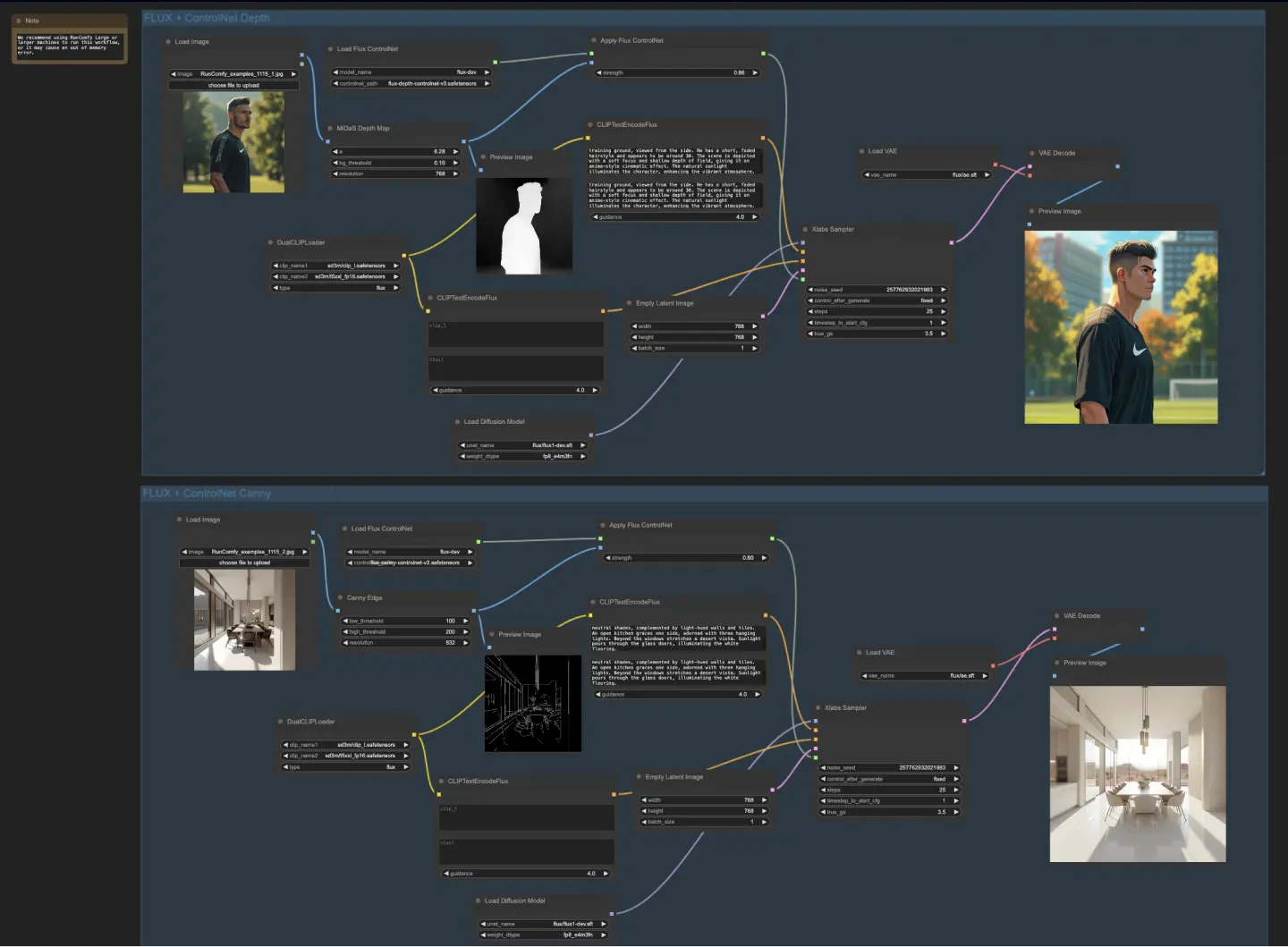

FLUX ControlNet Depth-V3 & Canny-V3

Transformieren Sie Ihren kreativen Prozess mit FLUX-ControlNet Depth und Canny Modellen, die für FLUX.1 [dev] von XLabs AI entwickelt wurden. Dieser ComfyUI-Workflow führt Sie durch das Laden von Modellen, das Einstellen von Parametern und das Kombinieren von FLUX-ControlNets, um beispiellose Kontrolle über Bildinhalt und -struktur zu erreichen. Ob Sie Tiefenkarten oder Kantenerkennung verwenden, FLUX-ControlNet befähigt Sie, atemberaubende KI-Kunst zu schaffen.ComfyUI FLUX-ControlNet Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI FLUX-ControlNet Beispiele

ComfyUI FLUX-ControlNet Beschreibung

FLUX ist ein neues Bildgenerierungsmodell, entwickelt von . Die FLUX-ControlNet-Depth und FLUX-ControlNet-Canny Modelle wurden vom XLabs AI Team erstellt. Dieser ComfyUI FLUX ControlNet Workflow wurde ebenfalls vom XLabs AI Team erstellt. Für weitere Details besuchen Sie bitte . Alle Anerkennung geht an deren Beitrag.

Über FLUX

Die FLUX-Modelle sind auf RunComfy vorinstalliert, benannt flux/flux-schnell und flux/flux-dev.

- Beim Start einer RunComfy-Medium-Sized-Maschine: Wählen Sie den Checkpoint

flux-schnell, fp8und Clipt5_xxl_fp8, um Speicherproblemen vorzubeugen. - Beim Start einer RunComfy-Large-Sized- oder Above-Maschine: Wählen Sie einen großen Checkpoint

flux-dev, defaultund einen hohen Clipt5_xxl_fp16.

Für weitere Details besuchen Sie:

🌟Der folgende FLUX-ControlNet Workflow ist speziell für das Modell konzipiert.🌟

Über FLUX-ControlNet Workflow (FLUX-ControlNet-Depth-V3 und FLUX-ControlNet-Canny-V3)

Wir präsentieren zwei herausragende FLUX-ControlNet Workflows: FLUX-ControlNet-Depth und FLUX-ControlNet-Canny, die jeweils einzigartige Fähigkeiten bieten, um Ihren kreativen Prozess zu verbessern.

1. Wie man den ComfyUI FLUX-ControlNet-Depth-V3 Workflow verwendet

Das FLUX-ControlNet Depth Modell wird zuerst mit dem "LoadFluxControlNet"-Knoten geladen. Wählen Sie das Modell "flux-depth-controlnet.safetensors" für optimale Tiefenkontrolle.

- flux-depth-controlnet

- flux-depth-controlnet-v2

- flux-depth-controlnet-v3: ControlNet ist auf 1024x1024 Auflösung trainiert und funktioniert für 1024x1024 Auflösung, mit besserer und realistischerer Version

Verbinden Sie den Ausgang dieses Knotens mit dem "ApplyFluxControlNet"-Knoten. Verbinden Sie auch Ihr Tiefenbild mit dem Bildeingang dieses Knotens. Das Tiefenbild sollte ein Graustufenbild sein, bei dem nähere Objekte heller und entfernte Objekte dunkler sind, sodass FLUX-ControlNet die Tiefeninformation genau interpretieren kann.

Sie können die Tiefenkarte aus einem Eingabebild mit einem Tiefenschätzungsmodell generieren. Hier wird der "MiDaS-DepthMapPreprocessor"-Knoten verwendet, um das geladene Bild in eine für FLUX-ControlNet geeignete Tiefenkarte zu konvertieren. Wichtige Parameter:

- Schwellenwert = 6.28 (beeinflusst die Empfindlichkeit gegenüber Kanten)

- Tiefenskala = 0.1 (wie stark die Werte der Tiefenkarte skaliert werden)

- Ausgabengröße = 768 (Auflösung der Tiefenkarte)

Im "ApplyFluxControlNet"-Knoten bestimmt der Stärkeparameter, wie stark das generierte Bild durch die FLUX-ControlNet-Tiefenkonditionierung beeinflusst wird. Eine höhere Stärke lässt das Ergebnis näher an der Tiefenstruktur orientieren.

2. Wie man den ComfyUI FLUX-ControlNet-Canny-V3 Workflow verwendet

Der Prozess ist dem FLUX-ControlNet-Depth Workflow sehr ähnlich. Zuerst wird das FLUX-ControlNet Canny Modell mit "LoadFluxControlNet" geladen. Dann wird es mit dem "ApplyFluxControlNet"-Knoten verbunden.

- flux-canny-controlnet

- flux-canny-controlnet-v2

- flux-canny-controlnet-v3: ControlNet ist auf 1024x1024 Auflösung trainiert und funktioniert für 1024x1024 Auflösung, mit besserer und realistischerer Version

Das Eingabebild wird mit dem "CannyEdgePreprocessor"-Knoten in eine Canny-Kantenkarte umgewandelt, was es für FLUX-ControlNet optimiert. Wichtige Parameter:

- Niedriger Schwellenwert = 100 (Schwellenwert der Kantenintensität)

- Hoher Schwellenwert = 200 (Hystereseschwellenwert für Kanten)

- Größe = 832 (Auflösung der Kantenkarte)

Die resultierende Canny-Kantenkarte wird mit dem "ApplyFluxControlNet"-Knoten verbunden. Auch hier verwenden Sie den Stärkeparameter, um zu steuern, wie stark die Kantenkarte die FLUX-ControlNet-Generierung beeinflusst.

3. Sowohl für ComfyUI FLUX-ControlNet-Depth-V3 als auch ComfyUI FLUX-ControlNet-Canny-V3

In beiden FLUX-ControlNet Workflows wird der CLIP-kodierte Textprompt verbunden, um den Bildinhalt zu steuern, während die FLUX-ControlNet-Konditionierung die Struktur und Geometrie basierend auf der Tiefen- oder Kantenkarte kontrolliert.

Durch das Kombinieren verschiedener FLUX-ControlNets, Eingabemodalitäten wie Tiefe und Kanten und das Anpassen ihrer Stärke können Sie eine feinkörnige Kontrolle sowohl über den semantischen Inhalt als auch über die Struktur der von FLUX-ControlNet generierten Bilder erreichen.

Lizenz: controlnet.safetensors fällt unter die Nicht-kommerzielle Lizenz

Lizenz

Lizenzdateien anzeigen:

Das FLUX.1 [dev] Modell ist von Black Forest Labs. Inc. unter der FLUX.1 [dev] Nicht-kommerziellen Lizenz lizenziert. Urheberrecht Black Forest Labs. Inc.

IN KEINEM FALL HAFTET BLACK FOREST LABS, INC. FÜR IRGENDEINEN ANSPRUCH, SCHÄDEN ODER ANDERE HAFTUNG, OB IN EINER VERTRAGSKLAGE, TORT ODER ANDERWEITIG, DIE AUS DER VERWENDUNG DIESES MODELLS ENTSTEHEN.