IC-Light | Video-Beleuchtung | AnimateDiff

Mit dem ComfyUI IC-Light Workflow können Sie mühelos Ihre Videos mit menschlichen Charakteren mithilfe einer Lichtkarte neu beleuchten. Indem Sie Ihre Prompts und Elemente wie Formen und Neonlichter in Ihre Lichtkarten einfügen, regeneriert dieses Tool Ihr Video mit verbesserter Beleuchtung.ComfyUI IC-Light for Video Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI IC-Light for Video Beispiele

ComfyUI IC-Light for Video Beschreibung

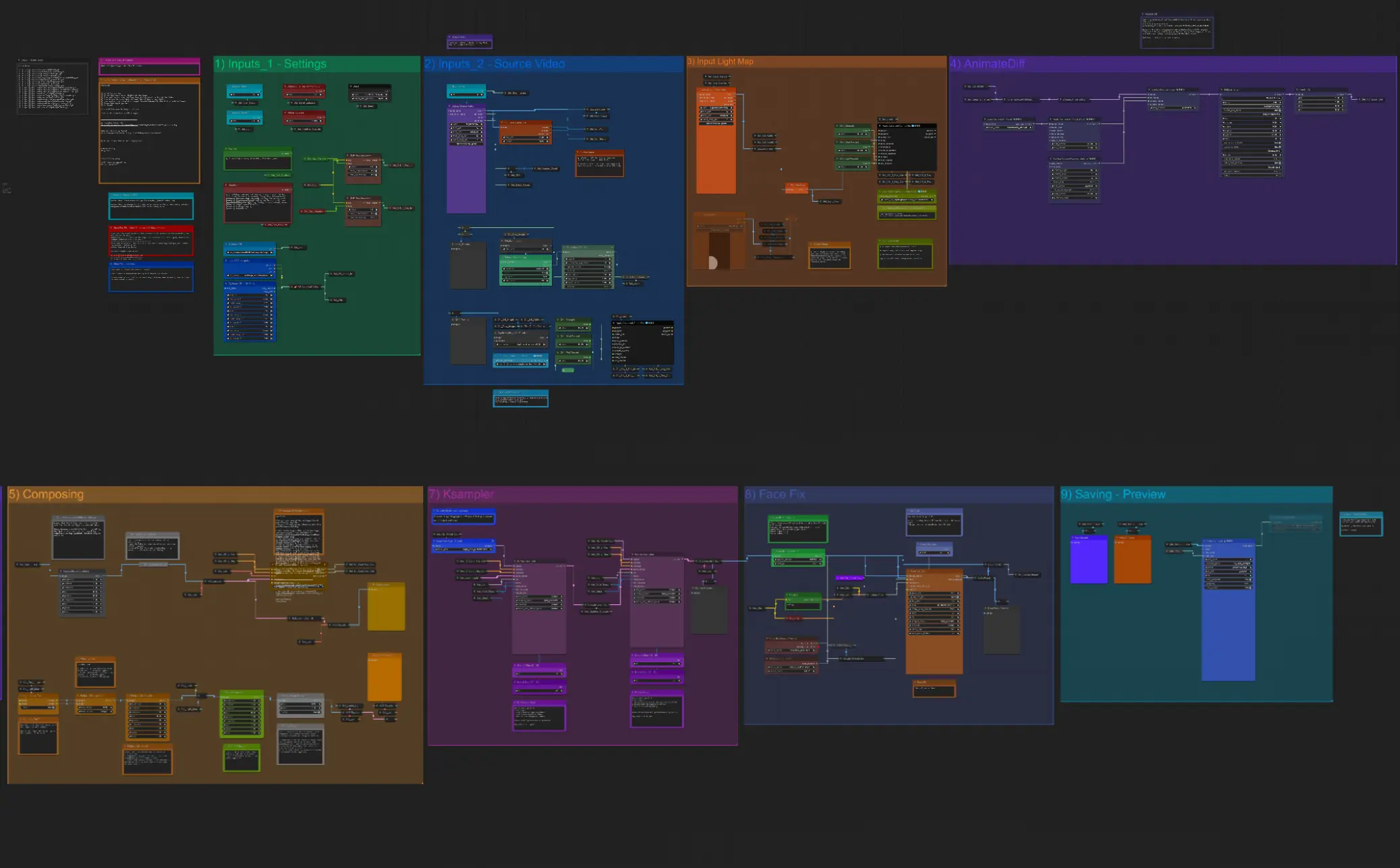

ComfyUI IC-Light Workflow für Video-Beleuchtung

Entfalten Sie das volle Potenzial Ihrer Videoprojekte mit dem ComfyUI IC-Light Workflow, der speziell für die Verbesserung der Beleuchtung in Ihren "Human"-Charakter-Videos mithilfe einer Lichtkarte entwickelt wurde. Mit ComfyUI IC-Light können Sie Ihre Videos ganz einfach transformieren, indem Sie einfach Ihre Prompts und Lichtkartenelemente wie Formen und Neonlichter bereitstellen. Das Tool erstellt ein neues Video mit deutlich verbesserter Beleuchtung.

WIE MAN DEN ComfyUI IC-Light Workflow VERWENDET

- Laden Sie das Quellvideo hoch: Beginnen Sie damit, das Video hochzuladen, das Sie verbessern möchten.

- Laden Sie ein Lichtkarten-Video oder ein einzelnes Lichtkarten-Bild hoch: Wählen Sie ein Lichtkarten-Video oder ein einzelnes Bild aus, das als neue Beleuchtungsvorlage dient.

- Geben Sie Load Cap und andere Einstellungen ein, dieselben Einstellungen sollten im Lichtkarten-Video vorhanden sein.

- Geben Sie Prompts ein, die Ihre neuen Lichteinstellungen wie Sonnenlicht oder Neonlichter beschreiben.

- Wählen Sie Ihr Modell. Ein realistisches Modell wird bevorzugt.

- Ändern Sie die Lichtkartenzusammensetzung und andere Einstellungen, falls erforderlich.

- Klicken Sie auf Render.

Ausgaben werden in ComfyUI > Outputs gespeichert

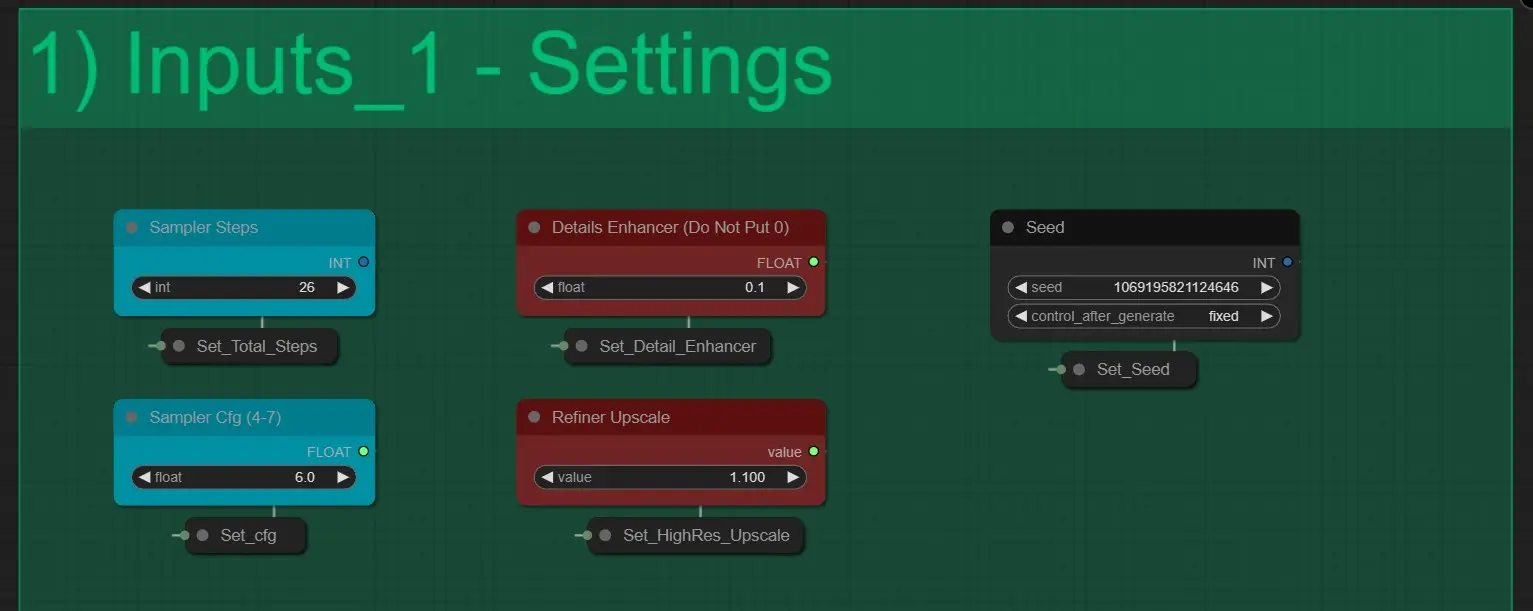

Inputs_1 - Einstellungen

Hier haben wir 5 Einstellungen:

- Sampler Steps: Bestimmt die Gesamtzahl der Schritte, die KSampler benötigt, um ein Bild zu rendern. Sollte nicht geändert werden. [Standardwert 26]

- Detail Enhancer: Erhöht die feinen Details im Endrender. [Verwenden Sie einen Wert zwischen 0.1 und 1]

- Seed: Kontrolliert den Generations-Seed für jeden KSampler.

- Sampler CFG: Kontrolliert die CFG-Werte der KSampler.

- Refiner Upscale: Funktioniert wie der Highres Fix-Wert. [Verwenden Sie Werte zwischen 1.1 und 1.6 für beste Ergebnisse]

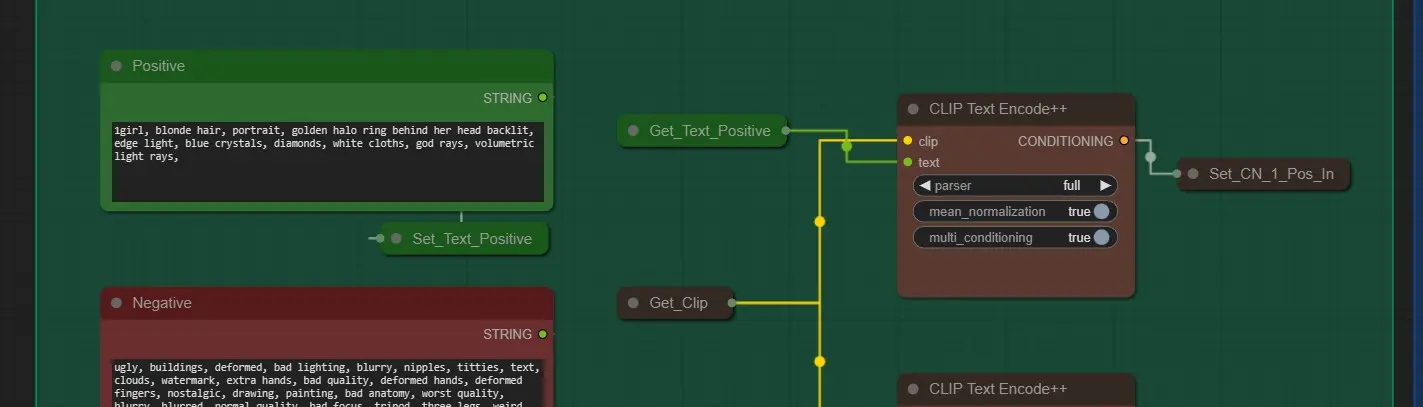

Prompts

- Positive Prompt: Geben Sie Prompts ein, die Ihr Bild mit der neuen Beleuchtung am besten beschreiben.

- Negative Prompts: Es ist so konfiguriert, dass es die besten Ergebnisse liefert. Fühlen Sie sich frei, es zu bearbeiten.

- Clip Text Encode nodes: Hilft beim Kodieren von Text, um die Qualität zu maximieren. Lassen Sie es auf "full"

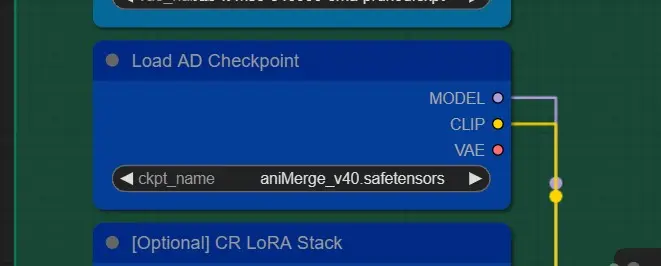

Modelle und Loras

- Checkpoint: Wählen Sie ein beliebiges realistic SD 1.5 Modell für genaue Ergebnisse. Fühlen Sie sich frei, ein beliebiges SD 1.5 Modell für stilistische Ergebnisse zu wählen.

- Loras: [Optional] Wählen Sie beliebige Loras aus der gegebenen Liste, wenn Sie möchten. Verwenden Sie sie nicht in voller Stärke. Verwenden Sie etwa 0.5-0.7 für den besten Effekt

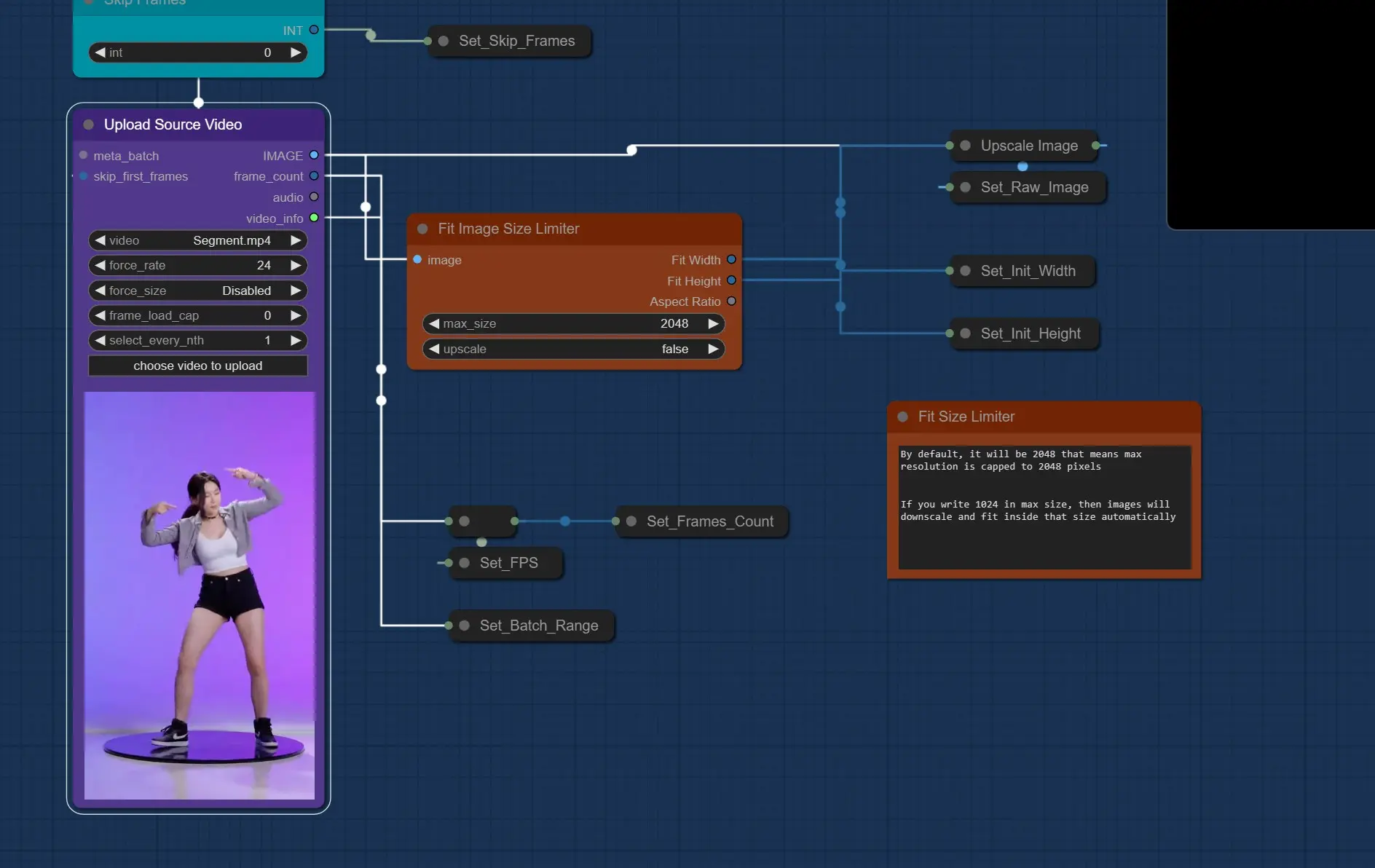

Quellvideo hochladen

- Quellvideo hochladen: Hier klicken und Ihr Human Character-Video hochladen, dessen Beleuchtung Sie ändern möchten.

- Es sollte unter 100 MB sein, Comfy wird große Dateien nicht hochladen.

- Es sollte nicht länger als 15-20 Sekunden sein. Längere Videos können möglicherweise nicht gerendert werden.

- Es sollte in 720p oder niedriger sein

- Verwenden Sie Skip Frames Nodes, wenn Sie einige Startbilder überspringen müssen. [Lichtkarten-Videos werden ebenfalls diese Anzahl von Bildern überspringen]

- Bildgrößenbegrenzer anpassen: Hier begrenzen Sie die Renderauflösung, sei es Landschaft oder Porträt, die maximale Auflösung wird immer unter oder gleich dem festgelegten Wert sein.

- Verwenden Sie Werte zwischen 800 – 1200 für beste Ergebnisse. [Dies wird sich auf den Vram auswirken]

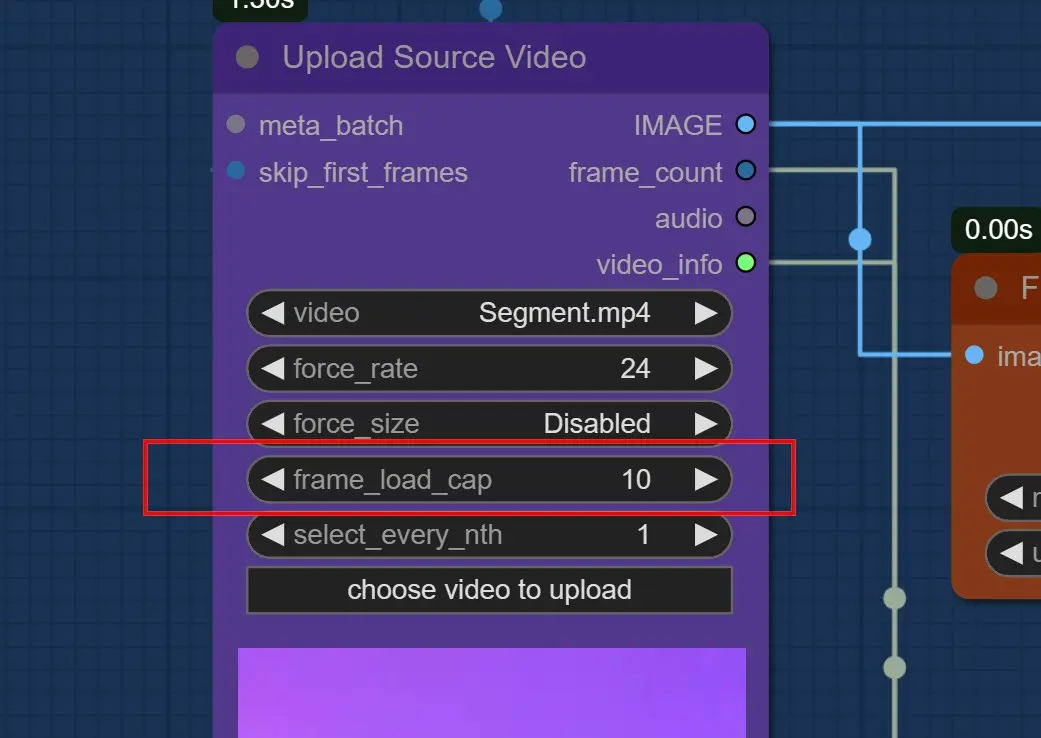

Wichtig: Verwenden Sie Frames Load Cap von 10, um es zuerst zu testen

- Verwenden Sie etwa 200 - 300 Frames bei 1000 – 1200 Fit-Größe, wenn Sie 24 GB haben.

- Verwenden Sie 0, wenn Sie alle Frames rendern möchten. [Nicht empfohlen für längere Videos]

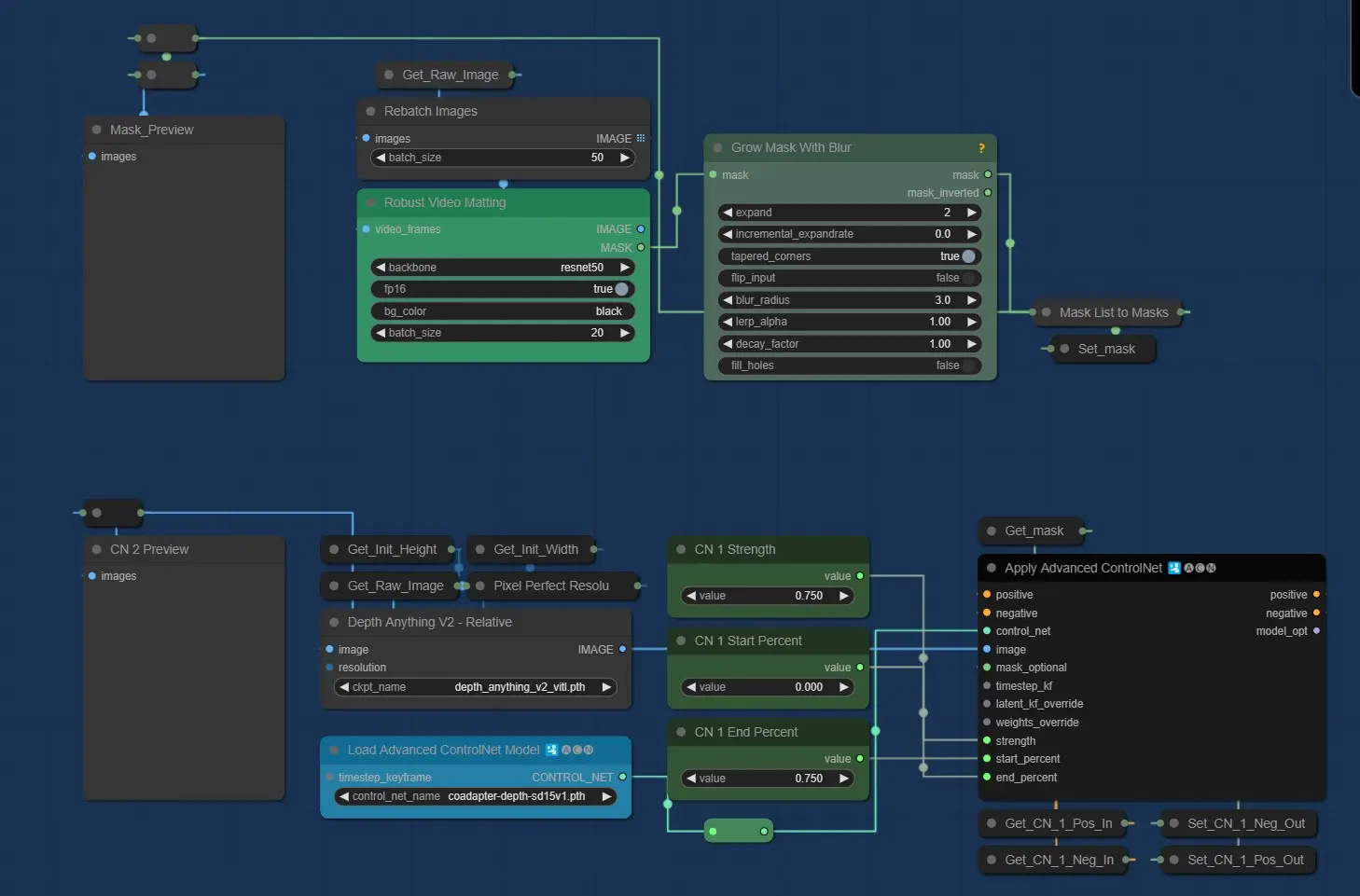

Masken- und Tiefeneinstellungen

- Maske: Verwendet Robust Video Matting, die Standardeinstellungen sind in Ordnung.

- Depth ControlNet: Verwendet die neuesten DepthAnything v2 Modelle.

- Stärke und Endprozentsatz sind auf 75% eingestellt, um optimale Ergebnisse zu erzielen.

- Verwenden Sie Co für beste Ergebnisse.

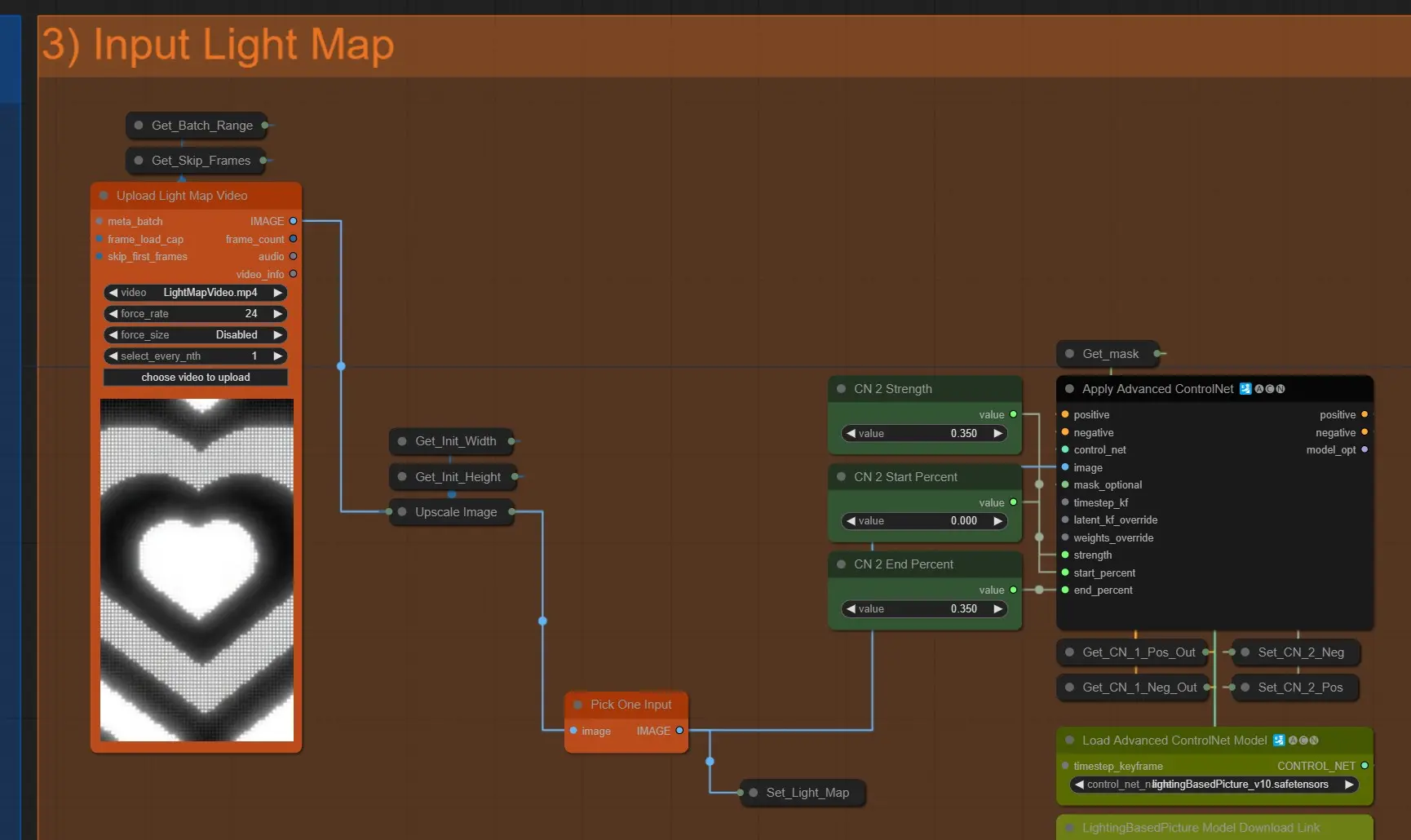

Lichtkarte

- Lichtkarte hochladen: Klicken und ein Lichtkarten-Video hochladen, das Sie möchten.

- Es wird automatisch auf die Abmessungen des Quellvideos skaliert

- Stellen Sie sicher, dass es länger oder gleich den Abmessungen des Quellvideos ist, sonst wird ein Fehler angezeigt.

- Light Map ControlNet: Diese Lichtkarte wird auch als Licht-ControlNet verwendet, indem verwendet wird.

- CN Stärke und Endprozentsatz: Verwenden Sie hier niedrige Werte, höhere Werte können zu Überbelichtung oder scharfem Lichtübergang führen.

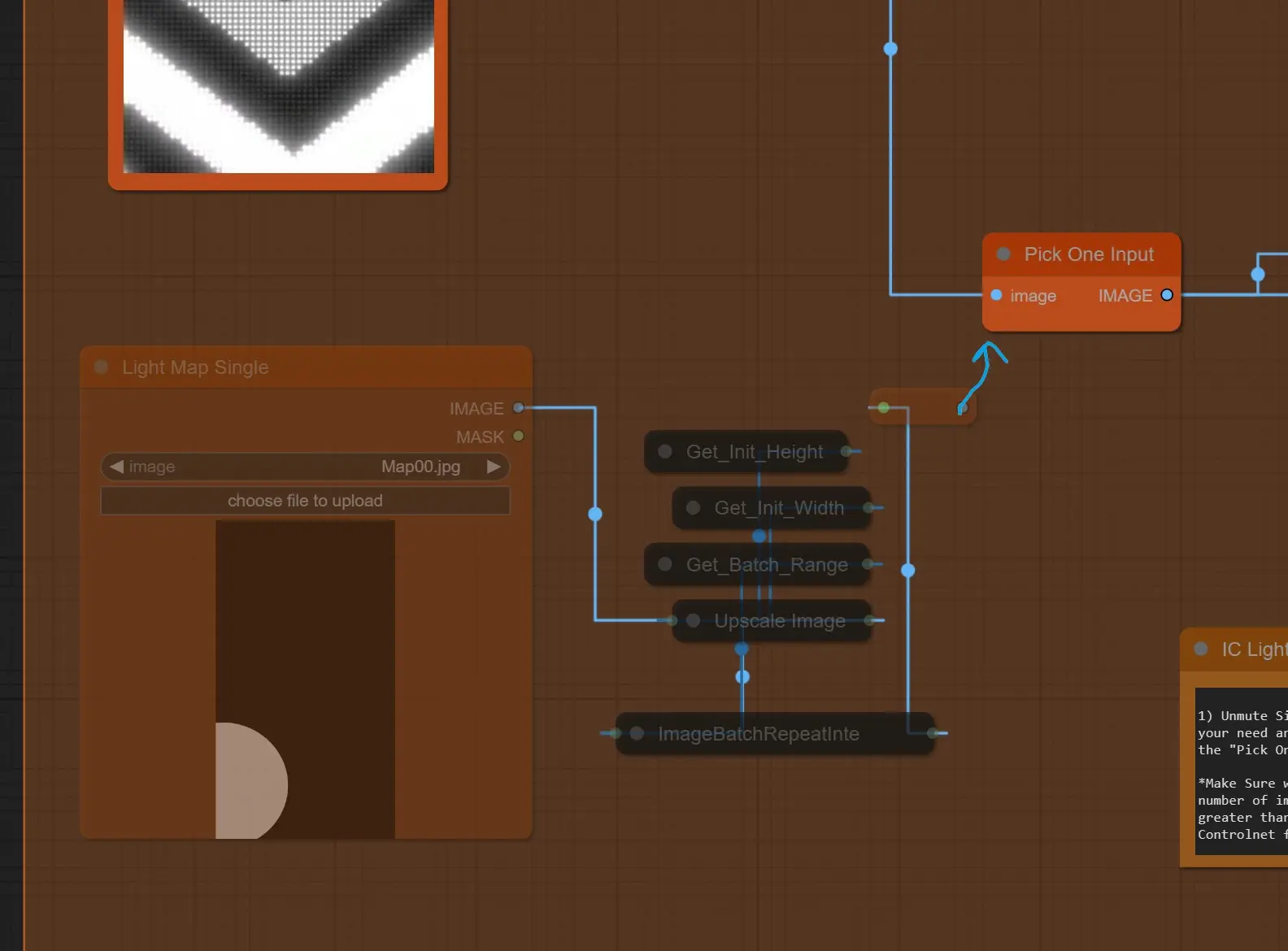

Einzelne Lichtkarte

- Um ein einzelnes Bild als Lichtkarte zu verwenden, schalten Sie diese Knoten stumm und verbinden Sie den Umleitungsknoten mit dem "Pick one Input"-Knoten.

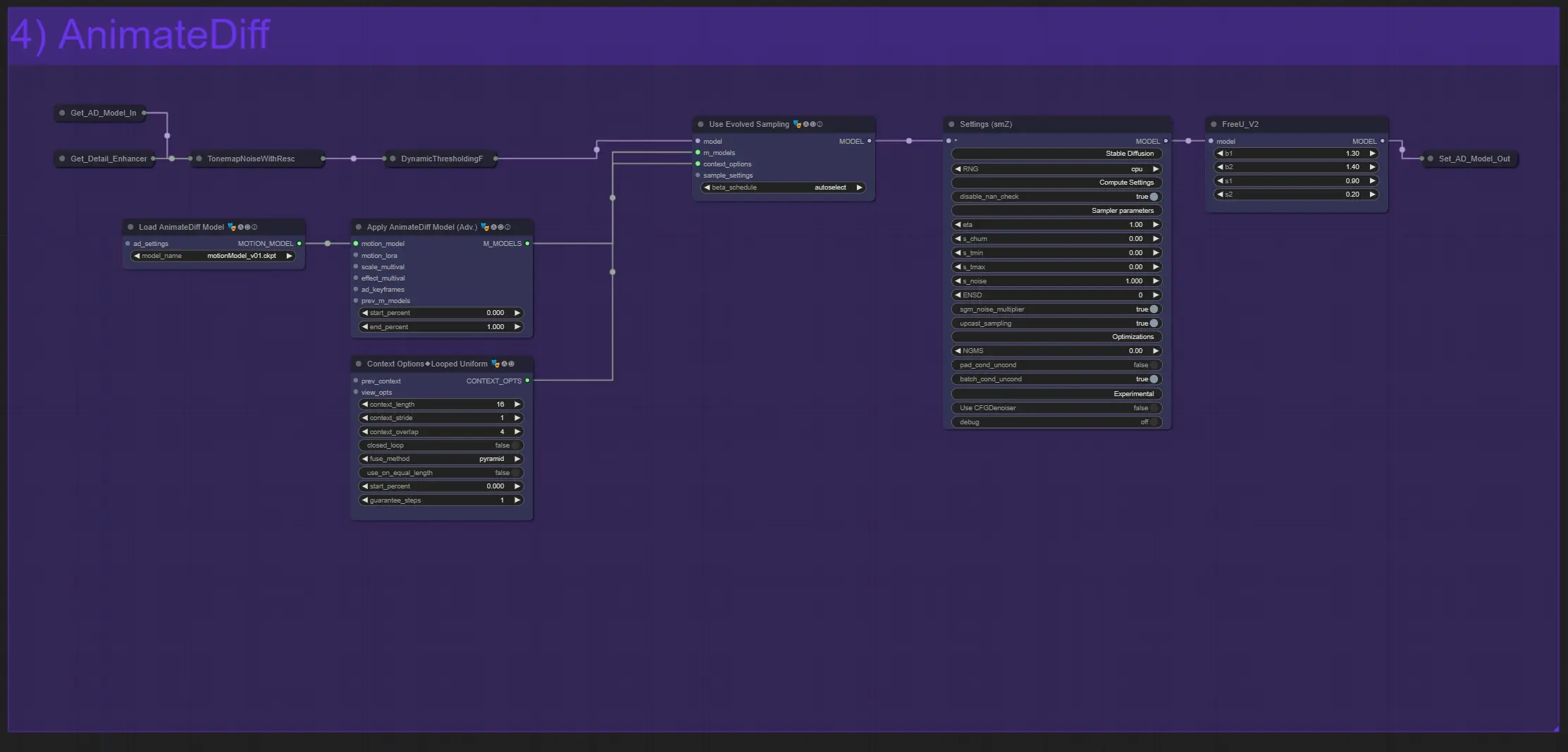

AnimateDIff

- Animatediff Modell laden: Sie können jedes Modell für verschiedene Effekte verwenden.

- Animatediff Andere Knoten: Sie müssen einige Kenntnisse über animatediff haben, um andere Einstellungen zu ändern [ Sie können sie finden ]

- Einstellungen SMZ: Dies ist ein Knoten, um die Qualität der Modell-Pipeline zu erhöhen, alle Einstellungen sind vordefiniert, um gut zu funktionieren.

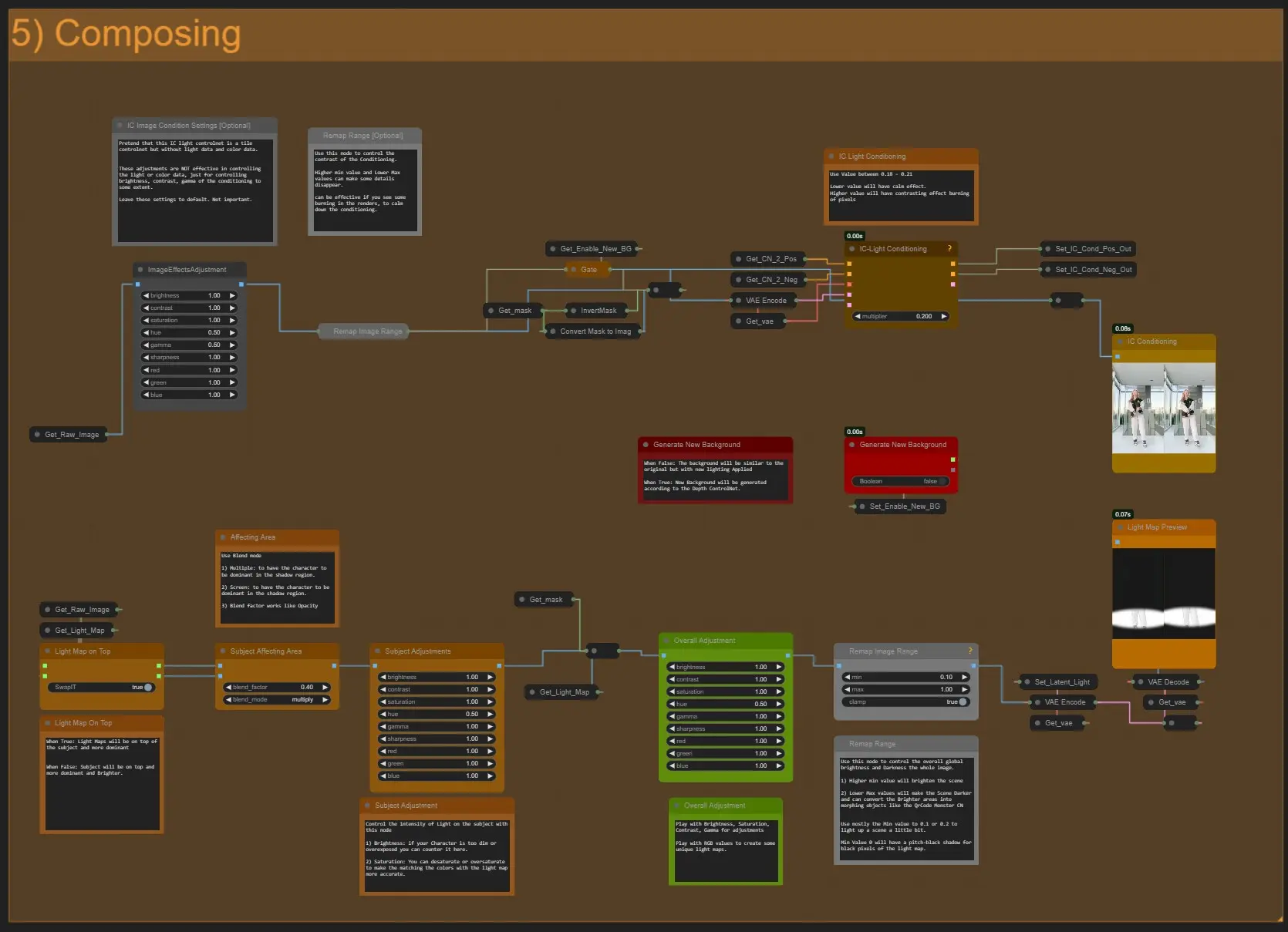

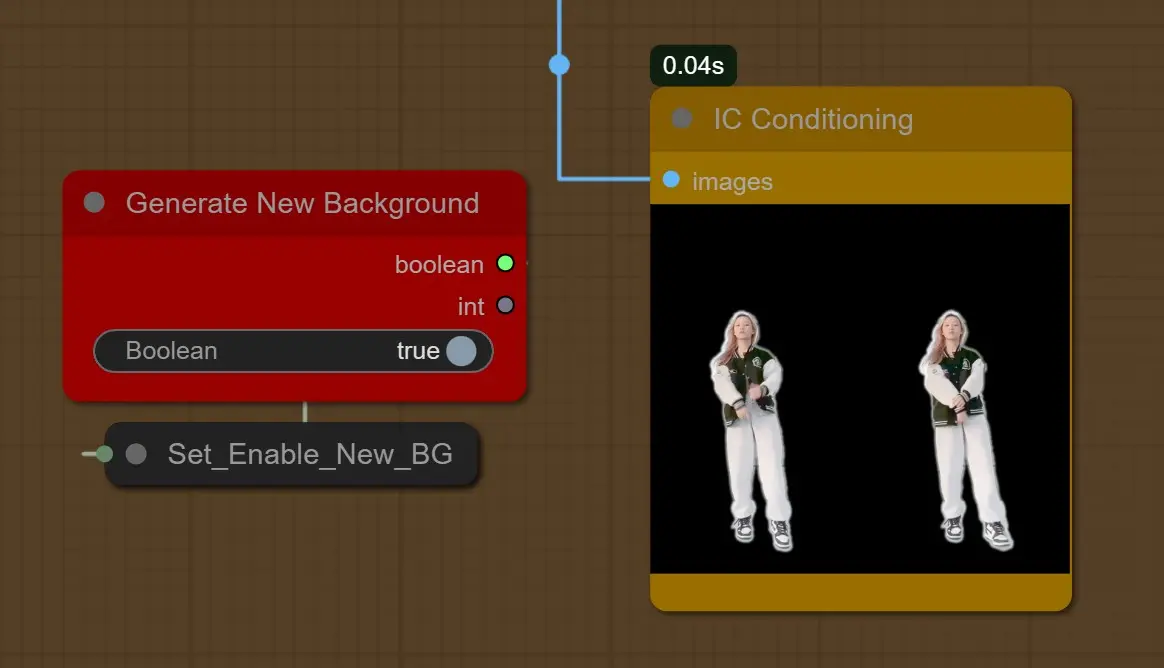

Zusammensetzung der Lichtkarte und IC-Conditioning

- Die oben genannten Anpassungsknoten (in grauer Farbe) steuern die Konditionierung des IC-Light-Conditionings, um den Kontrast zu verringern und die Helligkeit zu steuern.

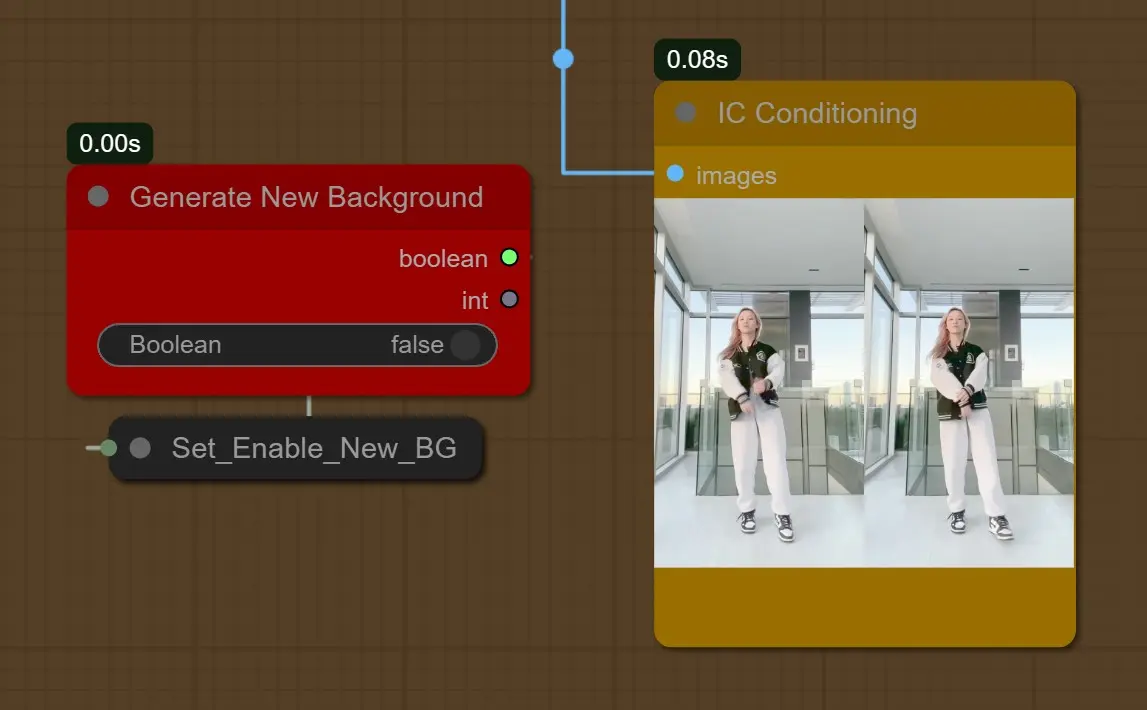

- Neues Hintergrundbild generieren: Wenn deaktiviert, werden die ursprünglichen Bildinputs verwendet und versucht, die Details ähnlich dem Hintergrund des Quellvideos gemäß den "Background Prompts" abzubilden, falls vorhanden im positiven Prompt-Feld

[1girl, sunlight, sunset, white shirt, black short jeans, interior, room]

- Wenn neues Hintergrundbild generieren aktiviert ist: Es wird ein neuer Hintergrund unter Berücksichtigung der Tiefe generiert

[1girl, sunlight, sunset, nature in the background, sky]

Auch die Stärke und der Endprozentsatz von Depth ControlNet wurden auf 45 % reduziert, um einen offenen Bereich im Hintergrund zu haben.

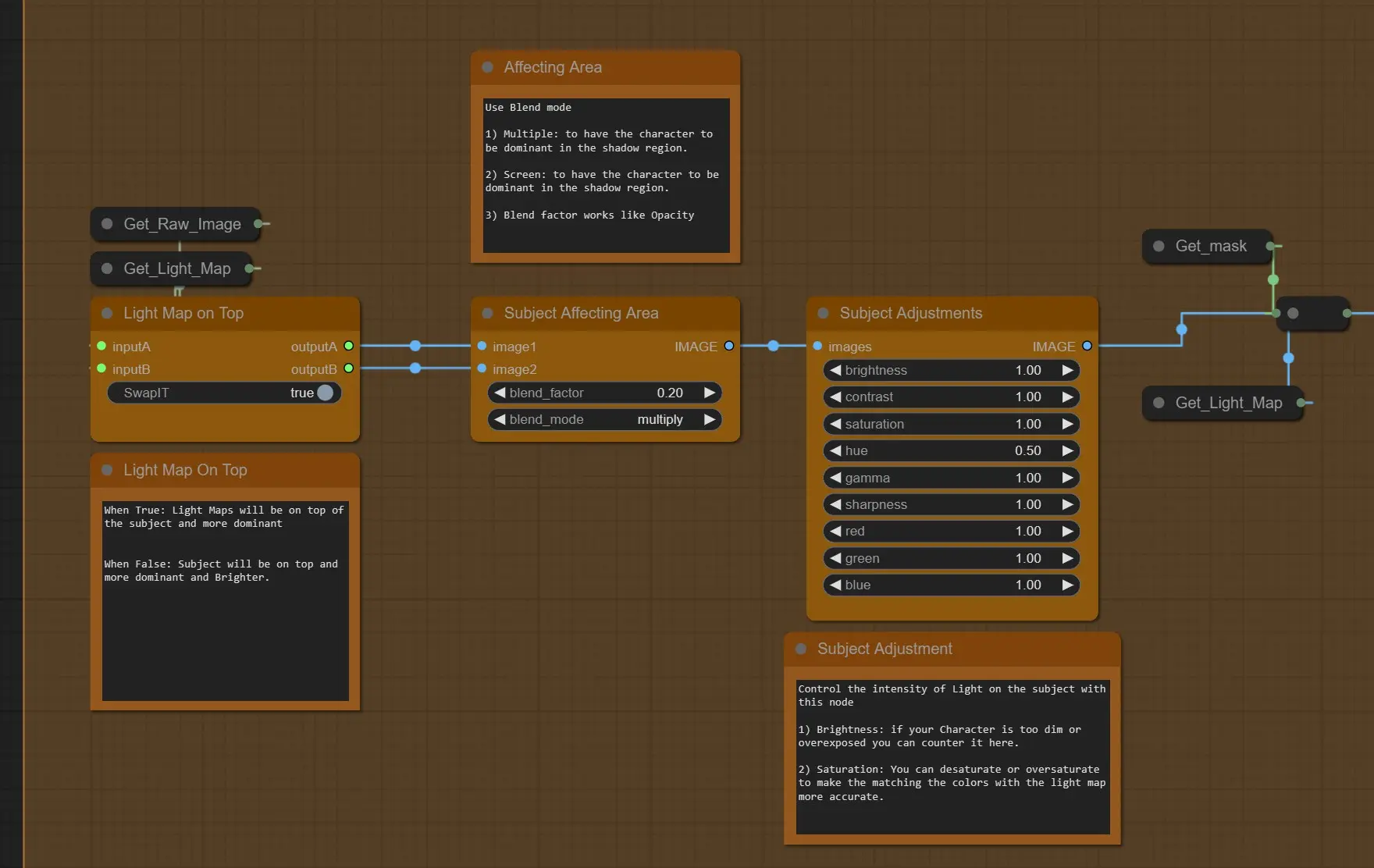

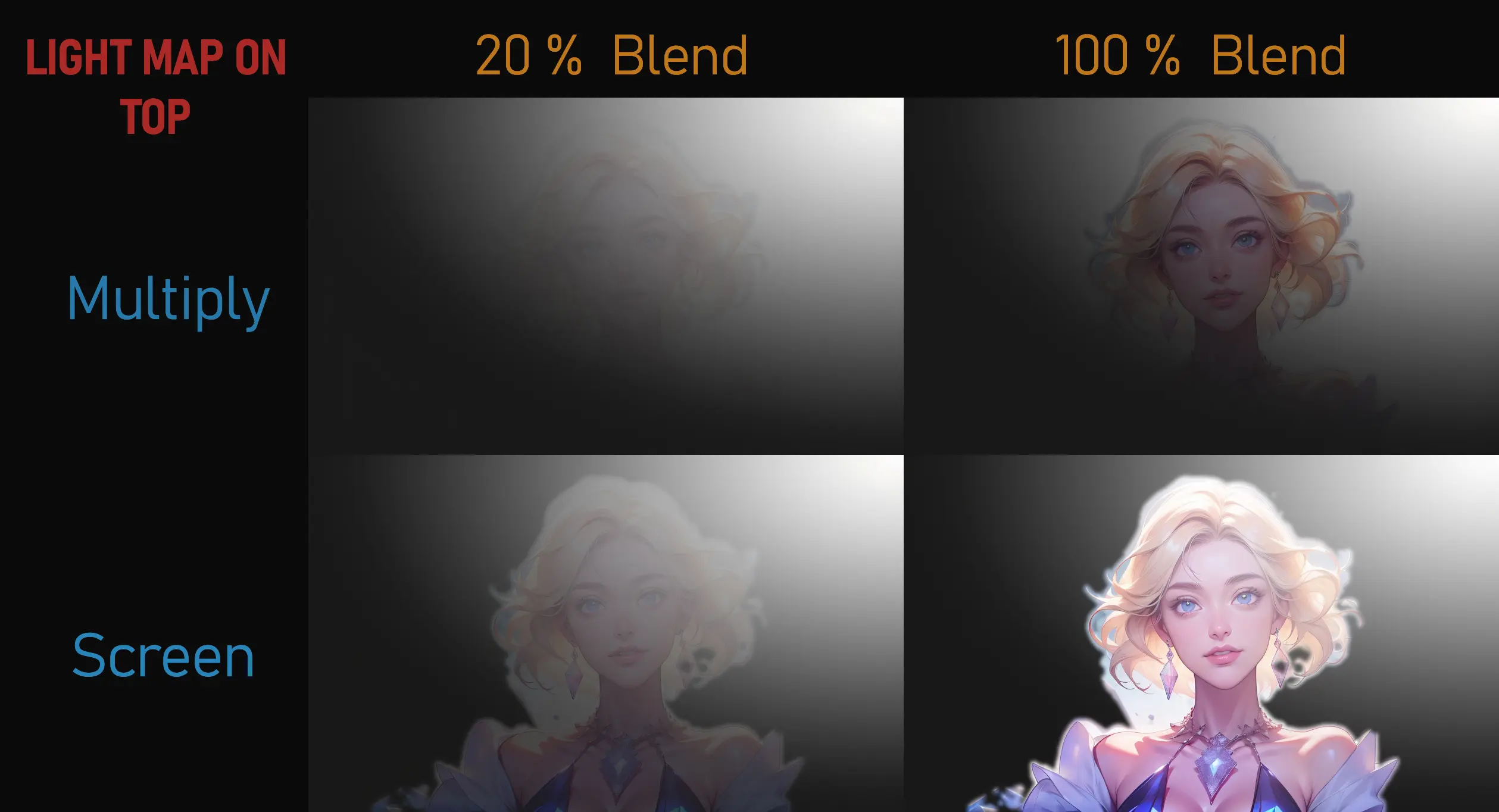

- Lichtkarte oben: Wenn wahr, wird die Lichtkarte oben auf dem Quellvideo und dominanter sein, wenn falsch, wird die Quelle oben, dominanter und heller sein

- Bereich, der das Subjekt betrifft: 2 Mischmodi funktionieren am besten

- Multiply: Verdunkelt die Schattenbereiche entsprechend der Lichtkarte oben oder unten

- Screen: Hellt die Schattenbereiche entsprechend der Lichtkarte oben oder unten auf

- Blend Factor ist für die Intensität.

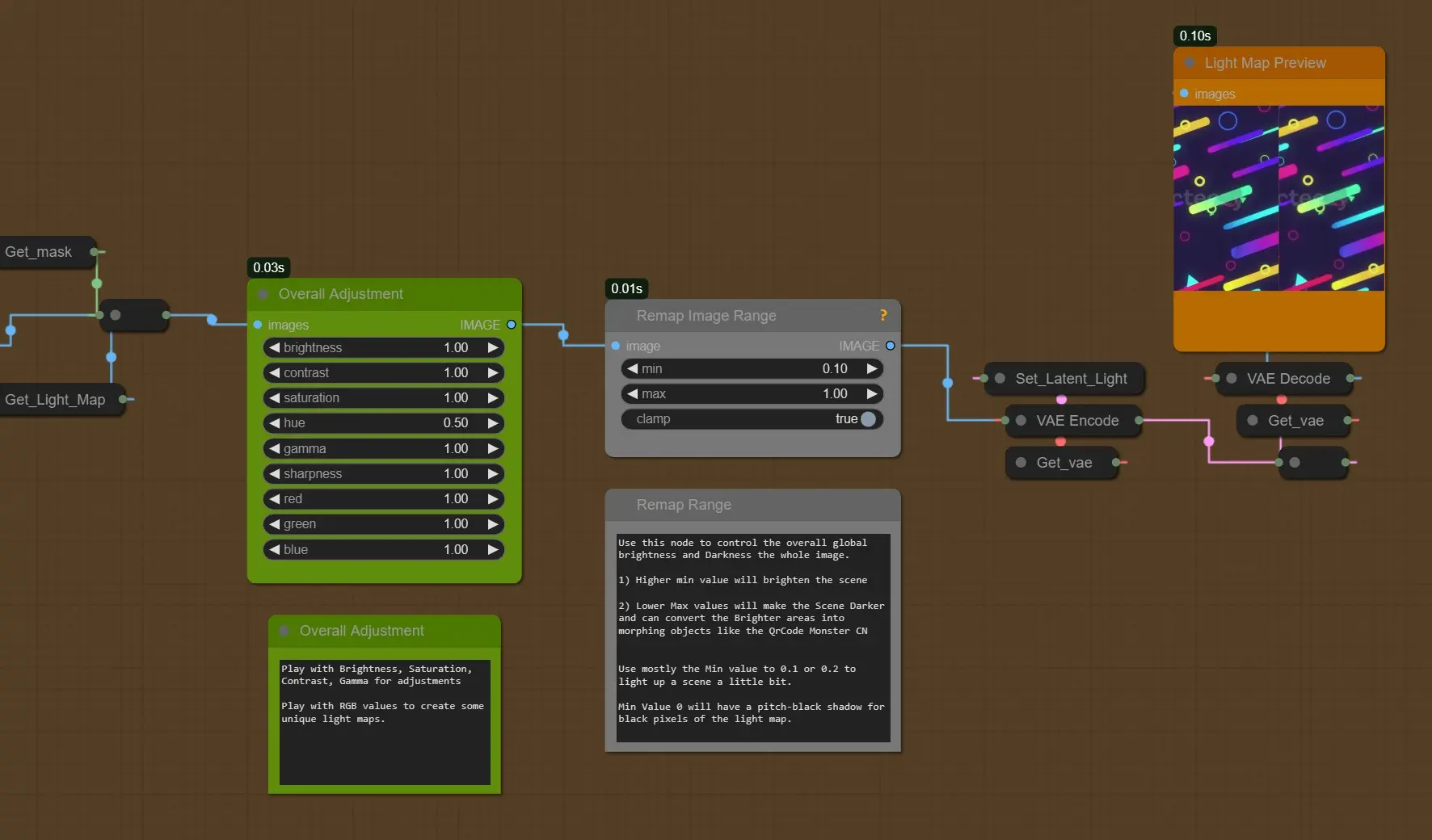

- Gesamteinstellungen: Dies steuert die Helligkeit, den Kontrast, das Gamma und den Farbton der final verarbeiteten Lichtkarte von oben.

- Bild-Remap: Verwenden Sie diesen Knoten, um die allgemeine globale Helligkeit und Dunkelheit des gesamten Bildes zu steuern.

- Höherer Min-Wert wird die Szene aufhellen

- Niedrigere Max-Werte machen die Szene dunkler und können die helleren Bereiche in morphende Objekte wie den QrCode Monster CN verwandeln

- Verwenden Sie hauptsächlich den Min-Wert auf 0.1 oder 0.2, um eine Szene ein wenig aufzuhellen.

- Min-Wert 0 wird einen pechschwarzen Schatten für schwarze Pixel der Lichtkarte haben.

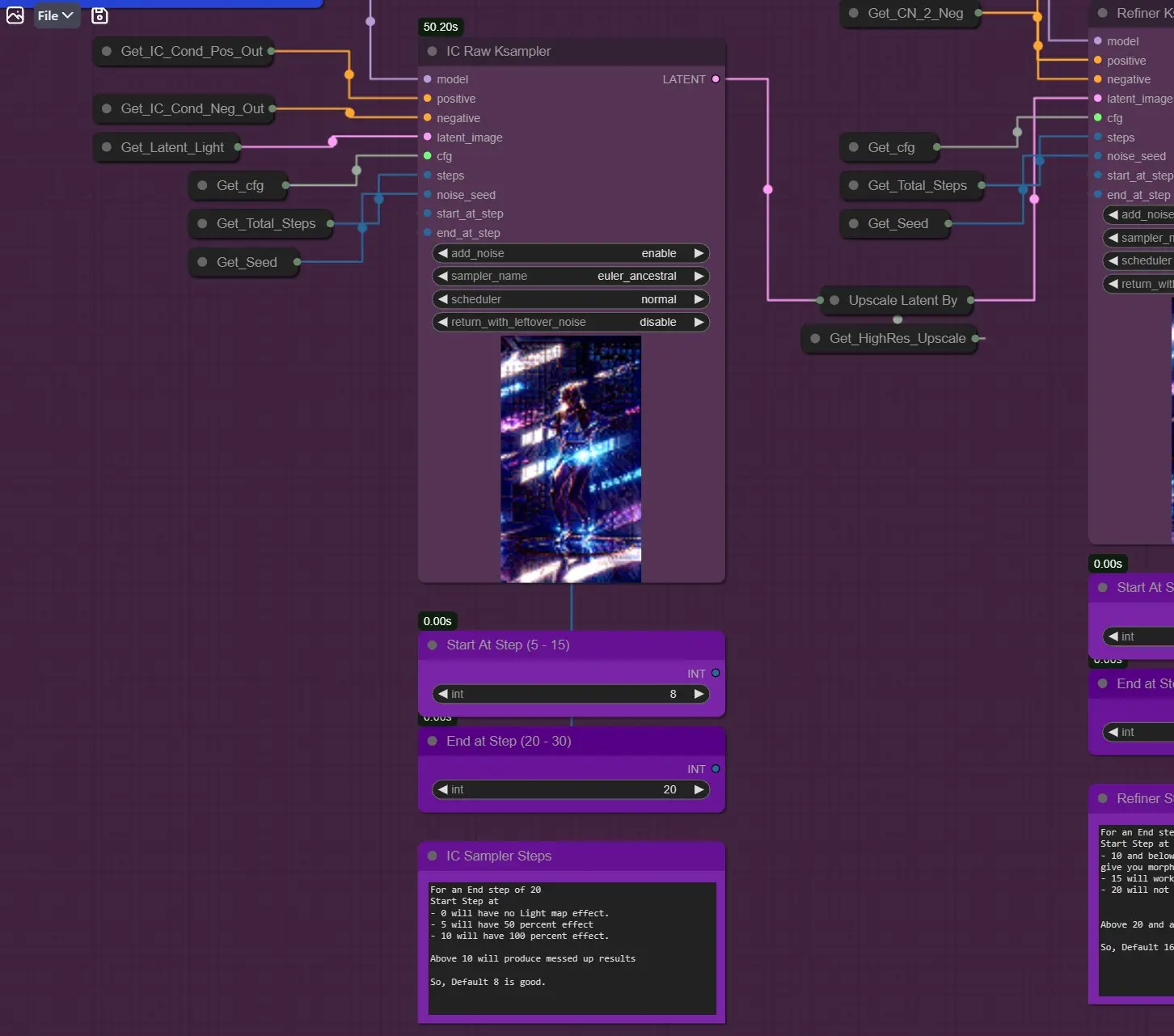

KSamplers (Raw und Refine)

IC Raw Ksampler: Anders als bei jedem anderen Sampler beginnt es bei Schritt 8 anstatt bei null, aufgrund der IC-Light-Bedingung (Die Frames werden ab dem 8. Schritt entrauscht)

- Zum Beispiel ein Endschritt von 20

- Startschritt bei

- 0 wird keinen Lichtkarteneffekt haben.

- 5 wird einen 50-prozentigen Effekt haben

- 10 wird einen 100-prozentigen Effekt haben.

- Also etwa 3-8 ist ein guter Wert zum Testen.

Wenn neues Hintergrundbild generieren auf TRUE gesetzt ist, können Sie für bessere Ergebnisse unter 5 gehen

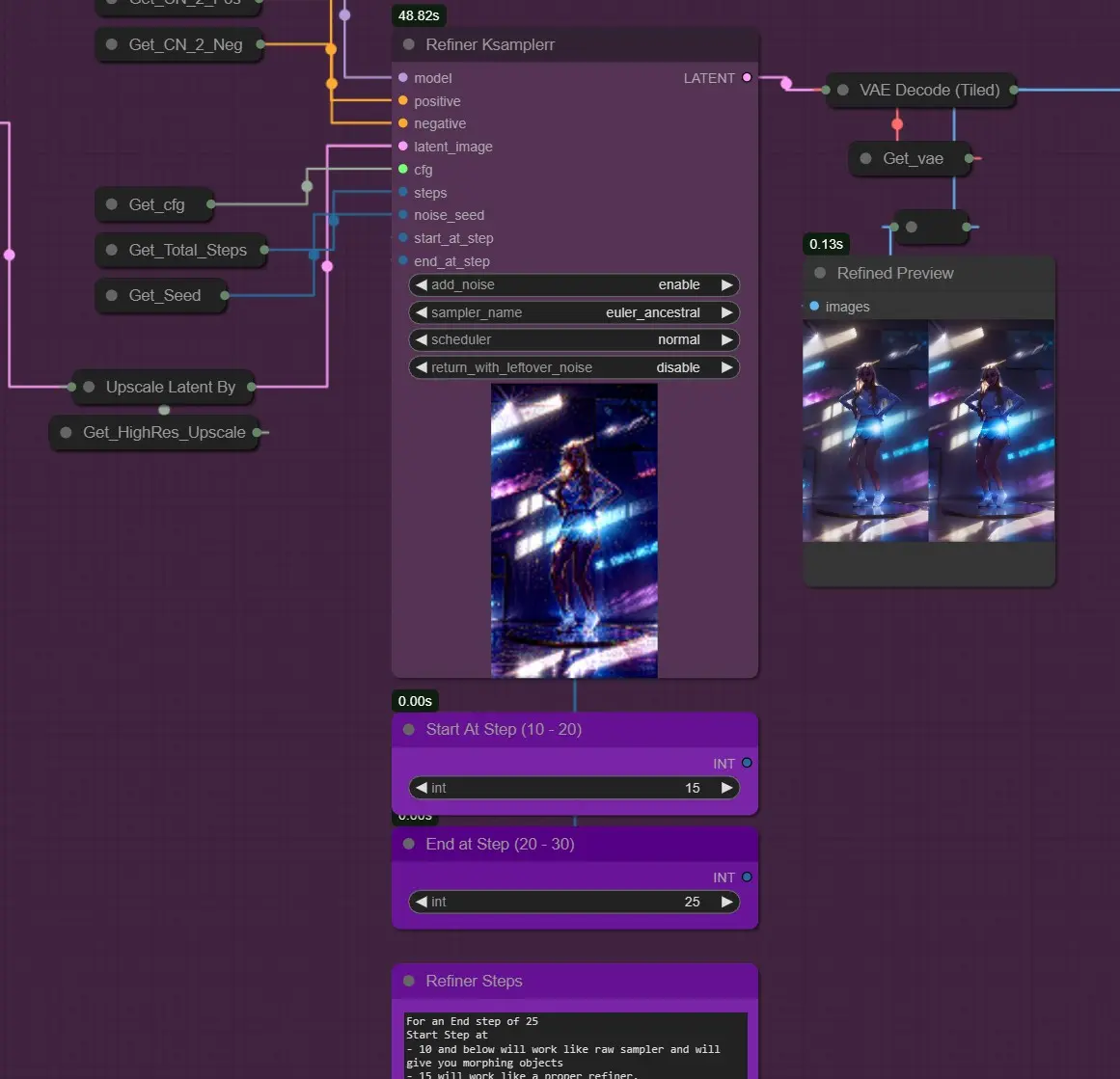

- Ksampler Refine: Funktioniert wie ein Img2Img-Refiner nach dem IC Raw Sampler.

Für einen Endschritt von 25

- Startschritt bei

- 10 und darunter wird wie ein Raw Sampler funktionieren und Ihnen morphende Objekte geben

- 15 wird wie ein ordentlicher Refiner funktionieren

- 20 wird nicht richtig funktionieren

- Über 20 und darüber werden chaotische Ergebnisse erzeugt

- Also ist der Standardwert 16 gut.

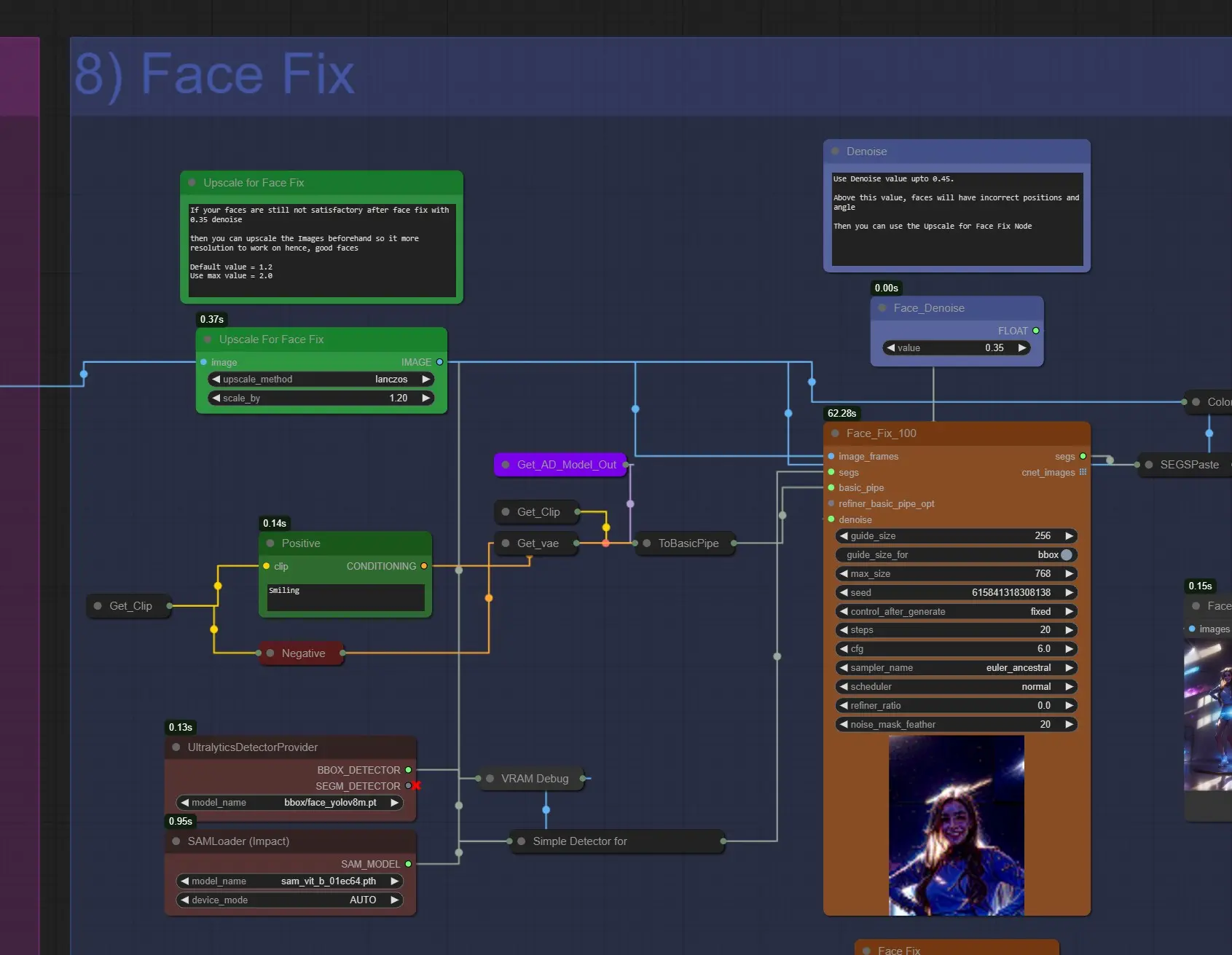

Gesichtskorrektur

- Upscale für Gesichtskorrektur: Wenn Ihre Gesichter nach der Gesichtskorrektur nicht zufriedenstellend sind, können Sie sie auf etwa 1.2 bis 1.6 hochskalieren, um bessere Gesichter zu erhalten.

- Positive Prompt: Hier können Sie die Prompts für das Gesicht schreiben. Es ist standardmäßig auf "smiling" eingestellt. Sie können es ändern.

- Gesichtsentrauschung: Verwenden Sie etwa 0.35 – 0.45. Bei höheren Werten kann das Gesicht falsch gerendert werden und es können Probleme mit rutschenden Gesichtern auftreten.

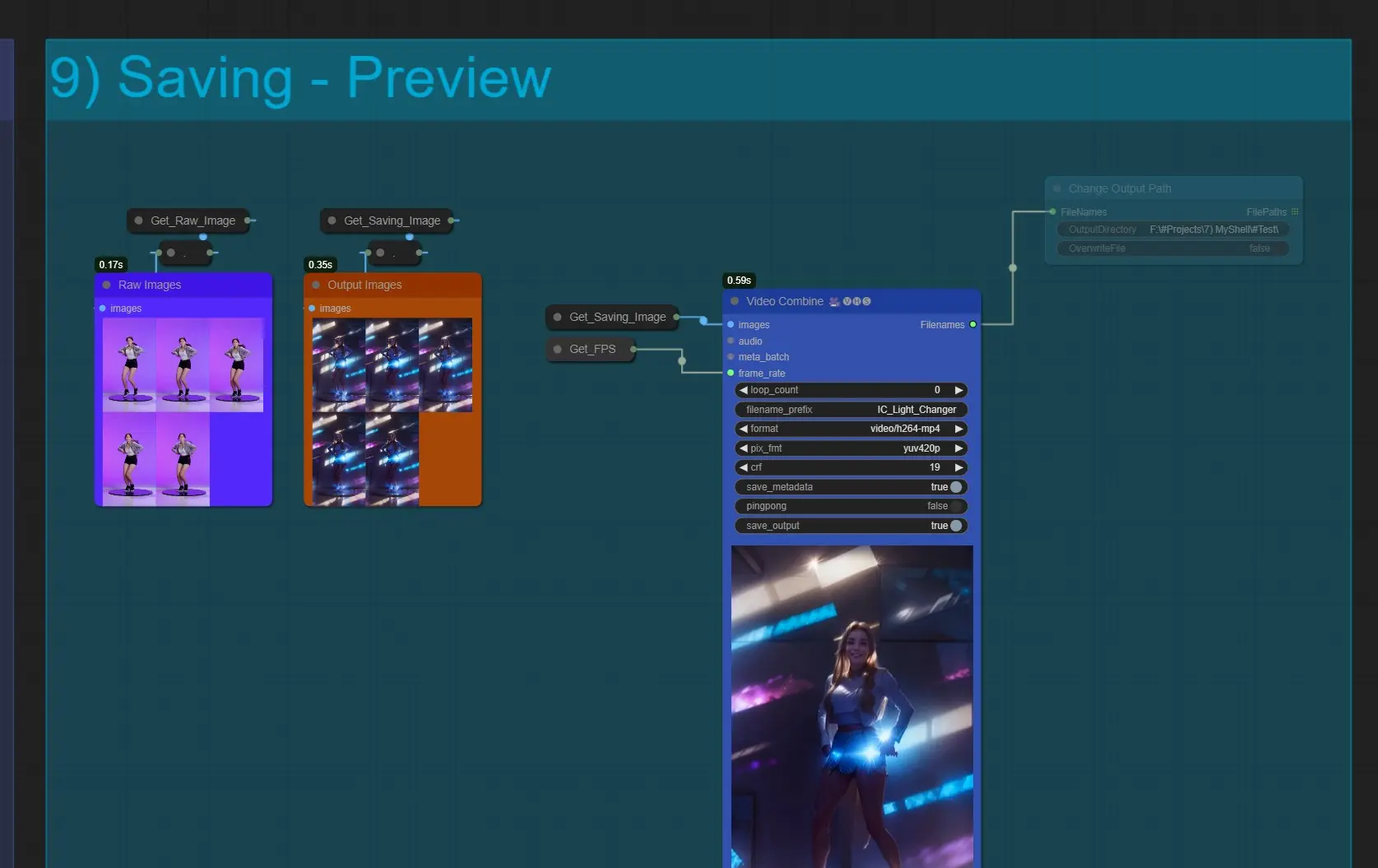

Speichern

- Video kombinieren: Dies wird alle Frames im Videoformat exportieren. Wenn dieser Knoten beim Kombinieren ausfällt, bedeutet dies, dass zu viele Frames vorhanden sind und der RAM ausgeht. Reduzieren Sie die Frames Load Cap, falls dies passiert

- Es wird standardmäßig in ComfyUI > Outputs gespeichert.

- Ausgabe-Pfad ändern: Schalten Sie diesen Knoten stumm, wenn Sie die Ausgabe an einem benutzerdefinierten Speicherort speichern möchten

Über den Autor dieses Workflows

Jerry Davos

- YouTube-Kanal: https://www.youtube.com/@jerrydavos

- Patreon: https://www.patreon.com/jerrydavos

Kontakte

- E-Mail: davos.jerry@gmail.com

- Discord: https://discord.gg/z9rgJyfPWJ