Vid2Vid Teil 1 | Komposition und Maskierung

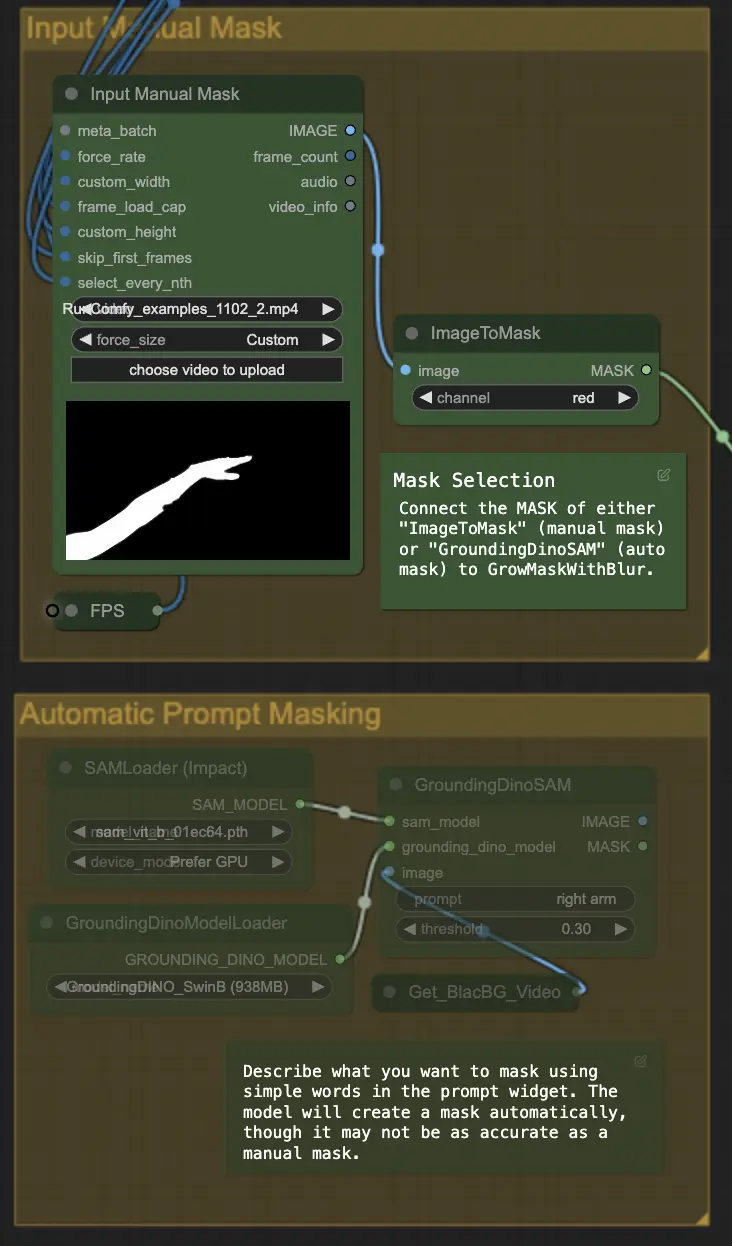

Der ComfyUI Vid2Vid bietet zwei unterschiedliche Workflows zur Erstellung hochwertiger, professioneller Animationen: Vid2Vid Teil 1, der Ihre Kreativität fördert, indem er sich auf die Komposition und Maskierung Ihres Originalvideos konzentriert, und Vid2Vid Teil 2, der SDXL Style Transfer nutzt, um den Stil Ihres Videos an Ihr gewünschtes ästhetisches Erscheinungsbild anzupassen. Diese Seite behandelt speziell Vid2Vid Teil 1.ComfyUI Vid2Vid Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI Vid2Vid Beispiele

ComfyUI Vid2Vid Beschreibung

Der ComfyUI Vid2Vid-Workflow, erstellt von , stellt zwei unterschiedliche Workflows vor, um hochwertige, professionelle Animationen zu erstellen.

- Der erste ComfyUI-Workflow: ComfyUI Vid2Vid Teil 1 | Komposition und Maskierung

- Der zweite Workflow:

ComfyUI Vid2Vid Teil 1 | Komposition und Maskierung

Dieser Workflow fördert die Kreativität, indem er sich auf die Komposition und Maskierung Ihres Originalvideos konzentriert.

Schritt 1: Modelle Laden | ComfyUI Vid2Vid Workflow Teil1

Wählen Sie die passenden Modelle für Ihre Animation aus. Dazu gehört die Auswahl des Checkpoint-Modells, des VAE (Variational Autoencoder)-Modells und des LoRA (Low-Rank Adaptation)-Modells. Diese Modelle sind entscheidend, um die Fähigkeiten und den Stil Ihrer Animation zu definieren.

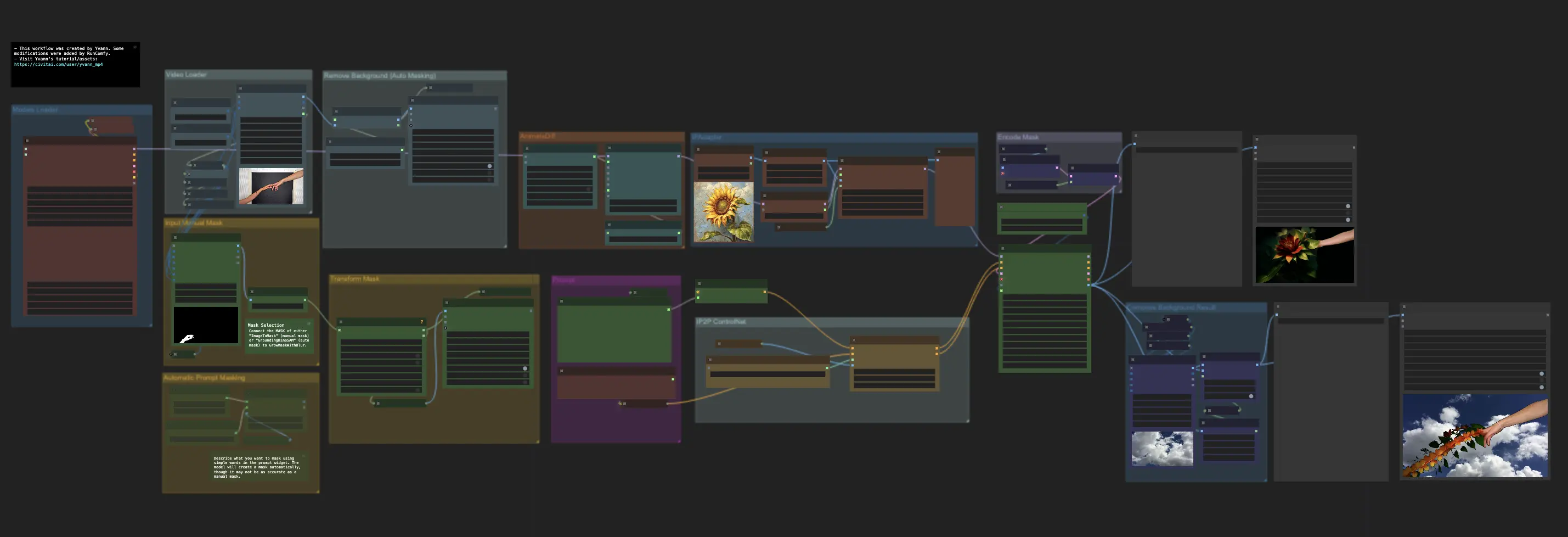

Schritt 2: Video Laden | ComfyUI Vid2Vid Workflow Teil1

Der Input Video-Knoten ist für das Importieren der Videodatei verantwortlich, die für die Animation verwendet wird. Der Knoten liest das Video und konvertiert es in einzelne Frames, die dann in den folgenden Schritten bearbeitet werden. Dies ermöglicht eine detaillierte Frame-für-Frame-Bearbeitung und -Verbesserung.

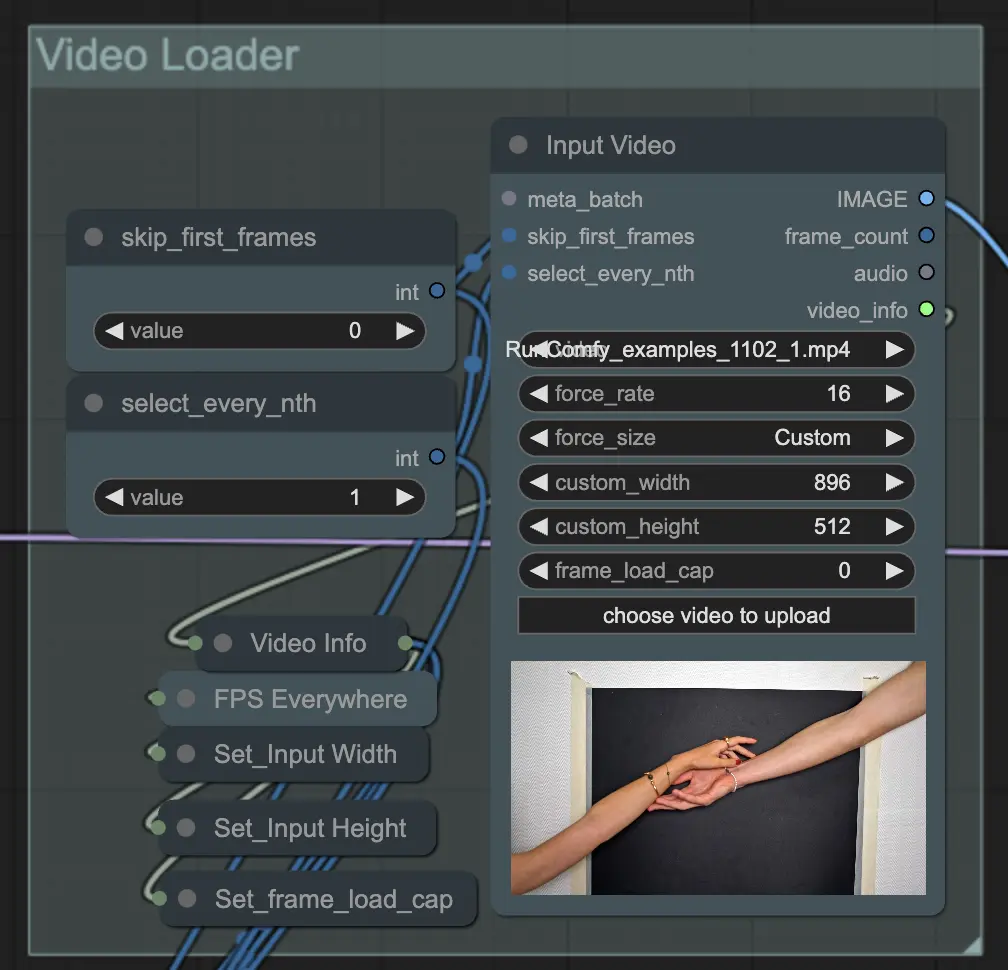

Schritt 3: Hintergrund Entfernen (Automatische Maskierung) | ComfyUI Vid2Vid Workflow Teil1

Hintergrund Entfernen (Automatische Maskierung) isoliert das Motiv vom Hintergrund mithilfe einer automatisierten Maskierungstechnik. Dies umfasst Modelle, die das Vordergrundmotiv vom Hintergrund erkennen und trennen, wodurch eine binäre Maske erstellt wird. Dieser Schritt ist entscheidend, um sicherzustellen, dass das Motiv unabhängig vom Hintergrund bearbeitet werden kann.

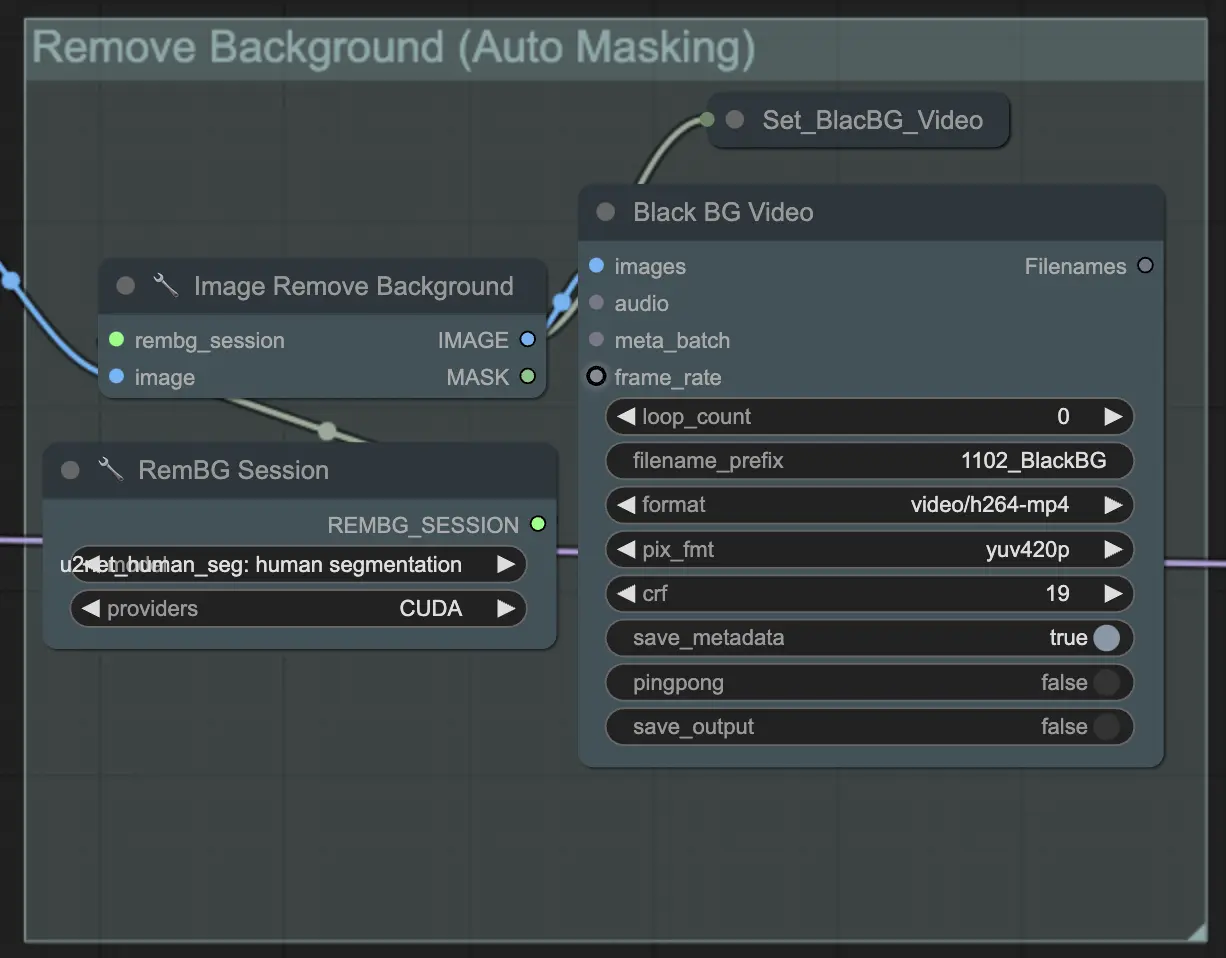

Schritt 4: Spezifischen Bereich Maskieren (Manuelle Maske oder Automatische Maske) | ComfyUI Vid2Vid Workflow Teil1

Dieser Schritt ermöglicht die Verfeinerung der im vorherigen Schritt erstellten Maske. Sie können entweder spezifische Bereiche manuell mit anderer Software maskieren oder die automatisierte Maskenfunktion 'Segment Anything' von ComfyUI verwenden.

- Manuelle Maske: Dies muss mit anderer Software außerhalb von ComfyUI für präzise Kontrolle durchgeführt werden.

- Automatische Maske: Mit der automatischen Maskenfunktion können Sie beschreiben, was Sie maskieren möchten, indem Sie einfache Worte im Prompt-Widget verwenden. Das Modell erstellt automatisch eine Maske, die jedoch möglicherweise nicht so genau ist wie eine manuelle Maske.

Die Standardversion verwendet eine manuelle Maske. Wenn Sie die automatische Maske ausprobieren möchten, umgehen Sie bitte die manuelle Maskengruppe und aktivieren Sie die automatische Maskengruppe. Verbinden Sie außerdem die MASKE von 'GroundingDinoSAM' (automatische Maske) mit 'GrowMaskWithBlur' anstelle von 'ImageToMask' (manuelle Maske) mit 'GrowMaskWithBlur'.

Schritt 5: Maske Transformieren | ComfyUI Vid2Vid Workflow Teil1

Maske Transformieren konvertiert die Maske in ein Bild und ermöglicht zusätzliche Anpassungen wie das Hinzufügen von Unschärfe zur ursprünglichen Maske. Dies hilft, die Ränder zu erweichen und die Maske natürlicher mit dem Rest des Bildes zu verbinden.

Schritt 6: Eingabeaufforderung | ComfyUI Vid2Vid Workflow Teil1

Geben Sie textuelle Eingabeaufforderungen ein, um den Animationsprozess zu leiten. Die Eingabeaufforderung kann den gewünschten Stil, das Aussehen oder die Aktionen des Motivs beschreiben. Dies ist entscheidend, um die kreative Richtung der Animation zu definieren und sicherzustellen, dass das Endergebnis dem vorgesehenen künstlerischen Stil entspricht.

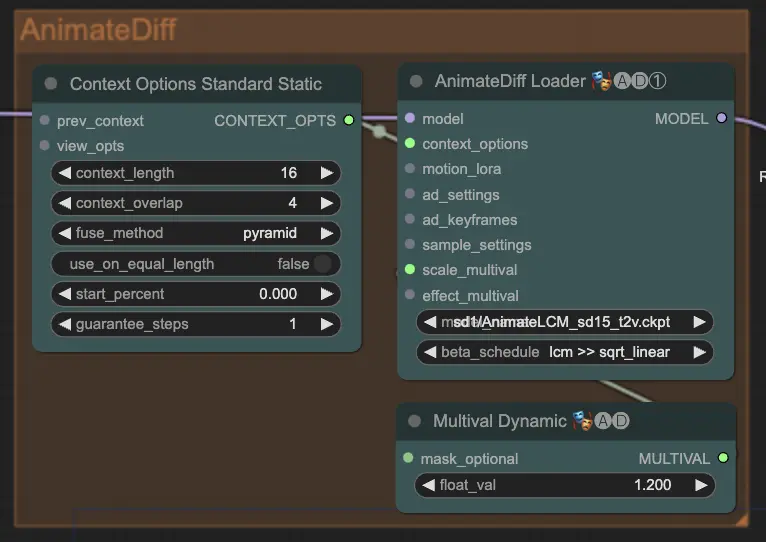

Schritt 7: AnimateDiff | ComfyUI Vid2Vid Workflow Teil1

Der AnimateDiff-Knoten erstellt reibungslose Animationen, indem er Unterschiede zwischen aufeinanderfolgenden Frames identifiziert und diese Änderungen schrittweise anwendet. Dies hilft, die Bewegungskohärenz zu bewahren und abrupte Änderungen in der Animation zu reduzieren, was zu einem flüssigeren und natürlicheren Aussehen führt.

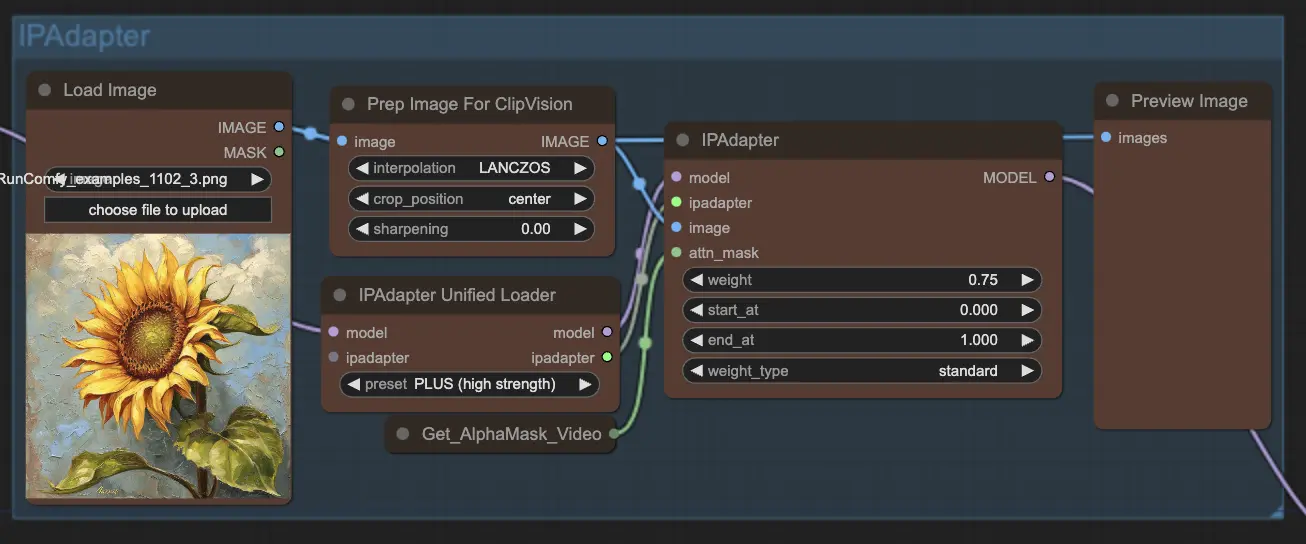

Schritt 8: IPAdapter | ComfyUI Vid2Vid Workflow Teil1

Der IPAdapter-Knoten passt die Eingabebilder an, um mit den gewünschten Ausgabestilen oder -merkmalen übereinzustimmen. Dazu gehören Aufgaben wie Kolorierung und Stiltransfer, um sicherzustellen, dass jeder Frame der Animation ein konsistentes Aussehen und Gefühl beibehält.

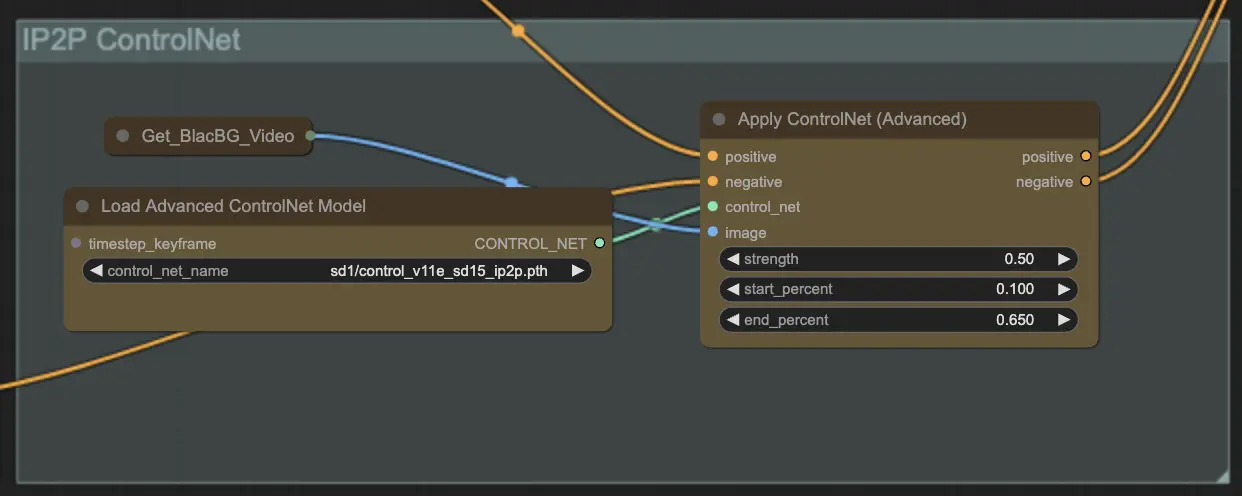

Schritt 9: ControlNet | ComfyUI Vid2Vid Workflow Teil1

Die Verwendung des ControlNet - v1.1 - Instruct Pix2Pix Version model verbessert Diffusionsmodelle, indem sie es ihnen ermöglicht, zusätzliche Eingabebedingungen (z. B. Kantenkarten, Segmentierungskarten) zu verarbeiten. Es erleichtert die Text-zu-Bild-Generierung, indem es diese vortrainierten Modelle mit aufgabenspezifischen Bedingungen in einem End-to-End-Verfahren steuert, was robustes Lernen auch mit kleineren Datensätzen ermöglicht.

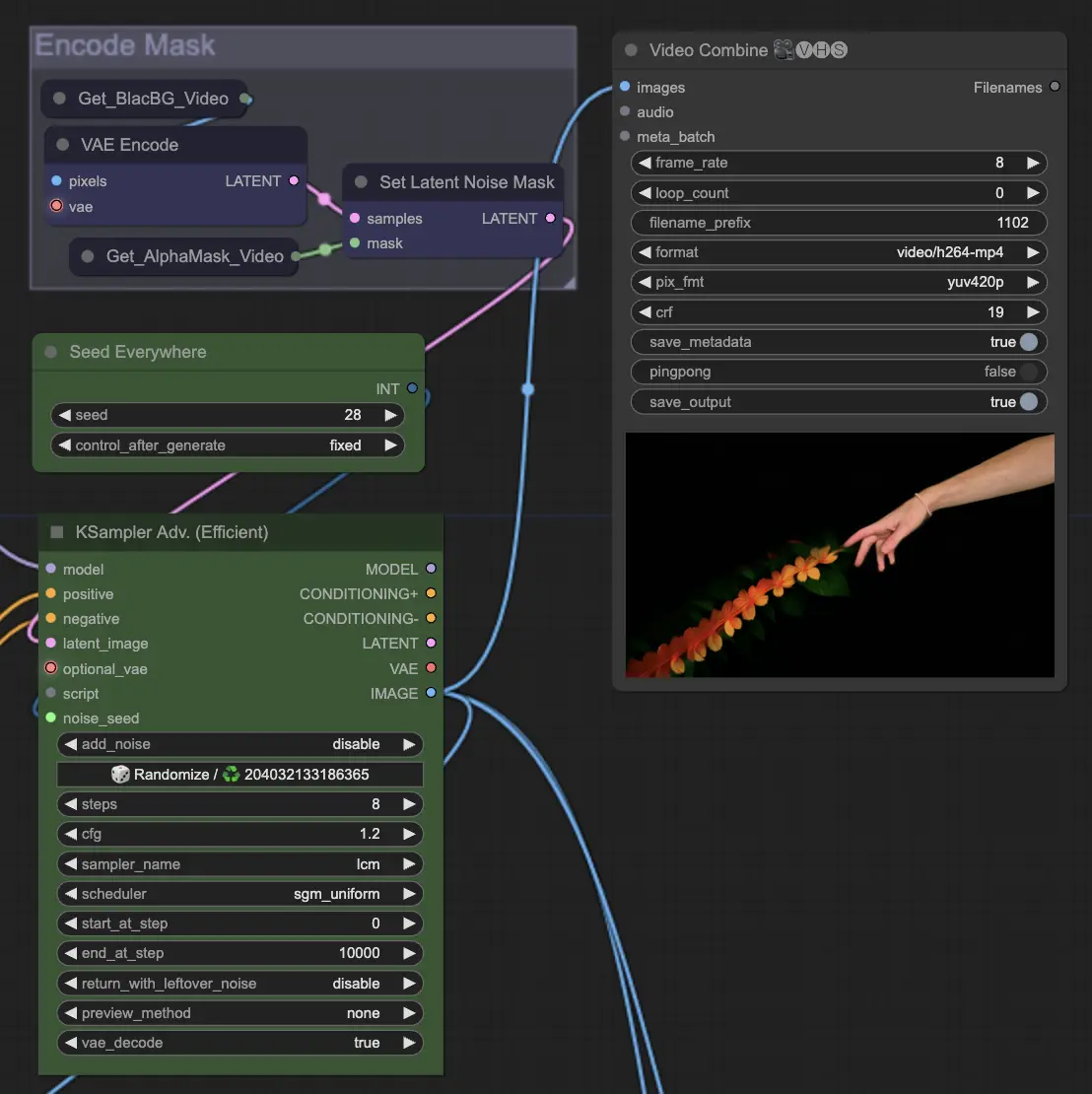

Schritt 10: Rendern | ComfyUI Vid2Vid Workflow Teil1

Im Rendern-Schritt werden die bearbeiteten Frames zu einem finalen Videoausgang zusammengefügt. Dieser Schritt stellt sicher, dass alle einzelnen Frames nahtlos zu einer kohärenten Animation kombiniert werden, die bereit zur Weiterverwendung und zum Export ist.

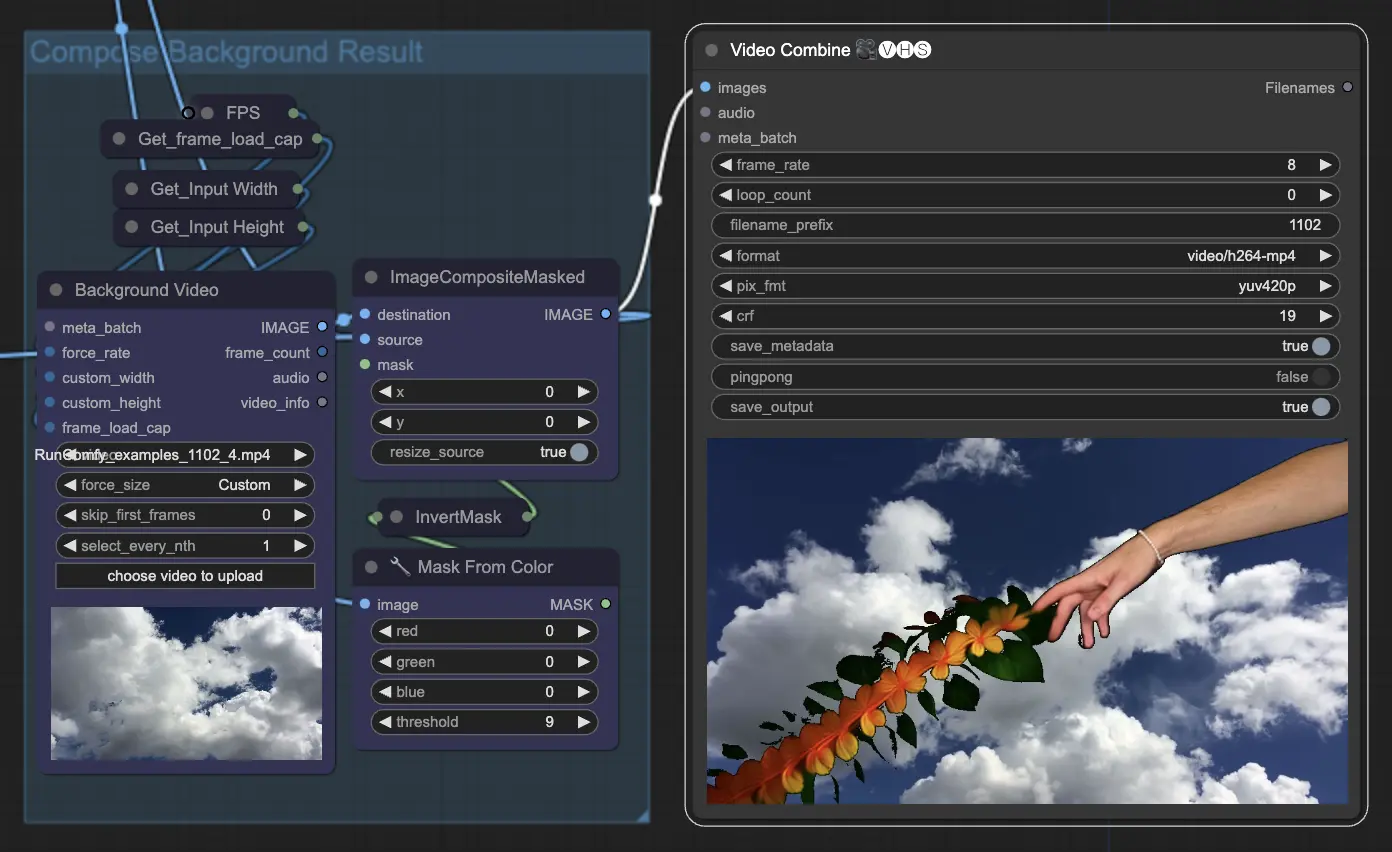

Schritt 11: Hintergrund Komponieren | ComfyUI Vid2Vid Workflow Teil1

Dies beinhaltet das Zusammenfügen des animierten Motivs mit dem Hintergrund. Sie können einen statischen oder dynamischen Hintergrund zur Animation hinzufügen und sicherstellen, dass das Motiv sich nahtlos in den neuen Hintergrund einfügt, um ein optisch ansprechendes Endprodukt zu erstellen.

Durch die Nutzung des ComfyUI Vid2Vid Workflow Teil1 können Sie komplexe Animationen mit präziser Kontrolle über jeden Aspekt des Prozesses erstellen, von der Komposition und Maskierung bis hin zum finalen Rendering.