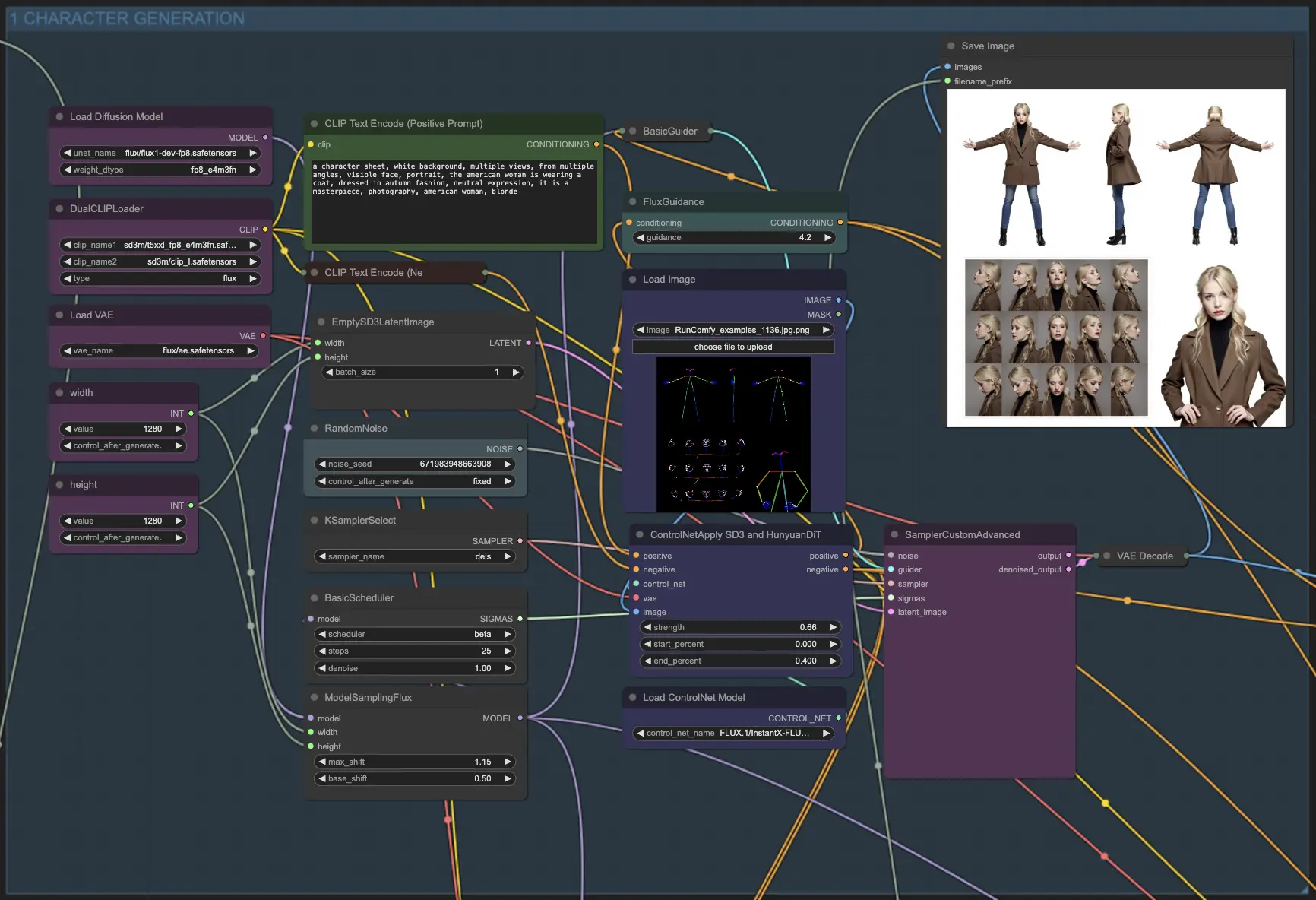

Konstante Charaktere mit Flux

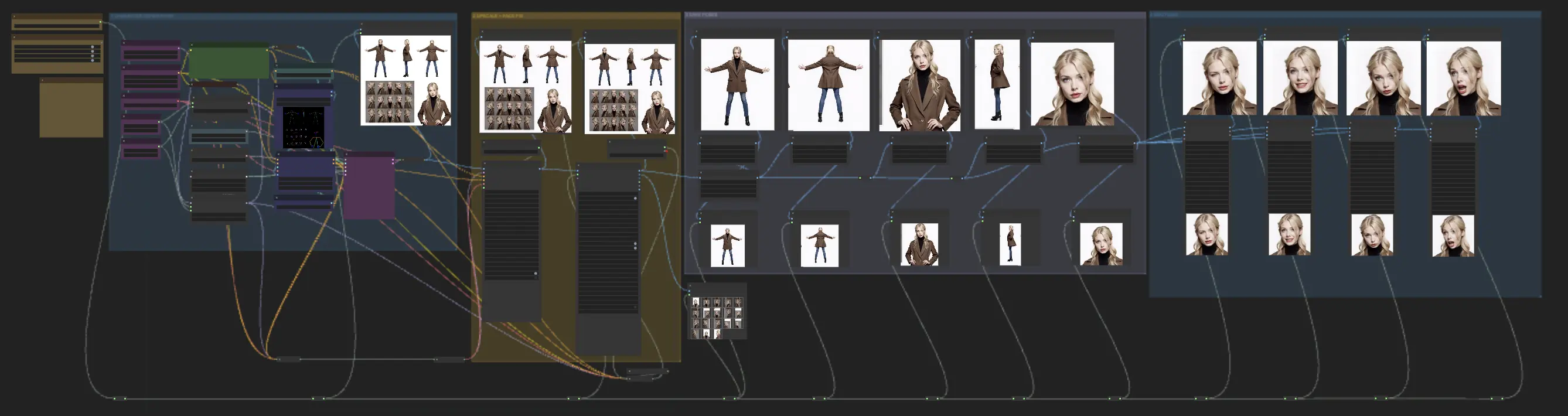

Der Konstante Charaktere mit Flux Workflow, erstellt von Mickmumpitz, ist ein leistungsstarkes ComfyUI-Tool, das die Konsistenz von KI-generierten Charakteren über mehrere Ausgaben hinweg aufrechterhält. Ideal für filmische KI-Filme, Kinderbücher oder jedes Projekt, das stabile Charaktererscheinungen erfordert, vereinfacht dieser auf Flux basierende Workflow den Prozess, um einheitliche Charakterlooks zu erreichen und reduziert den Bedarf an mehreren Eingabeaufforderungen und Feinabstimmungen.ComfyUI Consistent Characters with Flux Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI Consistent Characters with Flux Beispiele

ComfyUI Consistent Characters with Flux Beschreibung

Dieser Konstante Charaktere mit Flux Workflow wurde von erstellt. Wir empfehlen Ihnen dringend, sein detailliertes Tutorial anzusehen, um zu lernen, wie Sie diesen leistungsstarken Workflow für Konstante Charaktere effektiv nutzen können. Obwohl wir den Konstante Charaktere Workflow reproduziert und die Umgebung zu Ihrer Bequemlichkeit eingerichtet haben, gebührt Mickmumpitz alle Ehre für seine hervorragende Arbeit bei der Entwicklung dieser Flux-basierten Lösung für Konstante Charaktere.

Der Konstante Charaktere mit Flux

Der Konstante Charaktere Workflow mit Flux ist ein leistungsstarkes ComfyUI-Tool, das die Konsistenz von KI-generierten Charakteren über mehrere Ausgaben hinweg aufrechterhält. Es ist ideal für die Erstellung filmischer KI-Filme, Kinderbücher oder jedes Projekt, das stabile Erscheinungen von Konstante Charaktere erfordert. Dieser auf Flux basierende Workflow vereinfacht den Prozess, um einheitliche Erscheinungen von Konstante Charaktere zu erreichen, und reduziert den Bedarf an mehreren Eingabeaufforderungen und Feinabstimmungen. Durch die Nutzung des Flux.1 Dev-Modells verbessert es die Stabilität der generierten Konstante Charaktere und stellt sicher, dass sie das gleiche Aussehen und Gefühl beibehalten, sei es animiert oder realistisch gerendert.

Wie verwendet man den Konstante Charaktere mit Flux Workflow?

Der Konstante Charaktere Workflow mit Flux ist in vier Module unterteilt (Charaktergenerierung, Upscale + Face Fix, Posen, Emotionen), die jeweils darauf ausgelegt sind, den Prozess der Generierung von Konstante Charaktere mit einem einheitlichen Erscheinungsbild über mehrere Ausgaben hinweg zu optimieren.

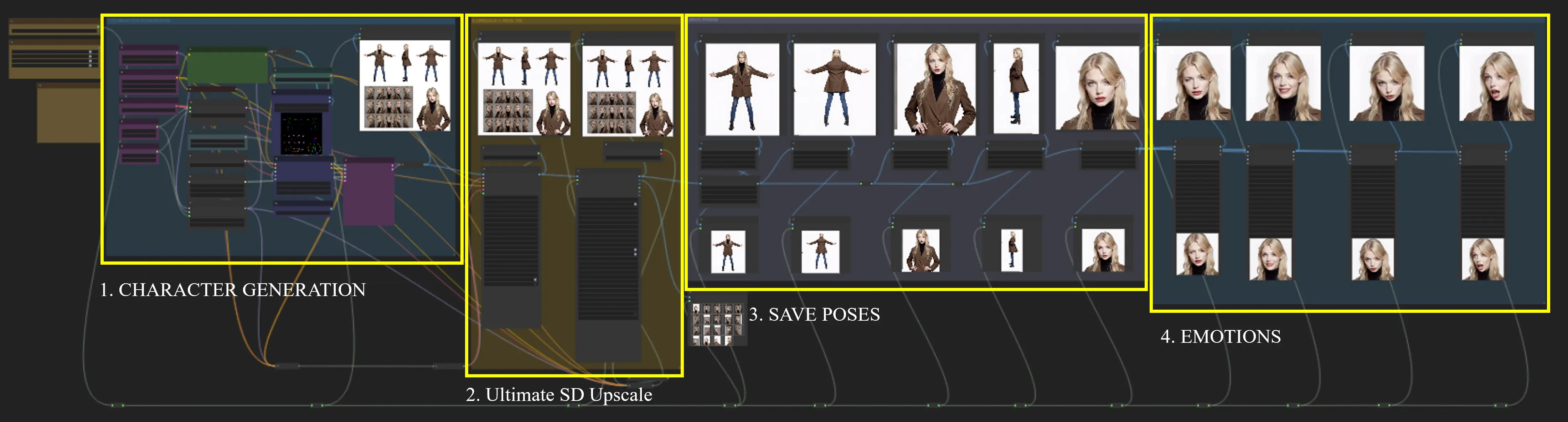

Fast Groups Muter (rgthree) Node

Nach dem Laden des Fast Groups Muter (rgthree) Knotens werden die Module 2, 3 und 4 automatisch ausgeführt, und es ist keine zusätzliche Einrichtung erforderlich. Dieser Knoten steuert die Schalter für alle vier Module und macht den Prozess der Konstante Charaktere reibungsloser und effizienter.

Fast Groups Muter (rgthree) Node Control module switch (ja/nein).

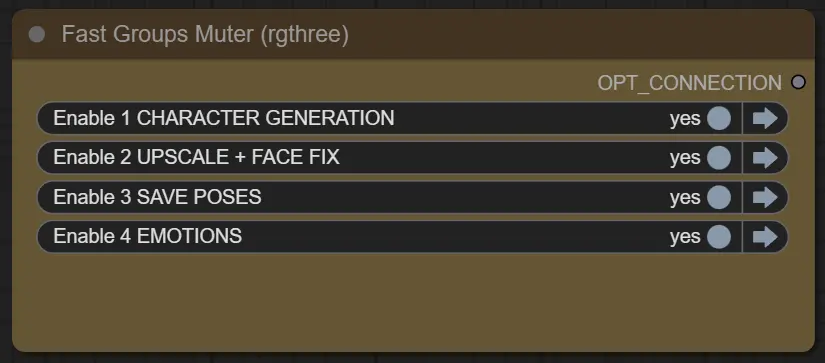

1. Charaktergenerierung

Dieses Modul nutzt die Flux-Modelle und das Flux ControlNet-Modell, um eine Tabelle mit Konstante Charaktere zu erzeugen, indem der Generierungsprozess mit Eingabeaufforderungen geleitet wird. Die Eingabe, die ein Posenblatt ist, dient als Referenz zur Steuerung der Generierung von Konstante Charaktere. Durch das Erstellen geeigneter Eingabeaufforderungen können Sie das Modell lenken, um gewünschte Konstante Charaktere Blätter zu erstellen.

Hier sind einige Beispiele für Eingabeaufforderungen:

Ein Charakterblatt mit einer amerikanischen Frau, die einen Mantel trägt, im Herbstmode gekleidet ist, mit neutralem Ausdruck. Das Blatt sollte einen weißen Hintergrund haben, mehrere Ansichten aus verschiedenen Winkeln und ein sichtbares Porträt des Gesichts. Der Gesamtstil sollte einem Meisterwerk der Fotografie ähneln.

Ein Charakterblatt, das einen Elfen-Ranger zeigt, der einen Umhang aus Herbstblättern trägt, in Waldfarben gekleidet ist, mit entschlossenem Ausdruck. Das Blatt sollte einen Pergamenthintergrund haben, mehrere Ansichten aus verschiedenen Winkeln und ein sichtbares Porträt des Gesichts. Der Ranger sollte von einem majestätischen Hirsch begleitet werden, der einen Langbogen und einen Köcher auf ihrem Rücken trägt. Der Gesamtstil sollte einem Meisterwerk der digitalen Malerei einer weiblichen Elfe mit langen goldenen Haaren ähneln.

Tipp: Sollte das generierte Konstante Charaktere Blatt nicht Ihren Erwartungen entsprechen, versuchen Sie, den Seed-Wert anzupassen, um die Ausgabe mit Variationen zu regenerieren.

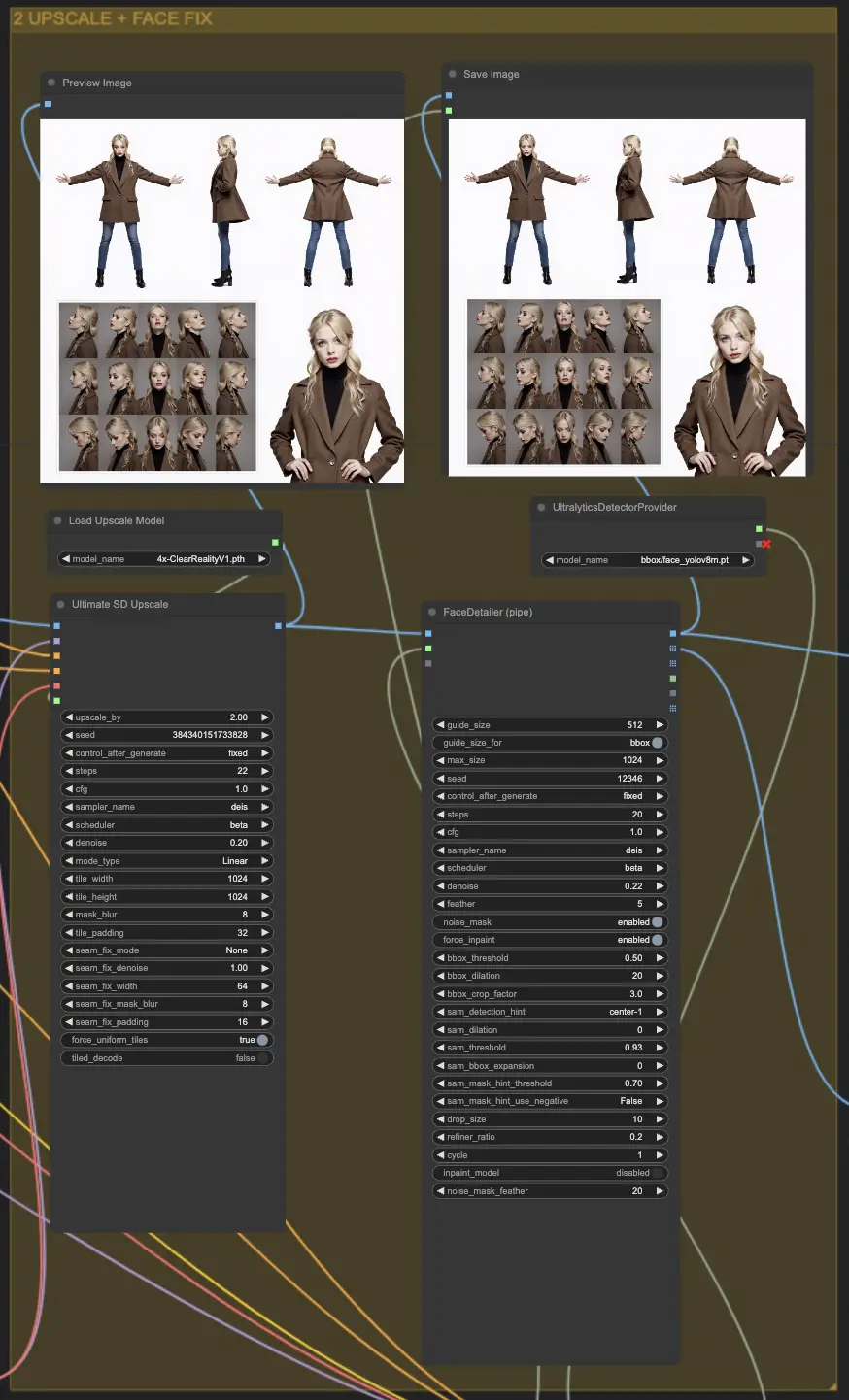

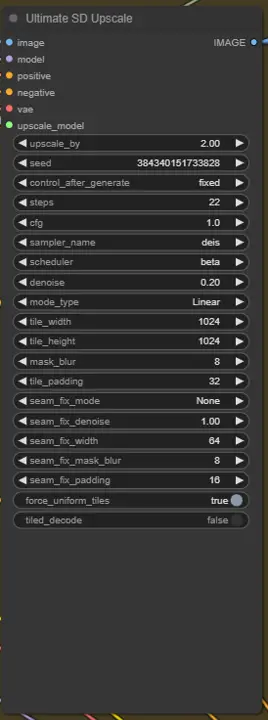

2. Upscale + Face Fix

2.1 Ultimate SD Upscale

Ultimate SD Upscale ist ein Knoten in Bildgenerierungspipelines, der die Bildauflösung durch das Teilen des Bildes in kleinere Kacheln erhöht, jede Kachel einzeln verarbeitet und sie dann wieder zusammenfügt. Dieser Prozess ermöglicht die Erzeugung hochauflösender Bilder bei gleichzeitiger Verwaltung des Speicherverbrauchs und Reduzierung von Artefakten, die beim Hochskalieren auftreten können.

Parameter:

upscale_by: Der Faktor, um den die Breite und Höhe des Bildes multipliziert werden. Für präzise Abmessungen verwenden Sie die "No Upscale" Version.seed: Steuert die Zufälligkeit im Generierungsprozess. Die Verwendung desselben Seeds führt zu denselben Ergebnissen.control_after_generate: Passt die Bilddetails nach der Generierung an.steps: Die Anzahl der Iterationen während der Bildgenerierung. Mehr Schritte führen zu feineren Details, aber längerer Verarbeitungszeit.cfg: Classifier-Free Guidance Skala, die anpasst, wie strikt das Modell den Eingabeaufforderungen folgt.sampler_name: Gibt die Sampling-Methode an, die für die Bildgenerierung verwendet wird.scheduler: Definiert, wie Rechenressourcen während der Generierung zugewiesen werden.denoise: Steuert das Maß der Rauschunterdrückung, was die Detailgenauigkeit des Originalbildes beeinflusst. Empfohlen: 0.35 für Verbesserung, 0.15-0.20 für minimale Änderungen.mode_type: Bestimmt den Modus der Verarbeitung, z. B. wie Kacheln verarbeitet werden.tile_widthundtile_height: Abmessungen der Kacheln, die bei der Verarbeitung verwendet werden. Größere Größen reduzieren Nähte, erfordern jedoch mehr Speicher.mask_blur: Weichzeichnet die Ränder der Masken, die für das Mischen der Kacheln verwendet werden, um Übergänge zu glätten.tile_padding: Anzahl der Pixel von benachbarten Kacheln, die während der Verarbeitung berücksichtigt werden, um Nähte zu reduzieren.seam_fix_mode: Methode zur Korrektur sichtbarer Nähte zwischen Kacheln:- Bands pass: Korrigiert Nähte entlang von Reihen und Spalten.

- Half tile offset pass: Wendet einen Versatz an, um Nähte besser zu überblenden.

- Half tile offset + intersections pass: Beinhaltet zusätzliche Durchläufe an Schnittpunkten.

seam_fix_denoise: Stärke der Rauschunterdrückung während der Nahtkorrektur.seam_fix_width: Breite der Bereiche, die während der Nahtkorrektur verarbeitet werden.seam_fix_mask_blur: Weichzeichnet die Maske für glattere Nahtkorrekturen.seam_fix_padding: Polsterung um Nähte während der Korrektur, um glattere Ergebnisse zu gewährleisten.force_uniform_tiles: Stellt sicher, dass Kacheln eine einheitliche Größe beibehalten, indem Randkacheln bei Bedarf erweitert werden, um Artefakte zu minimieren.tiled_decode: Verarbeitet Bildkacheln einzeln, um den Speicherverbrauch bei hochauflösender Generierung zu reduzieren.- Target size type: Bestimmt, wie die endgültige Bildgröße festgelegt wird:

- From img2img settings: Verwendet Standardbreite und -höhe.

- Custom size: Ermöglicht manuelle Breiten- und Höheneinstellung (max. 8192px).

- Scale from image size: Skaliert basierend auf der ursprünglichen Bildgröße.

- Upscaler: Die Methode zum Hochskalieren von Bildern vor der weiteren Verarbeitung (z. B. ESRGAN).

- Redraw: Steuert, wie das Bild neu gezeichnet wird:

- Linear: Verarbeitet Kacheln der Reihe nach.

- Chess: Verwendet ein Schachbrettmuster zur Verarbeitung, um Artefakte zu reduzieren.

- None: Deaktiviert das Neuzeichnen und konzentriert sich nur auf die Nahtkorrektur.

2.2. FaceDetailer (pipe)

FaceDetailerPipe ist ein Knoten, der darauf ausgelegt ist, Gesichtsdetails in Bildern zu verbessern, indem er fortschrittliche Bildverarbeitungstechniken verwendet, um die Schärfe und Klarheit von Gesichtszügen zu erhöhen. Es ist Teil des ComfyUI Impact Pack und zielt darauf ab, hochwertige Gesichtsdetaillierungen für verschiedene Anwendungen bereitzustellen.

Parameter:

image: Das Eingabebild, das verbessert werden soll und als Hauptmotiv für die Gesichtsdetaillierung dient.guide_size: Ein Parameter, der die Größe des Führungsbereichs steuert, der zur Verbesserung der Gesichtszüge verwendet wird und beeinflusst, wie viel Kontext berücksichtigt wird.guide_size_for: Bestimmt, ob die Führungsgröße für bestimmte Bereiche angewendet werden soll.max_size: Legt die maximale Größenbeschränkung für verarbeitete Bilder fest, um das Speichermanagement zu gewährleisten.seed: Steuert die Zufälligkeit im Bildverbesserungsprozess und ermöglicht reproduzierbare Ergebnisse bei Verwendung desselben Seeds.steps: Die Anzahl der Iterationen zur Verbesserung von Details. Mehr Schritte führen zu feineren Details, erfordern jedoch mehr Verarbeitungszeit.cfg: Die Classifier-Free Guidance Skala, die anpasst, wie genau das Modell der Eingabeführung folgt.sampler_name: Definiert die Sampling-Methode, die zur Detailverfeinerung verwendet wird.scheduler: Bestimmt die Berechnungsplanungsstrategie während der Verarbeitung.denoise: Steuert die Stärke der Rauschunterdrückung, die während des Verbesserungsprozesses angewendet wird. Niedrigere Werte behalten mehr Originaldetails, während höhere Werte glattere Ergebnisse erzielen.feather: Steuert die Glätte des Übergangs zwischen verbesserten und ursprünglichen Bereichen, um die Änderungen nahtlos zu mischen.noise_mask: Aktiviert oder deaktiviert die Verwendung einer Rauschmaske, um bestimmte Bereiche für die Rauschunterdrückung zu zielen.force_inpaint: Erzwingt das Inpainting in Bereichen, die zusätzliche Verbesserungen oder Korrekturen benötigen.bbox_threshold: Legt die Schwelle zum Erkennen von Begrenzungsrahmen um Gesichtszüge fest und beeinflusst die Empfindlichkeit.bbox_dilation: Erweitert die erkannten Begrenzungsrahmenbereiche, um sicherzustellen, dass alle relevanten Merkmale während der Verbesserung einbezogen werden.bbox_crop_factor: Passt den Beschnittfaktor für erkannte Begrenzungsrahmen an und steuert den Fokusbereich für Verbesserungen.sam_detection_hint: Gibt zusätzliche Hinweise oder Anleitungen für den Erkennungsprozess an.sam_dilation: Passt die Dilatation an, die auf die erkannten Bereiche angewendet wird, um eine breitere Abdeckung zu ermöglichen.sam_threshold: Definiert die Empfindlichkeitsschwelle für die Erkennung innerhalb des SAM (Segment Anything Model) Prozesses.sam_bbox_expansion: Erweitert die von SAM erkannten Begrenzungsrahmen, um mehr umgebenden Kontext einzubeziehen.sam_mask_hint_threshold: Passt die Schwelle für die von SAM bereitgestellten Maskierungshinweise an und steuert, wie Bereiche für die Maskierung definiert werden.sam_mask_hint_use_negative: Bestimmt, ob negative Hinweise verwendet werden sollen, was die Maskierung bestimmter Bereiche beeinflusst.drop_size: Legt die Größe der während des Verbesserungsprozesses angewendeten Tropfen fest, was das Verfeinerungsniveau beeinflussen kann.refiner_ratio: Steuert das Verhältnis zur Verfeinerung von Gesichtsdetails und balanciert zwischen dem Erhalt von Originalmerkmalen und dem Hinzufügen von Klarheit.cycle: Gibt die Anzahl der Verfeinerungszyklen an, die angewendet werden sollen und beeinflusst die Tiefe der Verbesserung.- inpaint_model (Optional): Ermöglicht die Verwendung eines Inpainting-Modells zum Ausfüllen fehlender oder unklarer Bereiche während des Detaillierungsprozesses.

noise_mask_feather: Passt das Federgewicht der Rauschmaske an und sorgt für einen sanfteren Übergang zwischen rauschigen und rauschfreien Bereichen.

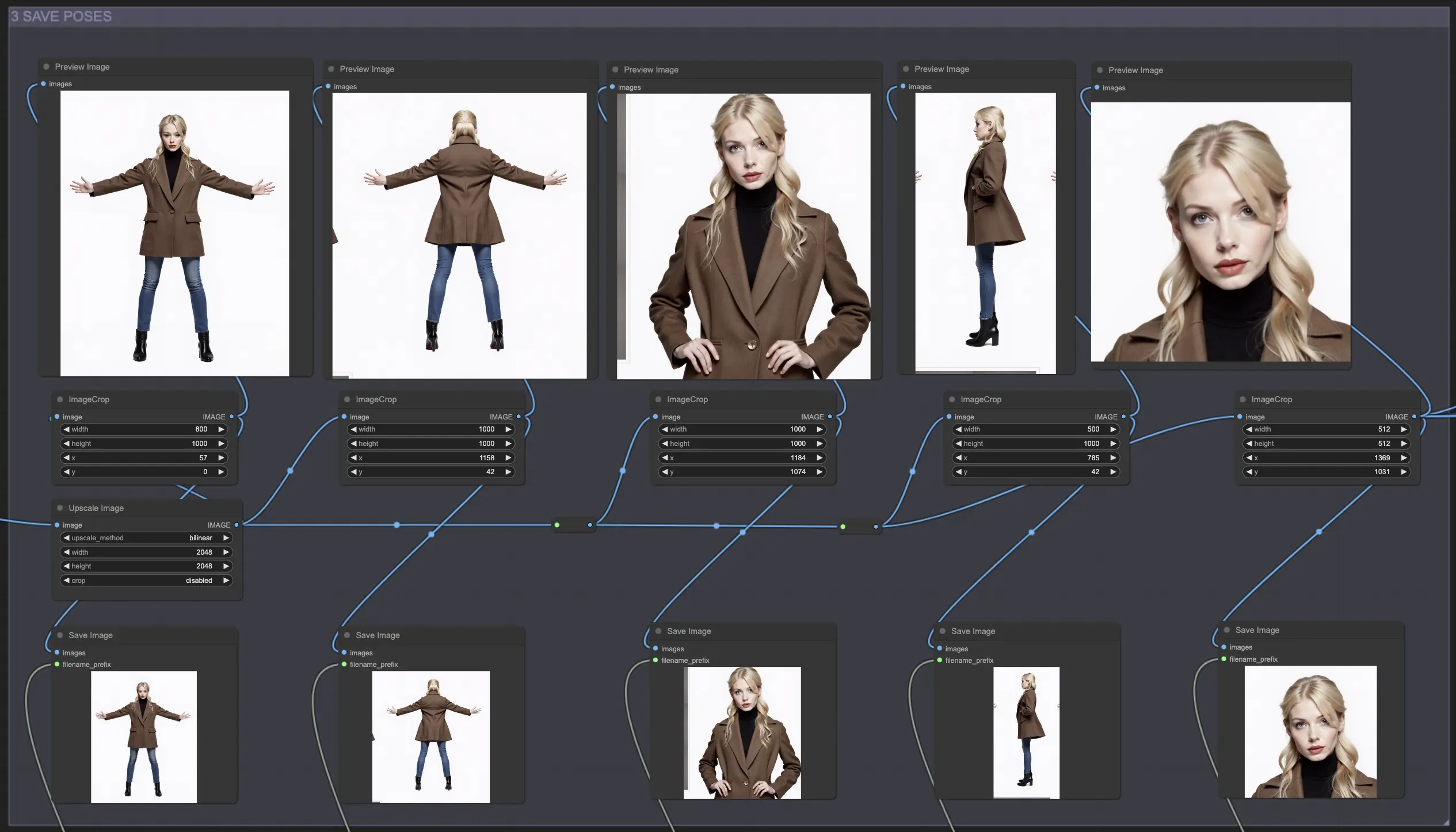

3. Posen

Dieses Modul ermöglicht es Ihnen, den Bildzuschnittsknoten zu verwenden, um jede Pose aus dem generierten Charakterblatt zu trennen und einzelne Posen des Charakters für weitere Verwendung oder Anpassungen zu speichern.

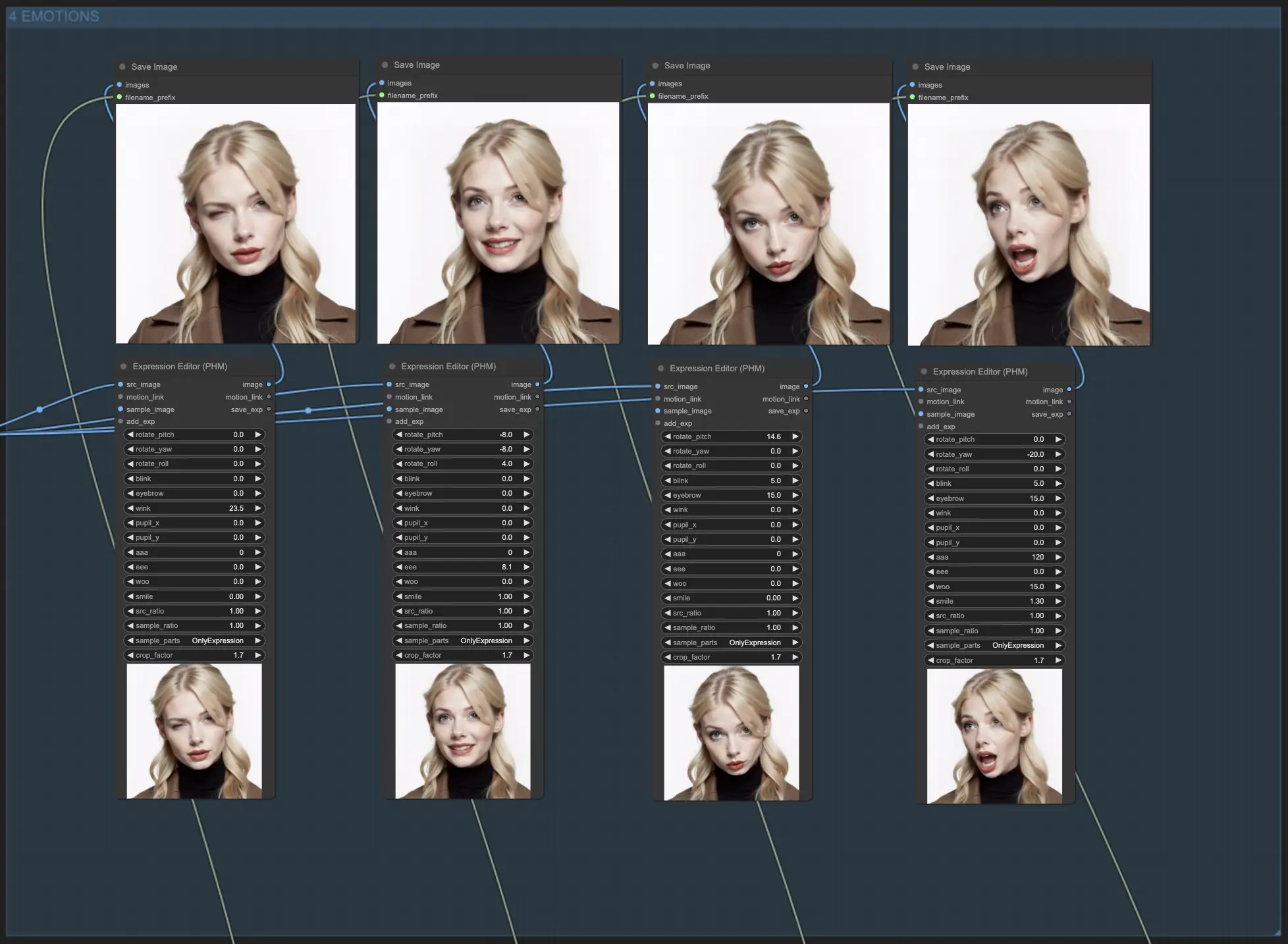

4. Emotionen

Dieses Modul verwendet den Photo Expression Editor (PHM) Knoten, um Gesichtsausdrücke in Fotos anzupassen. Die Parameter ermöglichen die Feinabstimmung verschiedener Gesichtsaspekte, wie Kopfbewegungen, Blinzeln und Lächeln

Expression Editor Parameter:

rotate_pitch: Steuert die Auf- und Abbewegung des Kopfes.rotate_yaw: Passt die seitliche Bewegung des Kopfes an.rotate_roll: Bestimmt den Neigungswinkel des Kopfes.blink: Steuert die Intensität des Augenblinzelns.eyebrow: Passt die Augenbrauenbewegungen an.wink: Steuert das Zwinkern.pupil_x: Bewegt die Pupillen horizontal.pupil_y: Bewegt die Pupillen vertikal.aaa: Steuert die Mundform für den "aaa" Vokallaut.eee: Steuert die Mundform für den "eee" Vokallaut.woo: Steuert die Mundform für den "woo" Vokallaut.smile: Passt den Grad eines Lächelns an.src_ratio: Bestimmt das Verhältnis des anzuwendenden Ausgangsausdrucks.sample_ratio: Bestimmt das Verhältnis des anzuwendenden Beispielausdrucks.sample_parts: Gibt an, welche Teile des Beispielausdrucks angewendet werden sollen ("OnlyExpression", "OnlyRotation", "OnlyMouth", "OnlyEyes", "All").crop_factor: Steuert den Beschnittfaktor des Gesichtsbereichs.

Flux-Modelle und die optimierten Module des Workflows machen es Ihnen leicht, einheitliche Erscheinungen von Konstante Charaktere über verschiedene Ausgaben hinweg aufrechtzuerhalten. Sie werden in der Lage sein, Ihre Charaktere wie nie zuvor zum Leben zu erwecken und ein wirklich immersives Erlebnis für Ihr Publikum zu schaffen!