IC-Light | 画像再照明

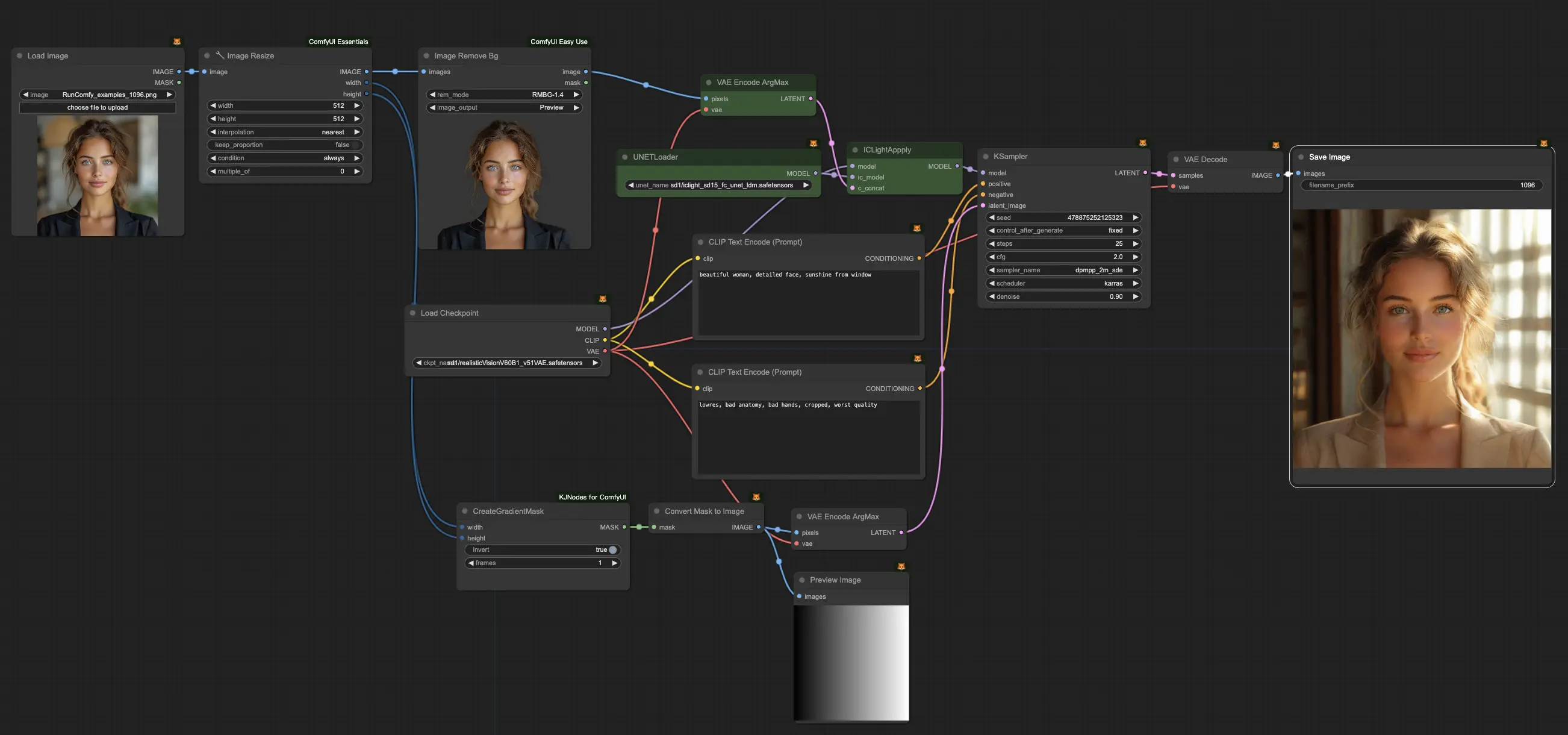

このComfyUI IC-Lightワークフローでは、画像を簡単に再照明できます。まず、元の画像の背景を削除して編集します。次に、プロンプトに基づいて、ツールは照明を強化し、新しい背景を持つ新しい画像を再生成し、一貫性のある正確な結果を保証します。ComfyUI IC-Light ワークフロー

ComfyUI IC-Light 例

ComfyUI IC-Light 説明

1. IC-Lightとは何ですか?

IC-Lightは、生成された画像のローカルな編集を実行するために、Stable Diffusionモデルと統合されたAIベースの画像編集ツールです。これは、画像を潜在空間表現にエンコードし、特定の領域に編集を適用し、その後、修正された潜在表現を画像にデコードすることで機能します。このアプローチにより、元の画像の全体的なスタイルと一貫性を維持しながら、編集プロセスを正確に制御できます。

現在、テキスト条件付き再照明モデルと背景条件付きモデルの2つのモデルがリリースされています。両方のタイプは、前景画像を入力として受け取ります。

2. IC-Lightの仕組み

内部的には、IC-Lightは画像のエンコードとデコードにStable Diffusionモデルの力を活用しています。このプロセスは、次の手順に分けることができます。

2.1. エンコード: 入力画像は、Stable Diffusion VAE(Variational Autoencoder)を通過して、圧縮された潜在空間表現を取得します。 2.2. 編集: 目的の編集が潜在表現の特定の領域に適用されます。これは通常、元の潜在と、修正する領域を示すマスク、および対応する編集プロンプトを連結することによって行われます。 2.3. デコード: 修正された潜在表現は、Stable Diffusionデコーダを通過して、編集された画像を再構成します。 IC-Lightは潜在空間で動作することにより、画像の全体的な一貫性とスタイルを維持しながら、局所的な編集を行うことができます。

3. ComfyUI IC-Lightの使い方

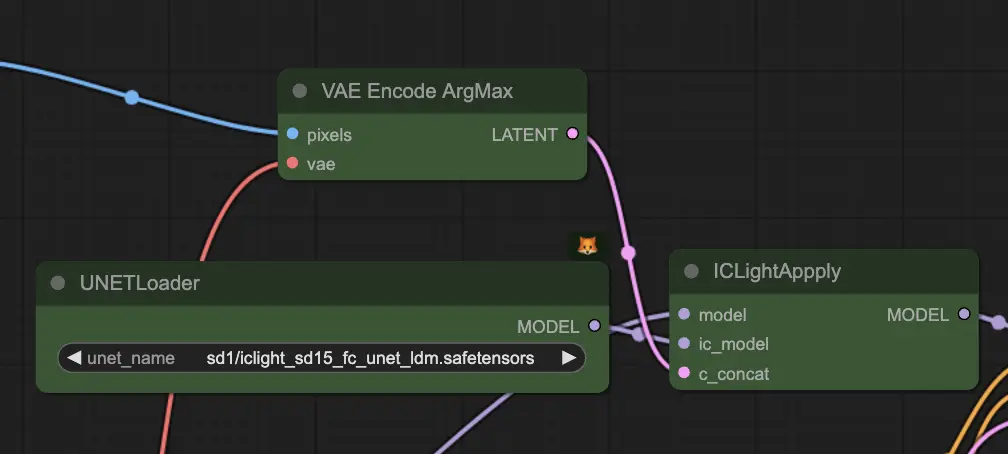

あなたが主に使用するノードは "IC-Light Apply" ノードで、画像のエンコード、編集、デコードのプロセス全体を処理します。

3.1. "IC-Light Apply" の入力パラメータ:

"IC-Light Apply" ノードには、3つの主要な入力が必要です。

- model: これは、画像のエンコードとデコードに使用される基本的なStable Diffusionモデルです。

- ic_model: これは、編集プロセスに必要な重みを含む、事前学習済みのIC-Lightモデルです。

- c_concat: これは、元の画像、編集する領域を示すマスク、およびそれらの領域をどのように修正するかを定義する編集プロンプトを組み合わせた特別な入力です。

c_concat入力を作成するには:

- VAEEncodeArgMaxノードを使用して、元の画像をエンコードします。このノードは、画像の最も可能性の高い潜在表現が得られることを保証します。

- ICLightApplyMaskGreyノードを使用して、画像のマスク版を作成します。このノードは、元の画像とマスクを入力として受け取り、マスクされていない領域がグレー表示された画像のバージョンを出力します。

- 編集プロンプトの潜在表現を作成します。これらのプロンプトは、画像の選択された領域に加えられる変更を導きます。

- 元の画像、マスク、および編集プロンプトの潜在表現を組み合わせて、"IC-Light Apply" ノードの単一の入力にします。

3.2. "IC-Light Apply" の出力パラメータ:

入力を処理した後、"IC-Light Apply" ノードは単一のパラメータを出力します。

- model: これは、IC-Light修正が適用されたパッチ適用済みのStable Diffusionモデルです。

最終的な編集画像を生成するには、出力モデルをComfyUIワークフローの適切なノード(KSamplerやVAEDecodeノードなど)に接続するだけです。

3.3. 最良の結果を得るためのヒント:

- 高品質のマスクを使用する: 編集が正確で効果的であることを確実にするために、マスクが修正したい領域を正確に概説していることを確認してください。

- さまざまな編集プロンプトを試す: 編集プロンプトは、画像の選択された領域に加えられる変更を導きます。目的の効果を達成するために、さまざまなプロンプトを試してみてください。結果に基づいてプロンプトを改良することを躊躇しないでください。

- グローバルな編集とローカルな編集のバランスを取る: IC-Lightは局所的な編集に優れていますが、画像の全体的な構成と一貫性を考慮することが重要です。生成されたアートワークの完全性を維持するために、集中した編集とグローバルな調整のバランスを見つけるようにしてください。

詳細については、をご覧ください。