오디오 리액티브 댄서 진화

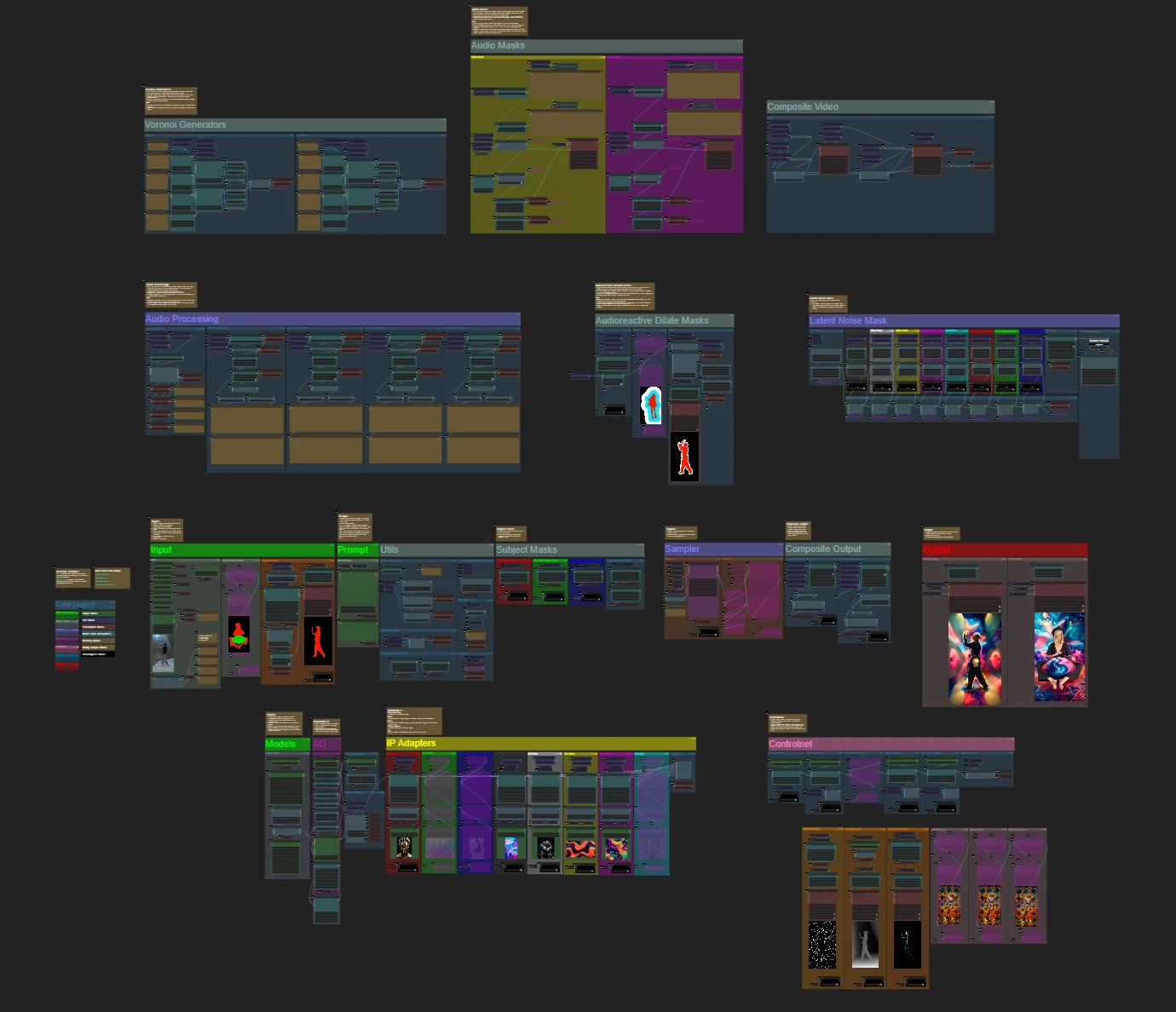

오디오 리액티브 댄서 진화 워크플로우는 비디오 대상을 음악 비트에 동기화된 매혹적인 애니메이션으로 변환하고, 역동적이고 기하학적이며 환각적인 배경을 제공합니다. 유연성을 염두에 두고 설계되어 사용자가 비디오 프레임, 마스킹, 오디오 반응성 및 패턴 세부 사항을 제어할 수 있습니다. 확장 마스크, ControlNet 및 비트 동기화 노이즈 애니메이션과 같은 기능을 통해 이 ComfyUI 워크플로우는 창작자들이 예술, 소리 및 움직임을 결합하여 오디오 리액티브 비주얼로 시각적으로 몰입감 있는 리드믹 경험을 창조할 수 있도록 합니다.ComfyUI Audioreactive Dancers Evolved 워크플로우

ComfyUI Audioreactive Dancers Evolved 예제

ComfyUI Audioreactive Dancers Evolved 설명

대상을 변형하여 멋진 비디오 애니메이션을 만들고, 다양한 복잡한 기하학적 도형과 환각적인 패턴으로 구성된 역동적인 오디오 리액티브 배경을 제공합니다. 이 워크플로우는 단일 또는 여러 대상을 사용할 수 있습니다. 이 워크플로우를 통해 음악의 리듬에 완벽하게 동기화된 매혹적인 오디오 리액티브 비주얼 효과를 제작하여 몰입형 경험을 제공합니다. 이 워크플로우는 단일 대상 또는 여러 대상을 오디오 리액티브 요소로 강화하여 사용할 수 있습니다.

오디오 리액티브 댄서 진화 워크플로우 사용 방법:

- 입력 섹션에 대상 비디오를 업로드합니다.

- 최종 비디오의 원하는 너비와 높이를 선택하고 "every_nth"로 건너뛸 입력 비디오의 프레임 수를 선택합니다. "frame_load_cap"으로 렌더링할 총 프레임 수를 제한할 수도 있습니다.

- 긍정적이고 부정적인 프롬프트를 작성합니다. 장면 전환이 발생할 때 일치하도록 배치 프레임 시간을 설정합니다.

- 기본 IP 어댑터 대상 마스크 색상에 대한 이미지를 업로드합니다:

- 빨강, 초록, 파랑 = 대상

- 검정 = 배경

- 흰색 = 흰색 오디오 리액티브 확장 마스크

- 노랑, 마젠타 = 배경 노이즈 마스크 패턴

- "모델" 섹션에서 좋은 LCM 체크포인트를 로드합니다 (예: Machine Delusions의 ParadigmLCM 사용).

- 모델 로더 아래의 Lora 스태커를 사용하여 원하는 로라를 추가합니다.

- 큐 프롬프트를 클릭합니다.

비디오 가이드

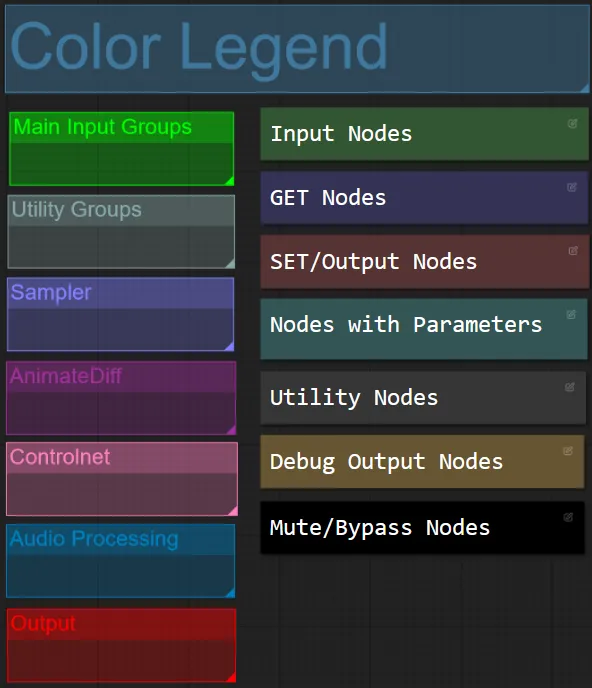

노드 및 그룹 색상

- 이 워크플로우에서는 각 그룹 내 기능에 따라 노드를 색상으로 구분했습니다.

- 그룹 섹션 제목은 보다 쉽게 구분할 수 있도록 색상으로 구분되어 있습니다.

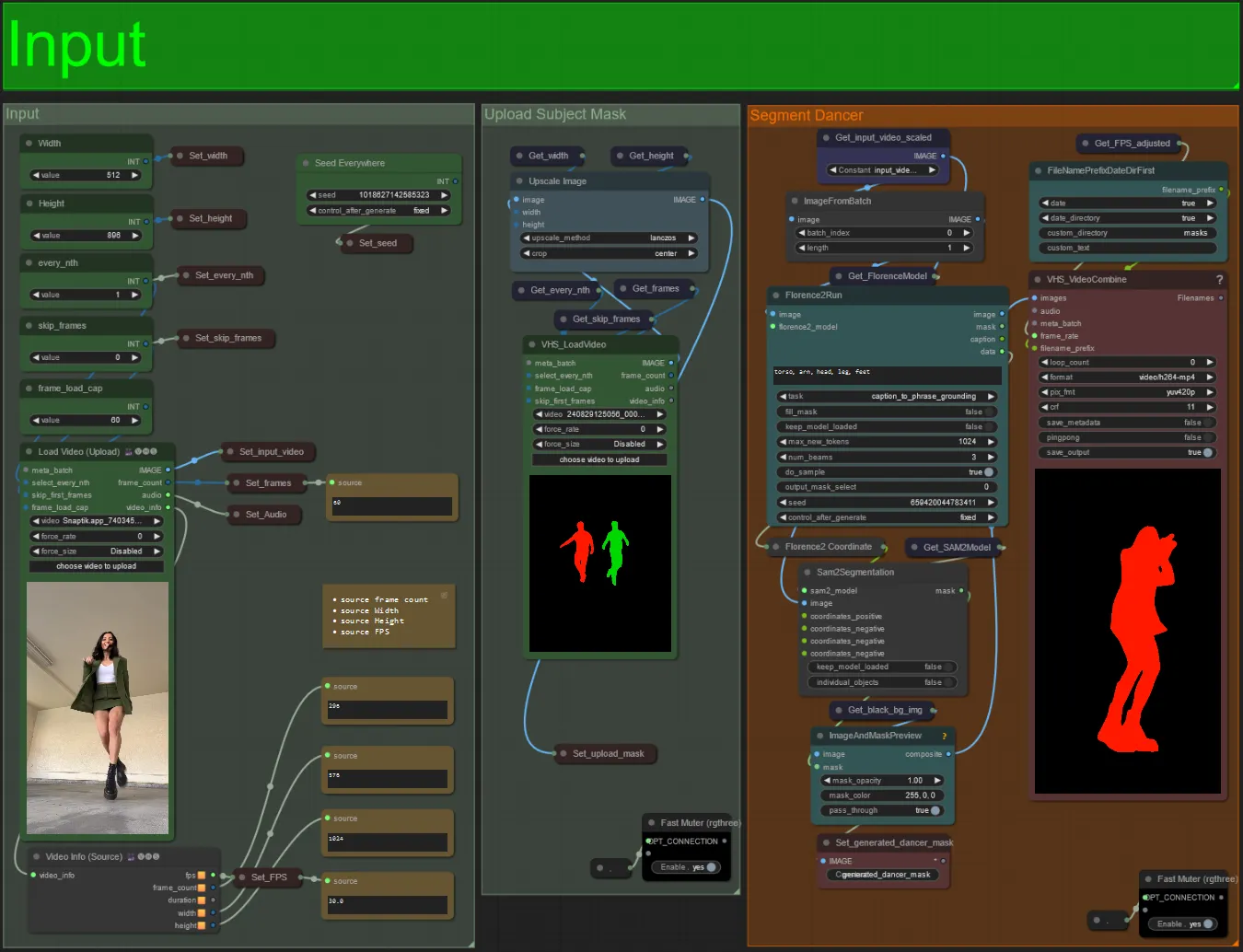

입력

- 원하는 대상 비디오를 Load Video (Upload) 노드에 업로드합니다.

- 왼쪽 상단의 두 입력을 사용하여 출력 너비와 높이를 조정할 수 있습니다.

- every_nth는 매 프레임마다, 매 세 번째 프레임마다 등 (2 = 매 프레임마다) 사용할지를 설정합니다. 기본값은 1로 설정되어 있습니다.

- skip_frames는 비디오 시작 부분에서 프레임을 건너뛰는 데 사용됩니다. (100 = 입력 비디오의 처음 100프레임 건너뛰기). 기본값은 0으로 설정되어 있습니다.

- frame_load_cap는 입력 비디오의 총 프레임 수를 로드할지를 지정하는 데 사용됩니다. 설정을 테스트할 때는 낮게 유지하는 것이 좋으며 (예: 30 - 60) 최종 비디오를 렌더링할 때는 증가시키거나 0(프레임 캡 없음)으로 설정합니다.

- 오른쪽 하단의 숫자 필드는 업로드된 입력 비디오에 대한 정보를 표시합니다: 총 프레임 수, 너비, 높이, FPS (위에서 아래로).

- 이미 생성된 대상 마스크 비디오가 있는 경우 "Upload Subject Mask" 섹션의 음소거를 해제하고 마스크 비디오를 업로드할 수 있습니다. 시간을 절약하기 위해 "Segment Dancer" 섹션을 음소거할 수도 있습니다.

- 때때로 분할된 대상이 완벽하지 않을 수 있습니다. 위에서 볼 수 있는 오른쪽 하단의 미리보기 상자를 사용하여 마스크 품질을 확인할 수 있습니다. 그런 경우 "Florence2Run" 노드에서 "머리", "가슴", "다리" 등과 같은 다른 신체 부위를 대상으로 하는 프롬프트를 조정하여 더 나은 결과를 얻을 수 있습니다.

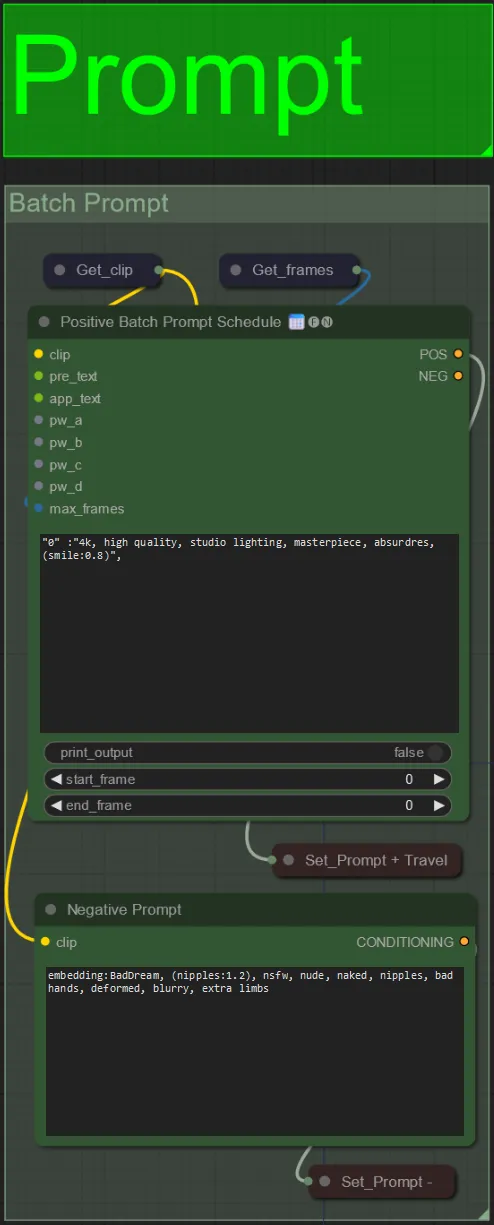

프롬프트

- 배치 형식을 사용하여 긍정적 프롬프트를 설정합니다:

- 예: "0": "4k, 걸작, 해변에 서 있는 1명 소녀, absurdres", "25": "HDR, 일몰 장면, 검은 머리와 흰 재킷을 입은 1명 소녀, absurdres", ...

- 부정적 프롬프트는 일반 형식이며, 원하는 경우 임베딩을 추가할 수 있습니다.

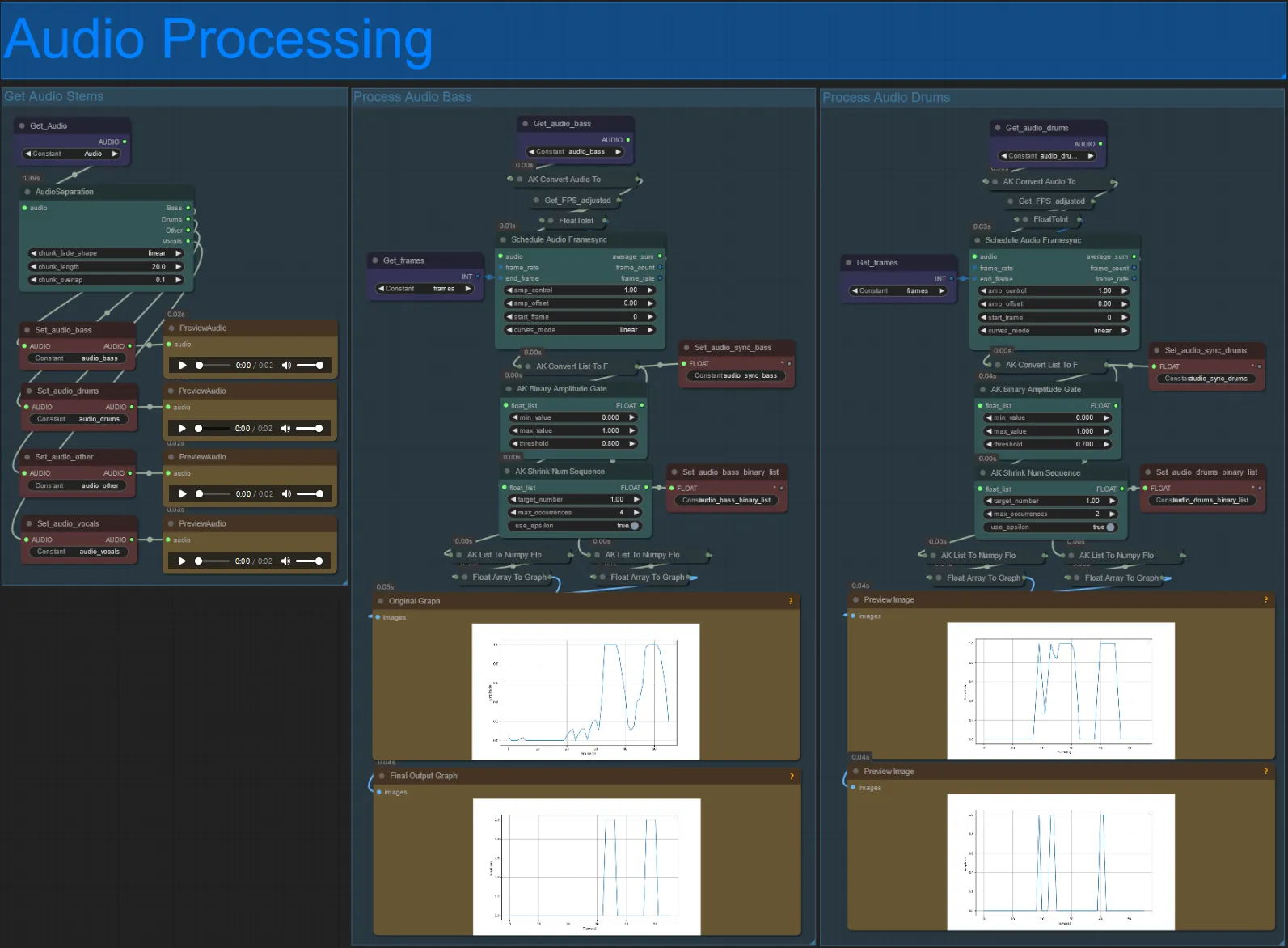

오디오 처리

- 이 섹션은 입력 비디오에서 오디오를 받아 스템(베이스, 드럼, 보컬 등)을 추출하고 입력 비디오 프레임과 동기화된 정규화된 진폭으로 변환하여 오디오 리액티브 비주얼을 생성합니다.

- amp_control = 진폭이 이동할 수 있는 전체 범위.

- amp_offset = 진폭이 가질 수 있는 최소값.

- 예: amp_control = 0.8 및 amp_offset = 0.2는 신호가 0.2에서 1.0 사이를 이동함을 의미합니다.

- 때때로 드럼 스템에 실제 노래의 베이스 노트가 포함될 수 있으므로 각 스템을 미리 보고 오디오 리액티브 마스크에 사용할 스템을 결정하세요.

- 그래프를 사용하여 비디오 길이 동안 해당 스템의 신호가 어떻게 변하는지 잘 이해할 수 있습니다.

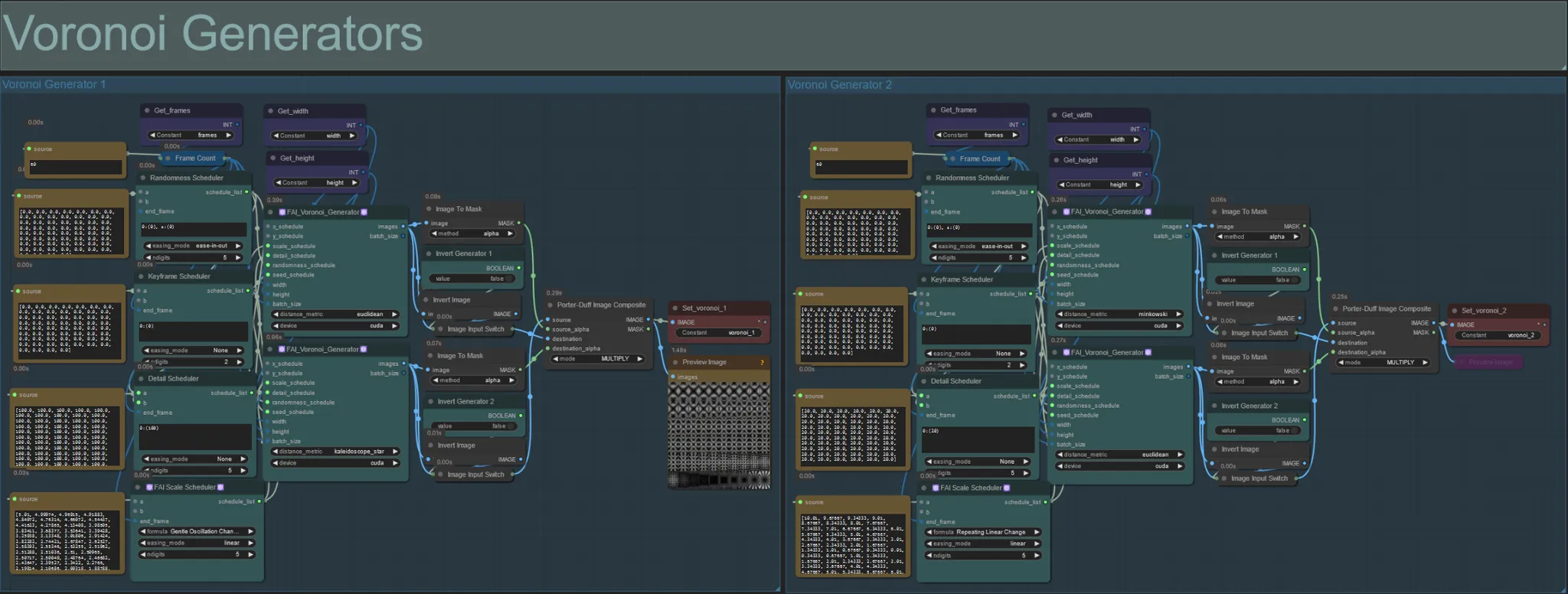

보로노이 생성기

- 이 섹션은 두 개의 FAI_Voronoi_Generator 사용자 정의 노드를 사용하여 그룹당 보로노이 노이즈 패턴을 생성하고 곱셈을 사용하여 합성합니다.

- 최종 출력에서 대칭 패턴을 깨뜨리려면 상위 항목에서 Randomness Scheduler 값을 0 이상으로 늘릴 수 있습니다.

- 출력 노이즈 패턴의 세부 사항 수를 늘리려면 상위 항목에서 Detail Scheduler 값을 늘립니다. 낮은 값은 낮은 노이즈 차별화를 초래합니다.

- 최종 노이즈 패턴 움직임에 큰 영향을 미치려면 FAI Scale Scheduler 노드의 "formula" 매개변수를 변경할 수 있습니다.

- FAI_Voronoi_Generator 노드 자체에서 "distance_metric" 기능을 변경하여 생성된 패턴과 결과 노이즈의 모양에 크게 영향을 줄 수 있습니다.

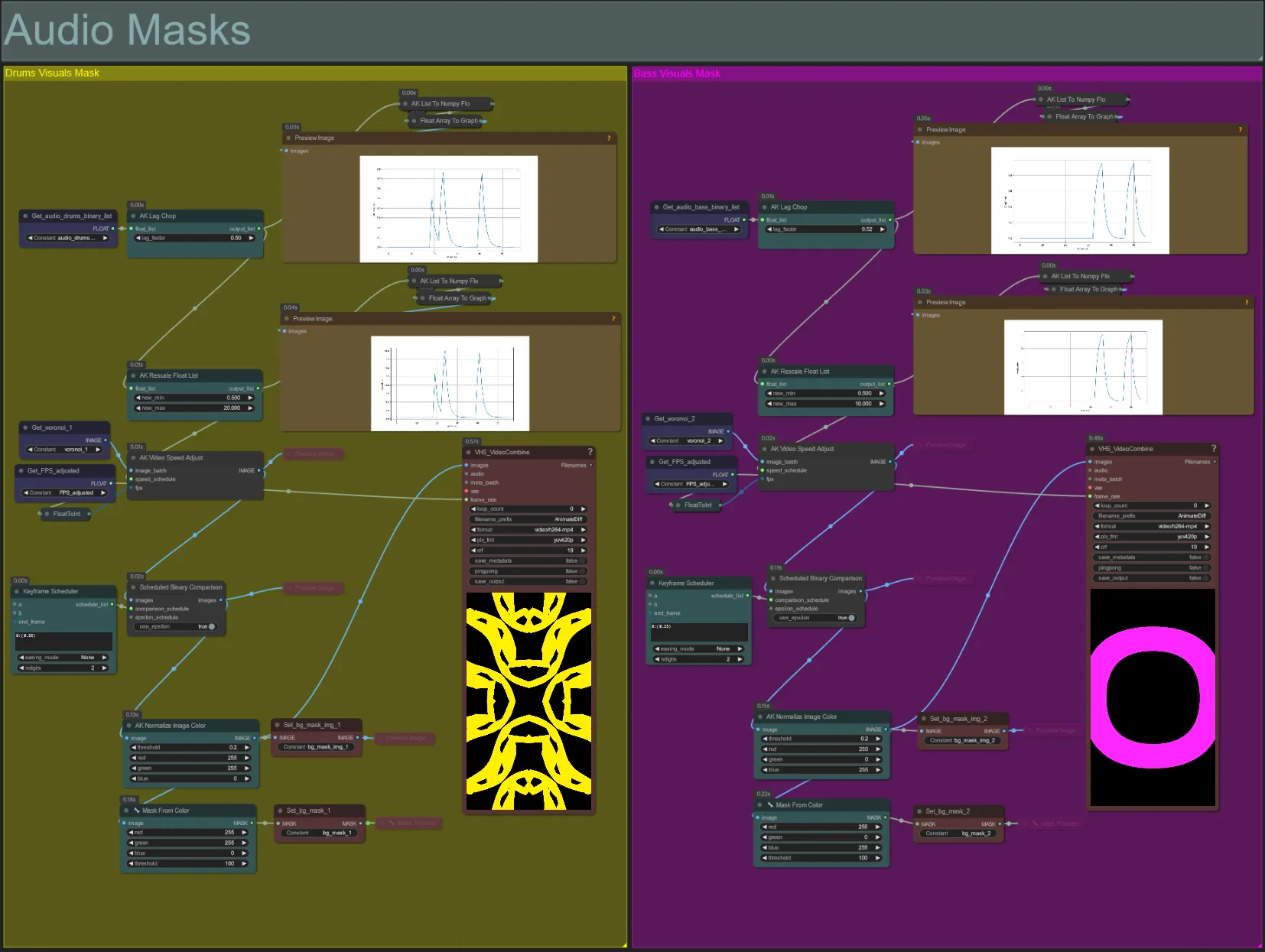

오디오 마스크

- 이 섹션은 보로노이 노이즈 이미지 배치를 색상 마스크로 변환하여 대상과 합성하고, 그 움직임을 베이스 또는 드럼 오디오 스템의 비트와 동기화하는 데 사용됩니다. 이러한 마스크는 오디오 리액티브 효과를 생성하는 데 필수적입니다.

- AK Lag Chop 노드에서 "lag_factor"를 늘려 최종 진폭 그래프가 얼마나 "뾰족"해질지를 늘립니다. 이는 출력 노이즈 움직임이 더 갑작스럽게 가속하고 감속하며, 낮은 lag_factor는 각 비트 이후의 움직임이 더 점진적으로 감속되도록 합니다. 노이즈 마스크 애니메이션이 너무 "튀거나" 경직된 것으로 보이지 않도록 하려면 이 방법을 사용합니다.

- AK Rescale Float List는 정규화된 진폭 값을 0-1에서 new_min 및 new_max로 재매핑하는 데 사용됩니다. 값 1.0은 노이즈 애니메이션의 30FPS 재생 속도를 나타내며, 0.5는 15FPS, 2.0은 60FPS 등을 나타냅니다. 비트(진폭 1.0)에 따라 얼마나 빠르게 움직이는지를 조정하고, 비트에서 벗어날 때(진폭 0.0) 오디오 리액티브 노이즈 패턴이 얼마나 느리게 애니메이션되는지를 변경하려면 이 값을 조정합니다.

- Keyframe Scheduler는 마스크의 외관에 큰 영향을 미칩니다. 잡음 입력 이미지에 사용할 픽셀 밝기 값의 임계값을 지정하는 부동 소수점 값 목록을 생성하여 일부 잡음이 잘리고 최종 마스크로 변환됩니다. 입력 잡음의 더 많은 부분을 유지하려면 이 값을 낮추고, 잡음을 덜 유지하려면 이 값을 높입니다.

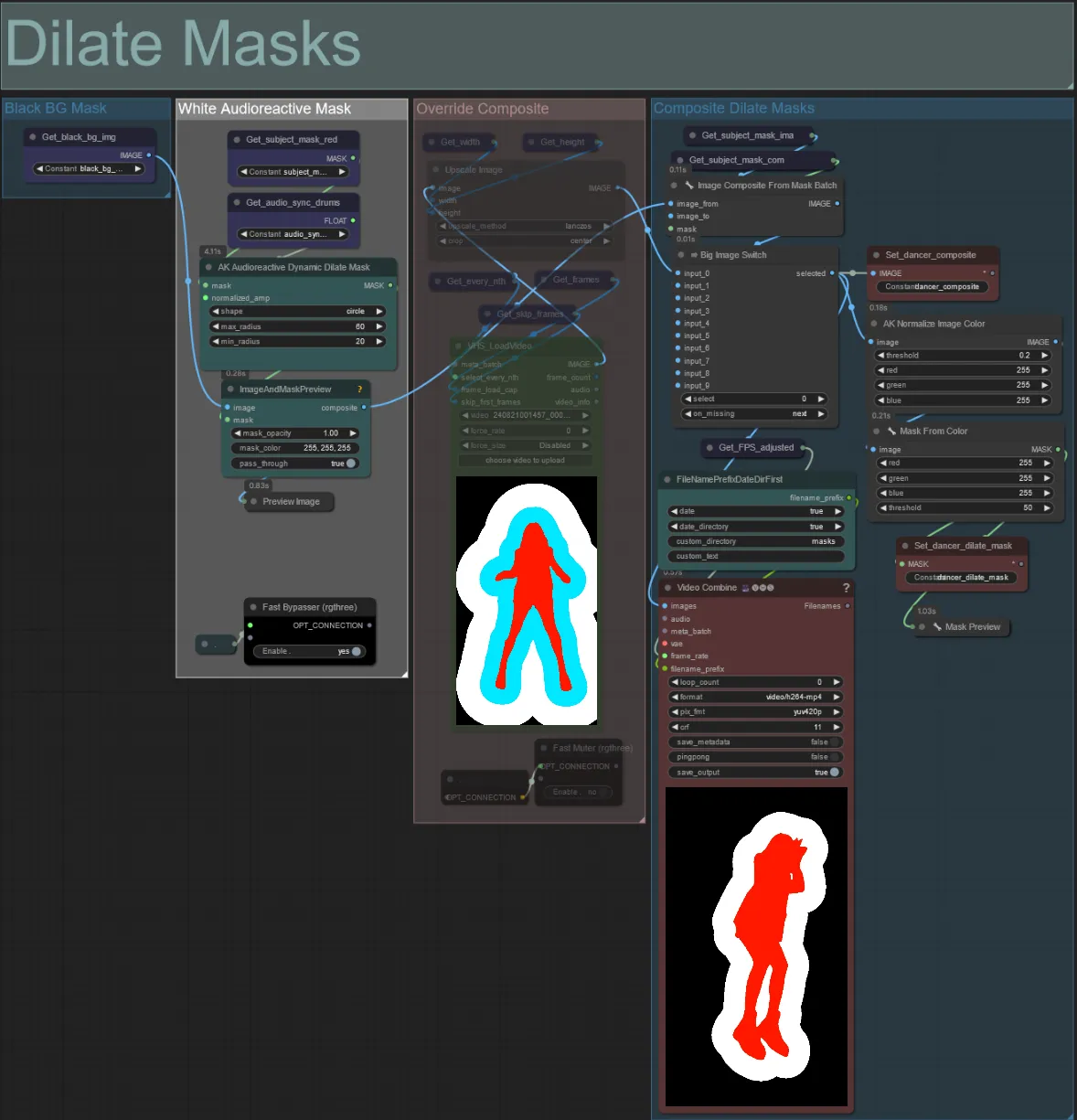

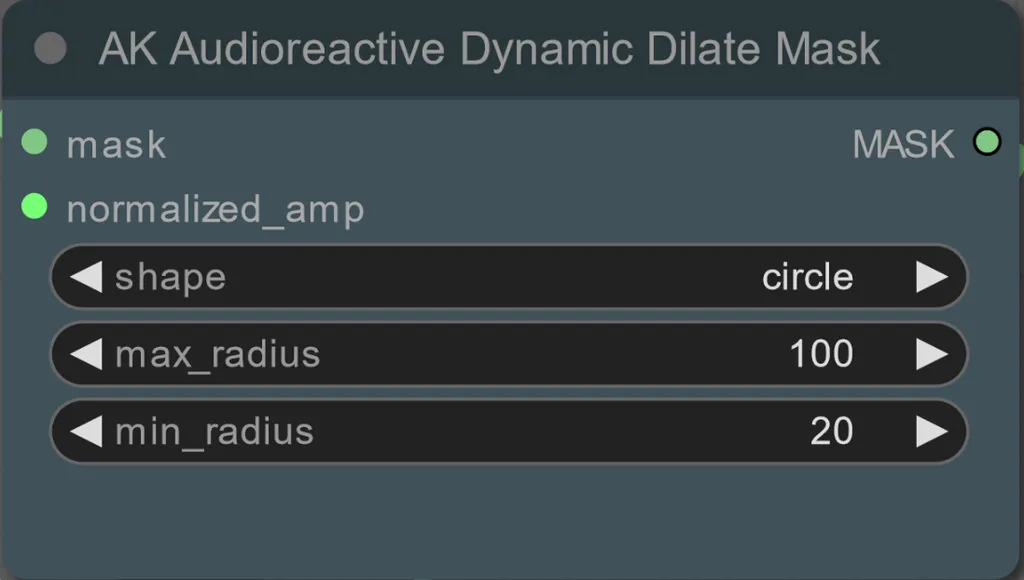

확장 마스크

- 각 색상 그룹은 생성할 확장 마스크의 색상에 해당합니다.

- 다음 노드를 사용하여 확장 마스크의 최소 및 최대 반경과 모양을 설정할 수 있습니다:

- shape: "circle"은 가장 정확하지만 생성하는 데 시간이 더 오래 걸립니다. 최종 렌더링을 수행할 준비가 되었을 때 이를 설정합니다. "square"는 계산이 빠르지만 정확도가 떨어지며, 워크플로우를 테스트하고 IP 어댑터 이미지를 결정할 때 가장 적합합니다.

- max_radius: 진폭 값이 최대(1.0)일 때 마스크의 픽셀 반경입니다.

- min_radius: 진폭 값이 최소(0.0)일 때 마스크의 픽셀 반경입니다.

- 이미 합성 마스크 비디오가 생성된 경우 "Override Composite Mask" 그룹의 음소거를 해제하고 업로드할 수 있습니다. 처리 시간을 절약하기 위해 우회할 경우 확장 마스크 그룹을 우회하는 것이 좋습니다.

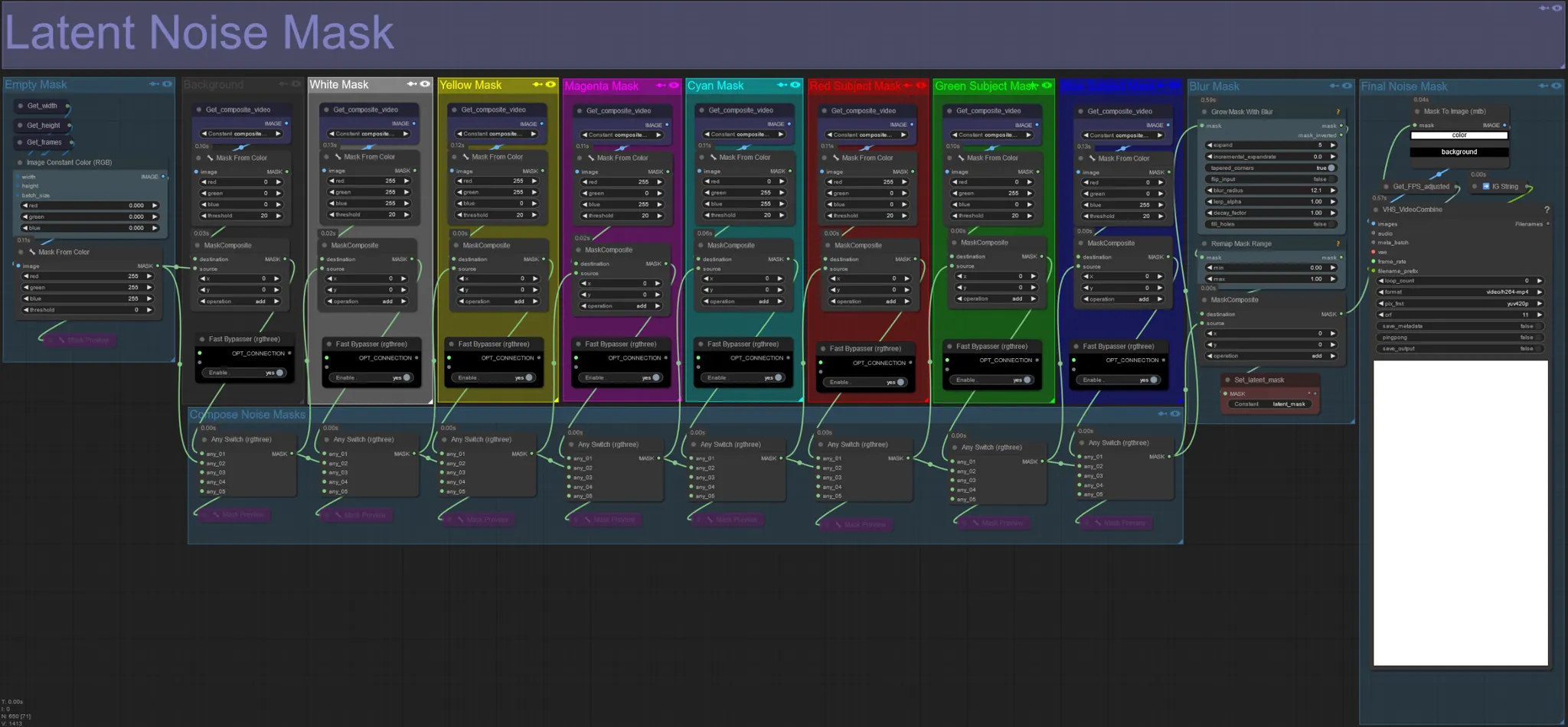

잠재 노이즈 마스크

- 잠재 노이즈 마스크를 사용하여 ksampler에 의해 실제로 확산(꿈꾸어진)될 마스크를 제어합니다. 확산되지 않기를 원하는 색상 마스크에 해당하는 그룹을 우회합니다(즉, 원본 비디오의 요소가 나타나기를 원합니다).

- 모든 마스크 그룹을 활성화 상태로 두면 최종 노이즈 마스크가 흰색이 됩니다(모든 것이 확산됩니다).

- 예시: 최종 출력에 댄서나 대상이 나타나도록 하려면 Fast Bypasser 노드를 클릭하여 빨간색 대상 마스크 그룹을 우회합니다.

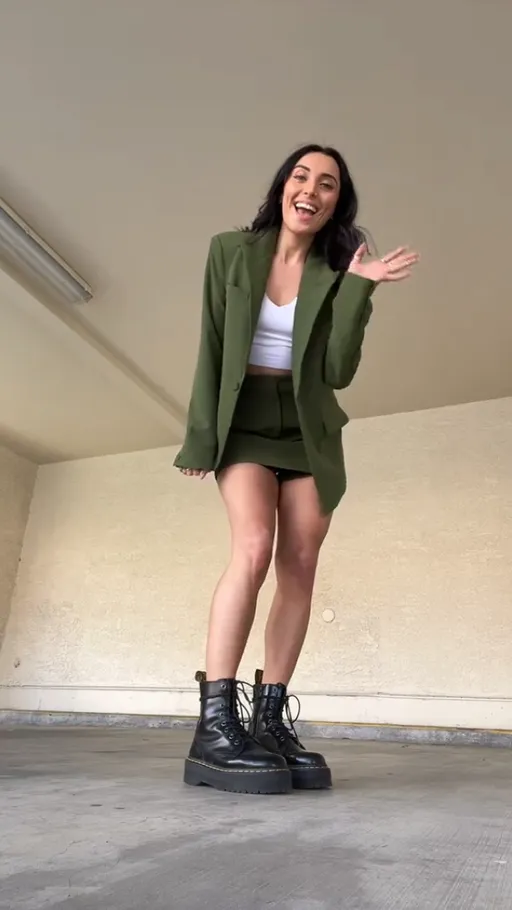

원본 입력 비디오:

빨간색 및 노란색 마스크 그룹 우회:

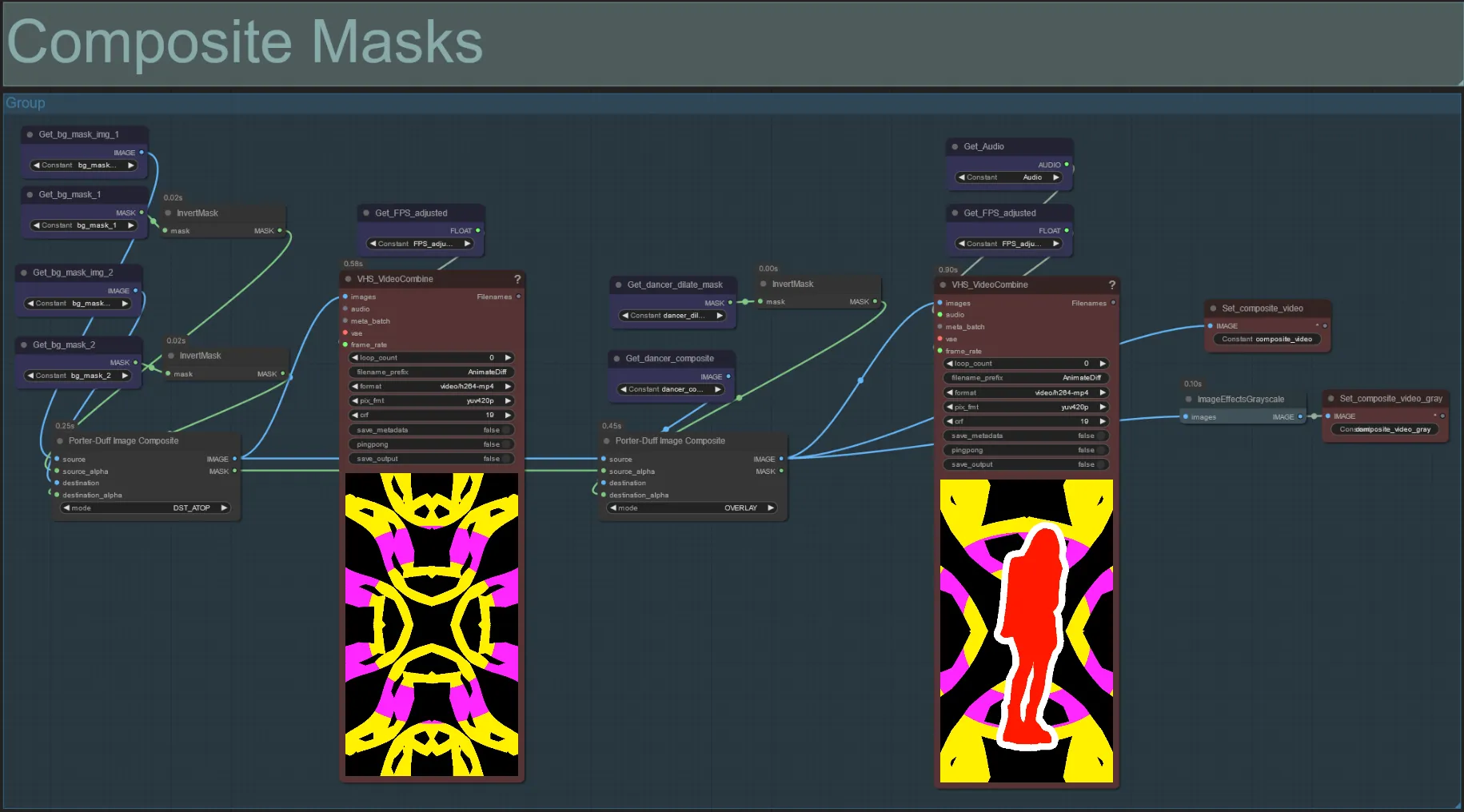

합성 마스크

- 이 섹션은 대상 마스크(및 오디오 리액티브 확장 마스크가 활성화된 경우)와 보로노이 노이즈 마스크의 최종 합성을 만듭니다.

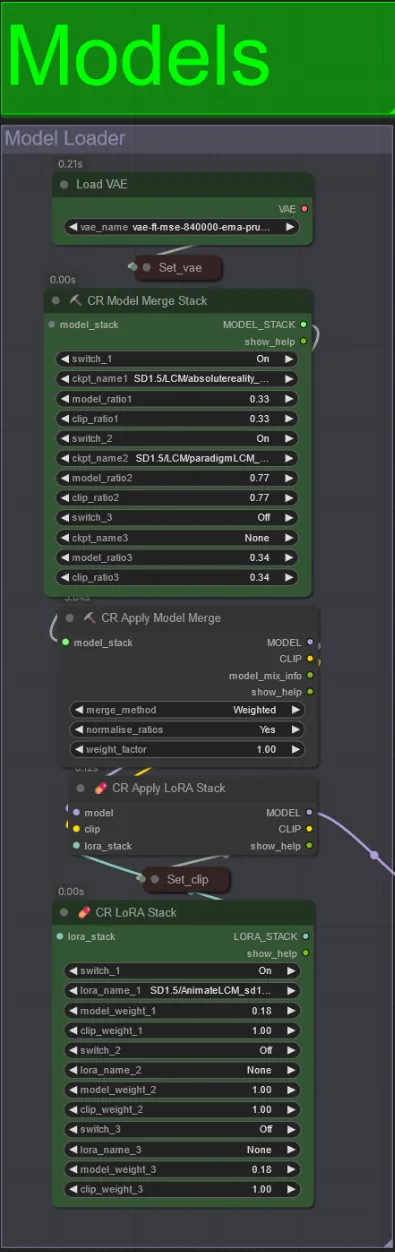

모델

- 체크포인트에 좋은 LCM 모델을 사용하세요. Machine Delusions의 ParadigmLCM을 추천합니다.

- Model Merge Stack을 사용하여 여러 모델을 함께 병합하여 다양한 흥미로운 효과를 얻을 수 있습니다. 활성화된 모델의 가중치가 1.0이 되도록 하세요.

- 최종 결과를 더욱 향상시키기 위해 낮은 가중치 0.18로 AnimateLCM_sd15_t2v_lora.safetensors를 지정할 수 있습니다.

- 모델 로더 아래의 Lora 스태커를 사용하여 추가 Loras를 모델에 추가합니다.

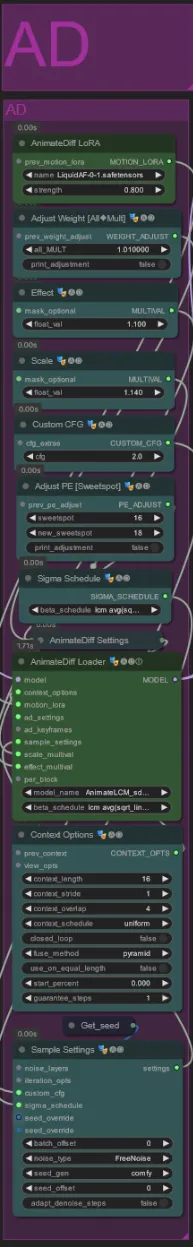

AnimateDiff

- 사용한 Motion Lora 대신 다른 것을 설정할 수 있습니다 (LiquidAF-0-1.safetensors)

- 출력의 모션 양을 늘리거나 줄이려면 Scale 및 Effect float 값을 늘리거나 줄입니다.

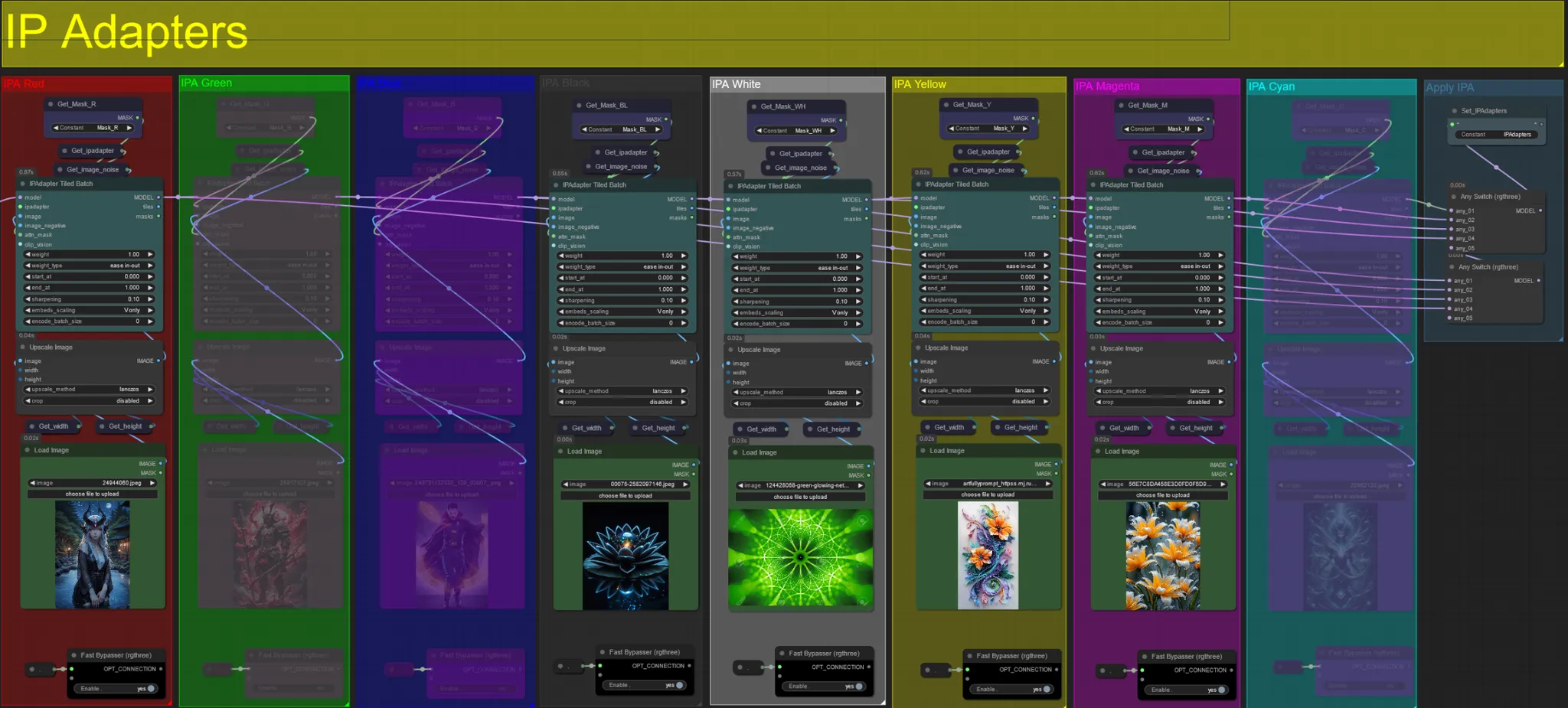

IP 어댑터

- 여기에서 확장 마스크와 비디오 대상에 사용할 배경을 렌더링할 참조 이미지를 지정할 수 있습니다.

- 각 그룹의 색상은 대상 마스크를 나타냅니다:

빨강, 초록, 파랑:

- 대상 마스크 참조 이미지.

검정:

- 배경 마스크 이미지, 배경에 대한 참조 이미지를 업로드하세요.

흰색:

- 확장 마스크 참조 이미지, 사용 중인 각 색상 확장 마스크에 대한 참조 이미지를 업로드하세요.

노랑, 마젠타

- 보로노이 노이즈 마스크 참조 이미지.

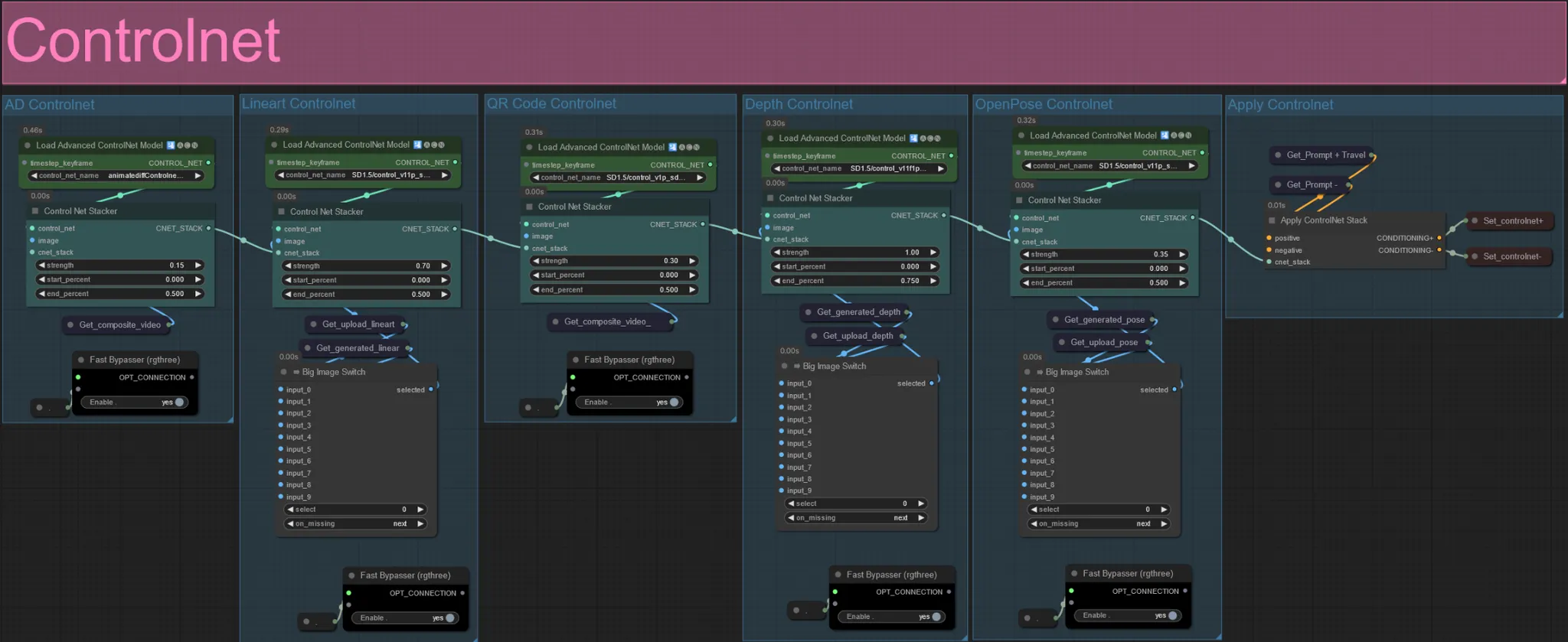

ControlNet

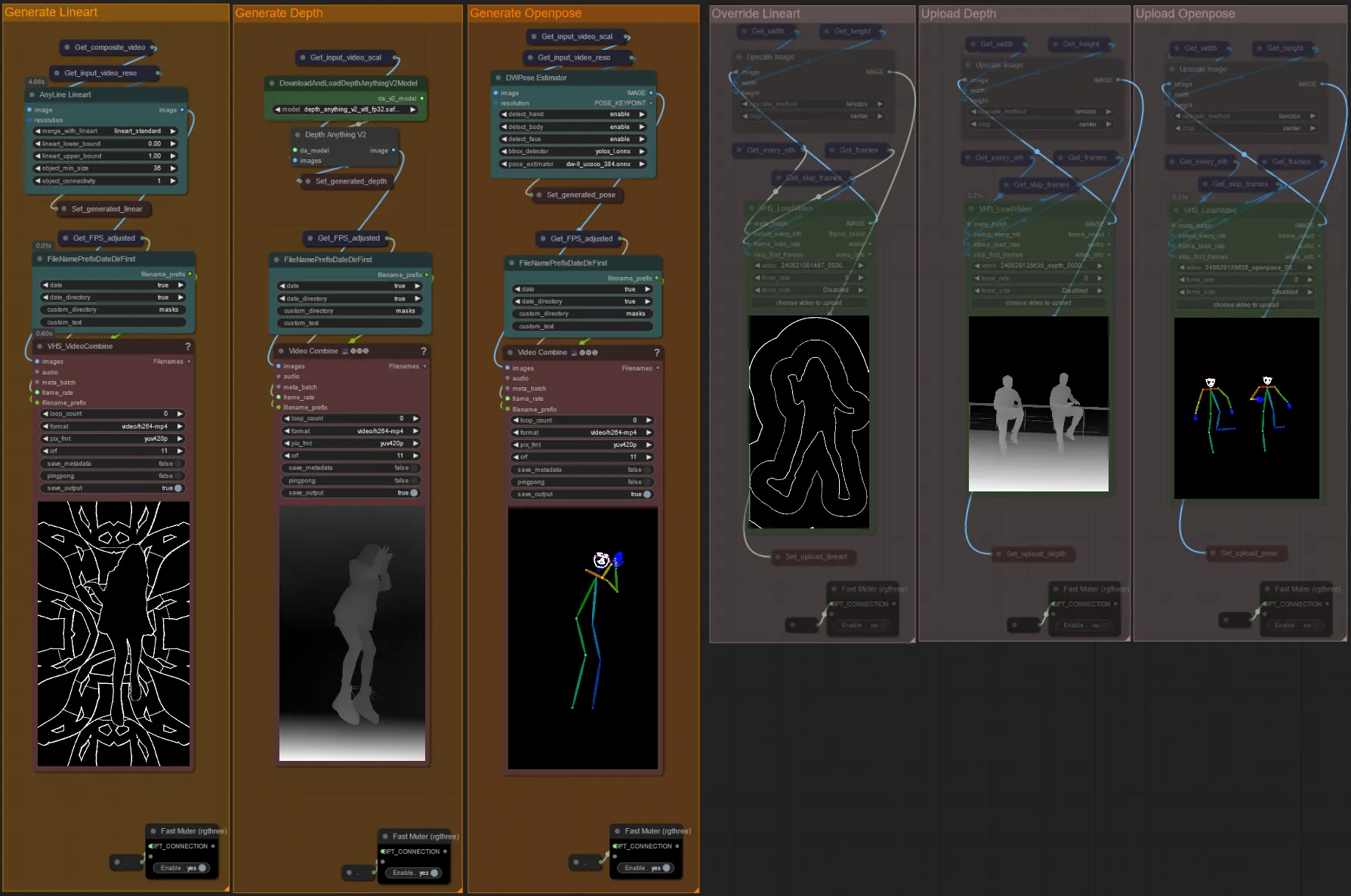

- 이 워크플로우는 AD, Lineart, QR Code, Depth, OpenPose를 포함한 5개의 다양한 controlnet을 사용합니다.

- controlnet의 모든 입력은 자동으로 생성됩니다

- 원하는 경우 아래에서 볼 수 있는 "Override " 그룹의 음소거를 해제하여 Lineart, Depth, Openpose controlnet의 입력 비디오를 덮어쓸 수 있습니다:

- 처리 시간을 절약하기 위해 덮어쓸 경우 "Generate" 그룹의 음소거도 권장합니다.

팁:

- Ksampler를 우회하고 전체 입력 비디오로 렌더링을 시작하세요. 모든 전처리기 비디오가 생성되면 저장하고 해당 오버라이드에 업로드하세요. 이제 워크플로우를 테스트할 때마다 각 전처리기 비디오를 개별적으로 생성할 필요가 없습니다.

샘플러

- 기본적으로 HiRes Fix 샘플러 그룹은 테스트 시 처리 시간을 절약하기 위해 음소거됩니다

- 확장 마스크 설정을 실험하려고 할 때도 시간을 절약하기 위해 샘플러 그룹을 우회하는 것이 좋습니다.

- 최종 렌더링에서는 HiRes Fix 그룹의 음소거를 해제하여 최종 결과를 업스케일하고 세부 사항을 추가할 수 있습니다.

출력

- 두 개의 출력 그룹이 있습니다: 왼쪽은 표준 샘플러 출력용이고, 오른쪽은 HiRes Fix 샘플러 출력용입니다.

- "FileNamePrefixDateDirFirst" 노드의 "custom_directory" 문자열을 변경하여 파일이 저장될 위치를 변경할 수 있습니다. 기본적으로 이 노드는 ComfyUI "output" 디렉토리의 타임스탬프가 찍힌 디렉토리에 출력 비디오를 저장합니다.

- 예:

…/ComfyUI/output/240812/<custom_directory>/<my_video>.mp4

- 예:

오디오 리액티브 비디오를 제작하면 대상에 몰입적이고 맥동하는 에너지를 더할 수 있으며, 모든 프레임이 실시간으로 비트에 반응합니다. 그러니 오디오 리액티브 아트의 세계에 뛰어들어 리듬에 의한 변화를 즐기세요!

저자 소개

Akatz AI:

- 웹사이트:

연락처:

- 이메일: akatzfey@sendysoftware.com