이 가이드는 "Wonder3D" 모델을 사용하여 3D 콘텐츠를 생성하는 포괄적인 소개를 제공하며, "ComfyUI 3D Pack" 노드의 고급 기능을 활용하여 워크플로우를 간소화하고 출력 품질을 향상시킵니다.

Part 1: ComfyUI 3D Pack#

1.1. ComfyUI 3D Pack 소개#

ComfyUI 3D Pack은 Mesh 및 UV Texture와 같은 3D 입력을 처리할 수 있도록 ComfyUI를 확장하는 광범위한 노드 모음입니다. 3DGS (Gaussian Splatting) 및 NeRF (Neural Radiance Fields)와 같은 고급 3D 처리 알고리즘과 모델을 통합하며, Hunyuan3D, StableFast3D, InstantMesh, CRM, TripoSR 등의 최신 모델을 포함합니다.

ComfyUI 3D Pack을 통해 사용자는 직관적인 ComfyUI 인터페이스 내에서 고품질의 3D 콘텐츠를 가져오고, 조작하고 생성할 수 있습니다. OBJ, PLY, GLB와 같은 다양한 3D 파일 형식을 지원하여 기존 3D 모델의 통합이 용이합니다. 이 팩에는 3D 기하학을 편집, 정리 및 최적화할 수 있는 강력한 메쉬 처리 유틸리티도 포함되어 있습니다.

주요 하이라이트 중 하나는 2D 이미지에서 포토리얼리스틱한 3D 재구성을 가능하게 하는 NeRF 기술의 통합입니다. 3DGS 노드는 포인트 클라우드 렌더링 및 스타일화를 가능하게 합니다. InstantMesh 및 TripoSR 모델은 3D 메쉬의 고해상도 업스케일링 및 슈퍼 해상도를 허용합니다. CRM (Convolutional Reconstruction Model)은 다중 뷰 이미지에서 3D 형상을 복원하고 CCM (Color Correction Map)을 제공합니다.

ComfyUI 3D Pack은 MrForExample이 개발했으며, 모든 공로는 MrForExample에게 돌아갑니다. 자세한 정보는 ComfyUI 3D Pack을 참조하십시오.

1.2. RunComfy에서 실행 준비가 된 ComfyUI 3D Pack#

현재 ComfyUI 3D Pack은 RunComfy 웹사이트에서 완전히 설정되어 사용 가능합니다. 사용자는 추가 소프트웨어나 종속성을 설치할 필요가 없습니다. 필요한 모든 모델, 알고리즘 및 도구가 사전 구성되어 웹 기반 ComfyUI 환경에서 효율적으로 실행되도록 최적화되어 있습니다.

Part 2: ComfyUI 3D Pack 노드와 Wonder3D 모델 사용#

2.1. Wonder3D란 무엇인가?#

Wonder3D는 단일 뷰 이미지에서 고품질의 텍스처 메쉬를 효율적으로 생성하기 위한 최첨단 방법입니다. 크로스 도메인 확산 모델의 힘을 활용하여 다중 뷰 노멀 맵과 해당 컬러 이미지를 생성합니다. Wonder3D는 단일 뷰 3D 재구성 작업에서 충실도, 일관성, 일반화 가능성 및 효율성의 문제를 해결하는 것을 목표로 합니다.

Wonder3D는 홍콩 대학교, 칭화 대학교, VAST, 펜실베이니아 대학교, 상하이 테크 대학교, MPI Informatik, 텍사스 A&M 대학교의 연구팀에 의해 개발되었으며, Xiaoxiao Long과 Yuan-Chen Guo가 동등한 기여의 제1 저자로 참여했습니다. 모든 공로는 그들의 기여에 돌아가며, 자세한 정보는 여기에서 확인할 수 있습니다.

2.2. Wonder3D의 기술적 배경#

Wonder3D의 핵심은 혁신적인 크로스 도메인 확산 모델에 있습니다. 이 모델은 다중 뷰에서 노멀 맵과 컬러 이미지의 공동 분포를 캡처하도록 설계되었습니다. 이를 달성하기 위해 Wonder3D는 도메인 스위처와 크로스 도메인 주의 메커니즘을 도입합니다. 도메인 스위처는 노멀 맵 또는 컬러 이미지의 원활한 생성을 허용하며, 크로스 도메인 주의 메커니즘은 두 도메인 간의 정보 교환을 촉진하여 일관성과 품질을 향상시킵니다.

Wonder3D의 또 다른 주요 구성 요소는 기하학 인식 노멀 융합 알고리즘입니다. 이 알고리즘은 생성된 다중 뷰 2D 표현에서 높은 품질의 표면을 견고하게 추출하며, 부정확성이 있는 경우에도 작동합니다. 노멀 맵과 컬러 이미지에 인코딩된 풍부한 표면 세부 사항을 활용하여 Wonder3D는 깔끔하고 세부적인 기하학을 재구성합니다.

2.3. Wonder3D의 장점 및 잠재적 제한 사항#

Wonder3D는 기존의 단일 뷰 재구성 방법에 비해 몇 가지 장점을 제공합니다. 높은 수준의 기하학적 세부 사항을 달성하면서도 좋은 효율성을 유지하여 다양한 응용 프로그램에 적합합니다. 크로스 도메인 확산 모델은 Wonder3D가 다양한 객체 카테고리와 스타일에 잘 일반화되도록 합니다. 크로스 도메인 주의 메커니즘에 의해 강제된 다중 뷰 일관성은 일관되고 그럴듯한 3D 재구성을 결과로 제공합니다.

그러나 모든 방법과 마찬가지로 Wonder3D는 몇 가지 제한 사항이 있을 수 있습니다. 생성된 메쉬의 품질은 학습 데이터와 확산 모델이 기본 3D 구조를 캡처하는 능력에 따라 달라집니다. 매우 복잡하거나 모호한 형태는 도전 과제가 될 수 있습니다. 또한, 현재 Wonder3D의 구현은 단일 객체에 초점을 맞추고 있으며, 여러 객체나 전체 장면을 처리하도록 확장하는 것은 향후 연구의 영역이 될 수 있습니다.

2.4. Wonder3D 워크플로우 사용 방법#

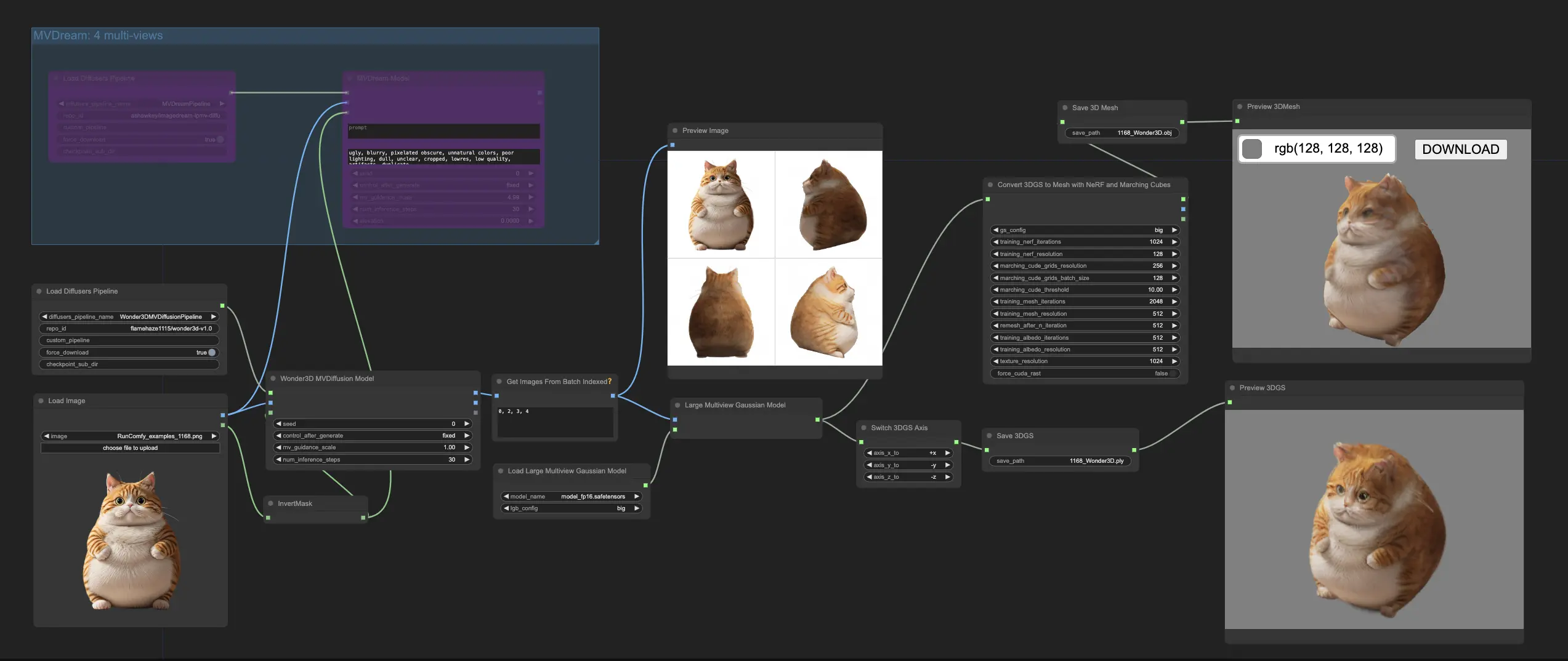

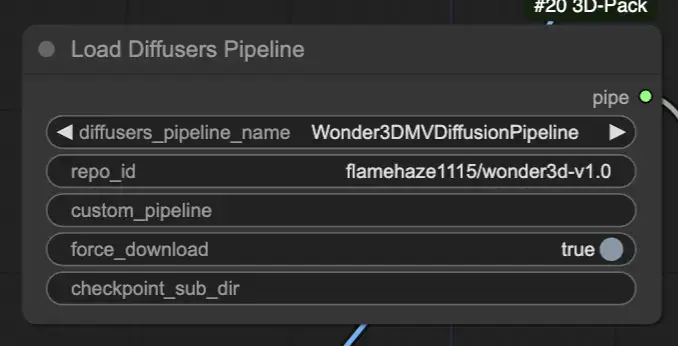

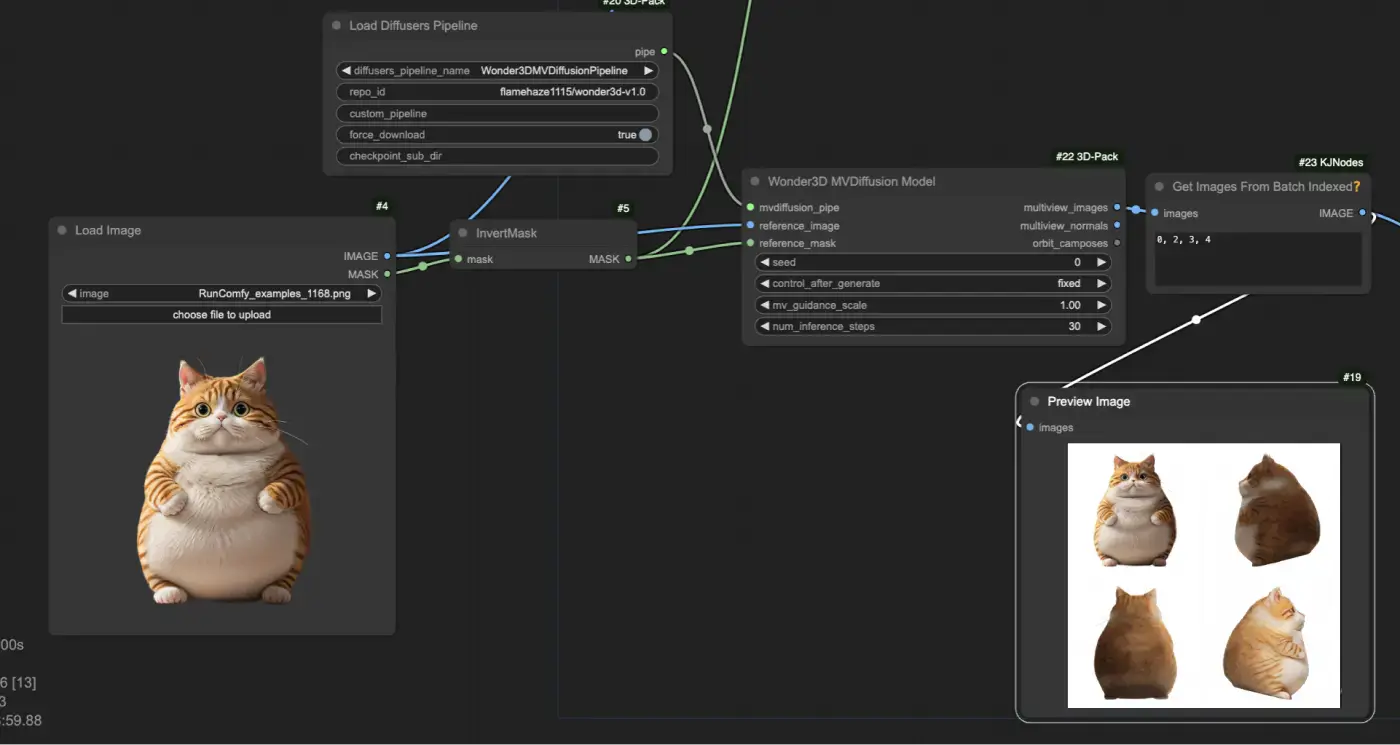

필요한 모델 체크포인트와 구성을 가져오는 "[Comfy3D] Load Diffusers Pipeline" 노드를 사용하여 사전 학습된 Wonder3D 확산 파이프라인을 로드합니다.

"LoadImage" 및 "InvertMask" 노드를 사용하여 입력 이미지와 해당 마스크를 제공합니다. 그런 다음 입력 이미지와 마스크를 "[Comfy3D] Wonder3D MVDiffusion Model" 노드에 공급하여 다중 뷰 노멀 맵과 컬러 이미지를 생성합니다.

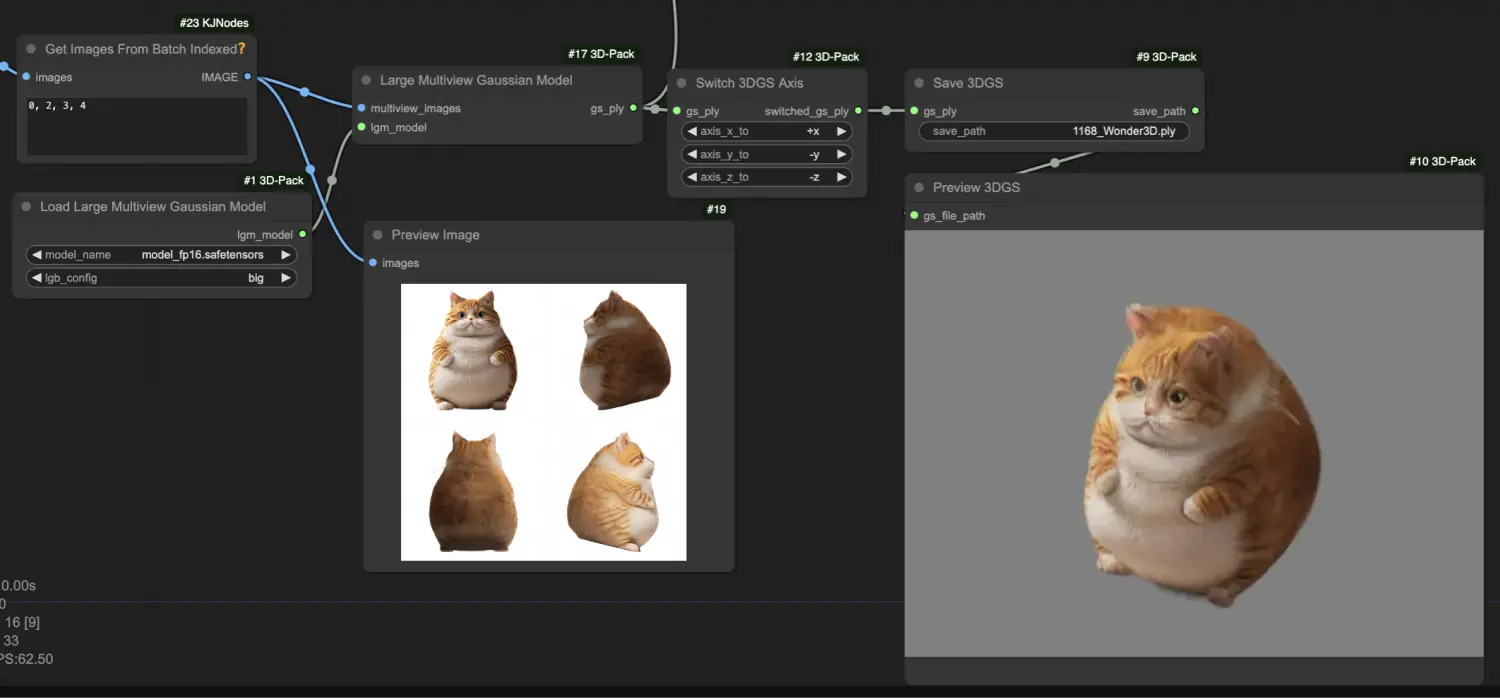

생성된 다중 뷰 이미지를 "[Comfy3D] Large Multiview Gaussian Model" 노드를 사용하여 처리하여 3D Gaussian Splatting (3DGS) 표현으로 변환하여 객체의 기하학적 세부 사항을 포인트 클라우드 형식으로 캡처합니다.

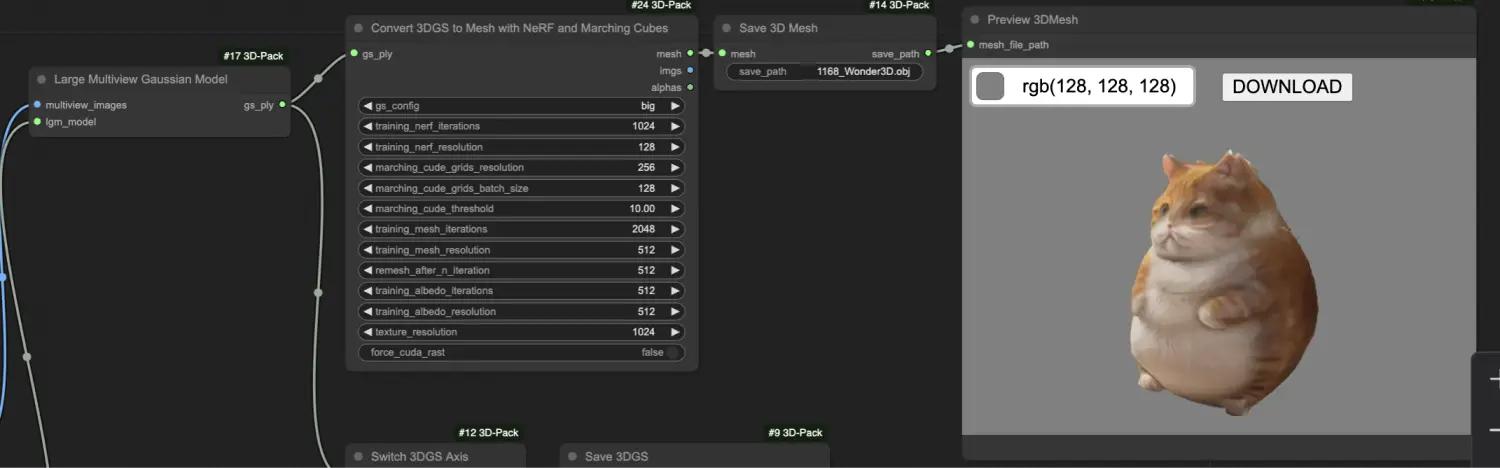

"[Comfy3D] Convert 3DGS to Mesh with NeRF and Marching Cubes" 노드를 사용하여 3DGS 표현을 텍스처 메쉬로 변환하며, 이 노드는 NeRF 및 Marching Cubes 알고리즘을 사용하여 고품질 메쉬를 추출합니다.