Эволюция Аудиореактивных Танцоров

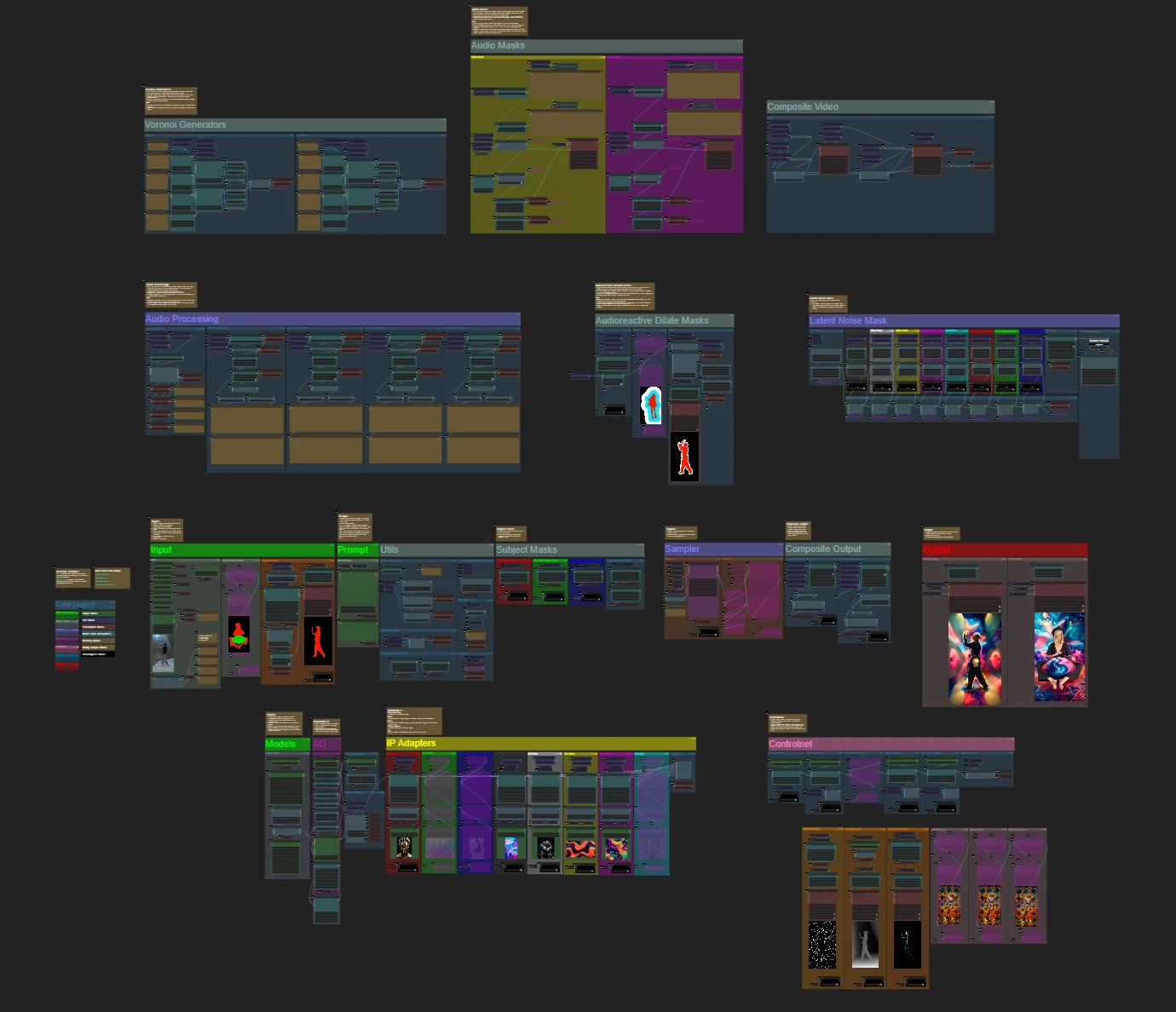

Рабочий процесс Audioreactive Dancers Evolved преобразует видеосюжеты в захватывающие анимации, синхронизированные с музыкальными ритмами, на фоне динамичных геометрических и психоделических изображений. Разработанный для гибкости, он позволяет пользователям управлять кадрами видео, маскированием, аудиореакцией и деталями узоров. С такими функциями, как маски расширения, ControlNet и анимация шума, синхронизированная с ритмом, этот рабочий процесс ComfyUI дает возможность творческим людям объединять искусство, звук и движение, создавая визуально захватывающие, ритмичные впечатления с аудиореактивными визуальными эффектами.ComfyUI Audioreactive Dancers Evolved Рабочий процесс

- Полностью функциональные рабочие процессы

- Нет недостающих узлов или моделей

- Не требуется ручная настройка

- Отличается потрясающей визуализацией

ComfyUI Audioreactive Dancers Evolved Примеры

ComfyUI Audioreactive Dancers Evolved Описание

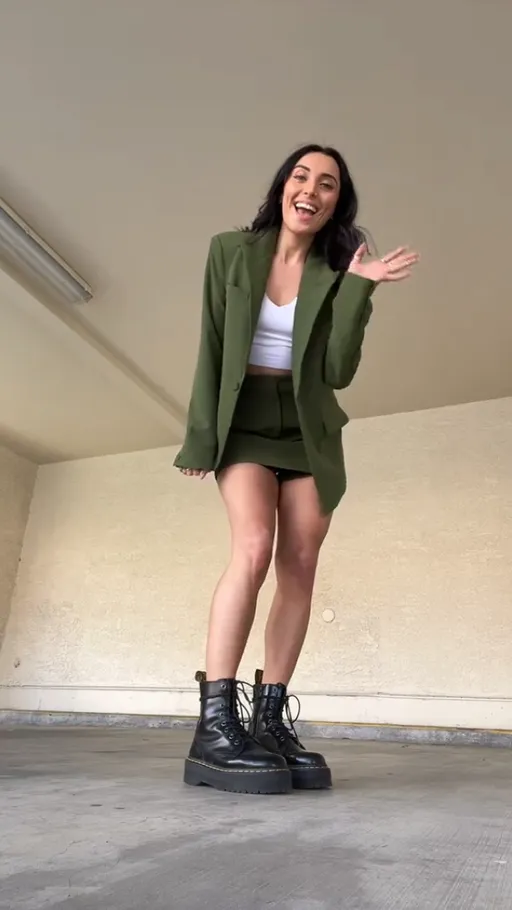

Создайте потрясающие видеоанимации, преобразуя ваш объект (танцора) и добавляя ему динамичный аудиореактивный фон, состоящий из различных сложных геометрических фигур и психоделических узоров. Вы можете использовать этот рабочий процесс с одним или несколькими объектами. С помощью этого рабочего процесса вы можете создавать завораживающие аудиореактивные визуальные эффекты, которые идеально синхронизируются с ритмом музыки, предлагая захватывающее впечатление. Рабочий процесс позволяет использовать его с одним объектом или несколькими объектами, все из которых улучшены аудиореактивными элементами.

Как использовать рабочий процесс Audioreactive Dancers Evolved:

- Загрузите видео объекта в секцию Input

- Выберите желаемую ширину и высоту конечного видео, а также сколько кадров исходного видео должно быть пропущено с помощью "every_nth". Вы также можете ограничить общее количество кадров для рендеринга с помощью "frame_load_cap".

- Заполните положительный и отрицательный запрос. Установите время перехода кадров в пакетном режиме, чтобы определить, когда должны происходить переходы сцен.

- Загрузите изображения для каждой из цветов маски объекта IP Adapter по умолчанию:

- Красный, Зеленый, Синий = объект(ы)

- Черный = Фон

- Белый = Белая аудиореактивная маска расширения

- Желтый, Пурпурный = Шумовые маски фона

- Загрузите хороший контрольный чекпоинт LCM (я использую ParadigmLCM от Machine Delusions) в разделе "Models".

- Добавьте любые лоры, используя Lora stacker ниже загрузчика модели

- Нажмите Queue Prompt

Видеогид

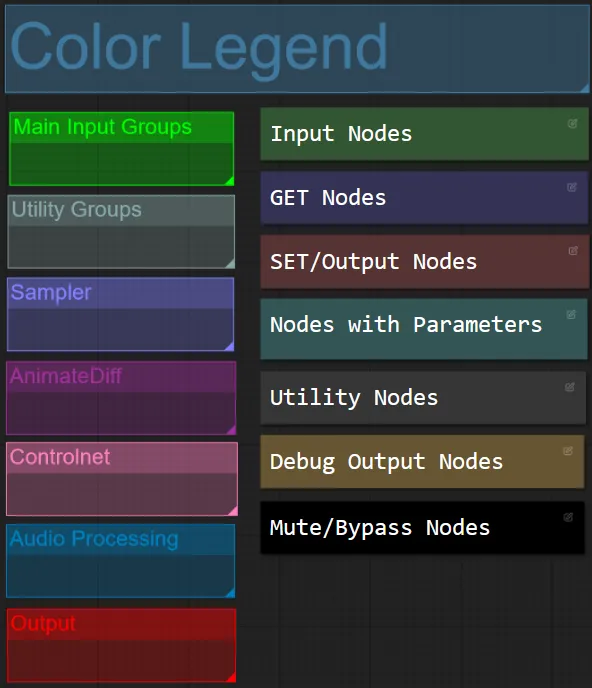

Цвет узлов и групп

- Для этого рабочего процесса я согласовал цвета узлов в зависимости от их функциональности в каждой группе.

- Заголовки секций групп окрашены для облегчения различения.

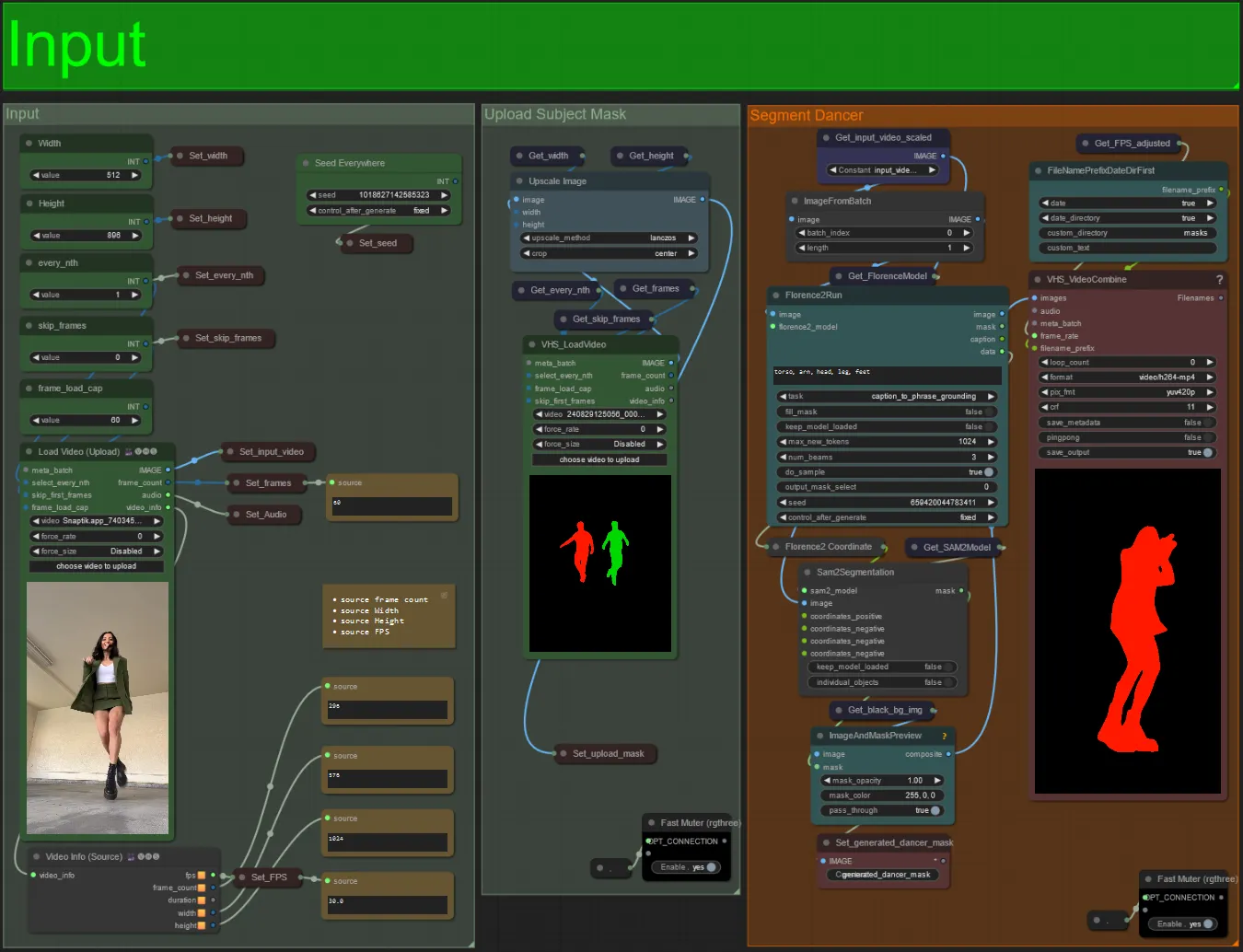

Ввод

- Загрузите желаемое видео объекта в узел Load Video (Upload).

- Вы можете настроить ширину и высоту вывода, используя два верхних левых входа.

- every_nth устанавливает, использовать ли каждый второй кадр, каждый третий кадр и так далее (2 = каждый второй кадр). По умолчанию оставлено на 1.

- skip_frames используется для пропуска кадров в начале видео. (100 = пропустить первые 100 кадров исходного видео). По умолчанию оставлено на 0.

- frame_load_cap используется для указания, сколько всего кадров исходного видео должно быть загружено. Лучше оставить низким при тестировании настроек (30 - 60, например), а затем увеличить или установить на 0 (без ограничения кадров) при рендеринге финального видео.

- Поля чисел в нижнем правом углу отображают информацию о загруженном входном видео: общее количество кадров, ширина, высота и FPS сверху вниз.

- Если у вас уже есть видео маски объекта, вы можете отключить "Upload Subject Mask" и загрузить видео маски. При желании вы можете отключить "Segment Dancer", чтобы сэкономить время обработки.

- Иногда сегментированный объект будет не идеален, вы можете проверить качество маски, используя окно предварительного просмотра в нижнем правом углу, как показано выше. Если это так, вы можете поиграть с запросом в узле "Florence2Run", чтобы нацеливаться на различные части тела, такие как "голова", "грудь", "ноги" и т.д., и посмотреть, получите ли вы лучший результат.

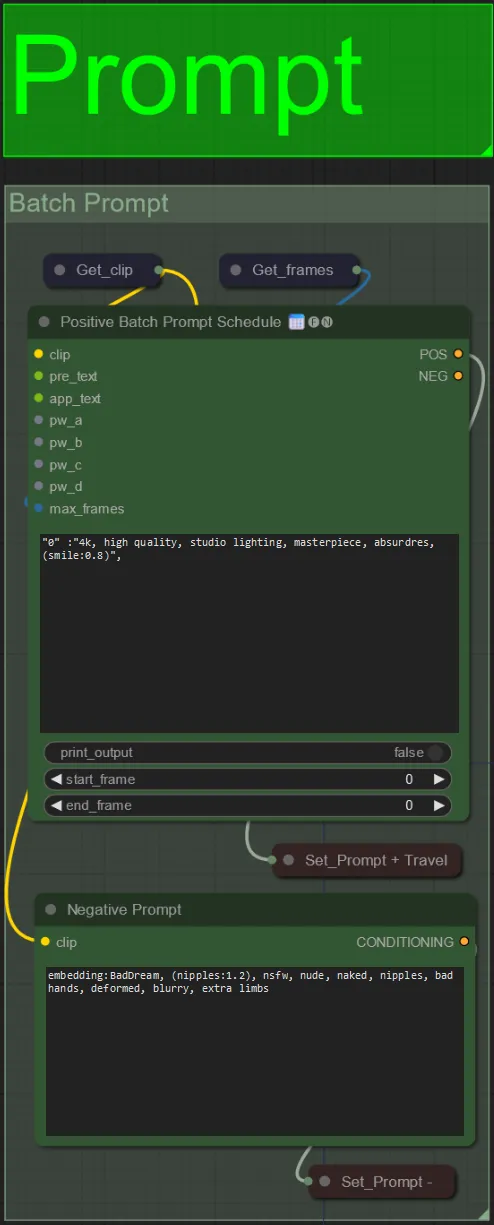

Запрос

- Установите положительный запрос, используя пакетное форматирование:

- например, "0": "4k, шедевр, 1 девушка стоит на пляже, absurdres", "25": "HDR, сцена заката, 1 девушка с черными волосами и белой курткой, absurdres", …

- Негативный запрос в обычном формате, вы можете добавить эмбеддинги, если хотите.

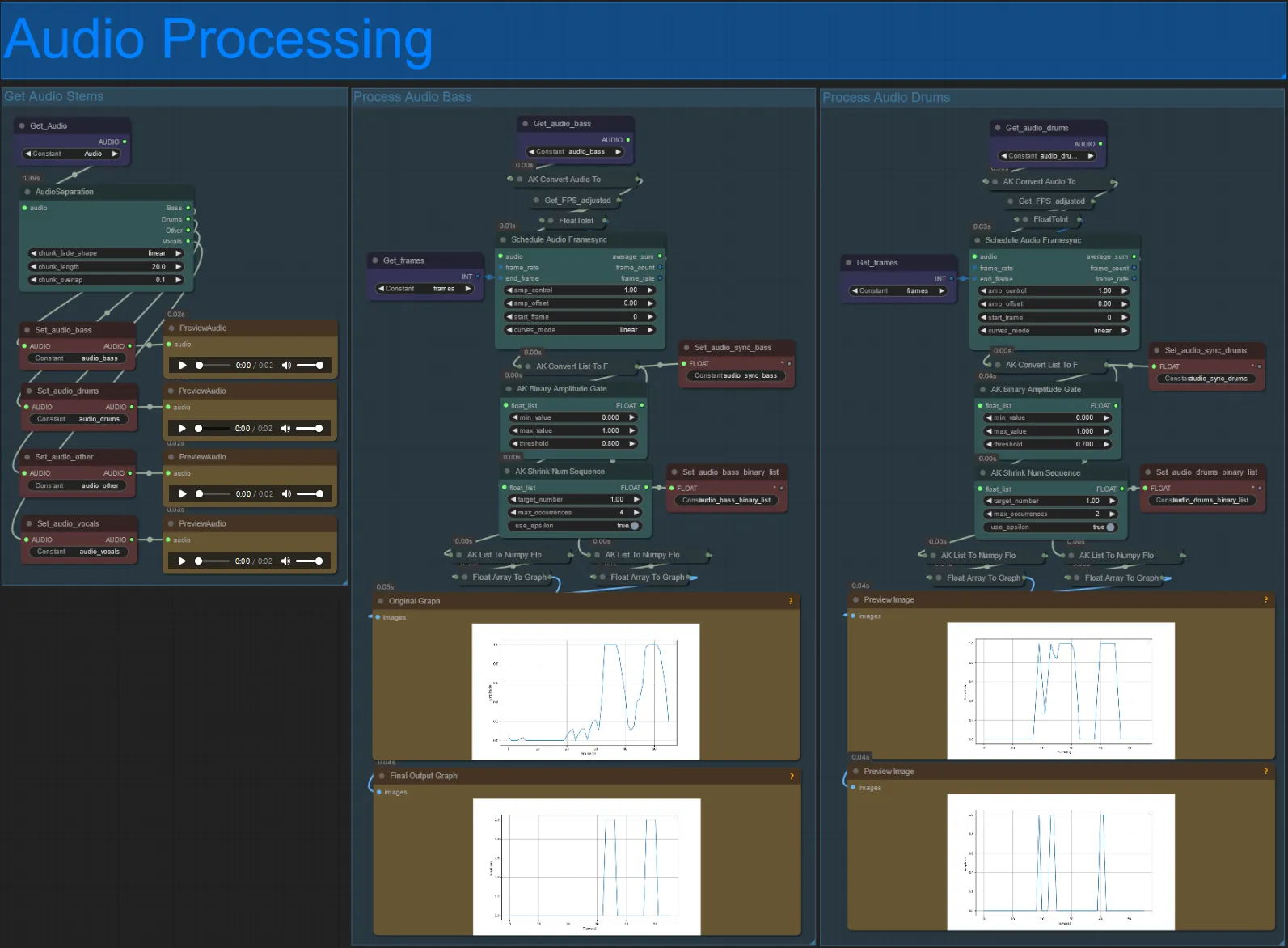

Аудиообработка

- Этот раздел принимает аудио из входного видео, извлекает стемы (бас, барабаны, вокал и т.д.) и затем преобразует его в нормализованную амплитуду, синхронизированную с кадрами входного видео, чтобы создать аудиореактивные визуальные эффекты.

- amp_control = общий диапазон, на который может колебаться амплитуда.

- amp_offset = минимальное значение, которое может принимать амплитуда.

- Пример: amp_control = 0.8 и amp_offset = 0.2 означает, что сигнал будет колебаться между 0.2 и 1.0.

- Иногда стемы барабанов содержат настоящие басовые ноты песни, просмотрите каждый, чтобы определить, какой использовать для ваших аудиореактивных масок.

- Используйте графики, чтобы получить хорошее представление о том, как сигнал для этого стема изменяется на протяжении видео

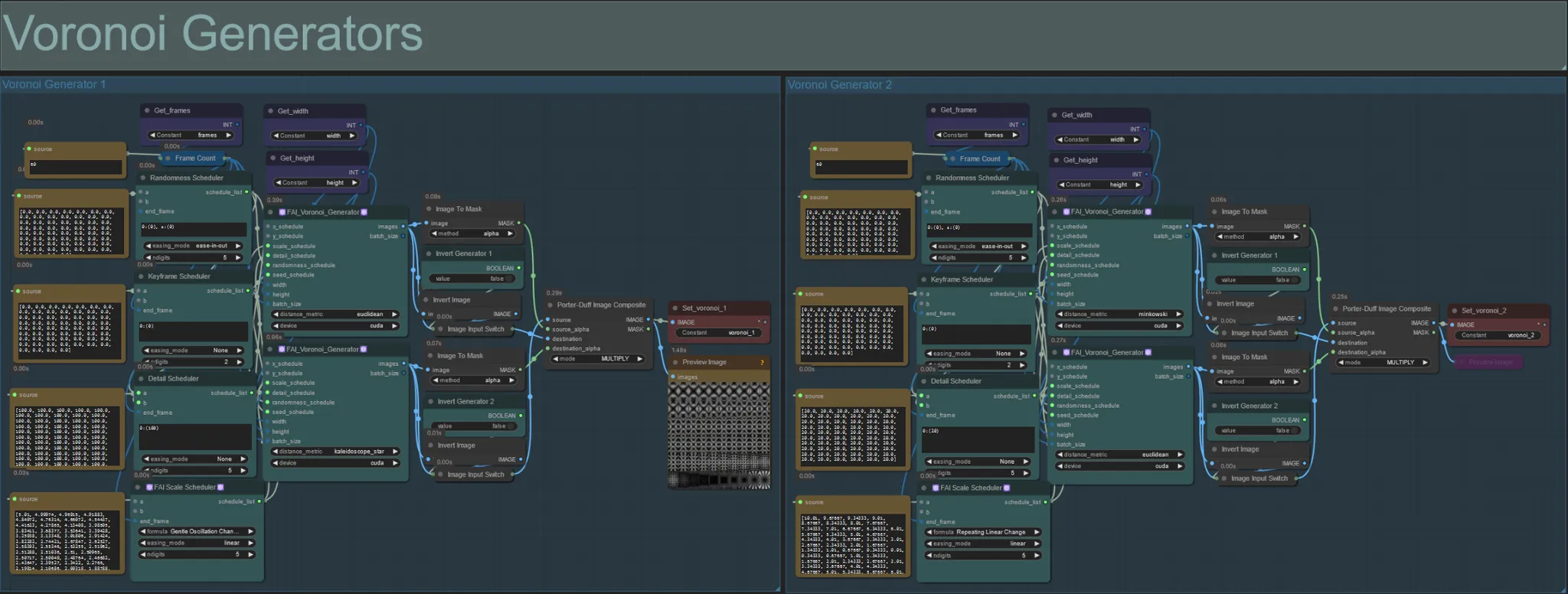

Генераторы Вороного

- Этот раздел генерирует шумовые узоры Вороного, используя два пользовательских узла FAI_Voronoi_Generator на каждую группу, которые компонуются вместе с помощью Multiply.

- Вы можете увеличить значения Randomness Scheduler в скобках от 0, чтобы разбить симметричные узоры в конечном результате.

- Увеличьте значение Detail Scheduler в скобках, чтобы увеличить количество деталей в выходных шумовых узорах. Более низкие значения приводят к меньшему различению шума.

- Измените параметры "formula" в узле FAI Scale Scheduler, чтобы значительно повлиять на движение конечного шумового узора.

- Вы также можете изменить функцию "distance_metric" на самих узлах FAI_Voronoi_Generator, чтобы значительно повлиять на генерируемые узоры и формы полученного шума.

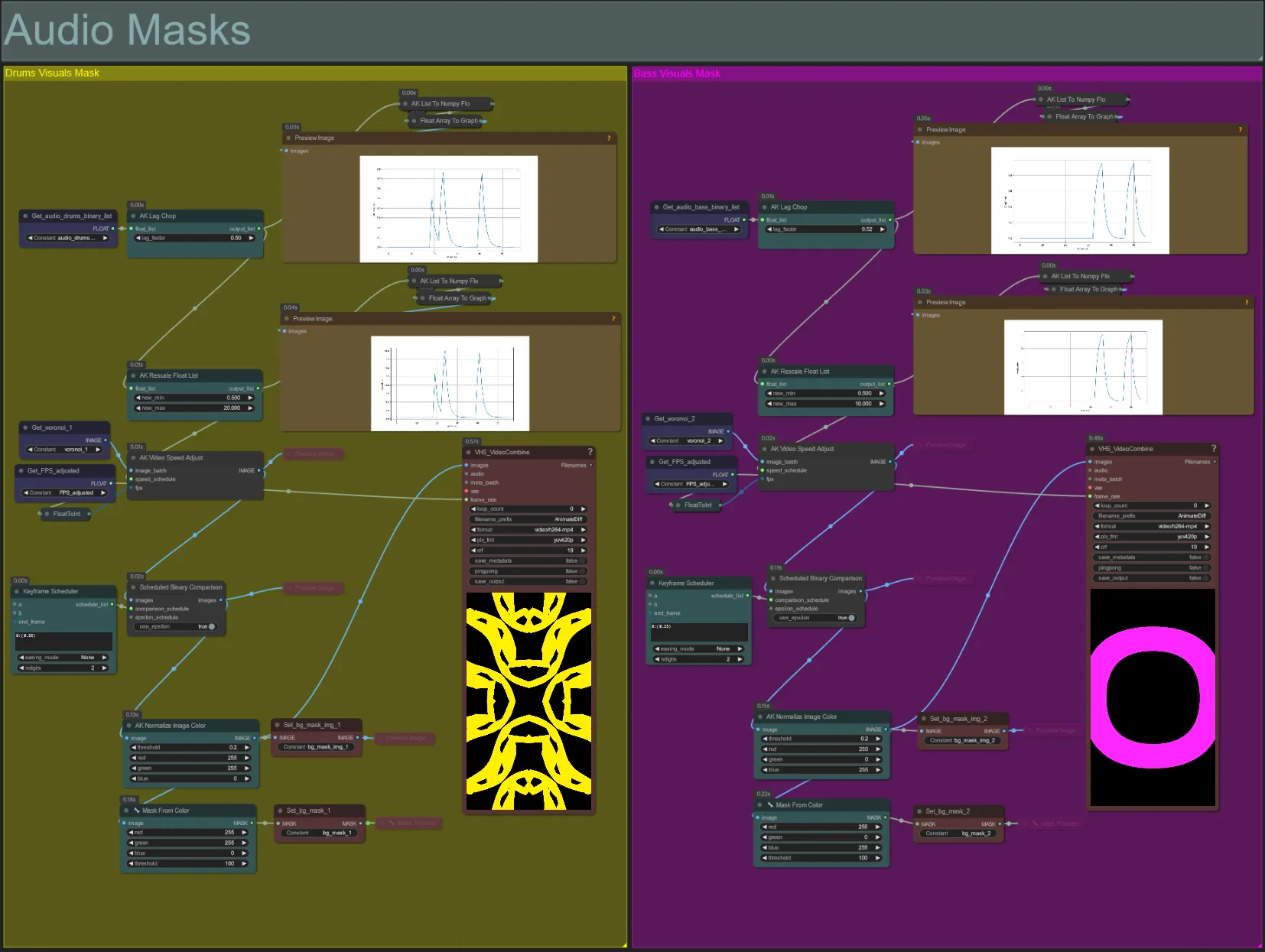

Аудиомаски

- Этот раздел используется для преобразования партий изображений шума Вороного в цветные маски для компоновки с объектом, а также синхронизирует их движения с ритмом либо басовых, либо барабанных аудиостемов. Эти маски необходимы для создания аудиореактивных эффектов.

- Увеличьте "lag_factor" в узле AK Lag Chop, чтобы увеличить, насколько "острыми" будут конечные графики амплитуды. Это приведет к тому, что движение выходного шума будет ускоряться и замедляться более резко, тогда как более низкий lag_factor приведет к более постепенному замедлению движения после каждого удара. Это используется, чтобы избежать появления анимации шума слишком "скачкообразной" и жесткой.

- AK Rescale Float List используется для повторного отображения нормализованных значений амплитуды от 0-1 до new_min и new_max. Значение 1.0 представляет собой скорость воспроизведения шумовой анимации в 30 кадров в секунду, тогда как 0.5 представляет собой 15 кадров в секунду, 2.0 представляет собой 60 кадров в секунду и т.д. Настройте это значение, чтобы изменить, насколько медленно аудиореактивный шумовой узор анимируется вне ритма (амплитуда 0.0), и насколько быстро он движется в ритм (амплитуда 1.0).

- Keyframe Scheduler сильно влияет на внешний вид маски. Он создает список значений float, чтобы указать пороговые значения яркости пикселей для использования для входных изображений шума, что приведет к тому, что часть шума будет обрезана и превращена в конечную маску. Уменьшите это значение, чтобы сохранить больше входного шума, и увеличьте, чтобы сохранить меньше шума.

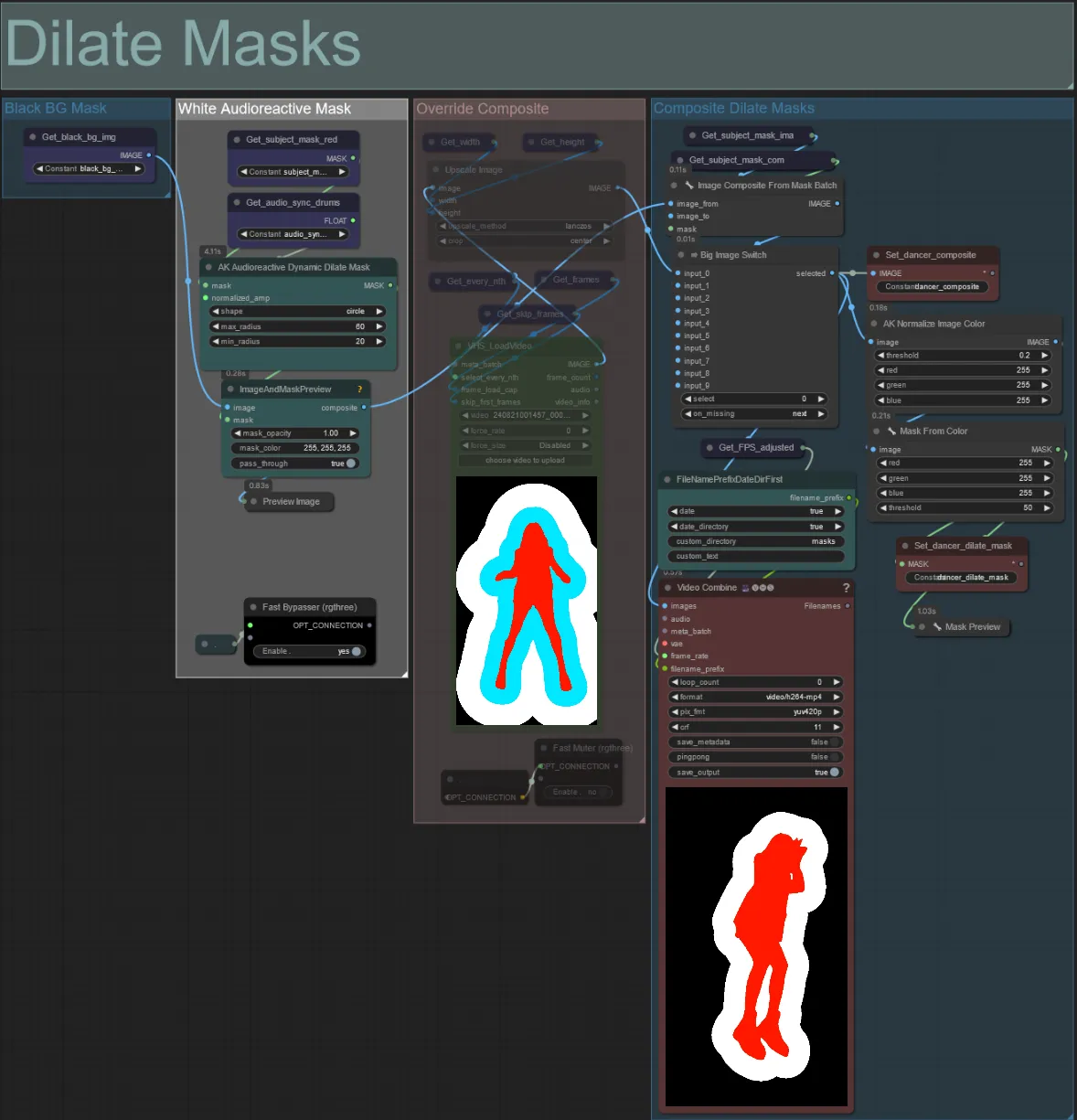

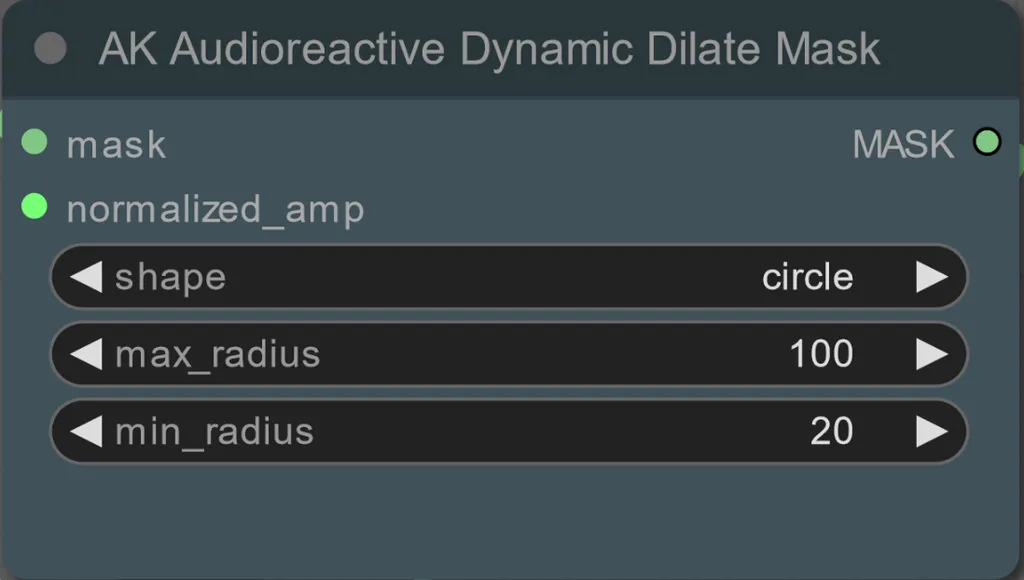

Расширение масок

- Каждая цветная группа соответствует цвету маски расширения, которая будет сгенерирована ею.

- Вы можете установить минимальный и максимальный радиус маски расширения, а также форму, используя следующий узел:

- форма: "круг" является наиболее точной, но требует больше времени для генерации. Установите это, когда вы готовы выполнить окончательное рендеринг. "квадрат" вычисляется быстро, но менее точен, лучше всего подходит для тестирования рабочего процесса и выбора изображений IP адаптера.

- max_radius: Радиус маски в пикселях, когда значение амплитуды максимальное (1.0).

- min_radius: Радиус маски в пикселях, когда значение амплитуды минимальное (0.0).

- Если у вас уже есть сгенерированное видео композитной маски, вы можете отключить группу "Override Composite Mask" и загрузить его. Рекомендуется обойти группы масок расширения, если выполняется переопределение, чтобы сэкономить время обработки.

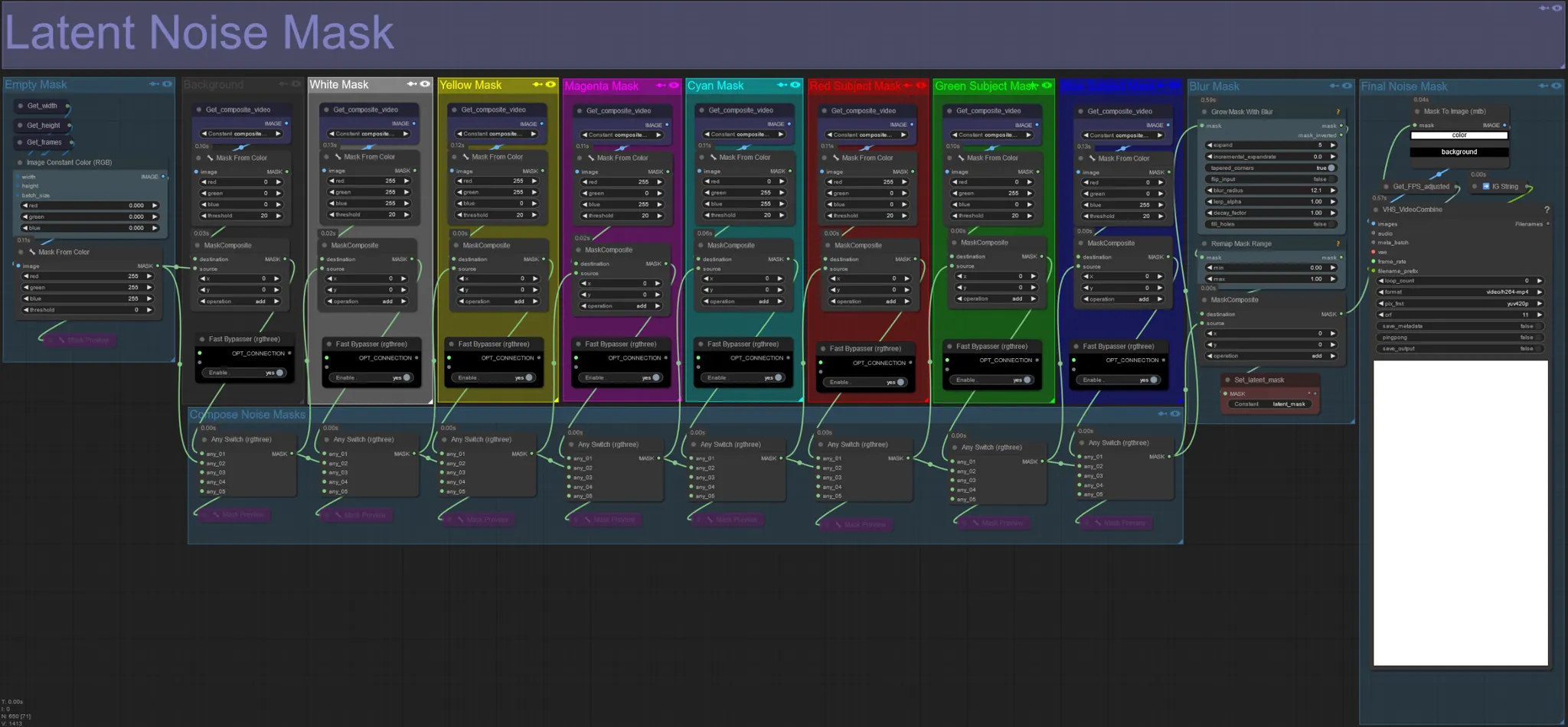

Маска латентного шума

- Используйте маски латентного шума, чтобы контролировать, какие маски будут действительно диффузированы (воссозданы) с помощью ksampler. Обойдите группу, соответствующую цветной маске, которую вы не хотите диффузировать (т.е. хотите, чтобы элементы из оригинального видео появились).

- Оставляя все группы масок включенными, получается белая конечная шумовая маска (все будет диффузировано).

- Пример: Обойдите группу Red Subject Mask, нажав на узел Fast Bypasser, чтобы ваш танцор или объект появился в конечном результате.

Оригинальное входное видео:

Обход групп масок Red и Yellow:

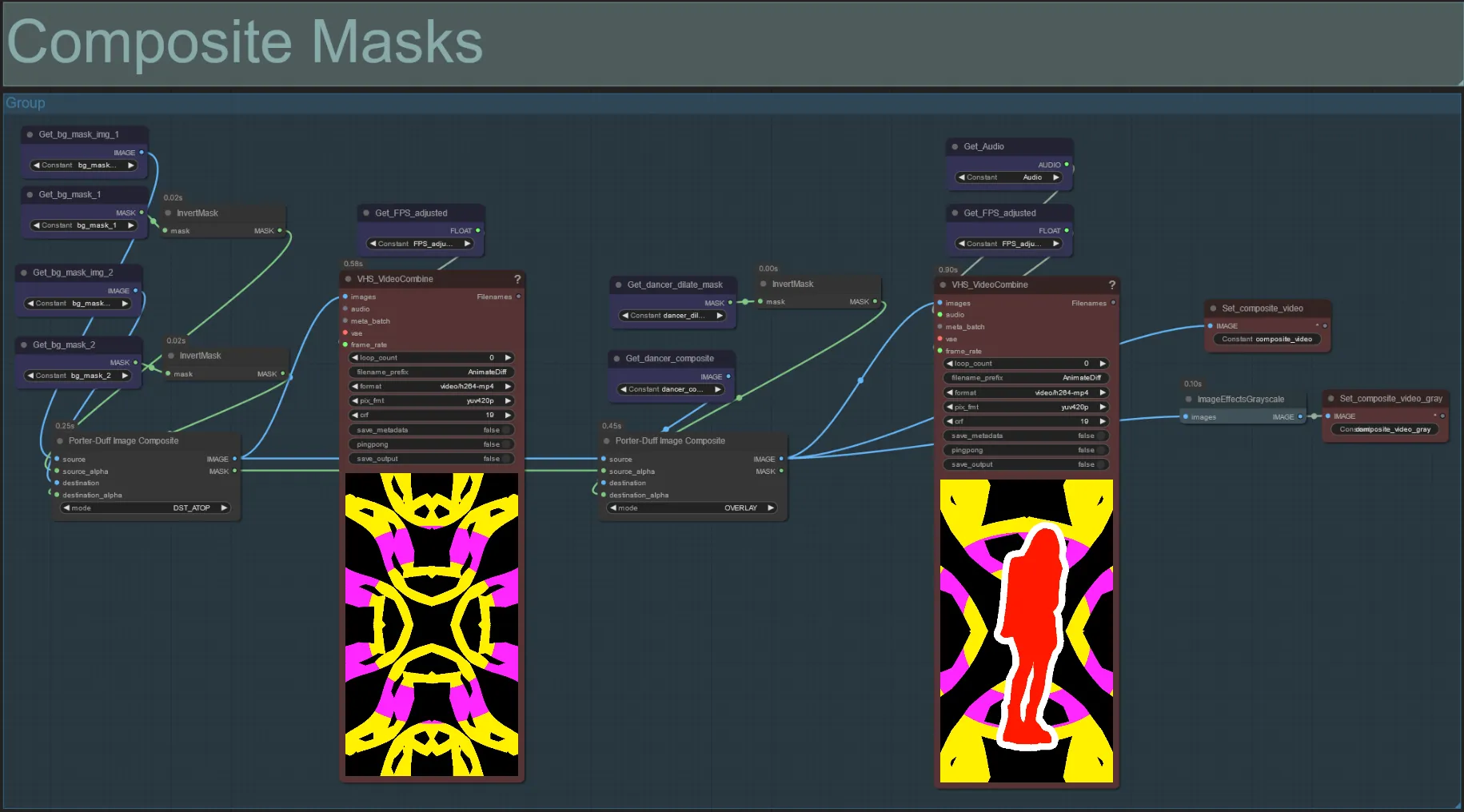

Композитная маска

- Этот раздел создает окончательный композит масок шума Вороного с маской объекта (и аудиореактивной маской расширения, если включена).

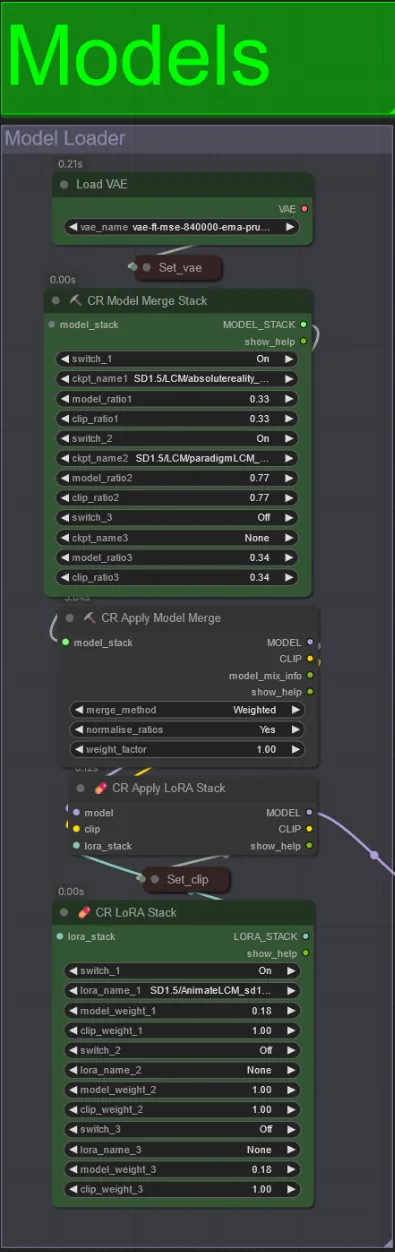

Модели

- Используйте хорошую модель LCM для контрольной точки. Я рекомендую ParadigmLCM от Machine Delusions.

- Вы можете объединить несколько моделей вместе, используя Model Merge Stack, чтобы получить различные интересные эффекты. Убедитесь, что веса в сумме составляют 1.0 для включенных моделей.

- Вы можете дополнительно указать AnimateLCM_sd15_t2v_lora.safetensors с низким весом 0.18, чтобы еще больше улучшить конечный результат.

- Добавьте любые дополнительные лоры к модели, используя Lora stacker ниже загрузчика модели.

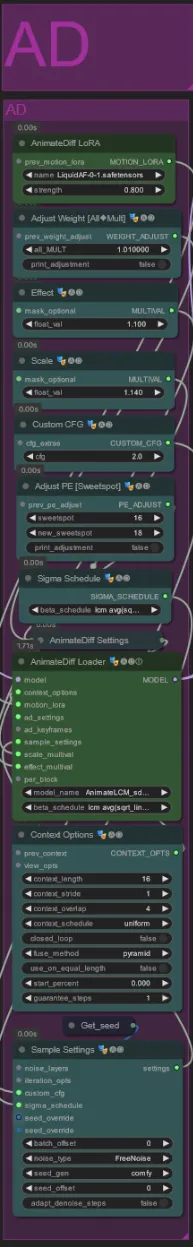

AnimateDiff

- Вы можете установить другую Motion Lora вместо той, которую я использовал (LiquidAF-0-1.safetensors)

- Увеличьте/уменьшите значения Scale и Effect, чтобы увеличить/уменьшить количество движения в выводе.

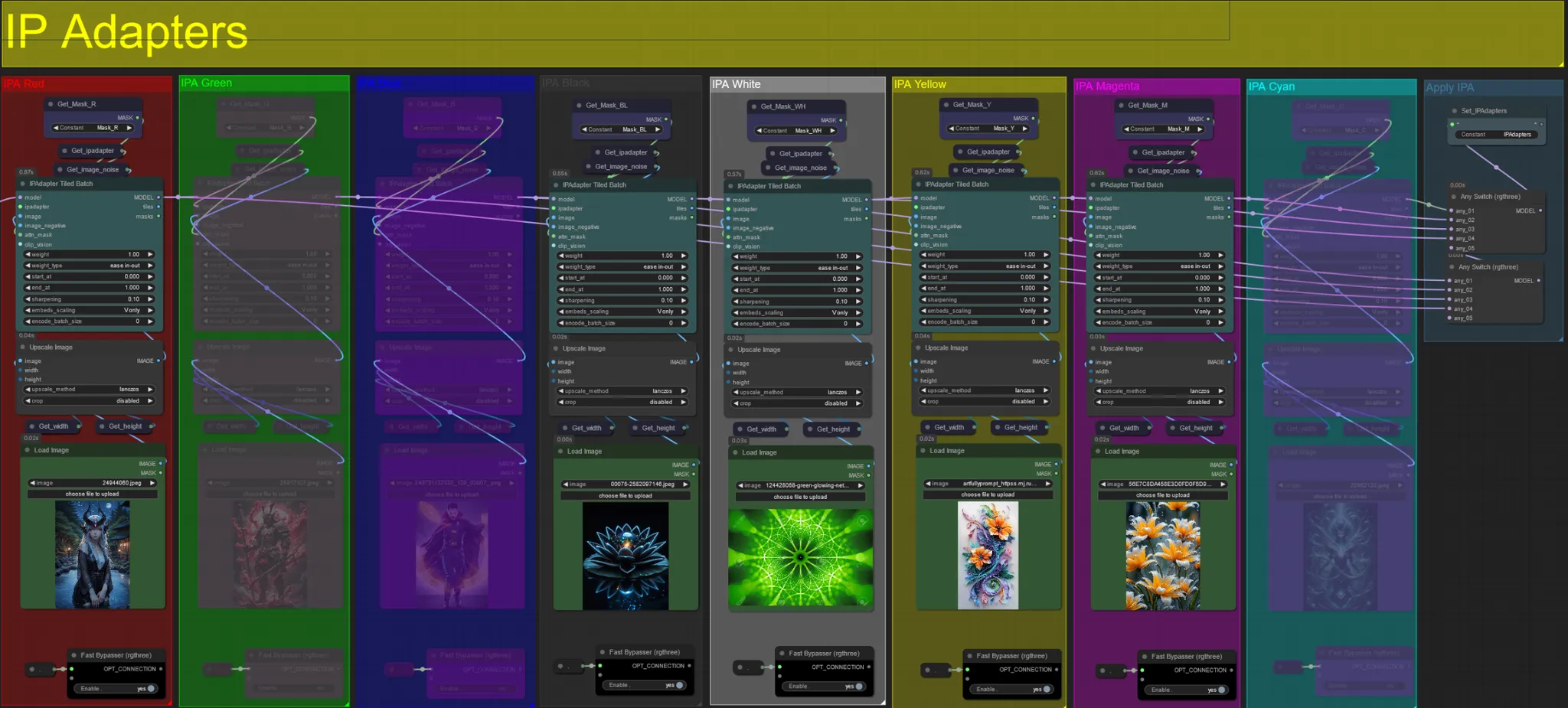

IP адаптеры

- Здесь вы можете указать эталонные изображения, которые будут использоваться для рендеринга фонов для каждой из масок расширения, а также вашего видео объекта(ов).

- Цвет каждой группы представляет маску, на которую она нацелена:

Красный, Зеленый, Синий:

- Эталонные изображения масок объектов.

Черный:

- Изображение маски фона, загрузите эталонное изображение для фона.

Белый:

- Эталонные изображения масок расширения, загрузите эталонное изображение для каждой цветной маски расширения, используемой.

Желтый, Пурпурный

- Эталонные изображения масок шума Вороного.

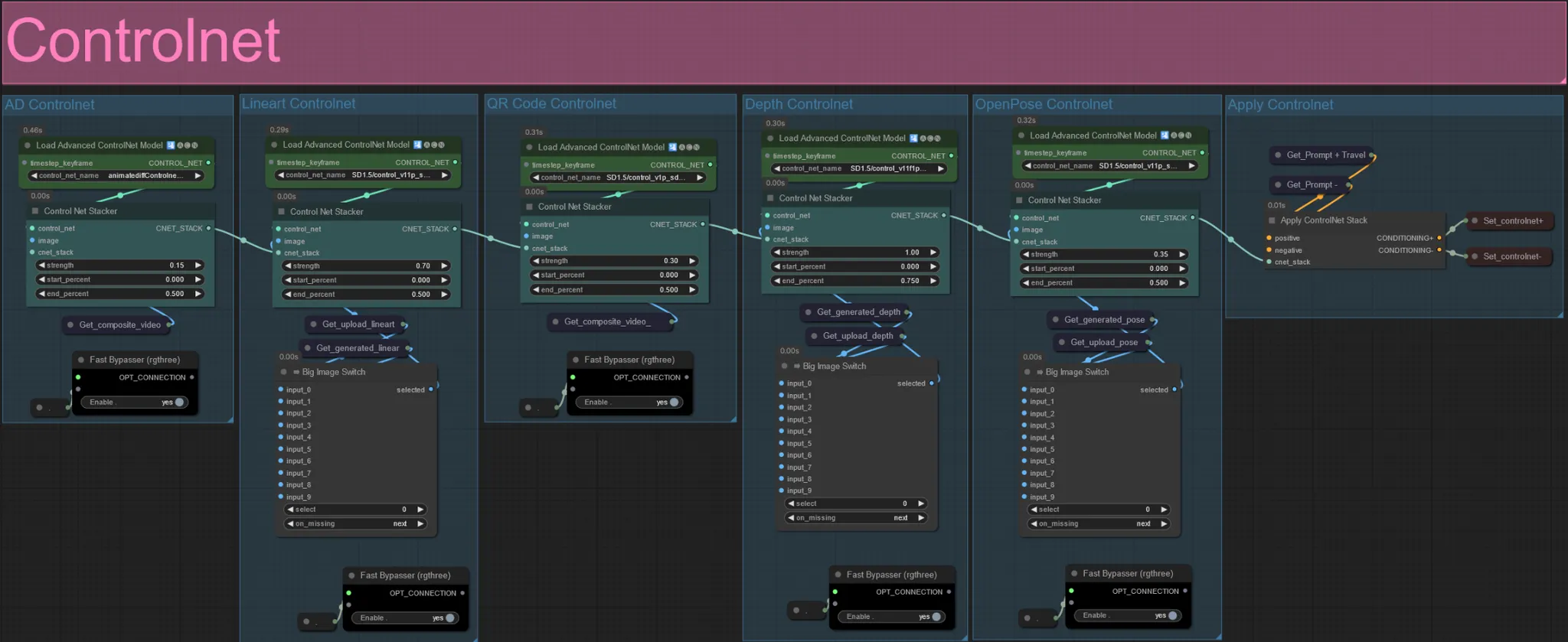

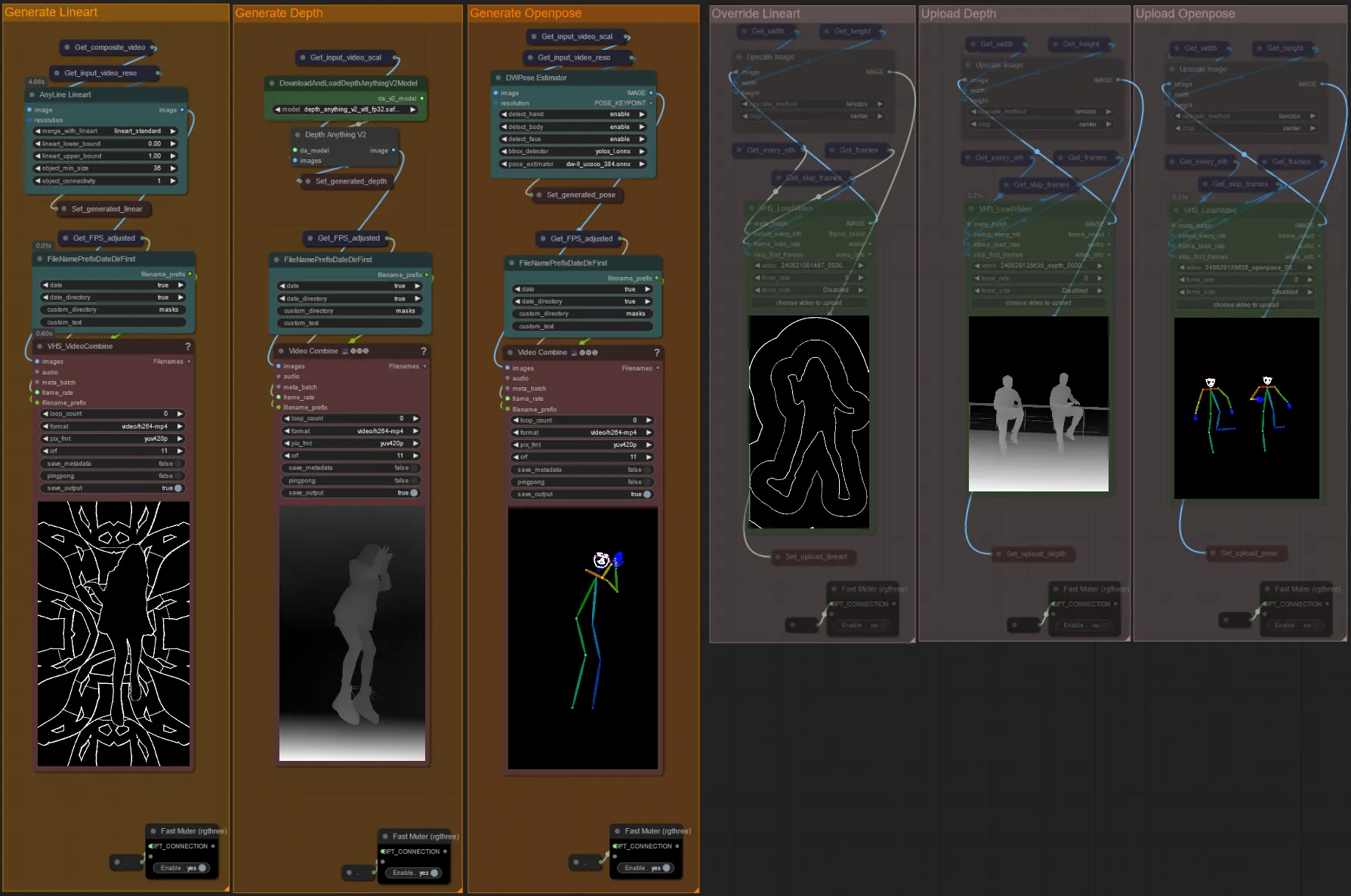

ControlNet

- Этот рабочий процесс использует 5 различных controlnets, включая AD, Lineart, QR Code, Depth и OpenPose.

- Все входные данные для controlnets генерируются автоматически

- Вы можете выбрать переопределение входного видео для controlnets Lineart, Depth и Openpose, если хотите, отключив группы "Override ", как показано ниже:

- Рекомендуется также отключить группы "Generate", если выполняется переопределение, чтобы сэкономить время обработки.

Совет:

- Обойдите Ksampler и начните рендеринг с вашего полного входного видео. Как только все предварительные видеоматериалы будут сгенерированы, сохраните их и загрузите в соответствующие переопределения. С этого момента, тестируя рабочий процесс, вам не придется ждать, пока каждое предварительное видео будет сгенерировано индивидуально.

Самплер

- По умолчанию группа HiRes Fix sampler будет отключена, чтобы сэкономить время обработки при тестировании

- Я рекомендую обойти группу Sampler также при попытке экспериментировать с настройками масок расширения, чтобы сэкономить время.

- При окончательных рендерах вы можете включить группу HiRes Fix, которая будет увеличивать масштаб и добавлять детали в конечный результат.

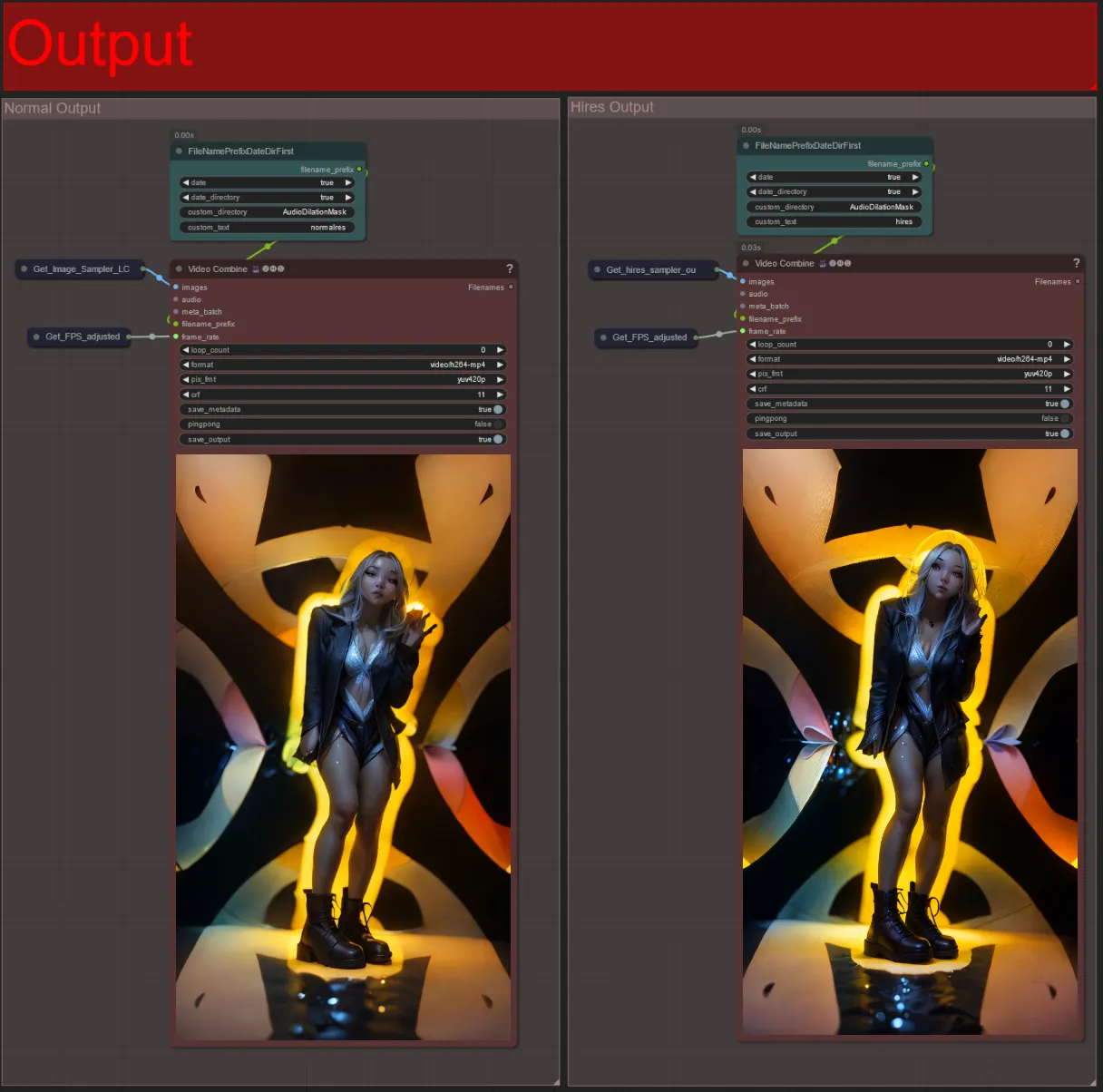

Вывод

- Существует две группы вывода: левая для стандартного вывода самплера, и правая для вывода самплера HiRes Fix.

- Вы можете изменить, где будут сохранены файлы, изменив строку "custom_directory" в узлах "FileNamePrefixDateDirFirst". По умолчанию этот узел будет сохранять выходные видео в каталоге с отметкой времени в каталоге "output" ComfyUI

- например,

…/ComfyUI/output/240812/<custom_directory>/<my_video>.mp4

- например,

Создание аудиореактивного видео может добавить захjson ватывающую, пульсирующую энергию вашему объекту, с каждым кадром, реагирующим на ритм в реальном времени. Поэтому погрузитесь в мир аудиореактивного искусства и наслаждайтесь трансформациями, ведомыми ритмом!

Об авторе

Akatz AI:

- Вебсайт:

Контакты:

- Email: akatzfey@sendysoftware.com