CogVideoX Tora | Модель преобразования изображения в видео

CogVideoX Tora сочетает в себе сильные стороны диффузионных моделей и трансформеров, явно моделируя траектории движения, что позволяет точно контролировать движения и динамику объектов в генерации видео. Этот подход, ориентированный на траектории, улучшает временную согласованность и визуальную достоверность, делая Tora значительным достижением для таких задач, как редактирование видео, синтез и анимация. Используйте рабочий процесс CogVideoX Tora для создания динамических видео и достижения плавных переходов и движения в анимированных сценах.ComfyUI CogVideoX Tora Рабочий процесс

- Полностью функциональные рабочие процессы

- Нет недостающих узлов или моделей

- Не требуется ручная настройка

- Отличается потрясающей визуализацией

ComfyUI CogVideoX Tora Примеры

ComfyUI CogVideoX Tora Описание

Узлы и связанный с ними рабочий процесс полностью разработаны Kijai. Мы отдаем все должное Kijai за эту инновационную работу. На платформе RunComfy мы просто представляем вклады Kijai в сообщество. Важно отметить, что в настоящее время нет формальной связи или партнерства между RunComfy и Kijai. Мы глубоко ценим работу Kijai!

CogVideoX Tora

Tora представляет новую структуру для создания высококачественных видео, используя руководство на основе траекторий в модели диффузионного трансформера. Сосредотачиваясь на траекториях движения, Tora достигает более реалистичного и временно согласованного синтеза видео. Этот подход устраняет разрыв между пространственно-временным моделированием и генеративными диффузионными структурами.

Обратите внимание, что эта версия Tora основана на модели CogVideoX-5B и предназначена только для академических исследований. Для получения информации о лицензировании, пожалуйста, обратитесь .

1.1 Как использовать рабочий процесс CogVideoX Tora?

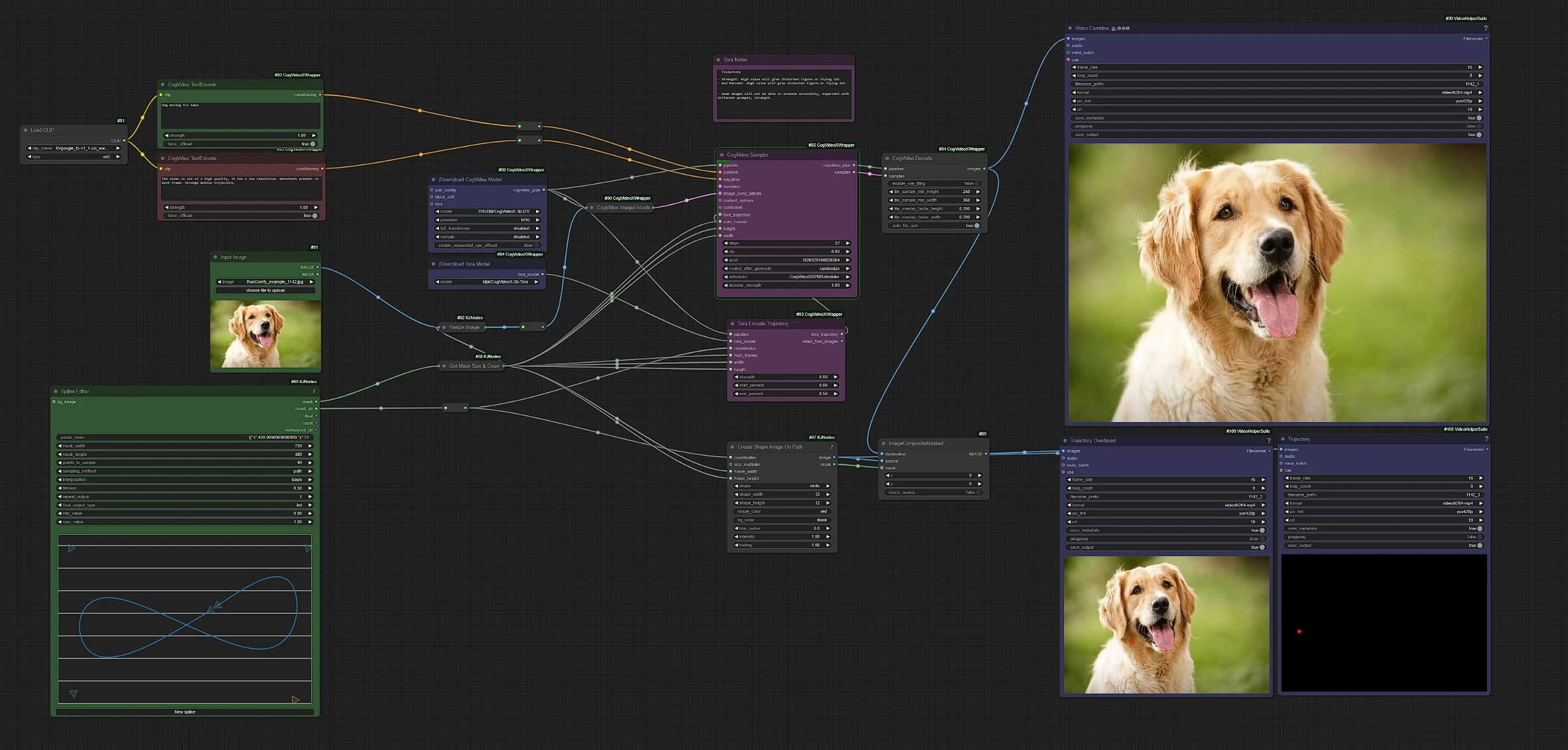

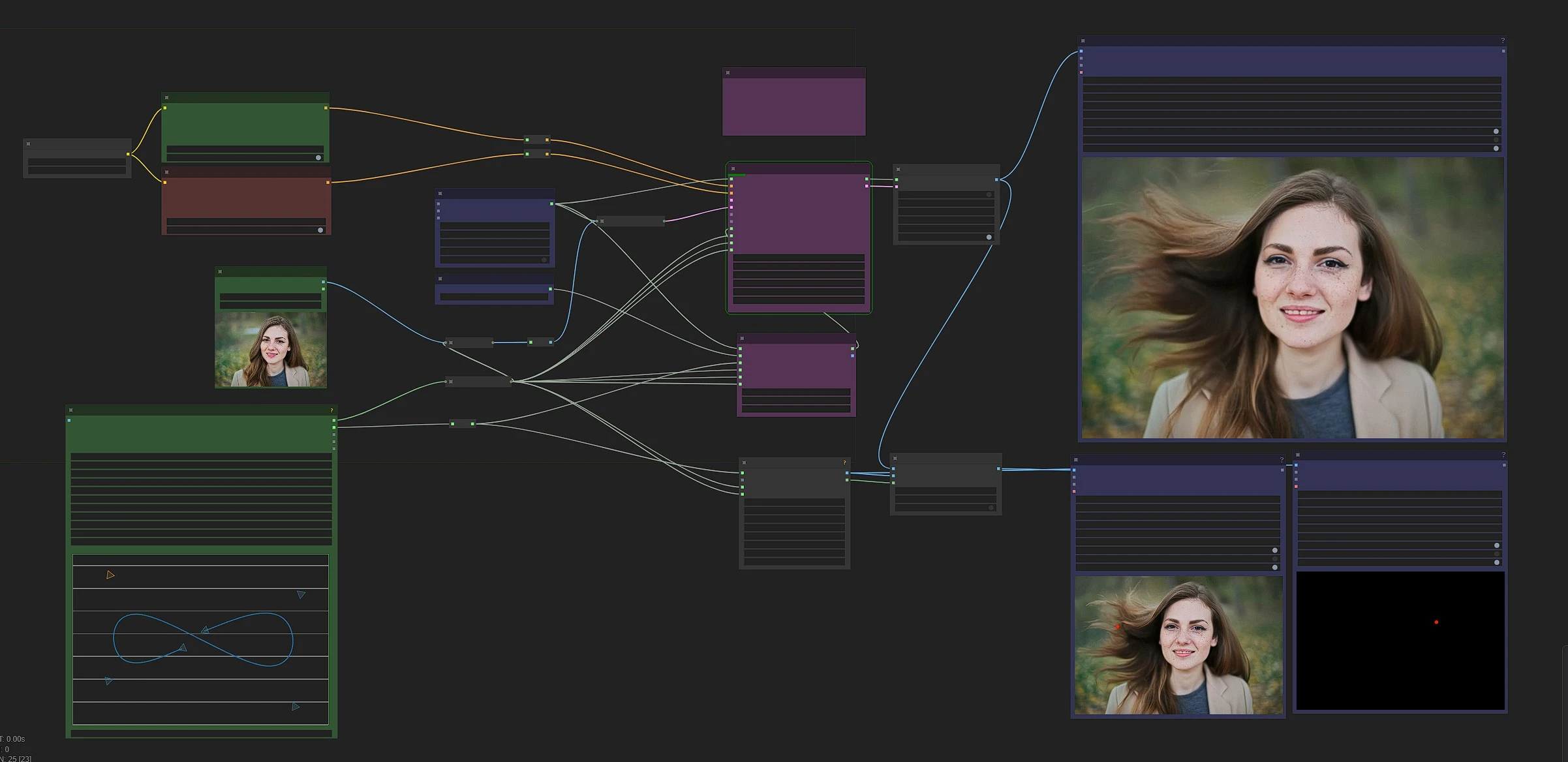

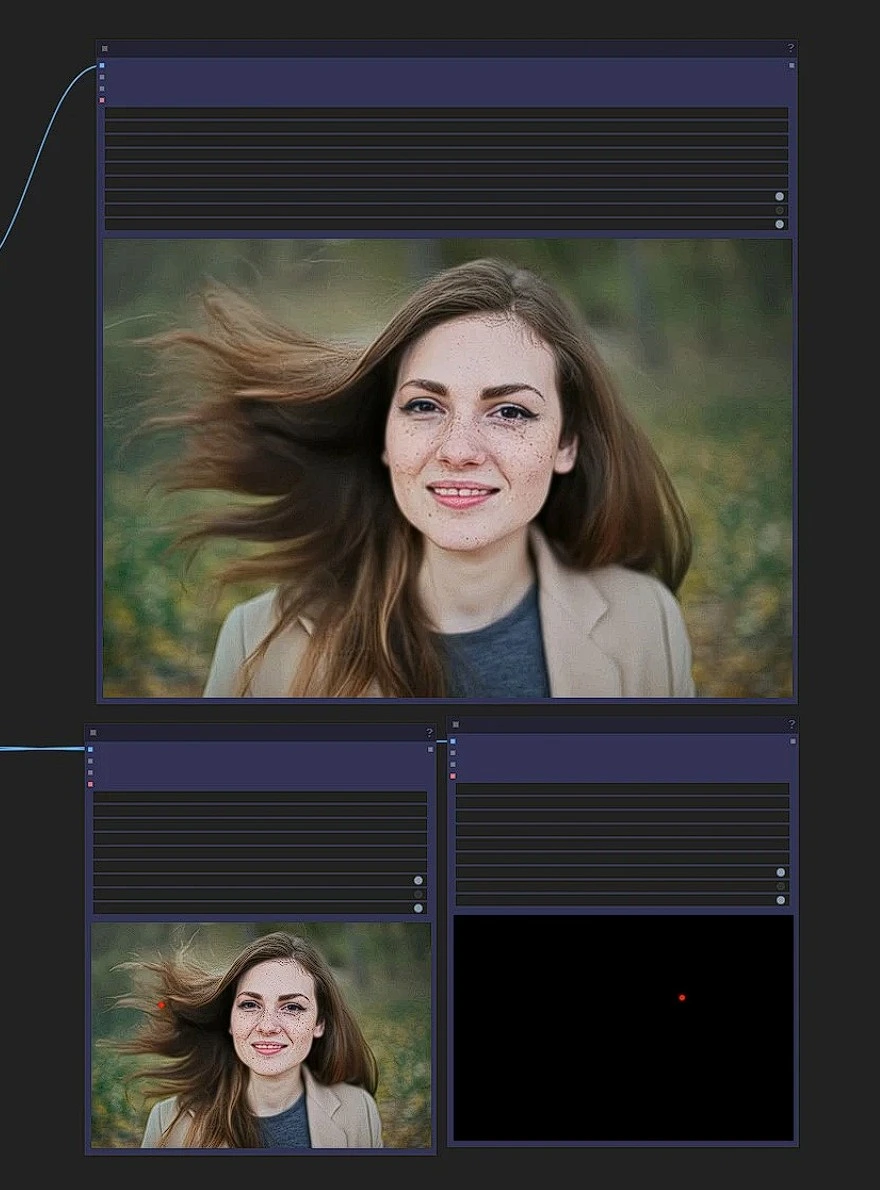

Это рабочий процесс CogVideoX Tora, узлы с левой стороны - это входные данные, в середине - узлы обработки tora, а справа - выходные узлы.

- Перетащите ваше горизонтальное изображение в узел ввода.

- Напишите ваши подсказки действий

- Создайте путь траектории

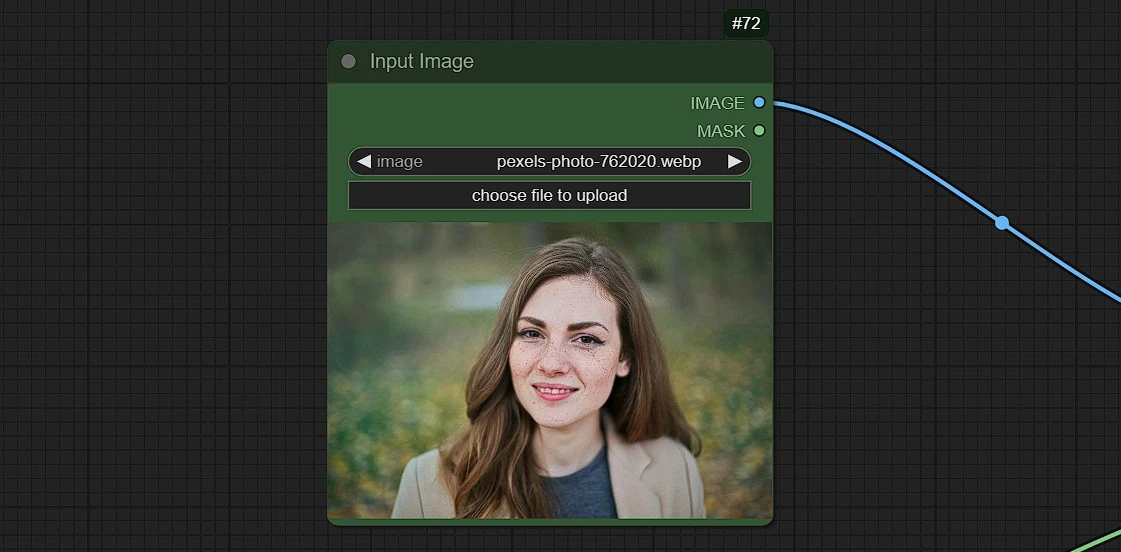

1.2 Загрузите входное изображение

- Загрузите, перетащите или скопируйте и вставьте (Ctrl+V) ваше изображение в узел загрузки изображения

[!CAUTION] Работают только изображения в горизонтальном формате с размерами - 720*480. Другие размеры вызовут ошибку.

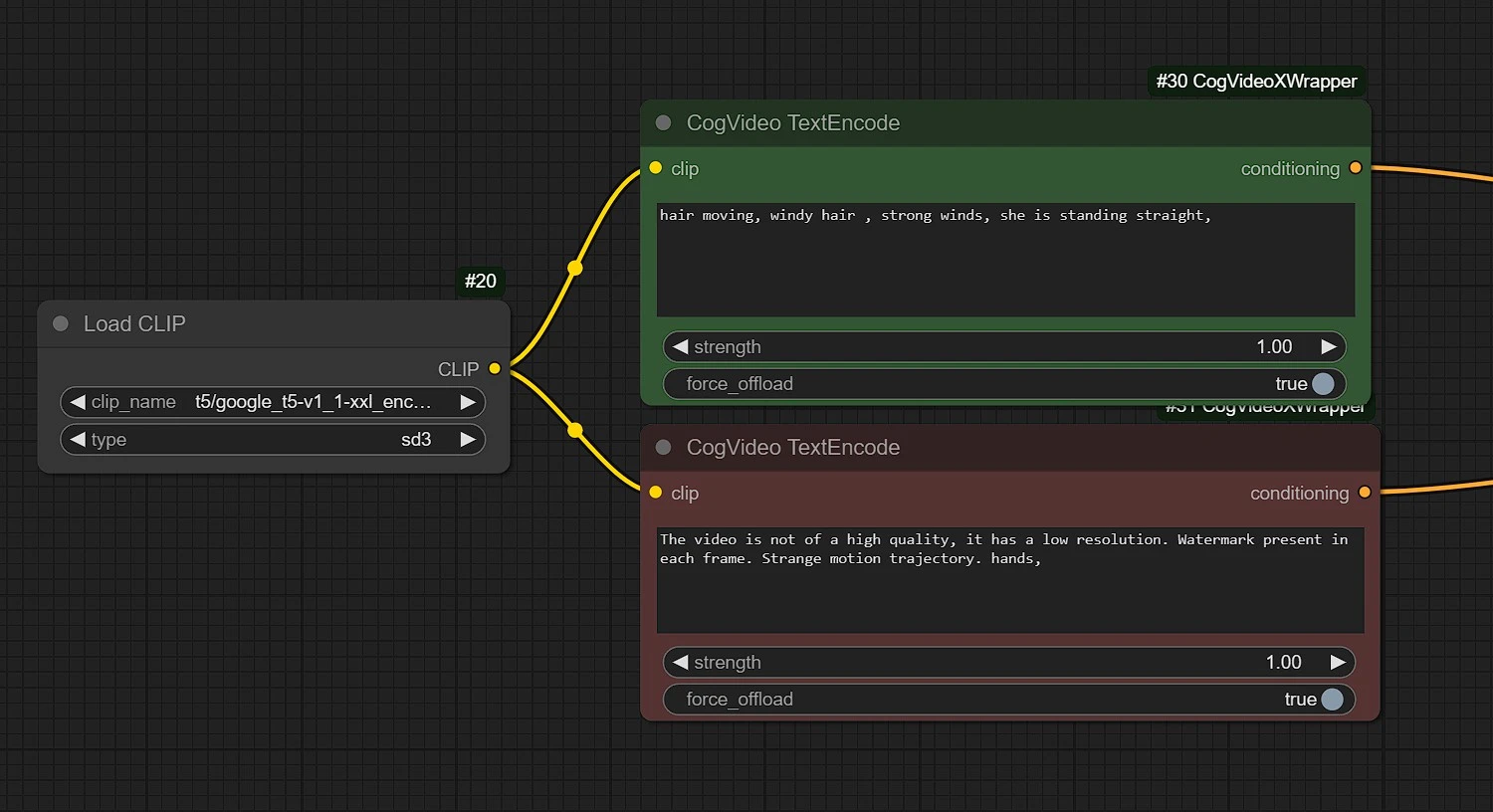

1.3 Добавьте ваши положительные и отрицательные подсказки

Положительные: Введите действия, происходящие с объектом на основе траектории, определенной в узле траектории (движение, течение и т.д.).Отрицательные: Введите то, чего вы не хотите (искаженные руки, размытость и т.д.)

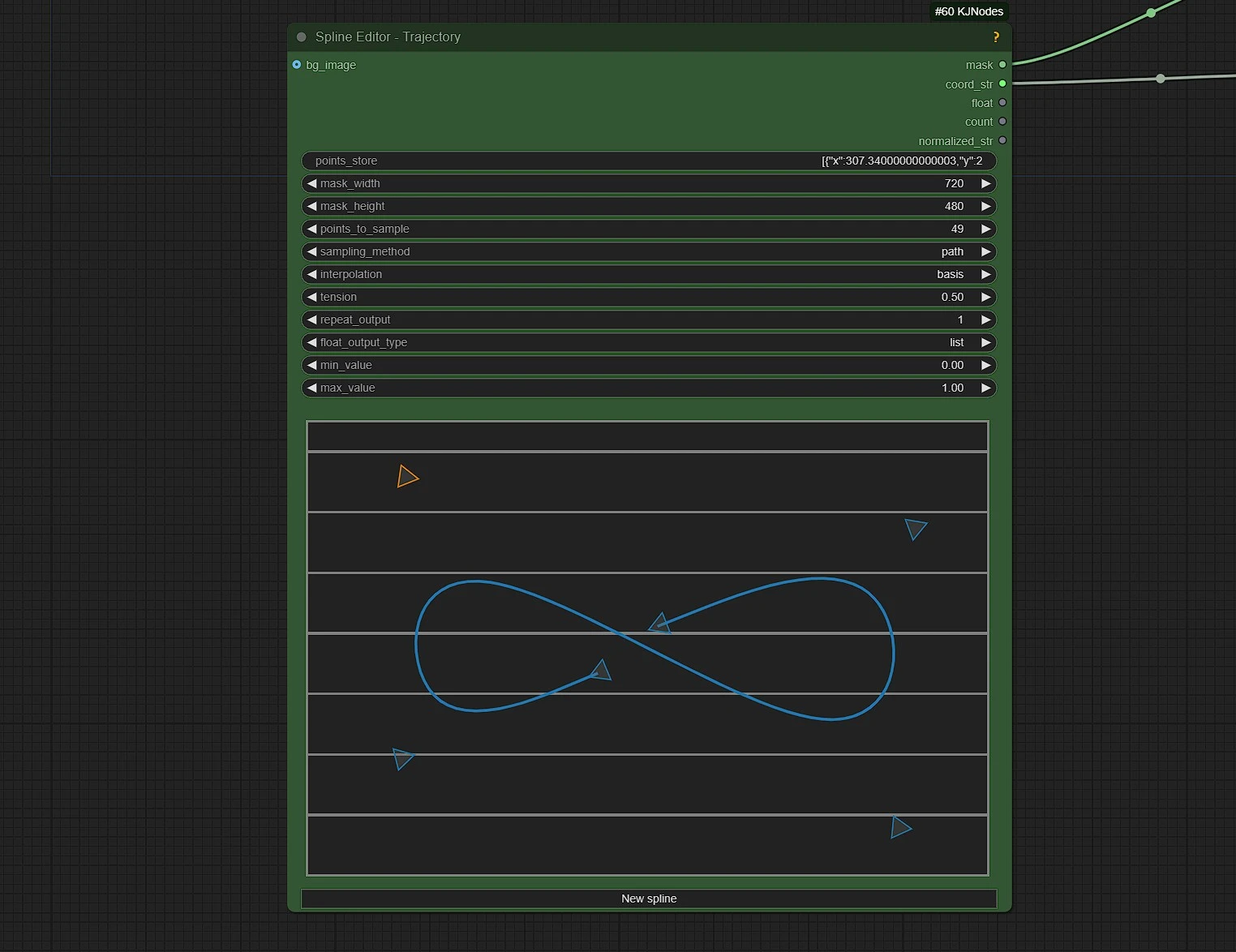

1.4 Создание траектории для движения

Здесь вы устанавливаете путь траектории движения объекта на загруженной фотографии.

points_to_sample: Это задает количество кадров для рендеринга или продолжительность вашего видео в кадрах.mask_width: По умолчанию 720. НЕ ИЗМЕНЯЙТЕ!mask_height: По умолчанию 480. НЕ ИЗМЕНЯЙТЕ!

Руководство по узлам:

- Shift + щелчок для добавления контрольной точки в конце. Ctrl + щелчок для добавления контрольной точки (подразделения) между двумя точками.

- Щелкните правой кнопкой мыши на точке, чтобы удалить ее.

- Обратите внимание, что вы не можете удалить с начала/конца.

- Щелкните правой кнопкой мыши на холсте для контекстного меню:

- Это чисто визуальные настройки, не влияющие на вывод:

Переключение видимости ручек

- Отображение точек выборки: отображает точки, которые будут возвращены.

- Значение points_to_sample устанавливает количество выборок

- возвращаемых с нарисованного сплайна, это не зависит от

- фактических контрольных точек, поэтому тип интерполяции имеет значение.

Метод выборки:

- время: выборка вдоль временной оси, используется для расписаний

- путь: выборка вдоль самого пути, полезна для координат

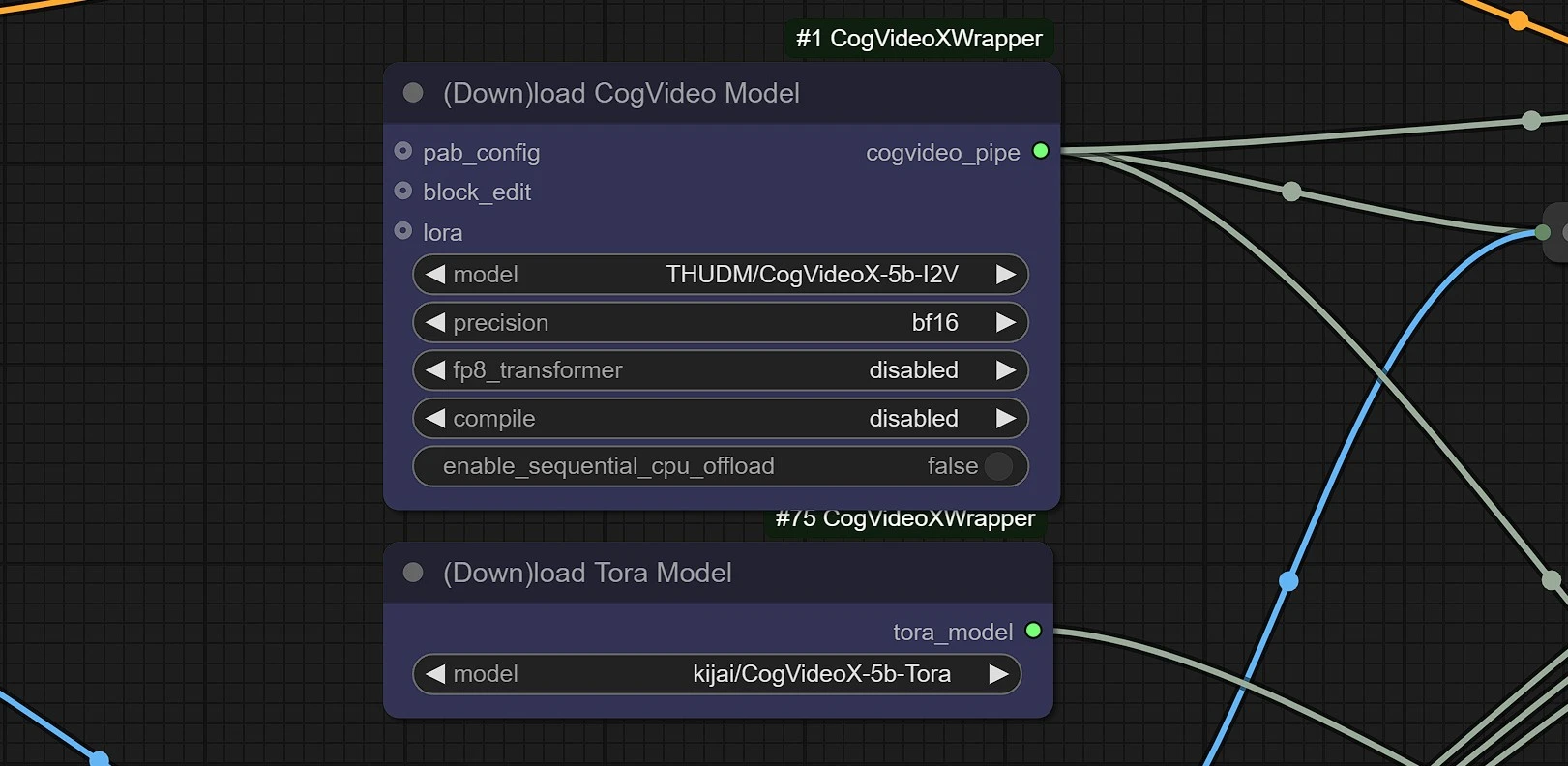

1.5 Загрузите модели CogVideoX & Tora

Это узлы загрузки моделей, они автоматически загрузят модели в ваш comfyui за 2-3 минуты.

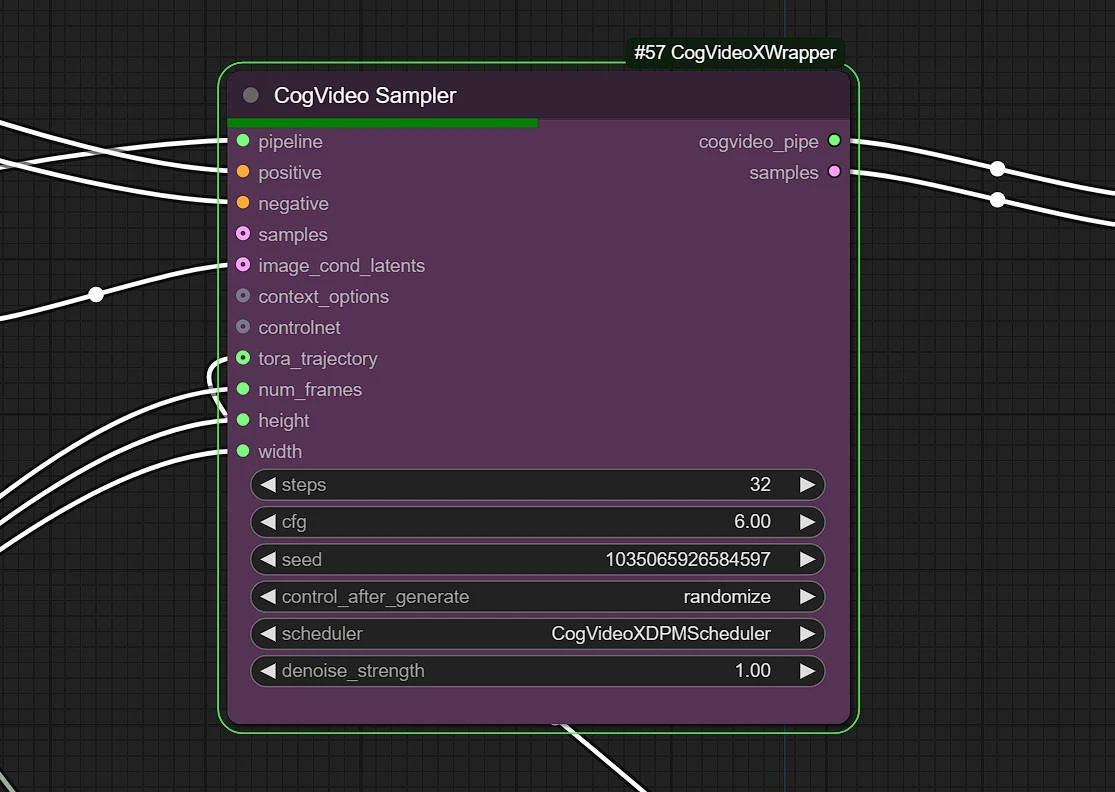

1.6 Образец CogVideo

Шаги: Это значение определяет качество вашего рендера. Держите между 25 - 35 для наилучшего и эффективного значения.cfg: Значение по умолчанию 6.0 для выборки CogVideo.denoising strengthиScheduler: Не изменяйте это.

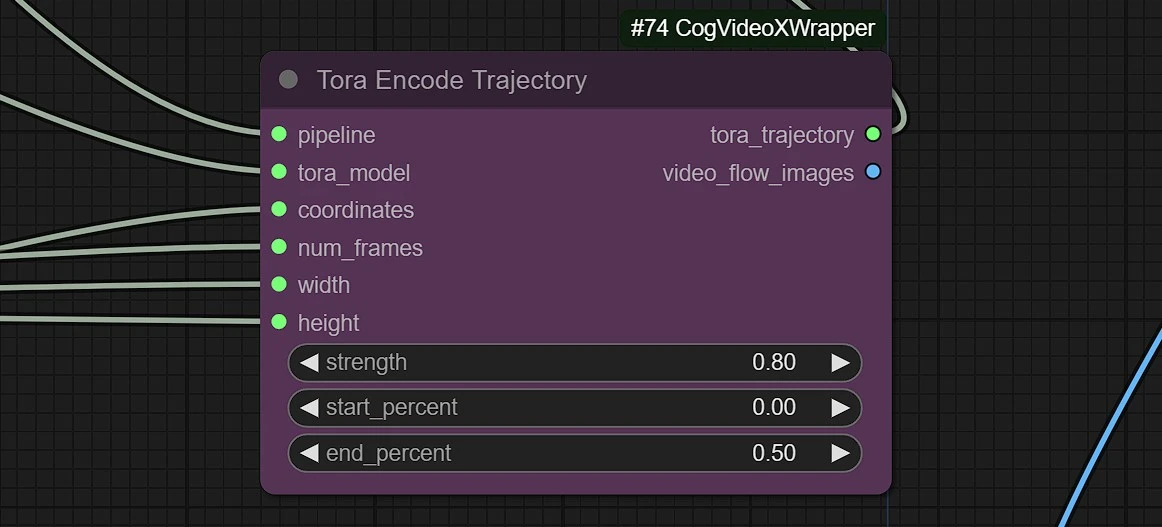

1.7 Вес и сила траектории

Этот узел установит силу вашей траектории движения.

strength: Высокое значение даст искаженные фигуры или летающие точки. Используйте между 0.5 - 0.9.start_percent: Используйте это значение, чтобы смягчить эффект силы движения.end_percent: - Высокое значение даст искаженные фигуры или летающие точки. Используйте между 0.3 - 0.7

1.8 Выходы

Эти узлы дадут вам 3 выхода.

- Выходное отрендеренное видео

- Путь траектории наложен на отрендеренное видео

- Видео с траекторией на черном фоне

"CogVideoX Tora: Трансформер диффузии, ориентированный на траекторию, для генерации видео" представляет инновационный подход к генерации видео, вводя руководство на основе траектории в рамках диффузионного трансформера. В отличие от традиционных моделей синтеза видео, которые борются за поддержание временной согласованности и реалистичного движения, CogVideoX Tora явно фокусируется на моделировании траекторий движения. Это позволяет системе генерировать согласованные и визуально убедительные видео, понимая, как объекты и элементы развиваются с течением времени. Объединяя мощь диффузионных моделей, известных своим высоким качеством генерации изображений, с временными рассуждениями трансформеров, CogVideoX Tora устраняет разрыв между пространственным и временным моделированием.

Механизм, ориентированный на траектории, CogVideoX Tora обеспечивает детализированный контроль над движениями объектов и динамическими взаимодействиями, что делает его особенно подходящим для приложений, требующих точного руководства по движению, таких как редактирование видео, анимация и создание спецэффектов. Способность модели поддерживать временную согласованность и реалистичные переходы увеличивает ее применимость в создании плавного и согласованного видео контента. Интегрируя траекторные приоритеты, CogVideoX Tora не только улучшает динамику движения, но и снижает артефакты, часто наблюдаемые в генерации на основе кадров. Этот прорыв устанавливает новый стандарт для синтеза видео, предлагая мощный инструмент для создателей и разработчиков в таких областях, как кинематограф, виртуальная реальность и видео-ориентированный ИИ.