Este flujo de trabajo de Personajes Consistentes con Flux fue creado por . Recomendamos encarecidamente ver su tutorial detallado para aprender a usar eficazmente este poderoso flujo de trabajo de Personajes Consistentes. Aunque hemos reproducido el flujo de trabajo de Personajes Consistentes y configurado el entorno para su conveniencia, todo el crédito va para Mickmumpitz por su excelente trabajo en desarrollar esta solución de Personajes Consistentes basada en Flux.

Los Personajes Consistentes con Flux

El flujo de trabajo de Personajes Consistentes con Flux es una poderosa herramienta de ComfyUI que mantiene la consistencia de personajes generados por IA en múltiples salidas. Es ideal para crear películas cinematográficas de IA, libros para niños o cualquier proyecto que requiera apariencias estables de Personajes Consistentes. Este flujo de trabajo basado en Flux simplifica el proceso de lograr apariencias uniformes de Personajes Consistentes, reduciendo la necesidad de múltiples indicaciones y ajustes finos. Al utilizar el modelo de desarrollo Flux.1, mejora la estabilidad de los Personajes Consistentes generados, asegurando que mantengan la misma apariencia y sensación, ya sea animados o renderizados de manera realista.

¿Cómo usar el flujo de trabajo de Personajes Consistentes con Flux?

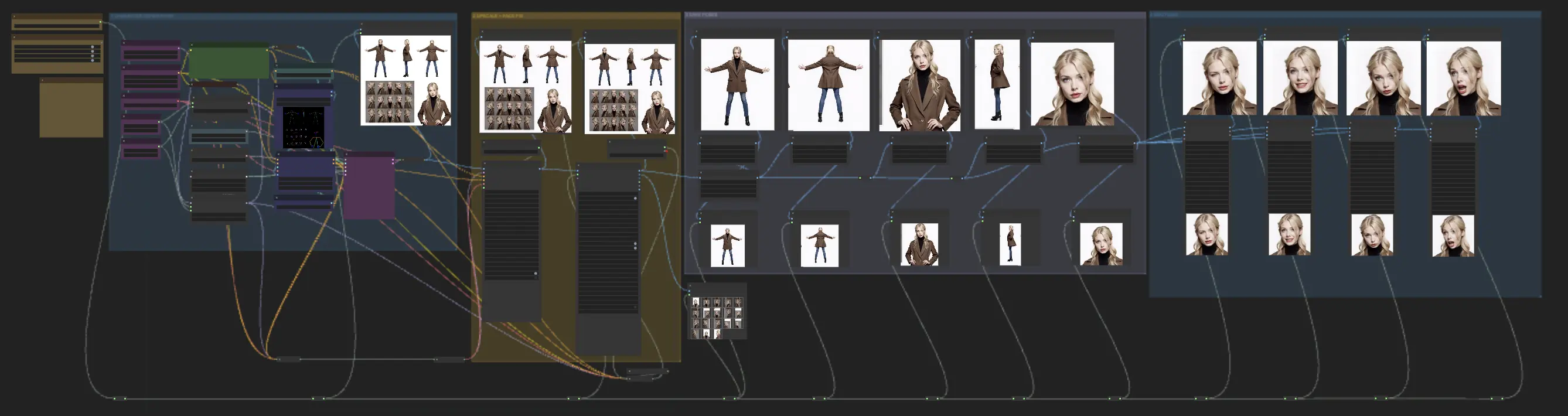

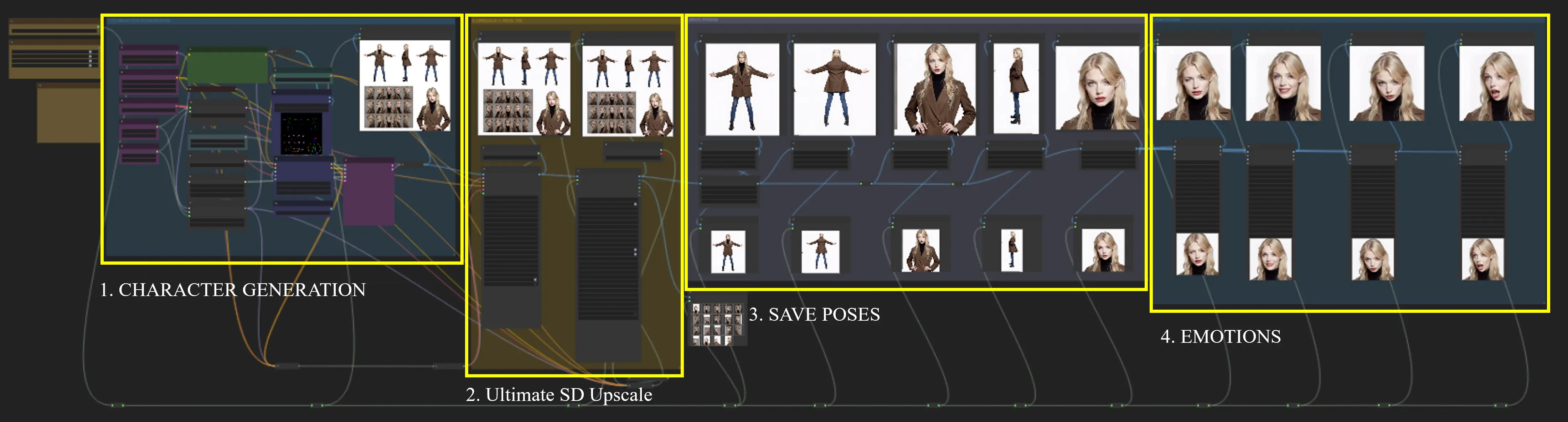

El flujo de trabajo de Personajes Consistentes con Flux se divide en cuatro módulos (Generación de Personajes, Aumento + Corrección de Rostro, Poses, Emociones), cada uno diseñado para optimizar el proceso de generación de Personajes Consistentes con una apariencia uniforme en múltiples salidas.

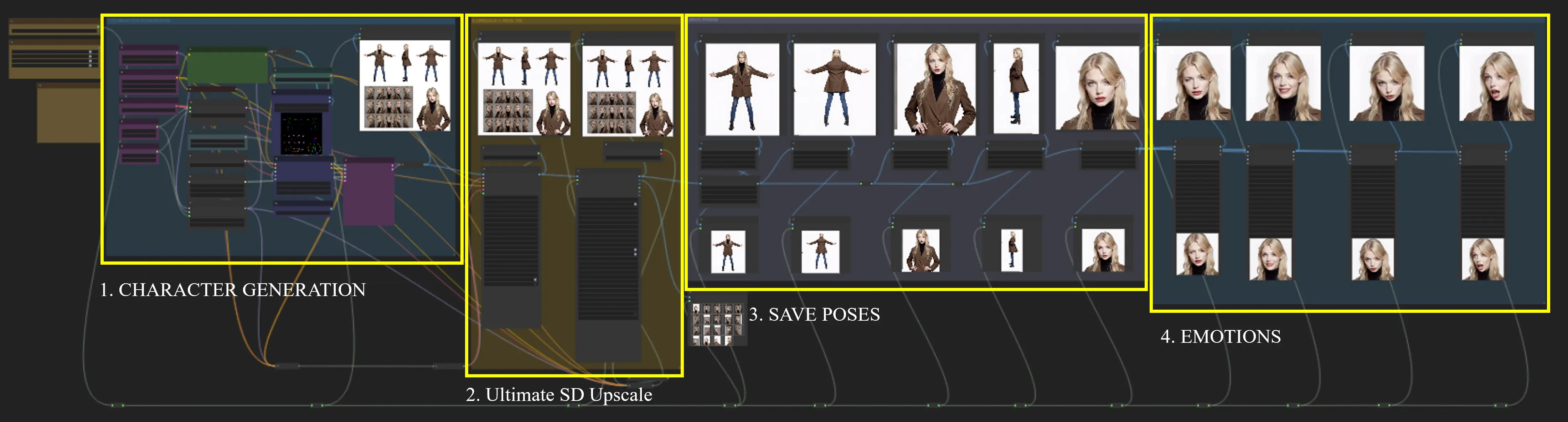

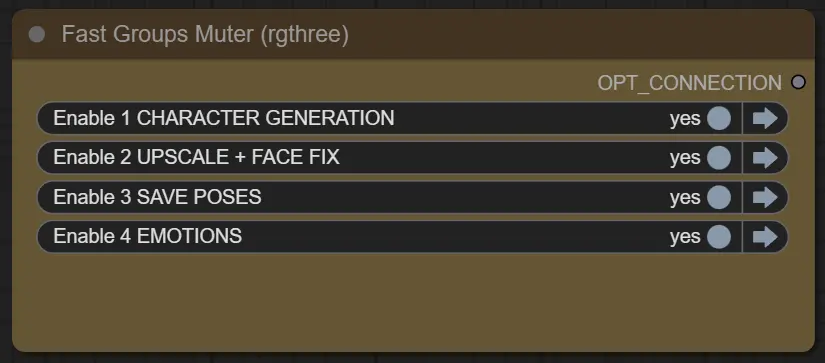

Nodo Fast Groups Muter (rgthree)

Después de cargar el nodo Fast Groups Muter (rgthree), los módulos 2, 3 y 4 se ejecutan automáticamente, y no se requiere configuración adicional. Este nodo controla los interruptores de los cuatro módulos, haciendo que el proceso de Personajes Consistentes sea más fluido y eficiente.

Control de módulo de nodo Fast Groups Muter (rgthree) (sí/no).

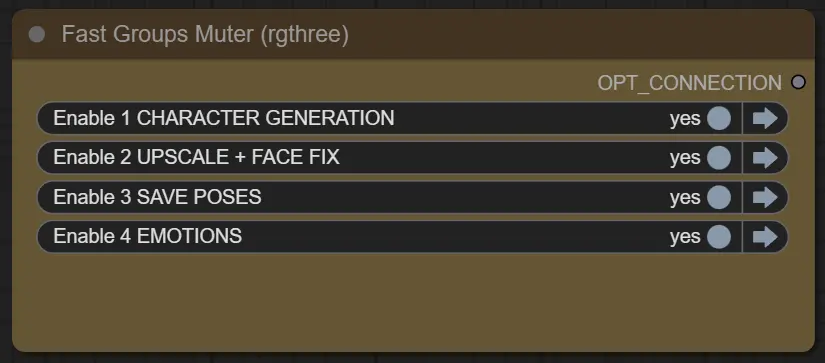

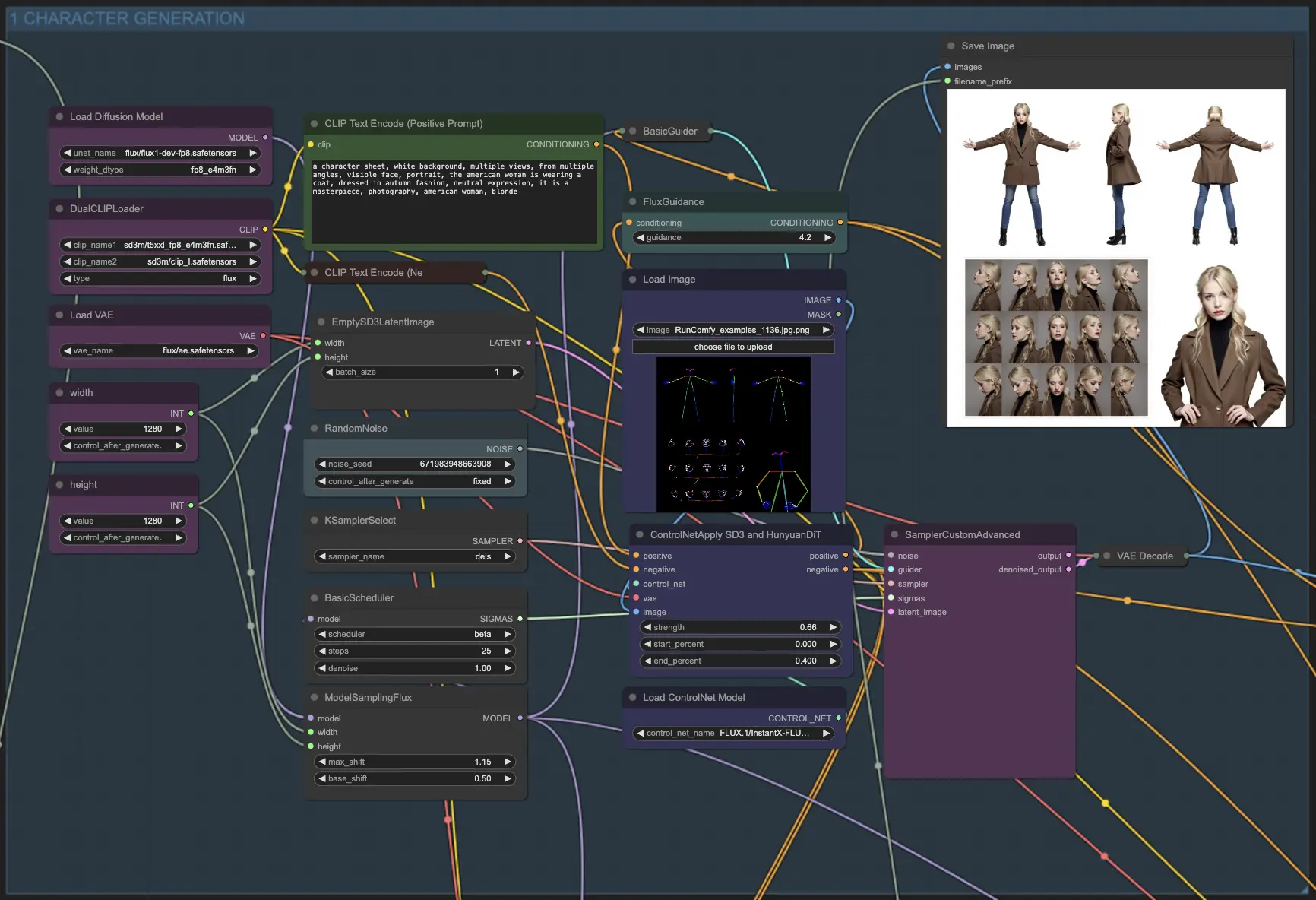

1. Generación de Personajes

Este módulo utiliza los modelos Flux y el modelo Flux ControlNet para generar una tabla de Personajes Consistentes guiando el proceso de generación con indicaciones. La entrada, que es una hoja de poses, sirve como referencia para dirigir la generación de Personajes Consistentes. Al elaborar indicaciones apropiadas, puede guiar el modelo para crear las hojas de Personajes Consistentes deseadas.

Aquí hay algunos ejemplos de indicaciones:

Una hoja de personaje con una mujer americana con un abrigo, vestida a la moda de otoño, con una expresión neutral. La hoja debe tener un fondo blanco, múltiples vistas desde varios ángulos y un retrato visible del rostro. El estilo general debe parecerse a una fotografía de obra maestra.

Una hoja de personaje que representa a una guardabosques elfa con una capa hecha de hojas de otoño, vestida con colores del bosque, con una expresión decidida. La hoja debe tener un fondo de pergamino, múltiples vistas desde diferentes ángulos y un retrato visible del rostro. La guardabosques debe estar acompañada por un majestuoso ciervo, llevando un arco largo y un carcaj en su espalda. El estilo general debe parecerse a una pintura digital de obra maestra de una elfa femenina con largo cabello dorado.

Consejo: Si la hoja de Personajes Consistentes generada no cumple con sus expectativas, intente ajustar el valor de semilla para regenerar la salida con variaciones.

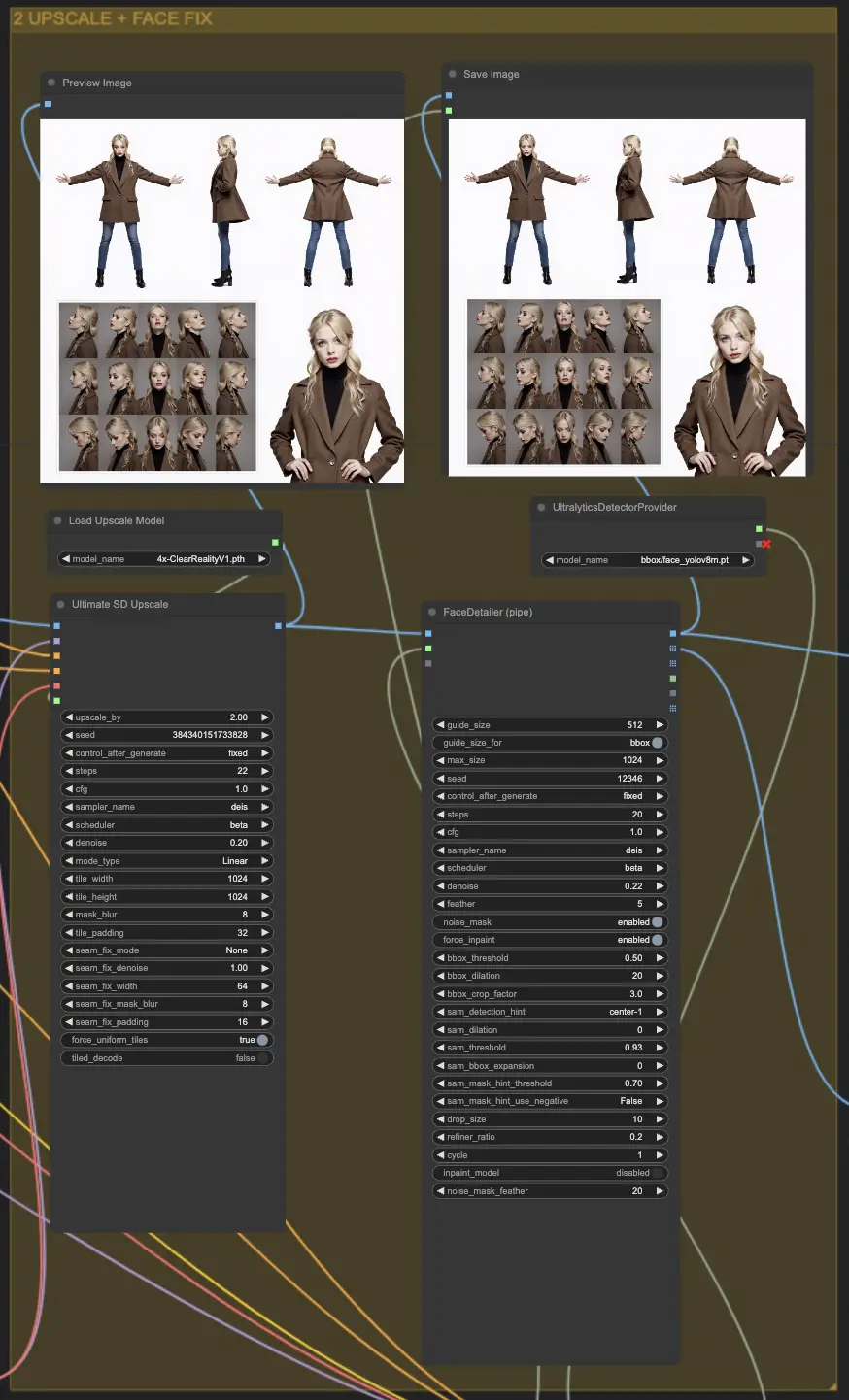

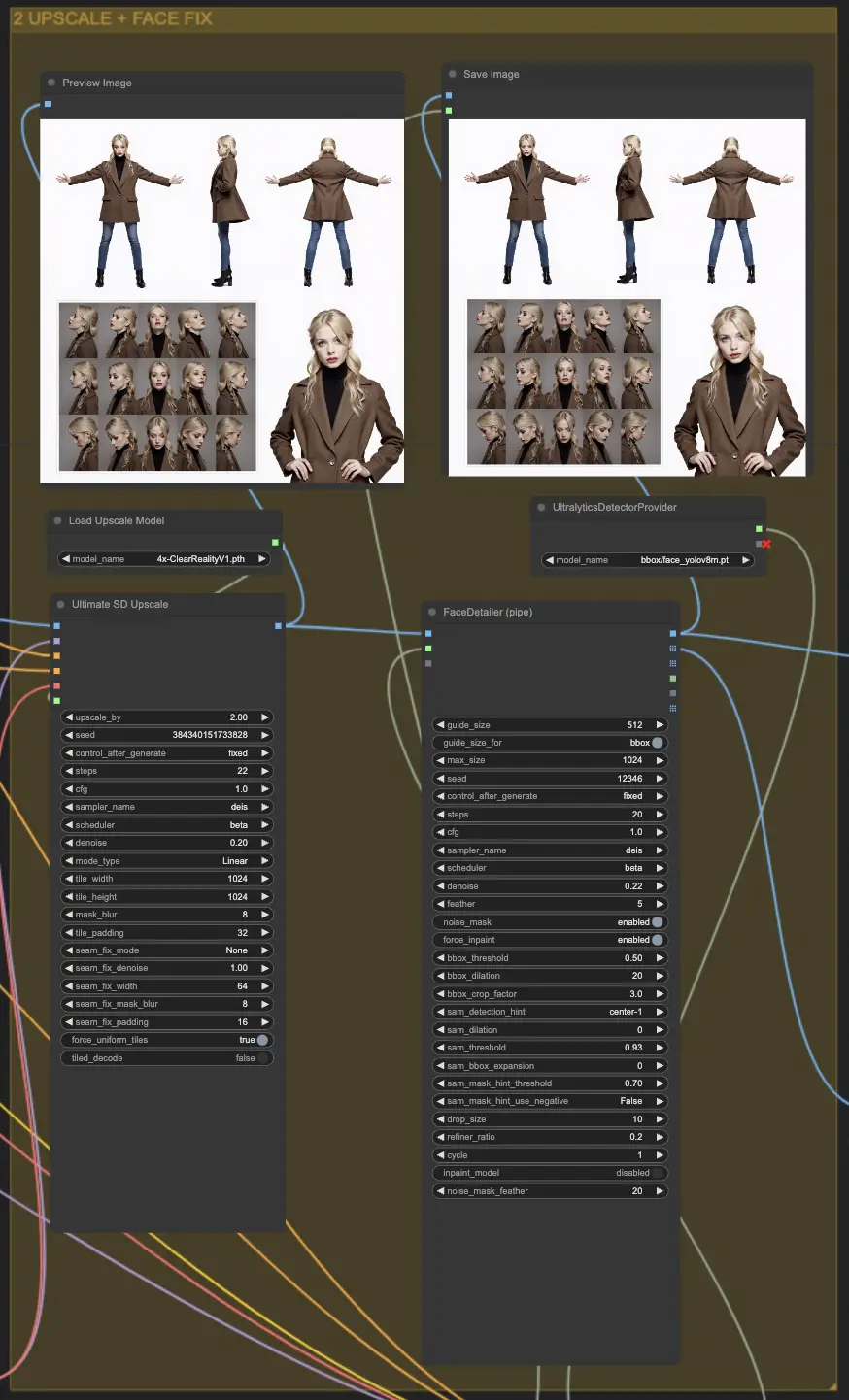

2. Aumento + Corrección de Rostro

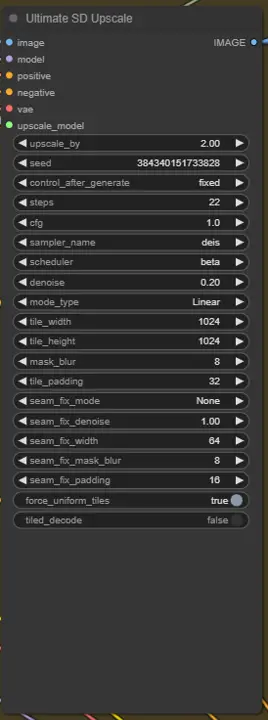

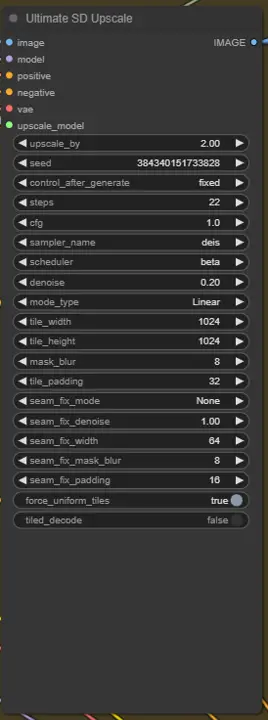

2.1 Aumento SD Definitivo

El Aumento SD Definitivo es un nodo utilizado en los flujos de generación de imágenes para mejorar la resolución de la imagen dividiendo la imagen en mosaicos más pequeños, procesando cada mosaico individualmente y luego uniéndolos nuevamente. Este proceso permite la generación de imágenes de alta resolución mientras se gestiona el uso de memoria y se reducen los artefactos que pueden ocurrir al aumentar la escala.

Parámetros:

upscale_by: El factor por el cual se multiplican el ancho y la altura de la imagen. Para dimensiones precisas, use la versión "Sin Aumento".seed: Controla la aleatoriedad en el proceso de generación. Usar la misma semilla produce los mismos resultados.control_after_generate: Ajusta los detalles de la imagen después de la generación.steps: El número de iteraciones durante la generación de la imagen. Más pasos resultan en detalles más finos pero un tiempo de procesamiento más largo.cfg: Escala de Guía Libre de Clasificación que ajusta qué tan estrictamente el modelo sigue las indicaciones de entrada.sampler_name: Especifica el método de muestreo utilizado para la generación de imágenes.scheduler: Define cómo se asignan los recursos de cómputo durante la generación.denoise: Controla el nivel de eliminación de ruido, influyendo en la retención de detalles de la imagen original. Recomendado: 0.35 para mejora, 0.15-0.20 para cambios mínimos.mode_type: Determina el modo de procesamiento, como cómo se procesan los mosaicos.tile_width y tile_height: Dimensiones de los mosaicos utilizados en el procesamiento. Los tamaños más grandes reducen las costuras pero requieren más memoria.mask_blur: Desenfoca los bordes de las máscaras utilizadas para la mezcla de mosaicos, suavizando las transiciones entre mosaicos.tile_padding: Número de píxeles de mosaicos vecinos considerados durante el procesamiento para reducir costuras.seam_fix_mode: Método para corregir costuras visibles entre mosaicos:

- Pase de bandas: Corrige costuras a lo largo de filas y columnas.

- Pase de desplazamiento de media baldosa: Aplica un desplazamiento para mezclar mejor las costuras.

- Pase de desplazamiento de media baldosa + intersecciones: Incluye pases adicionales en intersecciones.

seam_fix_denoise: Fuerza de la reducción de ruido durante la corrección de costuras.seam_fix_width: Ancho de las áreas procesadas durante la corrección de costuras.seam_fix_mask_blur: Desenfoca la máscara para correcciones de costuras más suaves.seam_fix_padding: Relleno alrededor de costuras durante la corrección para asegurar resultados más suaves.force_uniform_tiles: Asegura que los mosaicos mantengan un tamaño uniforme extendiendo los mosaicos de borde cuando sea necesario, minimizando artefactos.tiled_decode: Procesa los mosaicos de imagen individualmente para reducir el uso de memoria durante la generación de alta resolución.- Tipo de tamaño objetivo: Determina cómo se establece el tamaño final de la imagen:

- Desde configuraciones img2img: Utiliza ancho y alto predeterminados.

- Tamaño personalizado: Permite configurar manualmente el ancho y el alto (máximo 8192px).

- Escalar desde tamaño de imagen: Escala según el tamaño inicial de la imagen.

- Aumentador: El método para aumentar la escala de las imágenes antes de un procesamiento adicional (por ejemplo, ESRGAN).

- Redibujar: Controla cómo se redibuja la imagen:

- Lineal: Procesa los mosaicos secuencialmente.

- Ajedrez: Utiliza un patrón de tablero de ajedrez para el procesamiento para reducir artefactos.

- Ninguno: Desactiva el redibujado, centrándose solo en la corrección de costuras.

2.2. FaceDetailer (pipe)

FaceDetailerPipe es un nodo diseñado para mejorar los detalles faciales en imágenes, utilizando técnicas avanzadas de procesamiento de imágenes para mejorar la nitidez y claridad de las características faciales. Es parte del ComfyUI Impact Pack, con el objetivo de proporcionar mejoras de alta calidad en los detalles faciales para varias aplicaciones.

Parámetros:

image: La imagen de entrada a mejorar, que sirve como el sujeto principal para el detallado facial.guide_size: Un parámetro que controla el tamaño del área de guía utilizada para mejorar las características faciales, influyendo en cuánta cantidad de contexto se considera.guide_size_for: Determina si el tamaño de la guía debe aplicarse para regiones específicas.max_size: Establece el límite máximo de tamaño para las imágenes procesadas, asegurando la gestión de memoria.seed: Controla la aleatoriedad en el proceso de mejora de imágenes, permitiendo resultados reproducibles al usar la misma semilla.steps: El número de iteraciones para mejorar los detalles. Más pasos resultan en detalles más finos pero requieren más tiempo de procesamiento.cfg: La escala de Guía Libre de Clasificación, que ajusta qué tan de cerca sigue el modelo la guía de entrada.sampler_name: Define el método de muestreo utilizado para el refinamiento de detalles.scheduler: Determina la estrategia de programación computacional durante el procesamiento.denoise: Controla la fuerza de la reducción de ruido aplicada durante el proceso de mejora. Los valores más bajos retienen más detalles originales, mientras que los valores más altos producen resultados más suaves.feather: Controla la suavidad de la transición entre áreas mejoradas y originales, ayudando a mezclar los cambios de manera uniforme.noise_mask: Habilita o deshabilita el uso de una máscara de ruido para dirigir áreas específicas para la reducción de ruido.force_inpaint: Fuerza la pintura en regiones que necesitan mejoras o correcciones adicionales.bbox_threshold: Establece el umbral para detectar cuadros delimitadores alrededor de características faciales, influyendo en la sensibilidad.bbox_dilation: Expande las áreas de cuadros delimitadores detectadas para asegurar que todas las características relevantes se incluyan durante la mejora.bbox_crop_factor: Ajusta el factor de recorte para cuadros delimitadores detectados, controlando el área de enfoque para la mejora.sam_detection_hint: Especifica sugerencias o guías adicionales para el proceso de detección.sam_dilation: Ajusta la dilatación aplicada a las regiones detectadas, permitiendo una cobertura más amplia.sam_threshold: Define el umbral para la sensibilidad de detección dentro del proceso SAM (Segment Anything Model).sam_bbox_expansion: Expande los cuadros delimitadores detectados por el SAM, ayudando a incluir más contexto circundante.sam_mask_hint_threshold: Ajusta el umbral para las sugerencias de máscara proporcionadas por SAM, controlando cómo se definen las regiones para el enmascaramiento.sam_mask_hint_use_negative: Determina si se deben usar sugerencias negativas, influyendo en el enmascaramiento de ciertas regiones.drop_size: Establece el tamaño de las gotas aplicadas durante el proceso de mejora, lo que puede influir en el nivel de refinamiento.refiner_ratio: Controla la proporción para refinar los detalles faciales, equilibrando entre preservar las características originales y agregar claridad.cycle: Especifica el número de ciclos de refinamiento a aplicar, afectando la profundidad de la mejora.- inpaint_model (Opcional): Habilita el uso de un modelo de pintura para llenar áreas faltantes o poco claras durante el proceso de detallado.

noise_mask_feather: Ajusta el difuminado de la máscara de ruido, proporcionando una transición más suave entre áreas ruidosas y desruidadas.

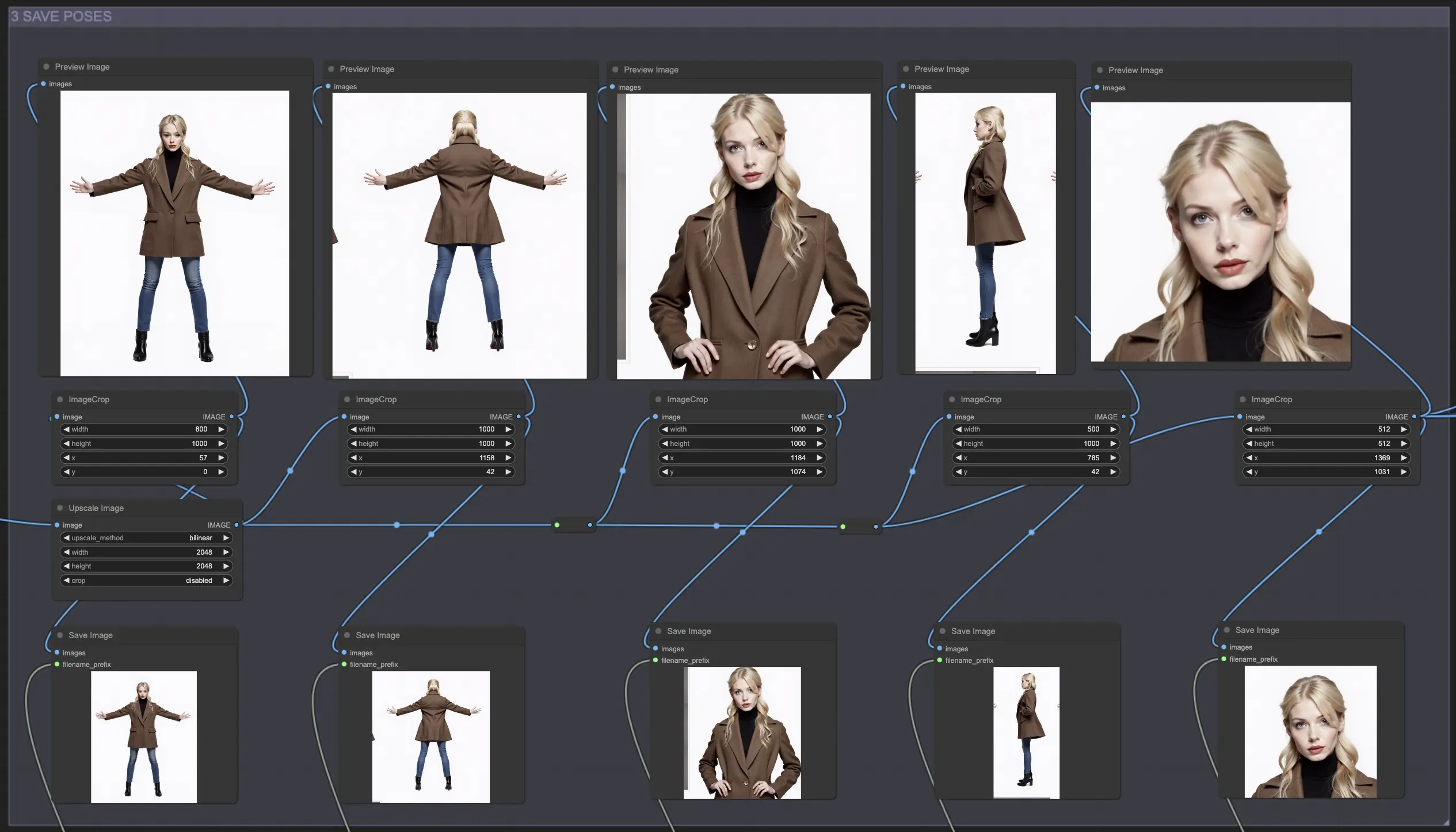

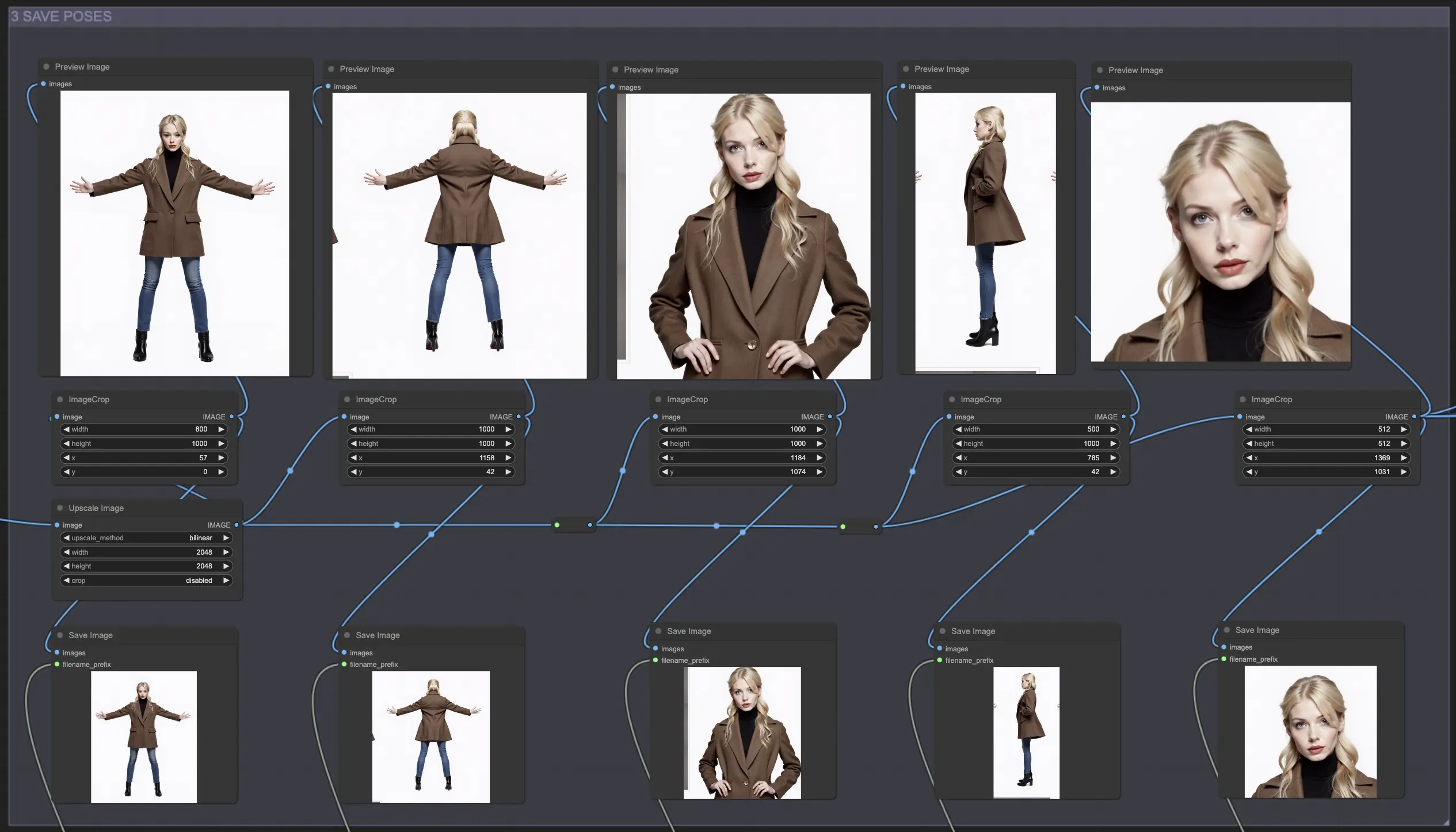

3. Poses

Este módulo le permite usar el nodo de recorte de imagen para separar cada pose de la hoja de personaje generada y guardar poses individuales del personaje para uso o ajustes futuros.

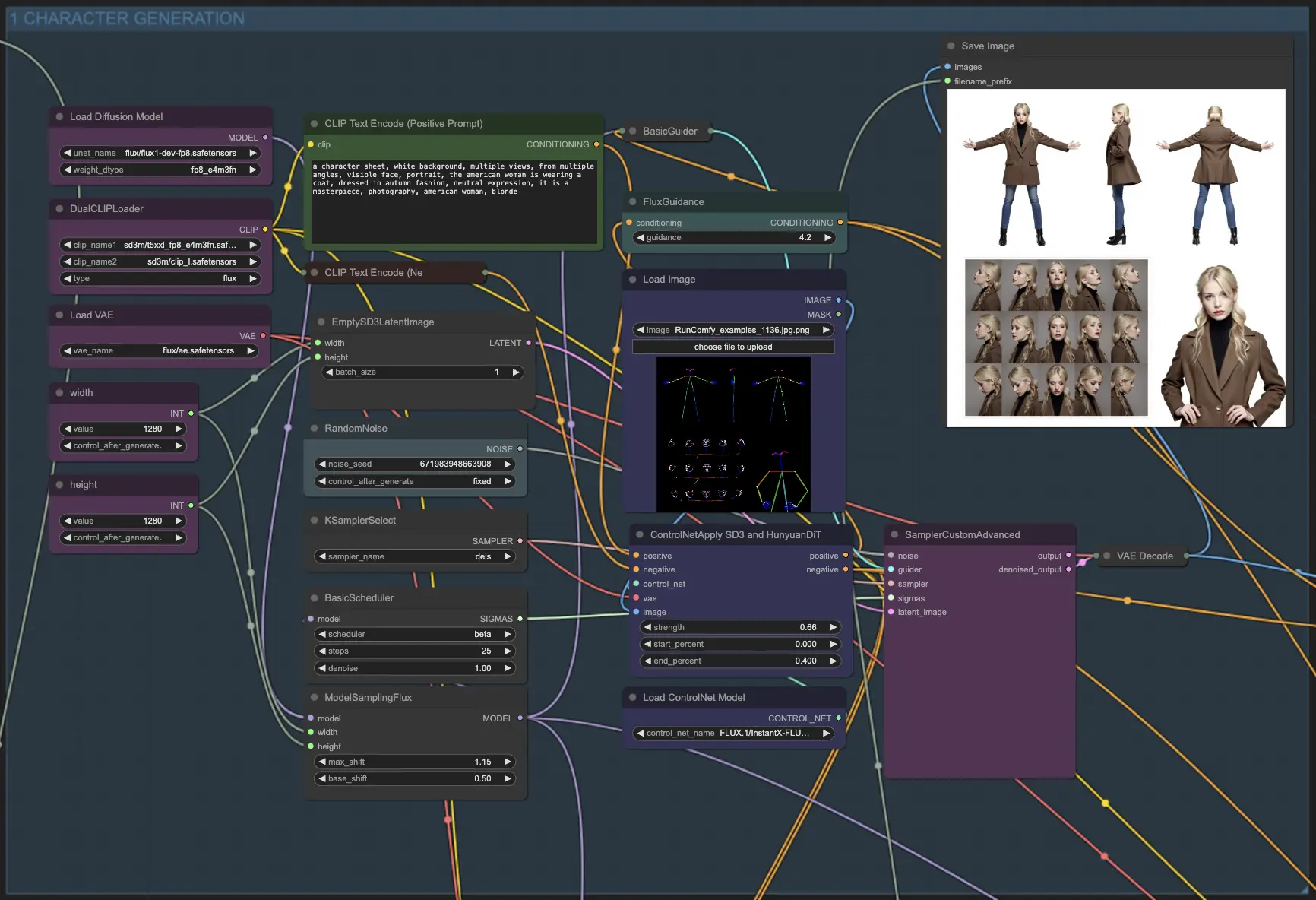

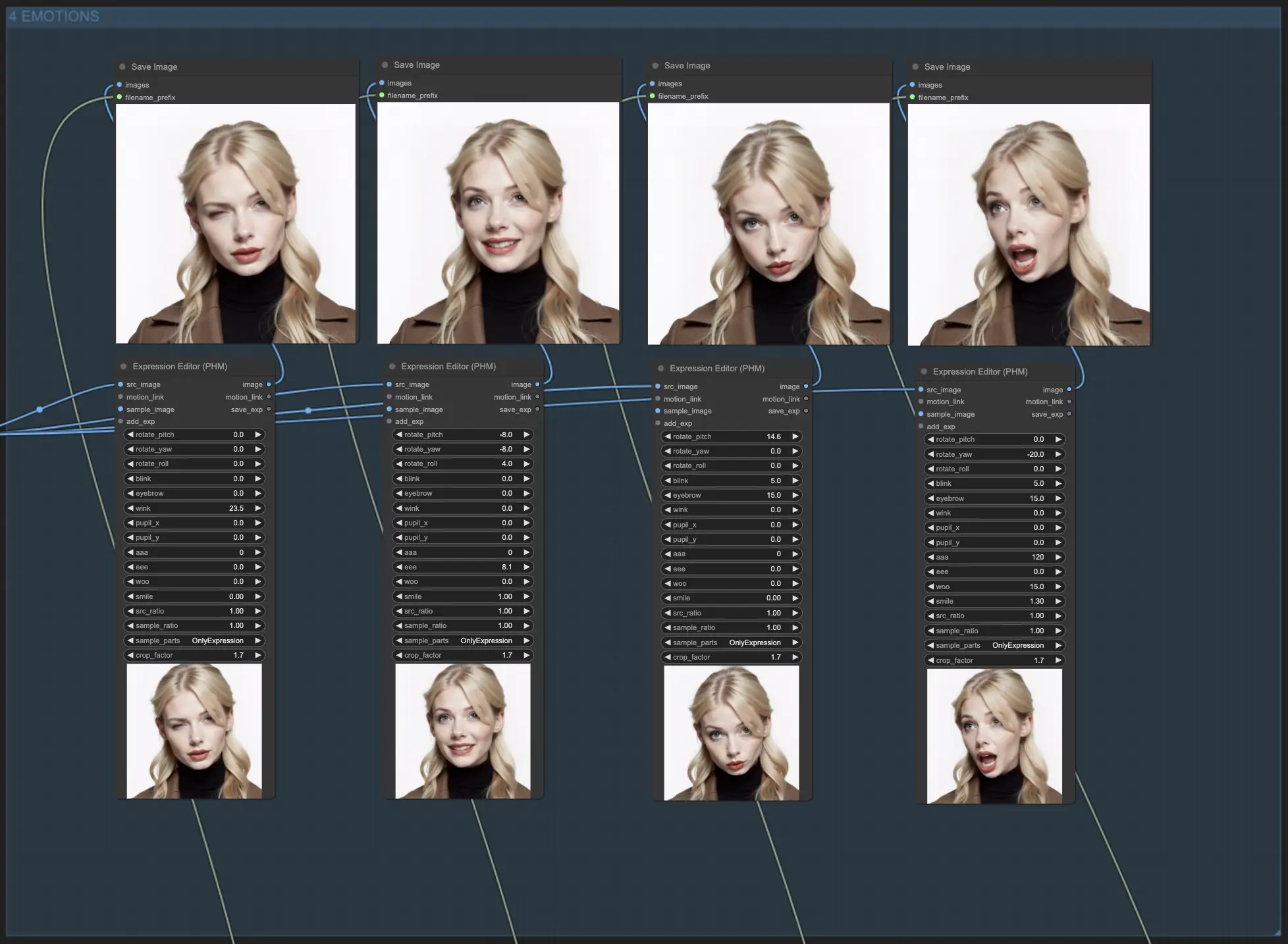

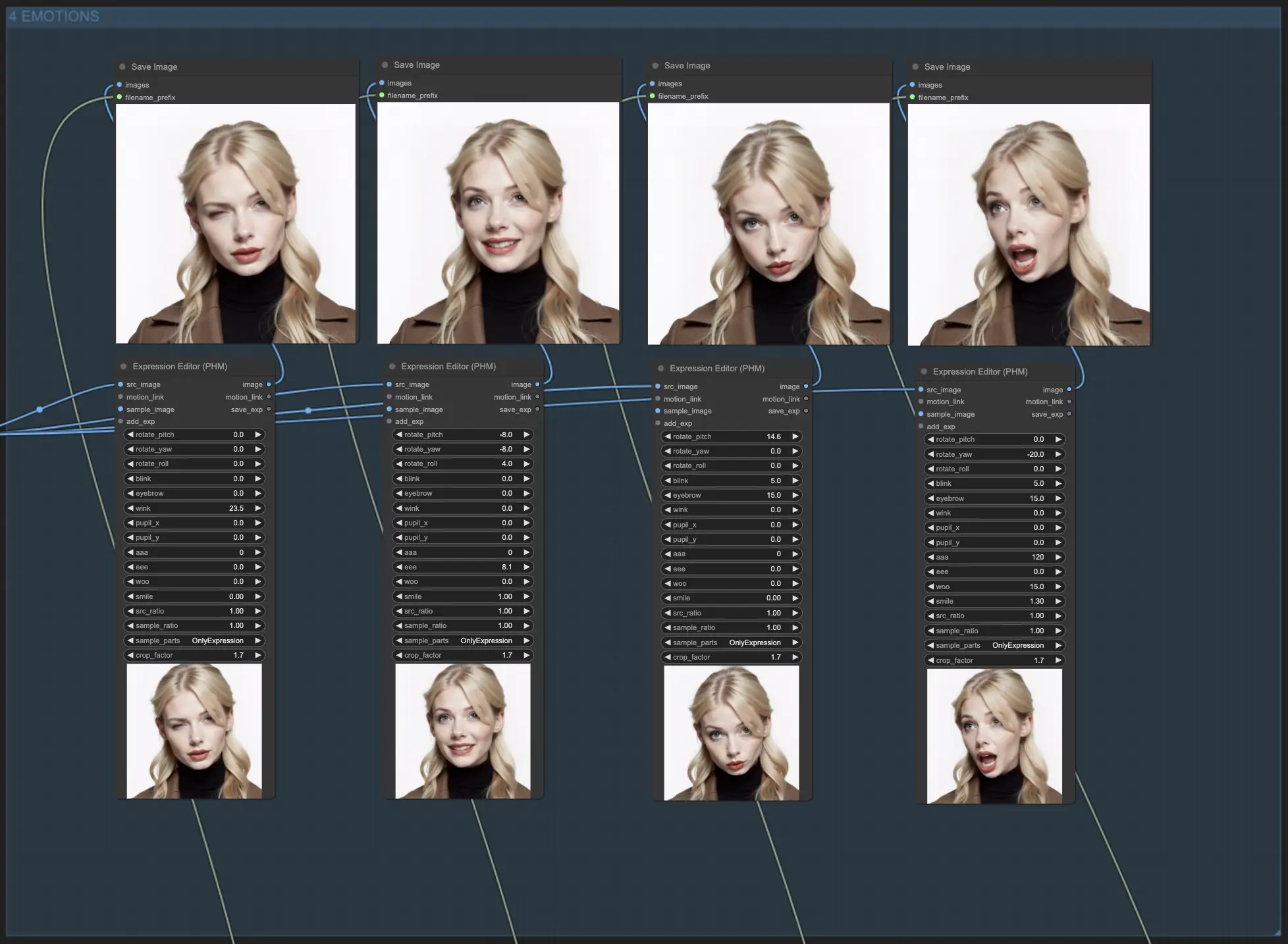

4. Emociones

Este módulo utiliza el nodo Photo Expression Editor (PHM) para ajustar las expresiones faciales en fotos. Los parámetros permiten ajustar finamente varios aspectos faciales, como movimientos de cabeza, parpadeos y sonrisas

Parámetros del Editor de Expresiones:

rotate_pitch: Controla el movimiento de arriba hacia abajo de la cabeza.rotate_yaw: Ajusta el movimiento de lado a lado de la cabeza.rotate_roll: Determina el ángulo de inclinación de la cabeza.blink: Controla la intensidad de los parpadeos.eyebrow: Ajusta los movimientos de las cejas.wink: Controla el guiño.pupil_x: Mueve las pupilas horizontalmente.pupil_y: Mueve las pupilas verticalmente.aaa: Controla la forma de la boca para el sonido vocal "aaa".eee: Controla la forma de la boca para el sonido vocal "eee".woo: Controla la forma de la boca para el sonido vocal "woo".smile: Ajusta el grado de una sonrisa.src_ratio: Determina la proporción de la expresión de origen a aplicar.sample_ratio: Determina la proporción de la expresión de muestra a aplicar.sample_parts: Especifica qué partes de la expresión de muestra aplicar ("SoloExpresión", "SoloRotación", "SoloBoca", "SoloOjos", "Todo").crop_factor: Controla el factor de recorte de la región facial.

Los modelos Flux y los módulos optimizados del flujo de trabajo facilitan el mantenimiento de apariencias consistentes de Personajes Consistentes en varias salidas. Podrá dar vida a sus personajes como nunca antes, creando una experiencia verdaderamente inmersiva para su audiencia!