Una guida dettagliata per padroneggiare ComfyUI IPAdapter Plus (IPAdapter V2)

Updated: 5/17/2024

Benvenuti! In questa guida, esploreremo le entusiasmanti funzionalità di ComfyUI IPAdapter Plus, noto anche come ComfyUI IPAdapter V2.

I modelli IPAdapter sono molto potenti per il condizionamento da immagine a immagine, consentendo il facile trasferimento del soggetto o dello stile delle immagini di riferimento su nuove creazioni. Pensalo come un LoRA a 1 immagine.

L'introduzione di IPAdapter Plus (IPAdapter V2) ha portato una pletora di nuove funzionalità volte a semplificare il processo di integrazione del modello, migliorare l'usabilità ed espandere le possibilità creative.

È importante notare che l'aggiornamento a ComfyUI IPAdapter Plus (IPAdapter V2) renderà malfunzionanti i tuoi flussi di lavoro precedenti, che si basano sul nodo ComfyUI IPAdapter V1. Di conseguenza, dovrai ricostruire i tuoi progetti utilizzando ComfyUI IPAdapter Plus.

Tratteremo:

1. ComfyUI IPAdapter Plus - Nodo IPAdapter Basic

- 1.1. Il flusso di lavoro ComfyUI IPAdapter più semplice

- 1.2. Input del nodo ComfyUI "IPAdapter"

- 1.3. Parametri nel nodo ComfyUI "IPAdapter"

- 1.4. La differenza nell'utilizzo di ComfyUI IPAdapter Plus con i modelli di checkpoint SD1.5 e SDXL

2. ComfyUI IPAdapter Plus - Nodo IPAdapter Advanced

- 2.1. Il flusso di lavoro ComfyUI IPAdapter Advanced

- 2.2. Parametri espansi nel nodo ComfyUI "IPAdapter Advanced"

3. ComfyUI IPAdapter Plus - FaceID

- 3.1. Flusso di lavoro ComfyUI IPAdapter FaceID

4. ComfyUI IPAdapter Plus - Funzione Image Merge

- 4.1. Metodo 1: Utilizzo del nodo ComfyUI "Batch Image"

- 4.2. Metodo 2: Controllo preciso sui pesi di riferimento utilizzando il nodo ComfyUI "IPAdapter Encoder"

5. ComfyUI IPAdapter Plus - IPAdapter Tile per immagini alte

- 5.1 Flusso di lavoro ComfyUI IPAdapter Tile

6. ComfyUI IPAdapter Plus - Stile e Composizione

- 6.1. ComfyUI IPAdapter Plus per il trasferimento di stile

- 6.2. ComfyUI IPAdapter Plus per mantenere la composizione

- 6.3. ComfyUI IPAdapter Plus per mantenere la composizione e il trasferimento di stile

🌟🌟🌟 ComfyUI Online - Sperimenta ora il flusso di lavoro IPAdapter Plus 🌟🌟🌟

Se sei interessato a esplorare il flusso di lavoro ComfyUI IPAdapter Plus (IPAdapter V2), utilizza il seguente ComfyUI web. È completamente equipaggiato con tutti i nodi e i modelli personalizzati essenziali, consentendo una creatività senza interruzioni senza la necessità di configurazioni manuali. Inizia a ottenere esperienza pratica immediatamente o continua con questo tutorial per imparare a utilizzare efficacemente IPAdapter Plus.

Per flussi di lavoro ComfyUI più avanzati e premium, visita la nostra 🌟Lista dei flussi di lavoro ComfyUI🌟

1. ComfyUI IPAdapter Plus - Nodo IPAdapter Basic

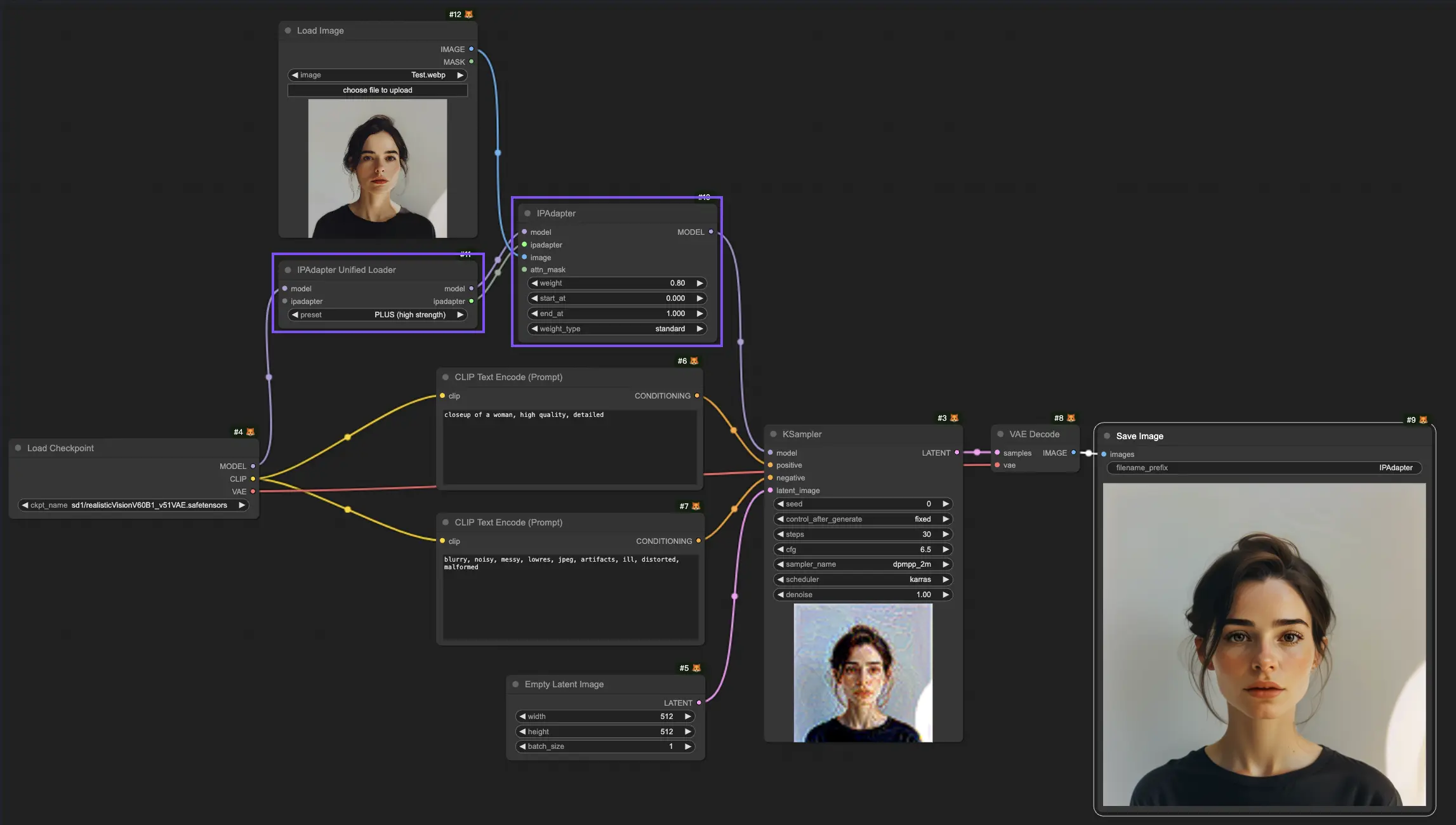

1.1. Il flusso di lavoro ComfyUI IPAdapter più semplice

1.2. Input del nodo ComfyUI "IPAdapter"

1.2.1. Input del nodo "IPAdapter": Model e IPAdapter

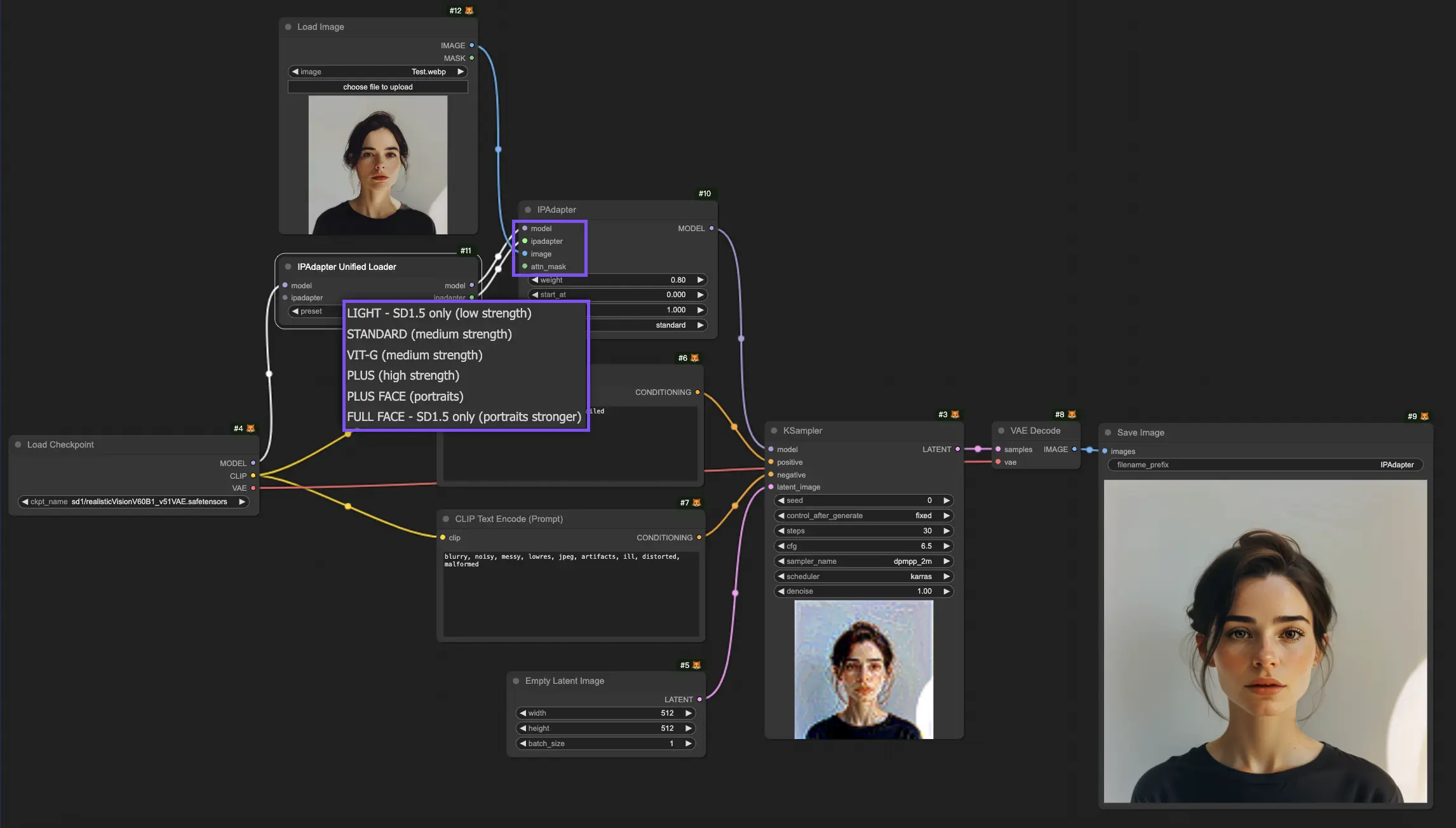

Gli input "Model" e "IPAdapter" del nodo "IPAdapter" sono collegati all'output del nodo "IPAdapter Unified Loader". Qui, puoi selezionare tra vari modelli IPAdapter, ognuno dei quali è adattato a diverse esigenze:

- Light - Solo SD1.5 (bassa intensità): Questo modello è ideale per regolazioni minime ed è esclusivamente compatibile con il modello SD1.5.

- Standard (media intensità): Questo modello raggiunge modifiche di media intensità, adatto a una vasta gamma di applicazioni, bilanciando alterazioni sottili e notevoli.

- VIT-G (media intensità): Pur offrendo modifiche di media intensità come lo Standard, il modello VIT-G è adattato per dati di immagine più intricati o vari, migliorando potenzialmente le prestazioni in scenari specifici.

- PLUS (alta intensità): Per coloro che richiedono modifiche sostanziali, il modello PLUS offre potenti capacità creative, consentendo alterazioni significative.

- PLUS FACE (ritratti): Progettato specificamente per migliorare i ritratti, PLUS FACE si concentra sul miglioramento dei tratti del viso, ideale per la fotografia di ritratti e le opere d'arte.

- Full FACE - Solo SD1.5 (ritratti più forti): Una versione più intensa di PLUS FACE, il modello Full FACE è progettato per trasformazioni drammatiche nei ritratti, ma è compatibile solo con il modello SD1.5.

1.2.2. Input del nodo "IPAdapter": Image

L'input "Image" del nodo "IPAdapter" è l'immagine di riferimento utilizzata per il condizionamento da immagine a immagine. È qui che il nodo "IPAdapter" applica le sue capacità di trasformazione, alterando l'immagine di riferimento in base ai parametri definiti e alle funzionalità del modello. Attraverso questo processo, vengono generate nuove immagini, ereditando gli attributi dall'immagine di riferimento e mescolandoli con il potenziale creativo del modello IPAdapter.

1.2.3. Input del nodo "IPAdapter": Attn Mask (Maschera di attenzione)

Con la "Attn Mask", puoi evidenziare aree specifiche dell'immagine per un'elaborazione mirata o per guidare l'attenzione del modello, migliorando o preservando determinate caratteristiche dell'immagine mentre dirigi il focus del modello.

1.3. Parametri nel nodo ComfyUI "IPAdapter"

1.3.1. Parametri nel nodo "IPAdapter": Weight

Il parametro "Weight" regola l'intensità delle modifiche applicate; valori più alti portano a effetti più pronunciati, mentre valori più bassi risultano in cambiamenti più sottili.

1.3.2. Parametri nel nodo "IPAdapter": Start At & End At

I parametri "Start At" e "End At" dettano i passaggi iniziali e finali in cui vengono applicati gli effetti dell'IPAdapter, offrendo il controllo sull'elaborazione.

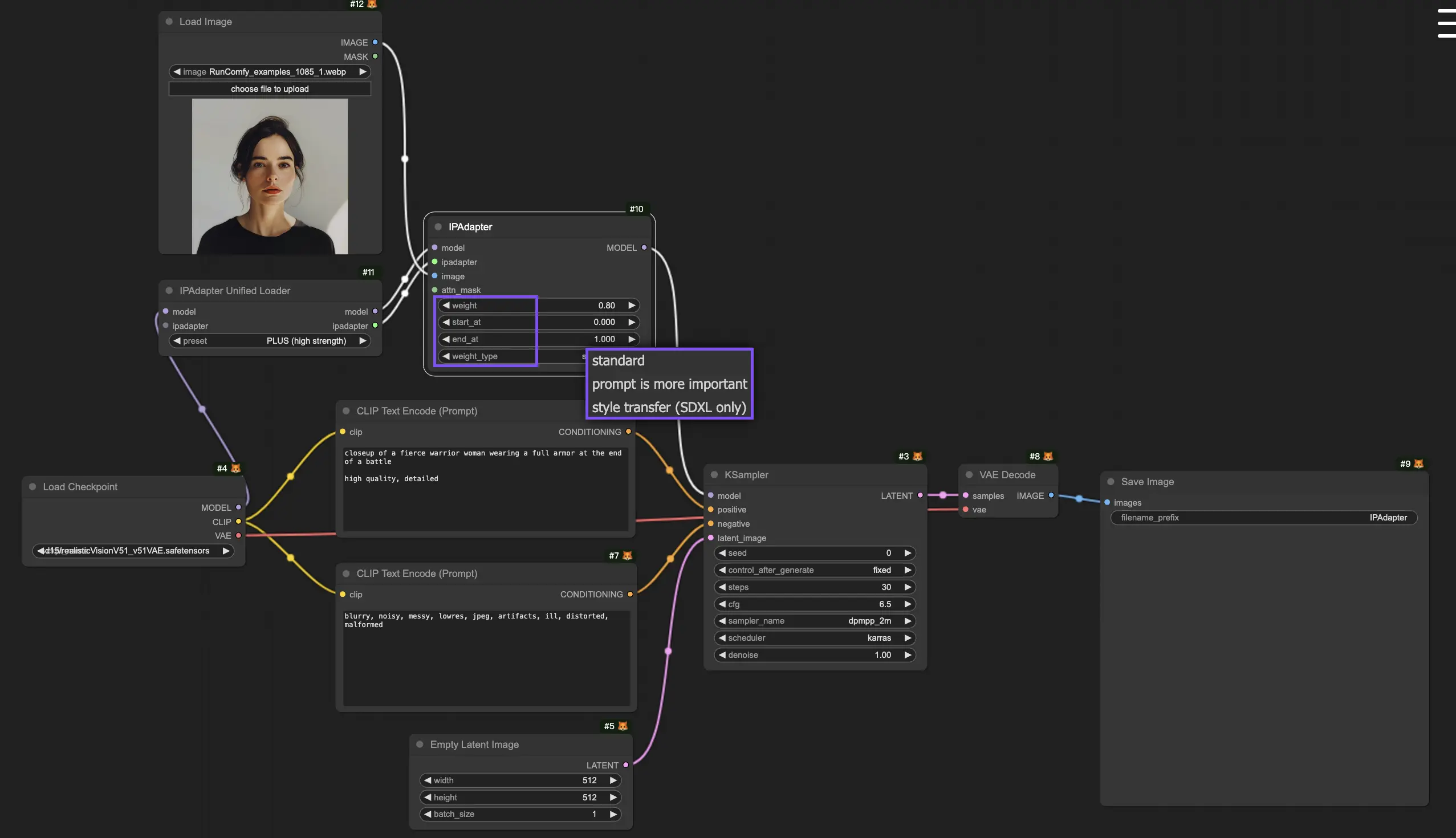

1.3.3. Parametri nel nodo "IPAdapter": Weight Type

Il "Weight Type" per applicare il peso attraverso le fasi di elaborazione varia, ognuno influenzando l'output in modo distintivo:

- Standard

- Il prompt è più importante

- Trasferimento di stile (solo SDXL)

1.4. La differenza nell'utilizzo di ComfyUI IPAdapter Plus con i modelli di checkpoint SD1.5 e SDXL

Quando si lavora con i modelli SDXL, il modello IPAdapter Plus si integra perfettamente e si adatta automaticamente alle caratteristiche del modello SDXL. Tuttavia, è essenziale regolare adeguatamente la dimensione latente per allinearsi con i requisiti del modello SDXL.

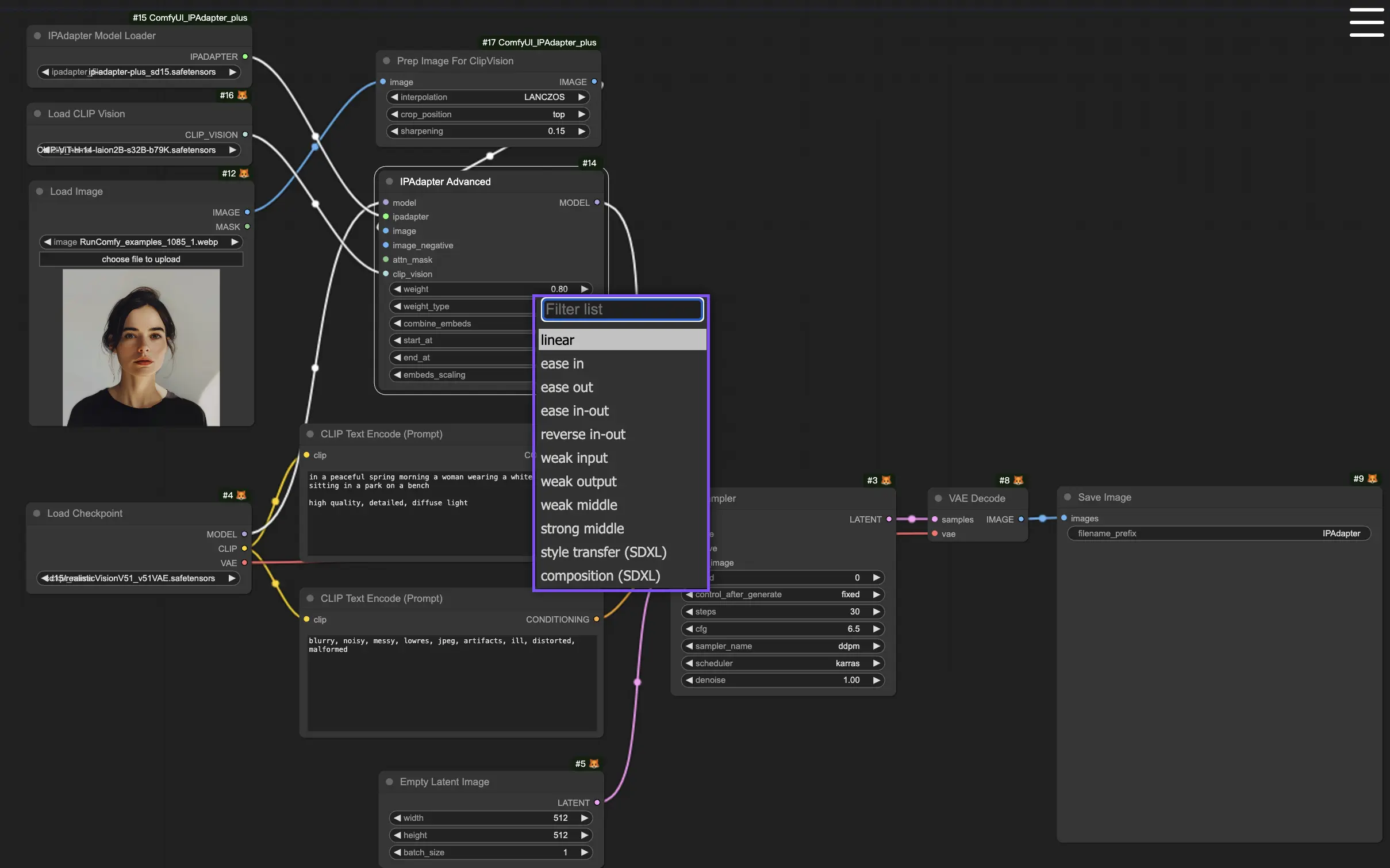

2. ComfyUI IPAdapter Plus - Nodo IPAdapter Advanced

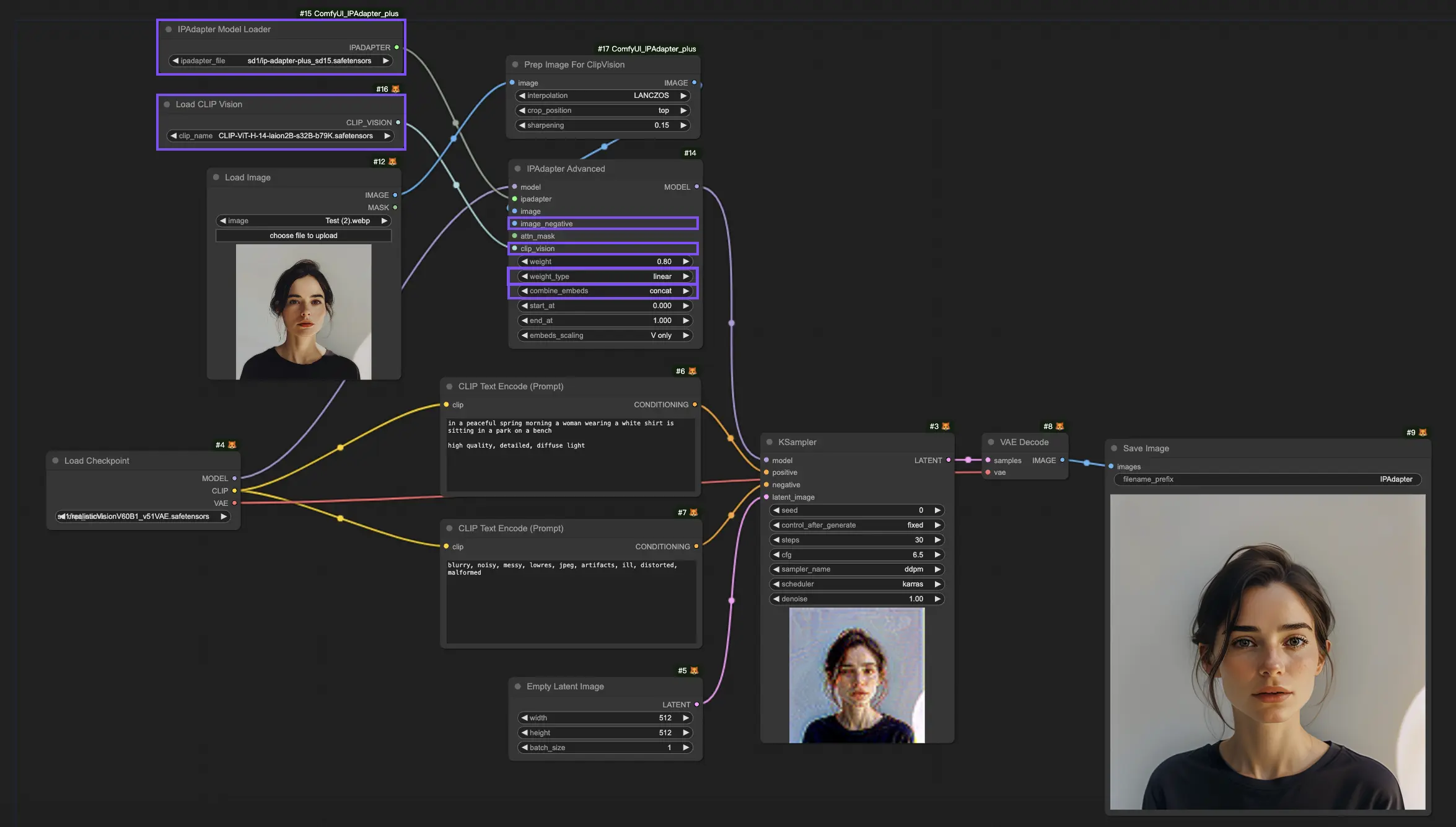

2.1. Il flusso di lavoro ComfyUI IPAdapter Advanced

Offrendo un set di funzionalità più completo, il nodo ComfyUI IPAdapter Advanced migliora il controllo sul processo di generazione attraverso parametri come "Image Negative", "CLIP Vision", "Combine Embeds" e più opzioni di "Weight Type", allineando le immagini più vicine alla tua visione creativa.

2.2. Parametri espansi nel nodo ComfyUI "IPAdapter Advanced"

2.2.1. Parametri espansi nel nodo "IPAdapter Advanced": Image Negative

Il parametro "Image Negative" ti consente di definire ciò che non vuoi che appaia nell'immagine finale. Specificando esempi negativi, il modello viene guidato lontano da elementi indesiderati, dirigendosi verso un risultato più desiderabile. Questa funzionalità è fondamentale per evitare temi, oggetti o pattern specifici nell'immagine generata, garantendo che l'output aderisca alle preferenze dell'utente.

2.2.2. Parametri espansi nel nodo "IPAdapter Advanced": CLIP Vision

Nel nodo "IPAdapter Advanced", troverai l'input "CLIP Vision". Questo si collega all'output del nodo "Load CLIP Vision", dove puoi selezionare tra diversi modelli CLIP-ViT.

- CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors: Questa variante del modello fa parte della famiglia CLIP (Contrastive Language–Image Pre-training), specificamente progettata per comprendere e interpretare il contenuto visivo in relazione alle informazioni testuali. È addestrato su un ampio set di dati (laion2B), con una dimensione del modello di 32 miliardi di parametri (s32B), ed è stato ottimizzato per bilanciare prestazioni e sicurezza nella generazione di contenuti (b79K indica un benchmark o una versione specifica). Questo modello è abile nel gestire un'ampia gamma di attività di riconoscimento visivo, rendendolo adatto per generare immagini di alta qualità e contestualmente accurate.

- CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors: Simile alla sua controparte, anche questo modello è addestrato sul dataset laion2B, ma vanta una dimensione maggiore di 39 miliardi di parametri, rendendolo in grado di comprendere relazioni ancora più sfumate tra testo e immagini. Il "bigG" indica probabilmente una versione più grande o avanzata all'interno della serie CLIP-ViT, con "b160k" che indica il suo benchmark o versione. Questo modello eccelle nel creare immagini dettagliate e complesse che si allineano strettamente alle descrizioni testuali, adatto per applicazioni che richiedono alta fedeltà e profonda comprensione semantica.

La principale differenza tra CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors e CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors risiede nella loro dimensione e nella potenziale complessità di gestione, con il secondo più grande a 39 miliardi di parametri, suggerendo che può interpretare relazioni testo-immagine più sfumate rispetto ai 32 miliardi di parametri del primo.

2.2.3. Parametri espansi nel nodo "IPAdapter Advanced": Weight Type

Rispetto al nodo "IPAdapter", il nodo "IPAdapter Advanced" apre più opzioni per il "weight type", ognuna delle quali influisce sull'output in modo distintivo:

- Linear: Applica il peso uniformemente dall'inizio alla fine della pipeline di elaborazione, garantendo un'influenza coerente senza modulazioni di intensità.

- Ease In: Aumenta gradualmente il peso dall'inizio, consentendo un'introduzione fluida dell'effetto man mano che procede attraverso la pipeline.

- Ease Out: Inizia con una forte influenza che diminuisce gradualmente, riducendo efficacemente l'effetto verso la fine dell'elaborazione.

- Ease In-Out: Una combinazione di entrambi gli effetti "Ease In" e "Ease Out"; inizia e finisce con un'influenza più mite, raggiungendo il picco nel mezzo per il massimo impatto.

- Weak Input: Riduce specificamente l'influenza dell'effetto all'inizio della catena di elaborazione, rendendo meno pronunciati gli elementi iniziali.

- Weak Output: Diminuisce l'influenza verso la fine della catena di elaborazione, ammorbidendo gli aspetti conclusivi dell'immagine.

- Weak Middle: Minimizza l'influenza dell'effetto a metà della catena di elaborazione, spesso per mantenere la chiarezza o concentrarsi sugli aspetti iniziali e finali.

- Strong Middle: Amplifica l'effetto nella parte centrale della catena di elaborazione, intensificando l'impatto sugli elementi centrali dell'immagine.

- Trasferimento di stile (SDXL): Progettato esclusivamente per i modelli SDXL, questa opzione si concentra sull'adattamento dello stile dall'immagine di riferimento all'immagine target, sfruttando le capacità di SDXL per una trasformazione stilistica sfumata.

- Composizione (SDXL): Progettato per i modelli SDXL, mira a fondere gli elementi compositivi delle immagini di riferimento e target, enfatizzando la disposizione e l'interazione degli elementi all'interno dello spazio.

2.2.4. Parametri espansi nel nodo "IPAdapter Advanced": Combine Embeds

La funzione "Combine Embeds" è essenziale per coloro che desiderano unire input da più fonti in un unico output visivo coerente. Utilizzando "Combine Embeds", hai la flessibilità di creare immagini che incorporano un'ampia gamma di influenze e ispirazioni artistiche, risultando in creazioni veramente personalizzate e innovative. I metodi forniti per combinare gli embeds, come Concat, Add, Subtract, Average e Norm Average, offrono approcci diversi per unire queste influenze. Questi saranno esplorati in dettaglio nella Sezione 4, "Funzione ComfyUI IPAdapter Image Merge".

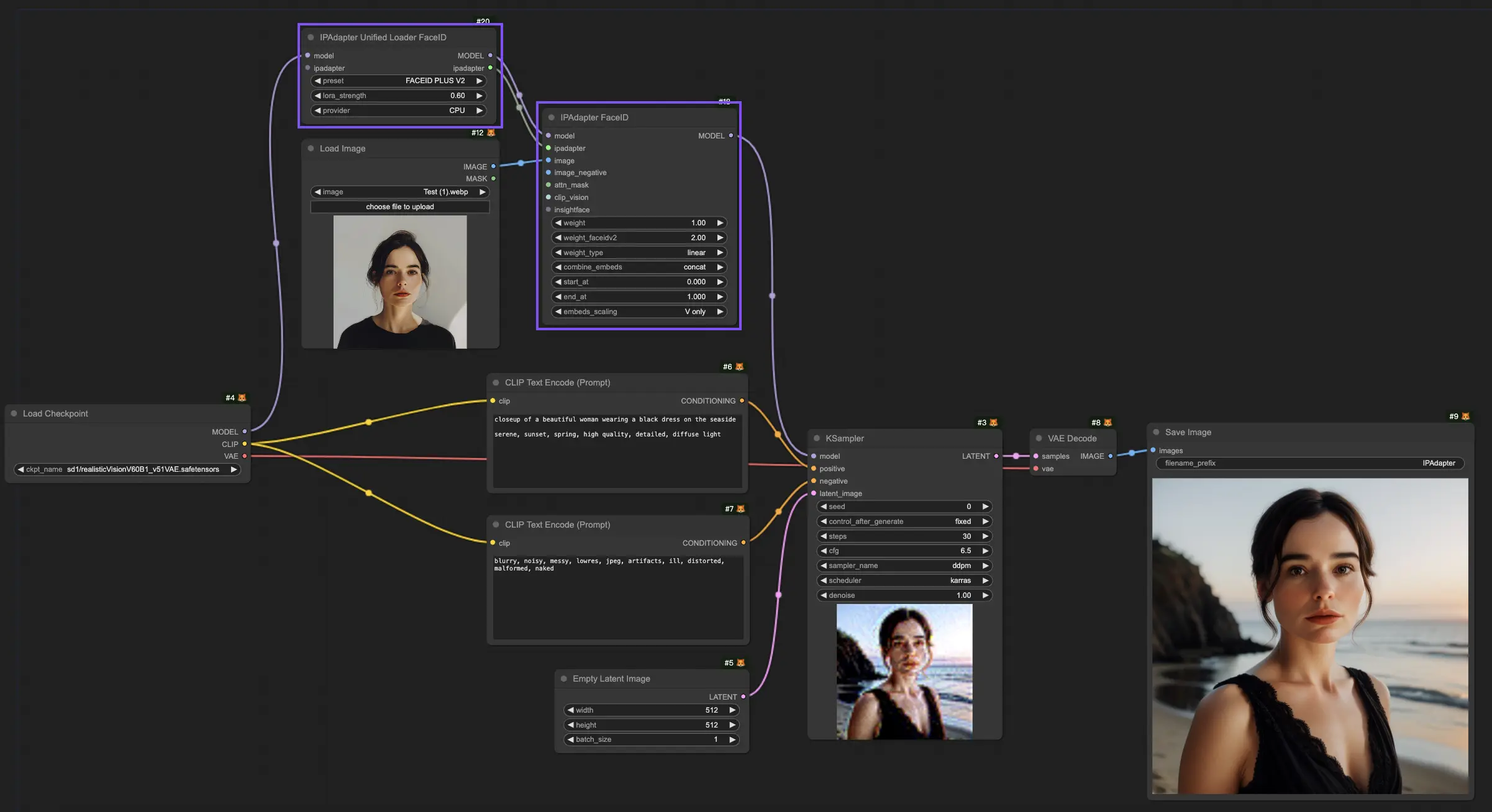

3. ComfyUI IPAdapter Plus - FaceID

Nella configurazione menzionata sopra, potresti aver notato l'assenza del modello FaceID. Per integrare il modello Face ID nel tuo flusso di lavoro, sono necessari due nodi specifici: il nodo "IPAdapter Unified Loader FaceID" e il nodo "IPAdapter FaceID".

3.1. Flusso di lavoro ComfyUI IPAdapte FaceID

Quando lavori all'interno del nodo "IPAdapter Unified Loader FaceID", puoi selezionare il più recente "Face ID Plus V2" dal menu a discesa dei modelli disponibili. Questa azione istruisce il loader a raccogliere e preparare automaticamente tutte le dipendenze necessarie specifiche per il modello Face ID Plus V2.

Scegli la CPU come Provider. Nonostante la potenziale disponibilità di una GPU ad alte prestazioni, è consigliabile configurare il modello Face ID per utilizzare la CPU come provider. Questa raccomandazione deriva dal vantaggio di preservare la preziosa memoria video (VRAM), una strategia che si dimostra vantaggiosa e aiuta a ottimizzare l'efficienza complessiva e l'efficacia dell'allocazione delle risorse del tuo progetto.

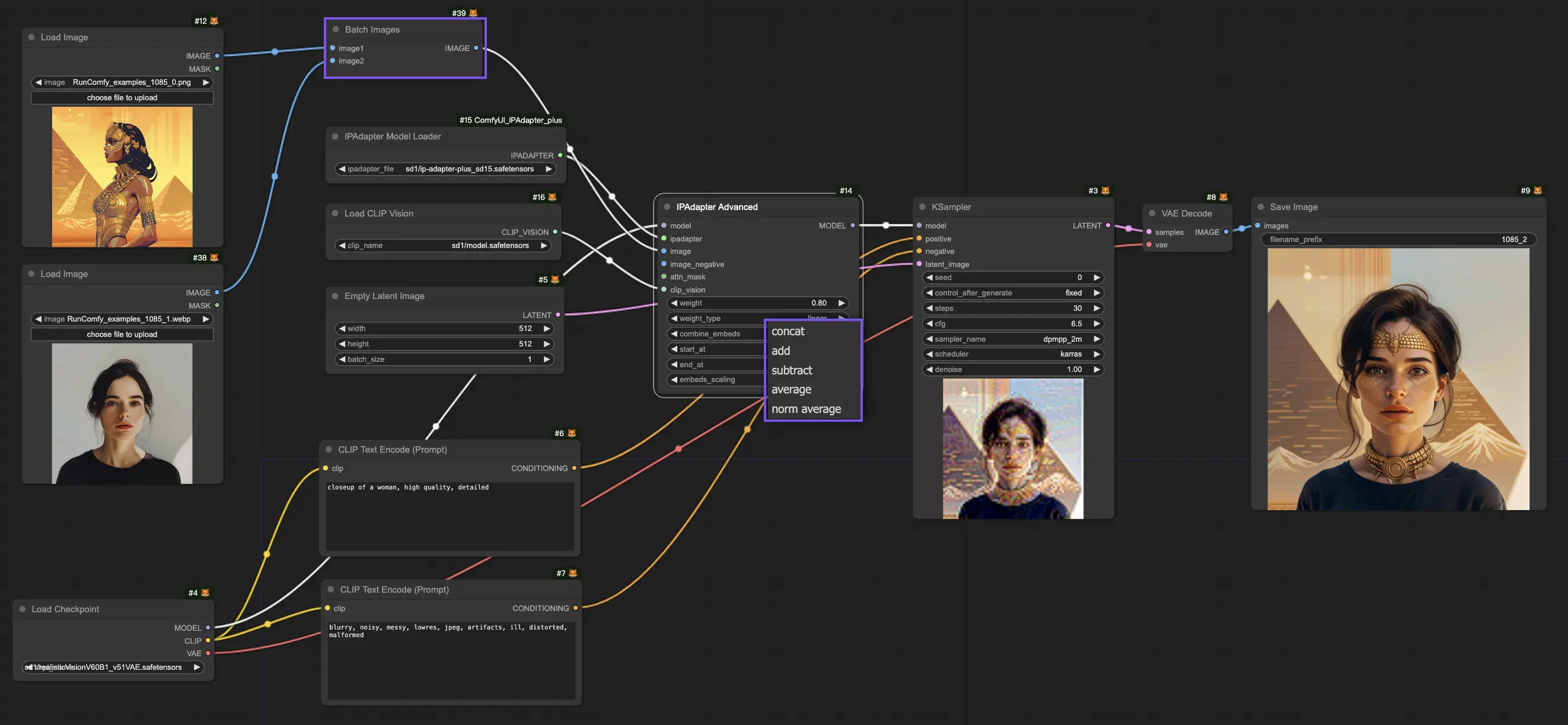

4. ComfyUI IPAdapter Plus - Funzione Image Merge

Come utilizzare più immagini di riferimento per generarne una nuova? Ecco due metodi per farlo con ComfyUI IPAdapter Plus, fornendoti la flessibilità e il controllo necessari per la generazione creativa di immagini.

4.1. Metodo 1: Utilizzo del nodo ComfyUI "Batch Image"

Per iniziare con il nodo "Batch Image", devi prima selezionare le immagini che desideri unire. Queste immagini vengono quindi inserite nel nodo, creando un batch unificato. Questo batch viene successivamente introdotto nella pipeline IPAdapter, applicando sequenzialmente ciascuna immagine al processo generativo.

Il nodo "IPAdapter Advanced" introduce le opzioni "Combine Embeds", concedendoti un controllo sofisticato su come più immagini influenzano la generazione. Queste opzioni—Concat, Add, Subtract, Average e Norm Average—dettano come gli embedding di diverse immagini vengono uniti, ognuno portando a risultati unici:

- Concat: Questa opzione concatena gli embedding di ciascuna immagine, preservando e combinando efficacemente le informazioni di tutte le immagini di input in un unico formato esteso. Questo approccio è vantaggioso per incorporare un ampio spettro di caratteristiche da ogni immagine, ma può portare a complessità a causa della maggiore quantità di informazioni elaborate.

- Add: Sommando gli embedding delle immagini, il metodo "Add" sinergizza le loro influenze, enfatizzando i tratti comuni tra le immagini. Questo può essere particolarmente utile per sottolineare caratteristiche o temi condivisi, portando potenzialmente a un output più unificato e coerente.

- Subtract: Contrariamente all'aggiunta, il metodo "Subtract" differenzia gli embedding sottraendoli, evidenziando gli aspetti unici di ciascuna immagine. Questo approccio consente l'esplorazione creativa dei contrasti e può essere utilizzato per diminuire determinati elementi presenti nelle immagini di riferimento, offrendo una nuova via per l'espressione artistica.

- Average: Facendo la media degli embedding, questo metodo ottiene una amalgamazione equilibrata delle caratteristiche delle immagini, assicurando che l'influenza di una singola immagine non sia eccessivamente dominante. Questa tecnica è ideale per ottenere un'integrazione armoniosa di più immagini, fornendo un output coeso che rappresenta equamente le immagini di input.

- Norm Average (Media normalizzata): Questa opzione regola l'influenza di ciascuna immagine in base al suo peso relativo all'interno del batch, consentendo un controllo preciso su come ogni immagine di riferimento contribuisce alla composizione finale. Permette la messa a punto dell'aspetto dell'immagine generata, garantendo che il risultato finale si allinei strettamente con la visione dell'utente.

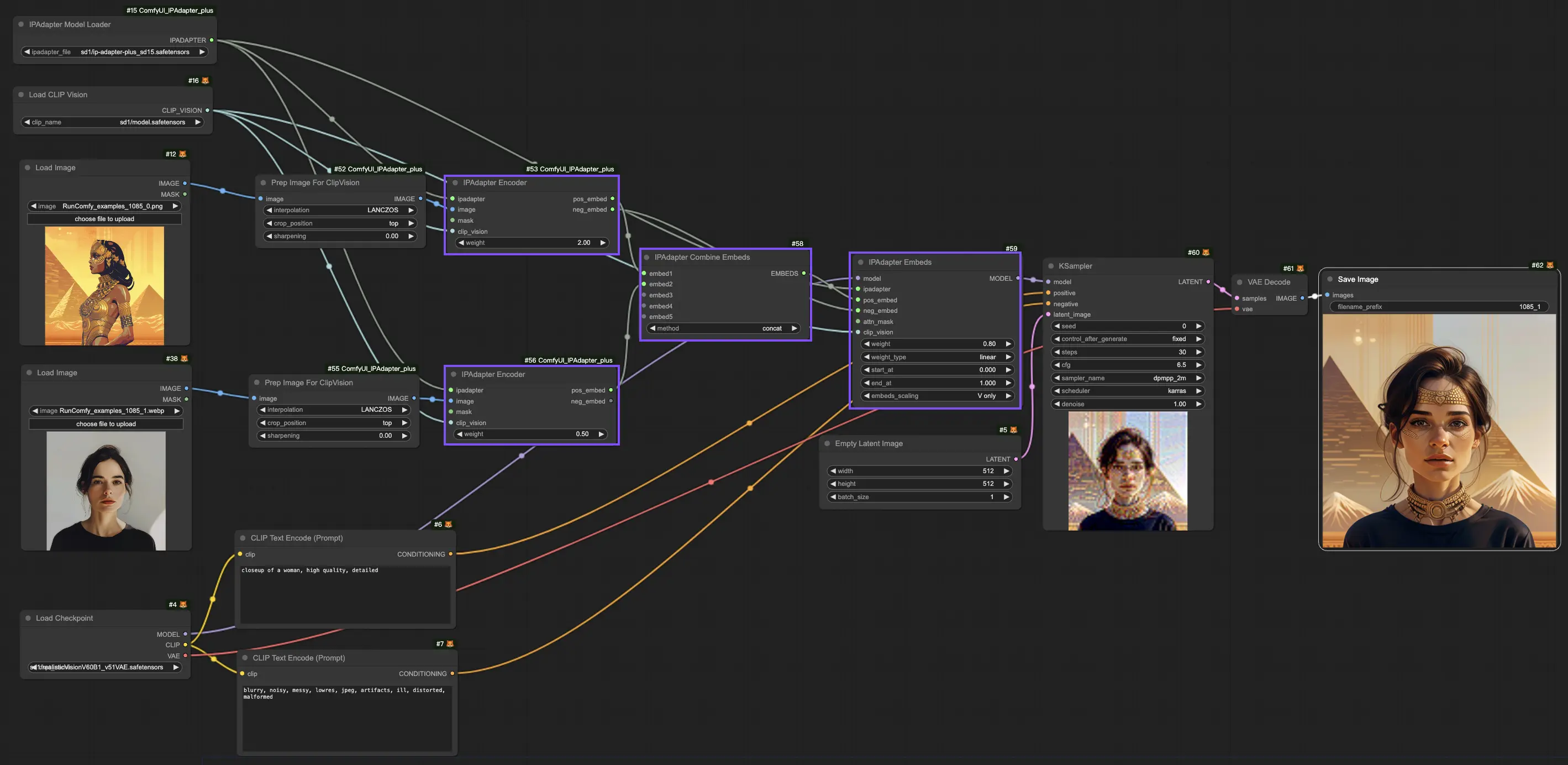

4.2. Metodo 2: Controllo preciso sui pesi di riferimento utilizzando il nodo ComfyUI "IPAdapter Encoder"

Per coloro che cercano un controllo più fine su come le immagini di riferimento sono ponderate nell'immagine finale, IPAdapter fornisce una soluzione attraverso l'uso dei nodi "IPAdapter Encoder" e di un nodo "IPAdapter Combine Embeds".

4.2.1. Utilizzo dei nodi "IPAdapter Encoder"

Ogni immagine nel processo di unione viene elaborata attraverso un nodo codificatore IPAdapter, che codifica le immagini per la compatibilità con IPAdapter. All'interno dei nodi "IPAdapter Encoder", gli utenti possono assegnare pesi specifici a ciascuna immagine, dettando la loro influenza sull'output unito. Regolare questi pesi consente un controllo sfumato sulla dominanza o sulla sottigliezza di ogni immagine nella composizione.

4.2.2. Unione con il nodo "IPAdapter Combine Embeds"

Dopo aver codificato le immagini e impostato i loro pesi, il nodo "IPAdapter Combine Embeds" unisce le loro rappresentazioni codificate. Combina gli embeds positivi dei nodi codificatori, riflettendo l'influenza prevista di ciascuna immagine sull'output unito. Questo embedding bilanciato è quindi pronto per la sintesi.

4.2.3. Connessione al nodo "IPAdapter"

L'embedding sintetizzato viene infine elaborato dall'IP Adapter per produrre la nuova immagine. Sebbene la connessione di embeds negativi sia facoltativa, farlo è consigliato per preservare le risorse computazionali. Selezionando uno qualsiasi dei due embeds negativi dei nodi codificatori e collegandolo al nodo IPAdapter, il processo viene ottimizzato, riducendo al minimo il calcolo non necessario e semplificando il processo di unione.

Seguendo questi metodi, puoi unire efficacemente più immagini per generare nuove composizioni creative, sfruttando appieno le capacità di ComfyUI IPAdapter Plus!

5. ComfyUI IPAdapter Plus - IPAdapter Tile per immagini alte

Quando si elaborano immagini alte, potresti incontrare una sfida unica: il codificatore CLIP Vision, un componente core del framework IPAdapter, predilige intrinsecamente le immagini quadrate. Questa preferenza può portare a problemi di ritaglio quando si collega direttamente un'immagine alta a un nodo IPAdapter, risultando tipicamente solo nella porzione centrale dell'immagine che influenza l'output. Di conseguenza, le sezioni superiore e inferiore dell'immagine potrebbero essere ignorate, influenzando la qualità complessiva del contenuto generato.

Per affrontare questo problema, il nodo "IPAdapter Tiled" offre una soluzione su misura. Consente la connessione diretta di immagini alte segmentando l'immagine in tile più piccole e gestibili. Questo metodo garantisce che ogni parte dell'immagine di riferimento venga presa in considerazione durante il processo di generazione, evitando il problema della negligenza parziale dell'immagine.

5.1 Flusso di lavoro ComfyUI IPAdapter Tile

Una funzionalità aggiuntiva del nodo "IPAdapter Tiled" è l'output di tile e maschere, che fornisce una rappresentazione visiva di come viene elaborata l'immagine. Questa funzione mostra le tile specifiche utilizzate e le loro maschere corrispondenti, offrendoti informazioni sul funzionamento interno del processo generativo. Comprendere come l'immagine viene segmentata ed elaborata può aiutarti a fare regolazioni informate per ottenere i risultati desiderati.

Inoltre, il nodo "IPAdapter Tiled" consente regolazioni personalizzate delle maschere, offrendo flessibilità per evidenziare o concentrarsi su sezioni particolari dell'immagine. Personalizzando queste maschere, puoi dirigere più attenzione a specifici elementi della tua immagine alta, concedendo un controllo maggiore sul risultato. Questa funzione si dimostra inestimabile per enfatizzare o minimizzare determinati aspetti all'interno dell'immagine, garantendo che il contenuto generato si allinei precisamente con la tua visione.

Pertanto, l'incorporazione del nodo "IPAdapter Tiled" in ComfyUI IPAdapter Plus migliora notevolmente la tua capacità di gestire progetti di condizionamento da immagine a immagine che coinvolgono immagini alte.

6. ComfyUI IPAdapter Plus - Stile e Composizione

Come utilizzare ComfyUI IPAdapter Plus per manipolare e combinare gli stili e le composizioni delle immagini di riferimento per creare nuovi elementi visivi avvincenti. ComfyUI IPAdapter Plus offre una potente suite di strumenti con cui artisti e designer possono sperimentare, inclusa la capacità di trasferire lo stile di un'immagine, mantenere la composizione di un'altra, o anche unire sia lo stile che la composizione da diversi riferimenti in una singola immagine.

6.1. ComfyUI IPAdapter Plus per il trasferimento di stile

Per trasferire lo stile di un'immagine di riferimento, come un LoRA a 1 immagine, sul tuo contenuto target utilizzando il nodo ComfyUI IPAdapter Advanced, segui questi passaggi:

Impostazione del nodo "IPAdapter Advanced": Inizia incorporando un nodo "IPAdapter Advanced" nel tuo flusso di lavoro.

Configurazione del nodo: Nelle impostazioni del nodo ComfyUI IPAdapter Advanced, individua l'opzione "Weight Type". Usa il menu a discesa per selezionare "Trasferimento di stile (SDXL)". Questa configurazione indirizza l'adattatore a dare priorità al trasferimento dello stile visivo dell'immagine di riferimento sul target.

Regolazione del "Weight" del trasferimento di stile: L'impostazione "weight" determina la forza del trasferimento di stile. Aumentare questo valore amplifica l'influenza dello stile di riferimento sull'immagine target, rendendo l'effetto più distinto.

6.2. ComfyUI IPAdapter Plus per mantenere la composizione

Per mantenere la composizione di un'immagine di riferimento durante la generazione di una nuova, userai anche il nodo ComfyUI IPAdapter Advanced ma con un'impostazione diversa:

Impostazione del nodo "IPAdapter Advanced": Come prima, aggiungi un nodo IPAdapter Advanced al tuo flusso di lavoro.

Configurazione del nodo: Scegli "Composizione (SDXL)" dal menu a discesa "Weight Type". Questo istruisce l'adattatore a mantenere gli elementi compositivi dell'immagine di riferimento nella nuova generazione.

Regolazione del "Weight" della composizione: Modifica l'impostazione "weight" per influenzare quanto strettamente la nuova immagine aderisce alla composizione del riferimento. Un peso maggiore farà rispettare più rigorosamente la composizione del riferimento.

6.3. ComfyUI IPAdapter Plus per mantenere la composizione e il trasferimento di stile

Per i progetti che richiedono sia lo stile di un'immagine che la composizione di un'altra da trasferire, il nodo "IPAdapter style & composition SDXL" offre una soluzione semplificata:

Scelta del nodo "IPAdapter Style & Composition SDXL": Aggiungi questo nodo specializzato al tuo progetto pergestire simultaneamente i trasferimenti di stile e composizione.

Caricamento dei riferimenti di stile e composizione: Il nodo "IPAdapter Style & Composition SDXL" consente due input, uno per l'immagine di cui vuoi trasferire lo stile e un altro per l'immagine di cui desideri mantenere la composizione. Carica entrambi i riferimenti di conseguenza.

Configurazione dei "Weights" per stile e composizione: Il nodo "IPAdapter Style & Composition SDXL" fornisce impostazioni di peso separate per stile e composizione. Regola questi pesi per bilanciare l'influenza di ogni riferimento sull'immagine finale. Impostare un peso più alto per lo stile o la composizione darà priorità a quell'aspetto nell'immagine generata.

Seguendo questi passaggi e sperimentando con le impostazioni, puoi sfruttare ComfyUI IPAdapter Plus per creare immagini visivamente stupefacenti che fondono il meglio di entrambi i mondi: lo stile distintivo di un'opera d'arte con la composizione ben congegnata di un'altra.

🌟🌟🌟 ComfyUI Online - Sperimenta ora il flusso di lavoro IPAdapter Plus 🌟🌟🌟

Se sei interessato a esplorare il flusso di lavoro ComfyUI IPAdapter Plus (IPAdapter V2), utilizza il seguente ComfyUI web. È completamente equipaggiato con tutti i nodi e i modelli personalizzati essenziali, consentendo una creatività senza interruzioni senza la necessità di configurazioni manuali. Inizia a ottenere esperienza pratica immediatamente!