IC-Light | 이미지 재조명

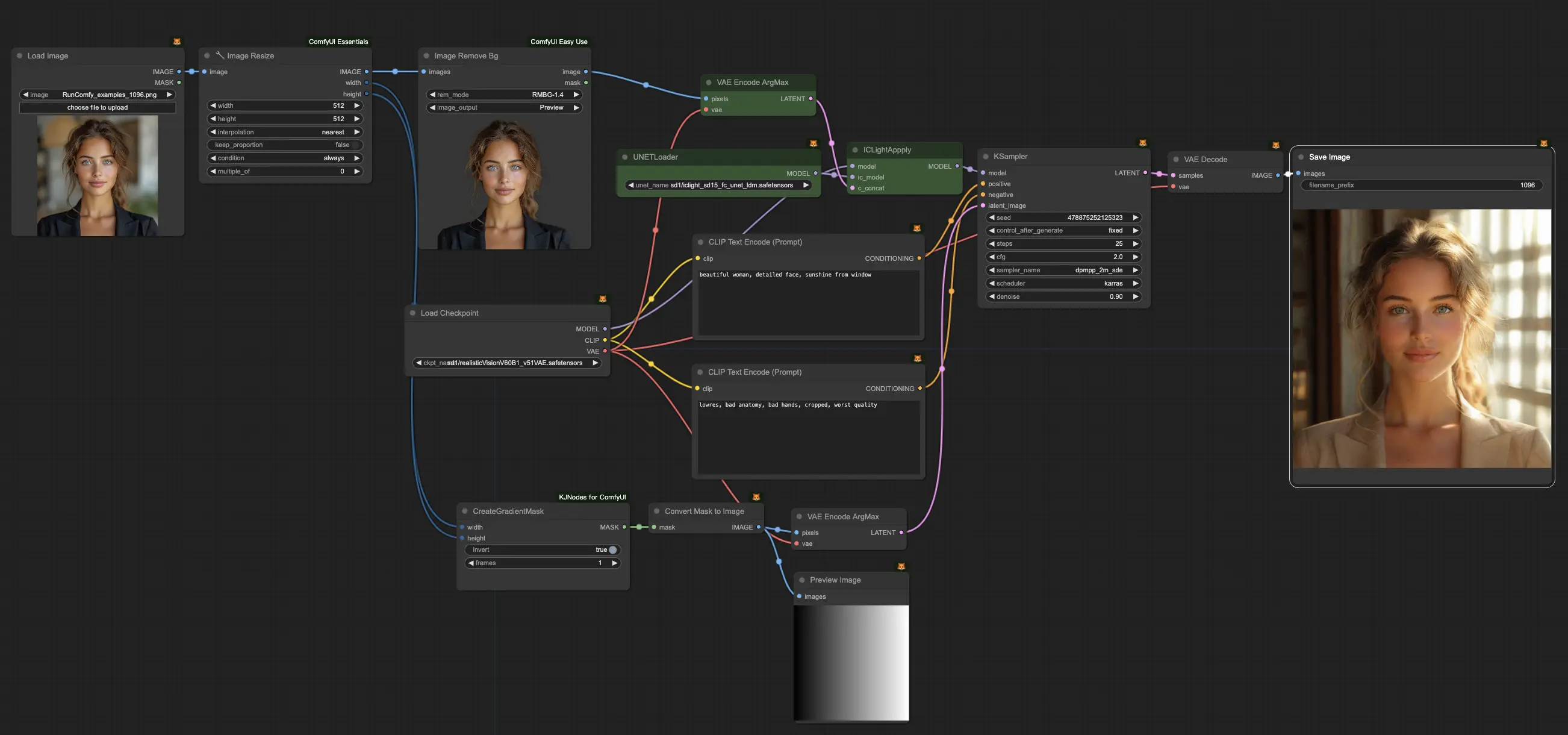

이 ComfyUI IC-Light 워크플로우에서는 이미지를 쉽게 재조명할 수 있습니다. 먼저 원본 이미지의 배경을 제거하여 편집합니다. 그런 다음 프롬프트를 기반으로 향상된 재조명과 새로운 배경으로 새 이미지를 재생성하여 일관되고 정확한 결과를 보장합니다.ComfyUI IC-Light 워크플로우

ComfyUI IC-Light 예제

ComfyUI IC-Light 설명

1. IC-Light란 무엇인가요?

IC-Light는 생성된 이미지에 대한 국소적 편집을 수행하기 위해 Stable Diffusion 모델과 통합되는 AI 기반 이미지 편집 도구입니다. 이는 이미지를 잠재 공간 표현으로 인코딩하고, 특정 영역에 대한 편집을 적용한 다음, 수정된 잠재 표현을 다시 이미지로 디코딩하는 방식으로 작동합니다. 이 접근 방식은 원본 이미지의 전반적인 스타일과 일관성을 유지하면서 편집 과정에 대한 정확한 제어를 가능하게 합니다.

현재 텍스트 조건부 재조명 모델과 배경 조건부 모델의 두 가지 모델이 공개되었습니다. 두 유형 모두 전경 이미지를 입력으로 사용합니다.

2. IC-Light의 작동 원리

IC-Light는 이미지를 인코딩하고 디코딩하기 위해 Stable Diffusion 모델의 힘을 활용합니다. 이 과정은 다음 단계로 나눌 수 있습니다:

2.1. 인코딩: 입력 이미지가 Stable Diffusion VAE(Variational Autoencoder)를 통과하여 압축된 잠재 공간 표현을 얻습니다. 2.2. 편집: 원하는 편집이 잠재 표현의 특정 영역에 적용됩니다. 이는 일반적으로 원래의 잠재 표현과 수정할 영역을 나타내는 마스크, 그리고 해당 편집 프롬프트를 연결하여 수행됩니다. 2.3. 디코딩: 수정된 잠재 표현이 Stable Diffusion 디코더를 통과하여 편집된 이미지를 재구성합니다. IC-Light는 잠재 공간에서 작동함으로써 이미지의 전반적인 일관성과 스타일을 유지하면서 국소적인 편집을 수행할 수 있습니다.

3. ComfyUI IC-Light 사용 방법

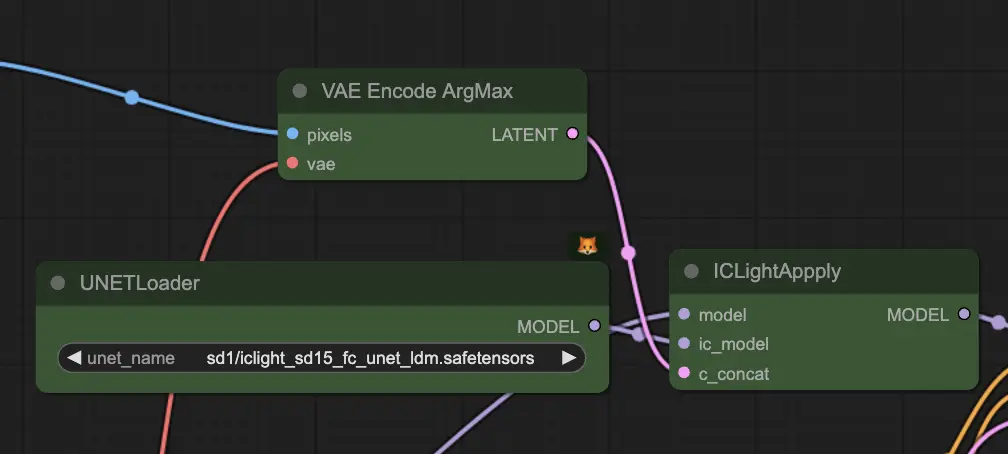

주로 작업하게 될 노드는 "IC-Light Apply" 노드로, 이미지의 인코딩, 편집, 디코딩 전체 과정을 처리합니다.

3.1. "IC-Light Apply" 입력 매개변수:

"IC-Light Apply" 노드는 세 가지 주요 입력을 필요로 합니다:

- model: 이미지를 인코딩하고 디코딩하는 데 사용될 기본 Stable Diffusion 모델입니다.

- ic_model: 편집 과정에 필요한 가중치를 포함하는 사전 학습된 IC-Light 모델입니다.

- c_concat: 원본 이미지, 편집할 영역을 나타내는 마스크, 그리고 해당 영역을 수정하는 방법을 정의하는 편집 프롬프트를 결합하는 특수 입력입니다.

c_concat 입력을 생성하려면:

- VAEEncodeArgMax 노드를 사용하여 원본 이미지를 인코딩합니다. 이 노드는 이미지의 가장 가능성이 높은 잠재 표현을 얻을 수 있도록 합니다.

- ICLightApplyMaskGrey 노드를 사용하여 이미지의 마스크 버전을 생성합니다. 이 노드는 원본 이미지와 마스크를 입력으로 받아 마스크되지 않은 영역이 회색으로 처리된 이미지 버전을 출력합니다.

- 편집 프롬프트의 잠재 표현을 생성합니다. 이러한 프롬프트는 이미지의 선택된 영역에 대한 수정 사항을 안내합니다.

- 원본 이미지, 마스크 및 편집 프롬프트의 잠재 표현을 "IC-Light Apply" 노드의 단일 입력으로 결합합니다.

3.2. "IC-Light Apply" 출력 매개변수:

"IC-Light Apply" 노드는 입력을 처리한 후 단일 매개변수를 출력합니다:

- model: IC-Light 수정 사항이 적용된 패치된 Stable Diffusion 모델입니다.

최종 편집된 이미지를 생성하려면 출력 모델을 ComfyUI 워크플로의 적절한 노드(예: KSampler 및 VAEDecode 노드)에 연결하기만 하면 됩니다.

3.3. 최상의 결과를 위한 팁:

- 고품질 마스크 사용: 편집이 정확하고 효과적으로 이루어지도록 하려면 마스크가 수정하려는 영역을 정확하게 윤곽을 그리는지 확인하세요.

- 다양한 편집 프롬프트 실험: 편집 프롬프트는 이미지의 선택된 영역에 대한 수정 사항을 안내합니다. 원하는 효과를 얻기 위해 다양한 프롬프트를 자유롭게 시도해 보고, 결과에 따라 프롬프트를 개선하는 것을 주저하지 마세요.

- 전역 및 지역 편집의 균형 유지: IC-Light는 국소적인 편집에 적합하지만 이미지의 전체적인 구성과 일관성을 고려하는 것이 중요합니다. 생성된 아트워크의 무결성을 유지하기 위해 집중적인 편집과 전역 조정 사이의 균형을 찾으려고 노력하세요.

자세한 내용은 을 참조하세요.