MimicMotion | 인간 동작 비디오 생성

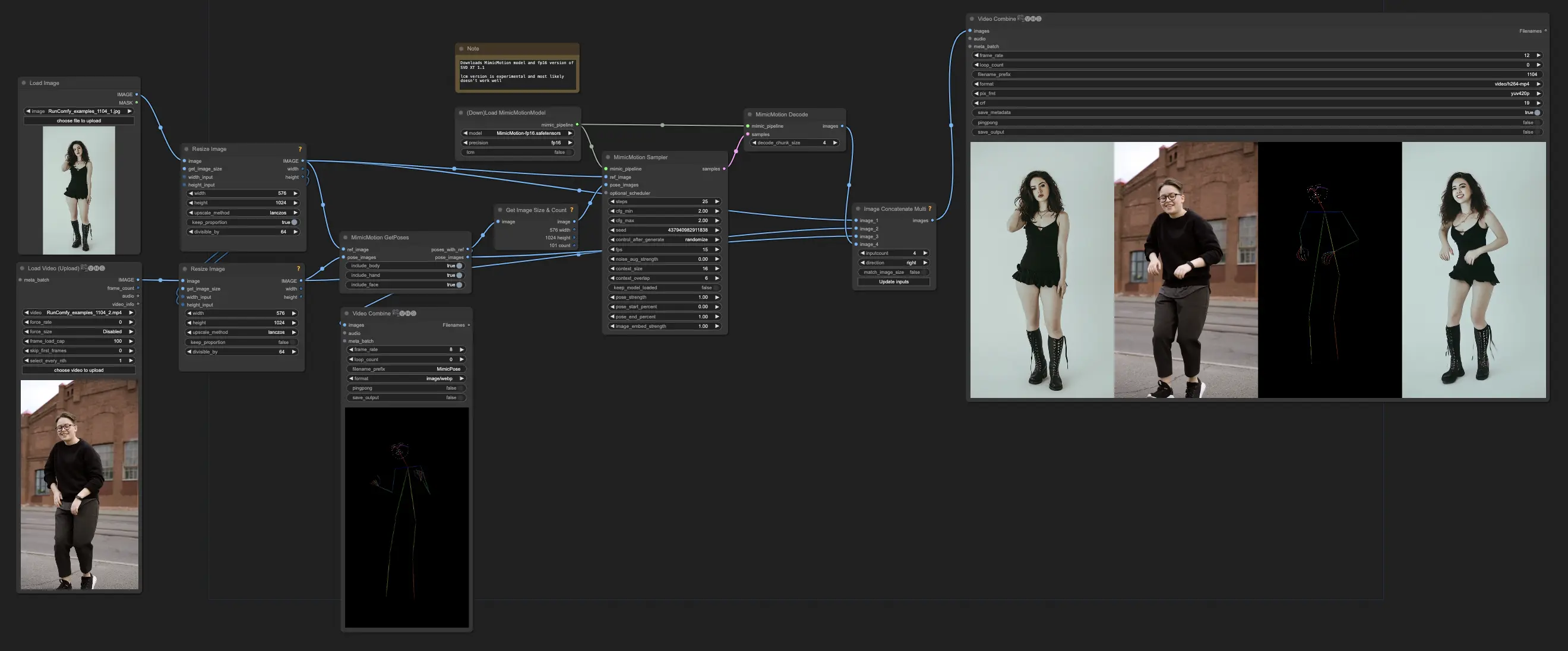

ComfyUI MimicMotion 워크플로우는 현실적인 인간 동작 비디오를 생성하기 위한 강력한 도구입니다. Tencent와 Shanghai Jiao Tong University가 개발한 기술인 MimicMotion을 통합하여, 이 워크플로우는 상세하고 부드러운 동작의 비디오를 쉽게 생성할 수 있게 합니다. 참조 이미지와 동작 시퀀스를 제공하기만 하면, MimicMotion이 참조 이미지의 외형을 모방하는 비디오를 생성합니다.ComfyUI MimicMotion 워크플로우

ComfyUI MimicMotion 예제

ComfyUI MimicMotion 설명

MimicMotion이란 무엇인가

MimicMotion은 Tencent와 Shanghai Jiao Tong University의 연구자들이 개발한 제어 가능한 비디오 생성 프레임워크입니다. 제공된 동작 가이던스를 따라 임의의 길이의 고품질 비디오를 생성할 수 있습니다. 이전 방법들과 비교하여, MimicMotion은 풍부한 세부 사항과 좋은 시간적 부드러움, 그리고 긴 시퀀스를 생성하는 능력에서 뛰어납니다.

MimicMotion의 작동 원리

MimicMotion은 참조 이미지와 포즈 가이던스를 입력으로 받습니다. 그 후 제공된 동작 시퀀스를 따라 참조 이미지의 외형에 맞는 비디오를 생성합니다.

MimicMotion의 강력한 성능을 가능하게 하는 몇 가지 주요 혁신:

- 신뢰도 인식 포즈 가이던스: 포즈 신뢰도 정보를 통합함으로써, MimicMotion은 더 나은 시간적 부드러움을 달성하고, 노이즈가 있는 학습 데이터에 더 강인해집니다. 이는 일반화에 도움이 됩니다.

- 지역 손실 증폭: 특히 손과 같은 고신뢰도 포즈 영역에 손실을 집중시켜, 생성된 비디오에서 이미지 왜곡을 크게 줄입니다.

- 점진적 잠재 융합: 부드럽고 긴 비디오를 효율적으로 생성하기 위해, MimicMotion은 겹치는 프레임을 가진 비디오 세그먼트를 생성하고 점진적으로 그들의 잠재 표현을 융합합니다. 이를 통해 제어된 계산 비용으로 임의의 길이의 비디오를 생성할 수 있습니다.

모델은 먼저 대규모 비디오 데이터셋에서 사전 학습되고, 그 후 동작 모방 작업을 위해 미세 조정됩니다. 이 효율적인 학습 파이프라인은 대량의 특수화된 데이터를 필요로 하지 않습니다.

ComfyUI MimicMotion 사용 방법 (ComfyUI-MimicMotionWrapper)

ComfyUI에서 사용할 수 있는 다양한 MimicMotion 노드를 테스트한 후, 우리는 를 사용하여 최고의 결과를 얻을 것을 권장합니다.

1단계: MimicMotion을 위한 입력 준비

ComfyUI MimicMotion으로 애니메이션을 시작하려면 두 가지 주요 재료가 필요합니다:

- 참조 이미지: 이는 애니메이션의 시작점이 되는 초기 프레임입니다. 애니메이트하고 싶은 주제를 명확하게 보여주는 이미지를 선택하세요.

- 포즈 이미지: 이는 동작 시퀀스를 정의하는 이미지입니다. 각 포즈 이미지는 애니메이션의 특정 시점에서 주제의 원하는 위치나 포즈를 보여줘야 합니다. 포즈 이미지를 수동으로 만들거나 비디오에서 포즈를 추출하는 포즈 추정 도구를 사용할 수 있습니다.

🌟참조 이미지와 포즈 이미지가 최적의 결과를 위해 동일한 해상도와 종횡비를 가지도록 하세요.🌟

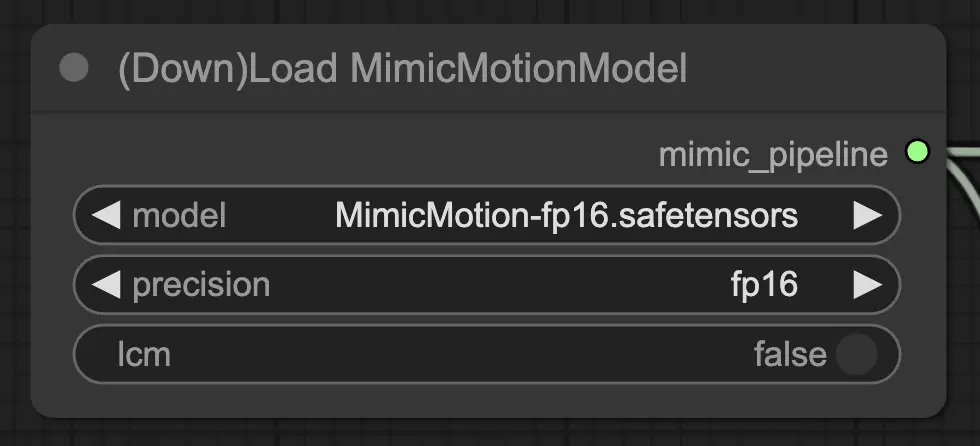

2단계: MimicMotion 모델 로딩

ComfyUI MimicMotion은 제대로 작동하기 위해 MimicMotion 모델을 필요로 합니다. RunComfy에서는 모델이 편의를 위해 미리 로드되어 있습니다. "DownLoadMimicMotionModel" 노드를 구성하려면 다음 단계를 따르세요:

- "model" 매개변수를 "MimicMotion-fp16.safetensors" (또는 다른 모델 파일 이름이 다를 경우 해당 이름)로 설정하세요.

- GPU 성능에 따라 원하는 정밀도(fp32, fp16, 또는 bf16)를 선택하세요. 이 선택은 성능과 호환성에 영향을 미칠 수 있습니다.

- LCM(잠재 조건 동작) 모델 변형을 사용하려는 경우가 아니면 "lcm" 매개변수를 False로 두세요.

노드 설정을 구성한 후, "DownloadAndLoadMimicMotionModel" 노드의 출력을 워크플로우의 다음 노드 입력에 연결하세요. 이렇게 하면 로드된 MimicMotion 모델이 ComfyUI 파이프라인의 후속 단계에서 제대로 사용됩니다.

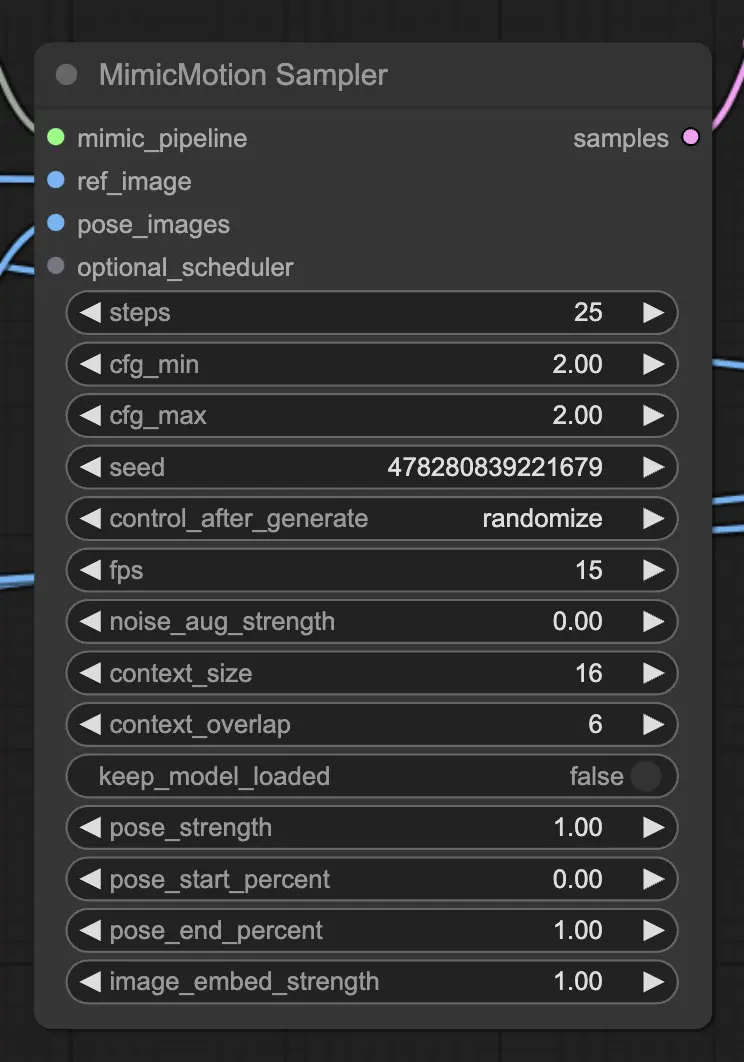

3단계: MimicMotion 샘플러 구성

"MimicMotionSampler" 노드는 입력을 기반으로 애니메이트된 프레임을 생성하는 역할을 합니다. 다음과 같이 설정하세요:

- "MimicMotionSampler" 노드를 추가하고 "DownloadAndLoadMimicMotionModel" 노드의 출력에 연결하세요.

- "ref_image" 매개변수를 참조 이미지로 설정하고, "pose_images" 매개변수를 포즈 이미지 시퀀스로 설정하세요.

- 샘플링 설정을 기호에 맞게 조정하세요:

- "steps"는 확산 단계 수를 결정합니다 (값이 높을수록 결과가 부드러워지지만 처리 시간이 길어짐).

- "cfg_min" 및 "cfg_max"는 조건부 가이던스의 강도를 제어합니다 (값이 높을수록 포즈 이미지에 더 가깝게 따름).

- "seed"는 재현성을 위한 랜덤 시드를 설정합니다.

- "fps"는 생성된 애니메이션의 초당 프레임 수를 지정합니다.

- "noise_aug_strength", "context_size", "context_overlap"과 같은 추가 매개변수를 조정하여 다양한 스타일과 시간적 일관성을 실험해보세요.

4단계: 잠재 샘플 디코딩

"MimicMotionSampler" 노드는 애니메이트된 프레임의 잠재 공간 표현을 출력합니다. 이러한 잠재 샘플을 실제 이미지로 변환하려면 "MimicMotionDecode" 노드를 사용해야 합니다:

- "MimicMotionDecode" 노드를 추가하고 "MimicMotionSampler" 노드의 출력에 연결하세요.

- "decode_chunk_size" 매개변수를 설정하여 동시에 디코딩되는 프레임 수를 제어합니다 (높은 값은 더 많은 GPU 메모리를 소비할 수 있음). "MimicMotionDecode" 노드의 출력은 이미지 형식의 최종 애니메이트된 프레임이 됩니다.

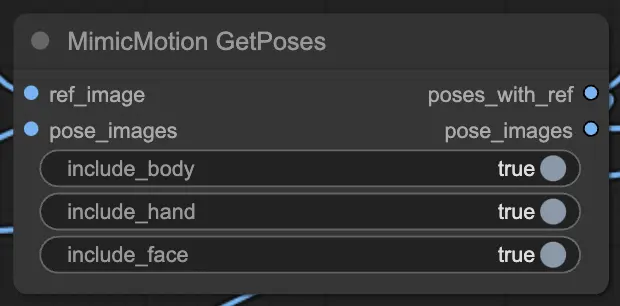

5단계: MimicMotionGetPoses로 포즈 향상

참조 이미지와 함께 추출된 포즈를 시각화하려면 "MimicMotionGetPoses" 노드를 사용할 수 있습니다:

- "ref_image" 및 "pose_images"를 "MimicMotionGetPoses" 노드에 연결하세요.

- "include_body", "include_hand", "include_face" 매개변수를 설정하여 표시할 포즈 키포인트를 제어합니다. 출력에는 추출된 포즈와 함께 참조 이미지 및 개별 포즈 이미지가 포함됩니다.

팁과 모범 사례

ComfyUI MimicMotion을 최대한 활용하기 위한 몇 가지 팁:

- 다양한 참조 이미지와 포즈 시퀀스를 실험하여 다양한 애니메이션을 만드세요.

- 품질과 처리 시간의 균형을 맞추기 위해 샘플링 설정을 조정하세요.

- 최고의 결과를 위해 고품질의 일관된 포즈 이미지를 사용하세요. 포즈 간의 시점이나 조명 변화가 너무 큰 것을 피하세요.

- 고해상도 이미지나 긴 애니메이션을 작업할 때 GPU 메모리 사용량을 모니터링하세요.

- "DiffusersScheduler" 노드를 활용하여 고유한 효과를 위한 노이즈 스케줄링을 사용자 정의하세요.

ComfyUI MimicMotion은 놀라운 애니메이션을 손쉽게 생성할 수 있는 강력하고 다재다능한 도구입니다. 워크플로우를 이해하고 다양한 매개변수를 탐색함으로써 누구나 쉽게 애니메이션을 만들 수 있습니다. 애니메이션 세계에 발을 들이면서, 실험하고 반복하며 과정을 즐기세요. ComfyUI MimicMotion으로 창의적인 비전을 실현하는 것은 무한한 가능성을 가지고 있으므로, 창작의 즐거움을 만끽하세요!