Mochi Edit UnSampling | Vídeo-para-Vídeo

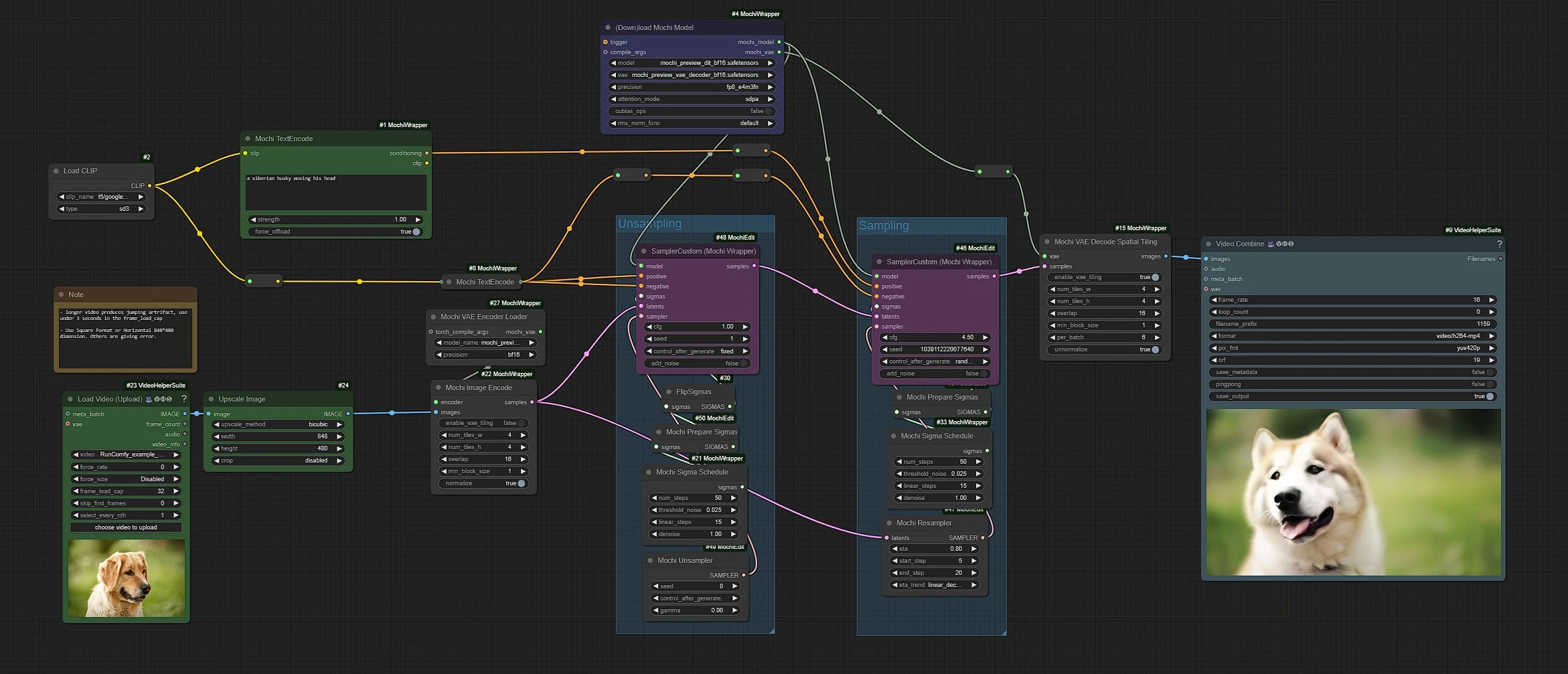

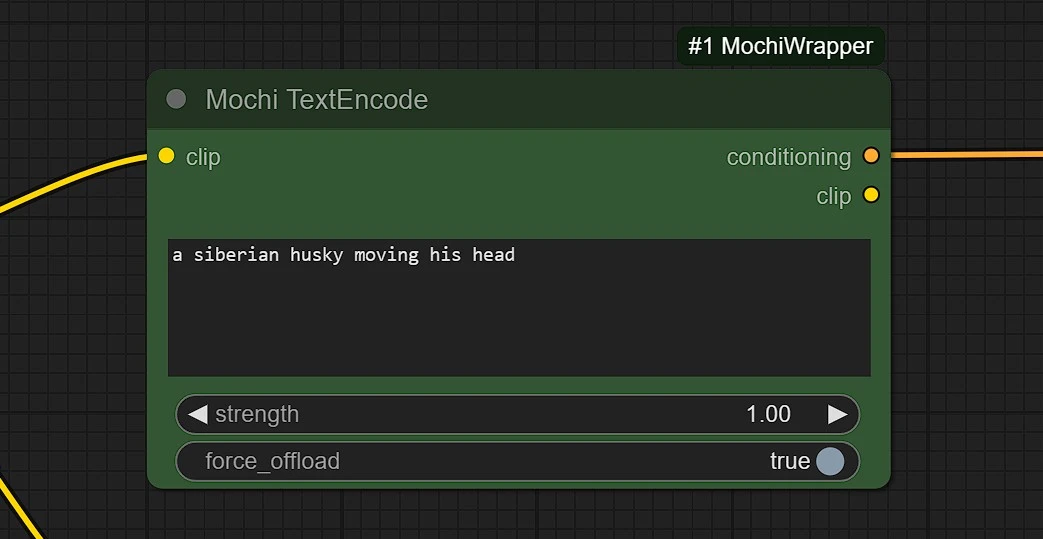

O Mochi Edit utiliza o Genmo Mochi e técnicas baseadas em difusão para transformar quadros de vídeo invertendo-os em ruído e reamostrando-os com edições guiadas por prompts, também conhecidas como unsampling. Com o Mochi Edit perfeitamente integrado ao ComfyUI, os usuários podem alcançar transferência de estilo sem interrupções, modificação de objetos e fluxos de trabalho de edição de animação suaveComfyUI Mochi Edit Fluxo de Trabalho

- Fluxos de trabalho totalmente operacionais

- Sem nós ou modelos ausentes

- Nenhuma configuração manual necessária

- Apresenta visuais impressionantes

ComfyUI Mochi Edit Exemplos

ComfyUI Mochi Edit Descrição

Os nós e seu fluxo de trabalho associado são totalmente desenvolvidos por logtd e Kijai. Damos todo o crédito devido a logtd e Kijai por este trabalho inovador. Na plataforma RunComfy, estamos simplesmente apresentando suas contribuições à comunidade. Apreciamos profundamente o trabalho de logtd e Kijai!

O fluxo de trabalho Mochi Edit é uma ferramenta projetada para permitir que os usuários modifiquem conteúdo de vídeo usando prompts baseados em texto. Ele suporta tarefas como adicionar ou alterar elementos (por exemplo, colocar chapéus em personagens), ajustar o estilo geral ou substituir assuntos dentro do vídeo.

1. Mochi Edit Unsampling

No cerne do Mochi Edit está sua técnica de unsampling. A técnica de unsampling do Mochi Edit aproveita uma abordagem simplificada para editar vídeos e imagens, permitindo transformações através de prompts multimodais sem exigir etapas adicionais de pré-processamento ou módulos de rede externos. A ideia central por trás da técnica de unsampling do Mochi Edit é manipular diretamente a representação latente do vídeo, em vez de realizar operações complexas como detecção de rosto ou estimativa de pose, comuns em pipelines tradicionais de geração de imagens. Este método está alinhado com o objetivo mais amplo de criar um processo de geração de imagens mais flexível e simplificado, semelhante à capacidade do GPT de gerar texto a partir de qualquer prompt de entrada. Com a técnica de unsampling do Mochi Edit, os usuários podem gerar vários estilos e modificações diretamente a partir de uma descrição multimodal, tornando o processo muito mais intuitivo e eficiente.

Em resumo, o Mochi Edit permite que você crie pequenas variações do vídeo que você carrega. Como copiar e traduzir o movimento do sujeito para outro sujeito ou alterar configurações de fundo, mudar propriedades do sujeito..etc

2. Como Usar o Fluxo de Trabalho Mochi Edit?

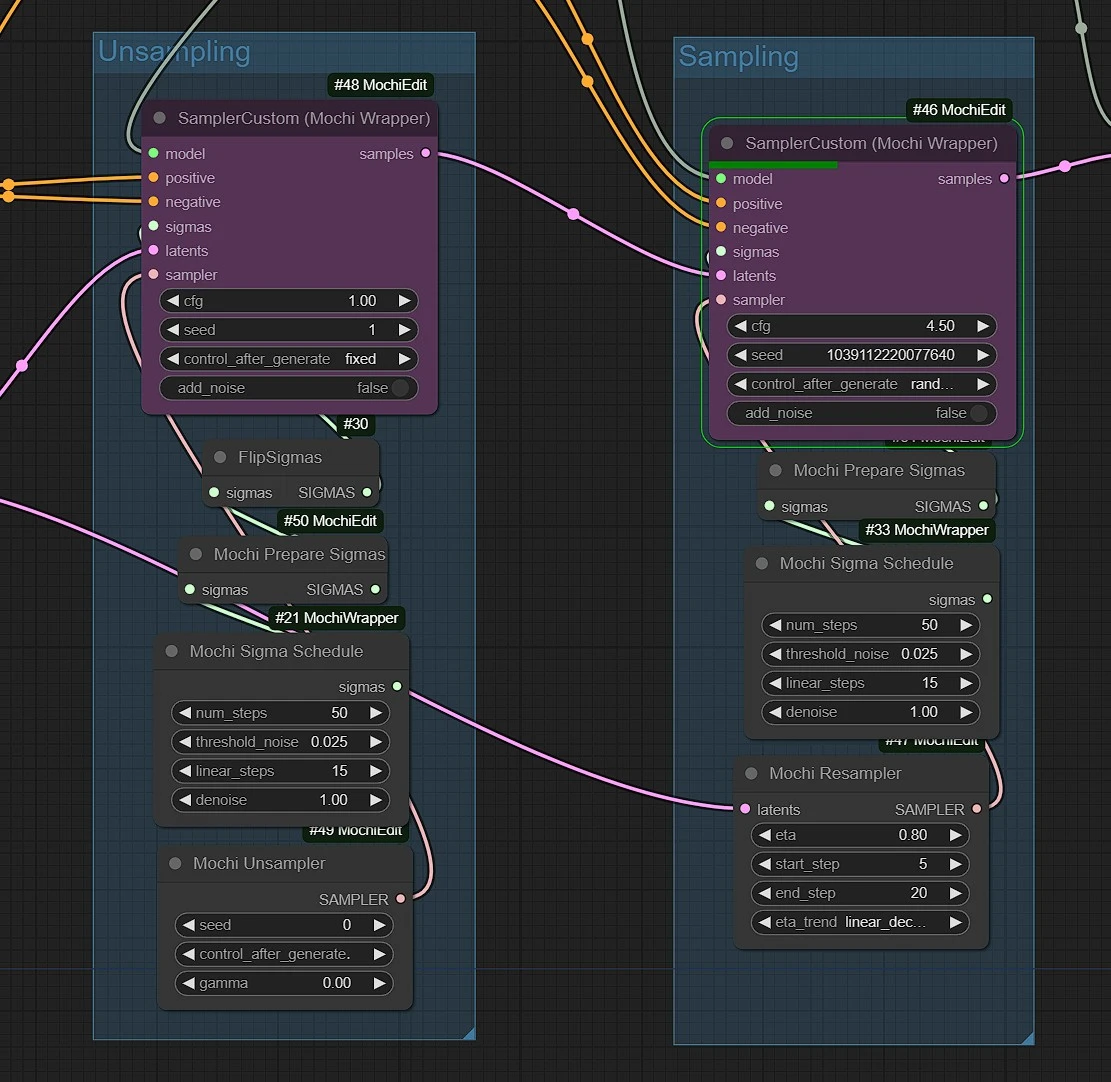

Neste fluxo de trabalho, os nós Verdes à Esquerda são as entradas para Vídeo e texto, os nós Roxos no Meio são os nós de unsampler e sampler do mochi, e o Azul à Direita é o nó de saída de vídeo.

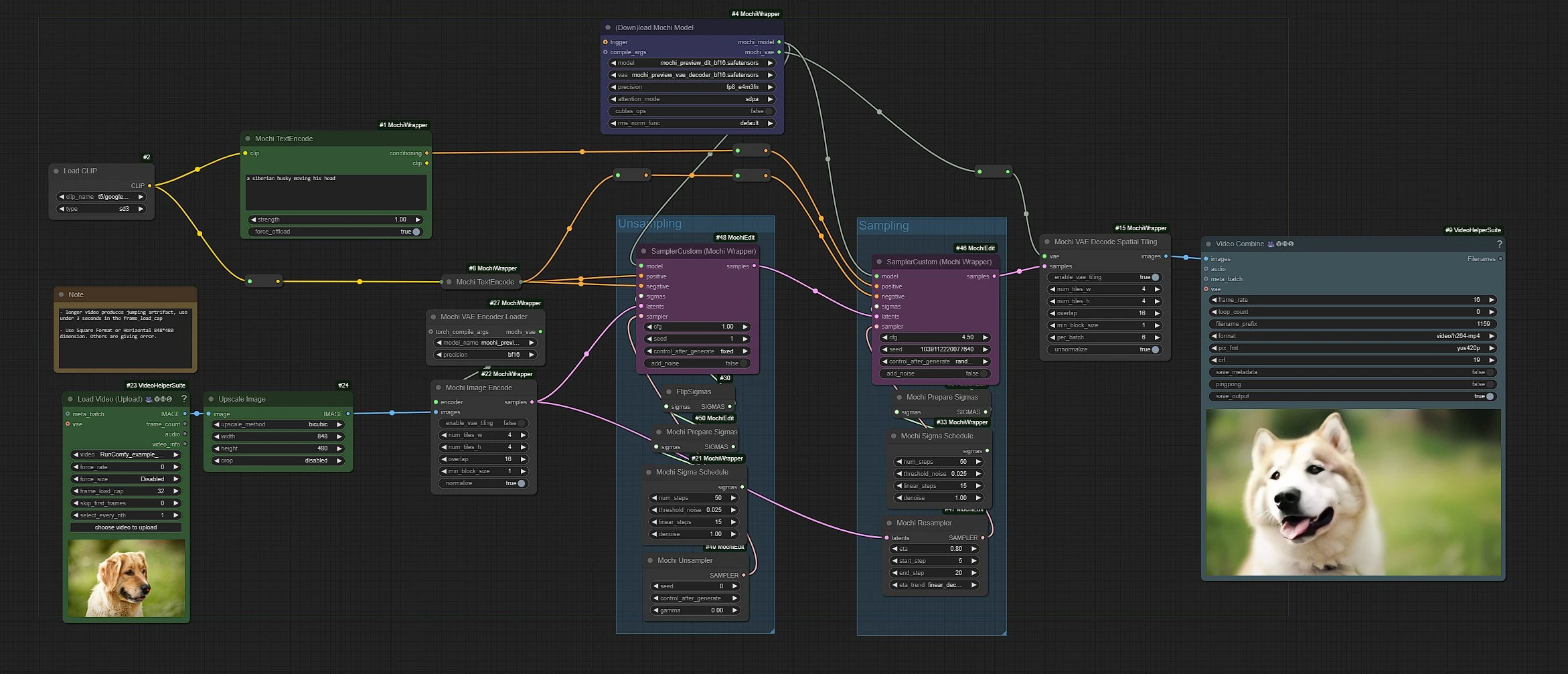

2.1 Carregar Nó de Vídeo

- Clique e Carregue seu vídeo no nó de carregar vídeo

frame_load_cap: é padrão para 32 quadros. Acima de 32 quadros, são observados artefatos de salto. Mantenha abaixo de 3 segundos (32) quadros para melhores resultados.skip_frames: Pule quadros se você quiser começar a partir de um quadro específico

Use Formato Quadrado (512 x 512) ou Horizontal (848 x 480) na dimensão de upscale. Outros estão dando erro.

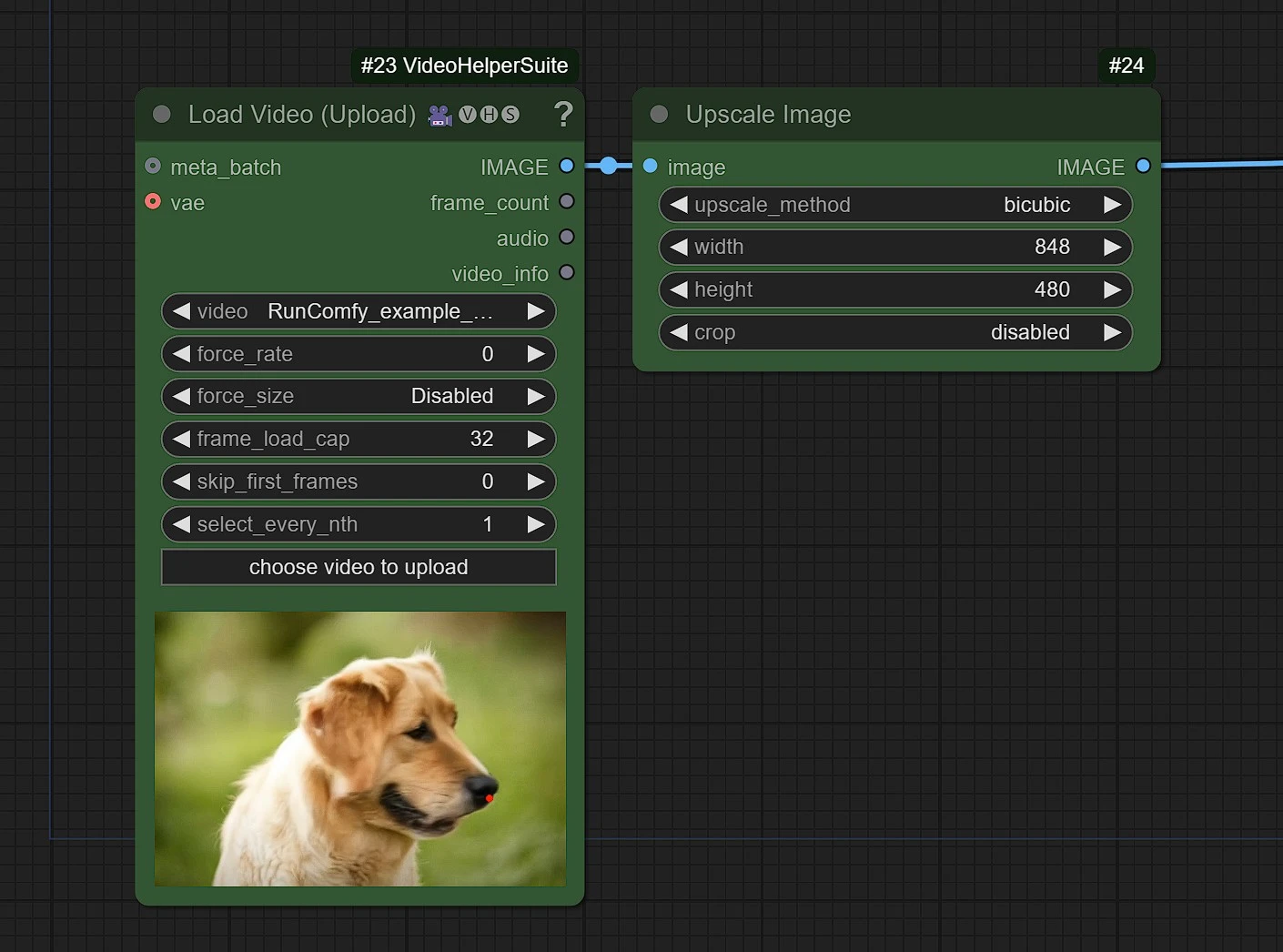

2.2 Prompts

Este é um uso experimental, às vezes pode funcionar ou às vezes não ou às vezes mudar completamente o vídeo original.

- Use pequena variação do sujeito como prompt.

- Variação forte pode distorcer e mudar completamente a imagem.

- Tente diferentes sementes se você não estiver obtendo resultados adequados.

2.3 Grupos de Nós de Amostragem e Unsampling

Os Ksamplers de Amostragem e Unsampling estão configurados para a melhor configuração pelo autor. Se as configurações forem editadas vagamente, podem resultar em resultados estranhos indesejáveis. Sinta-se à vontade para brincar com:

Seeddo Sampler para variaçõesnum_stepselinear_steppara alterar a qualidade ou velocidade de renderização.eta,start_stepeend_Steppara alterar a força do unsampling, início e fim percentual.

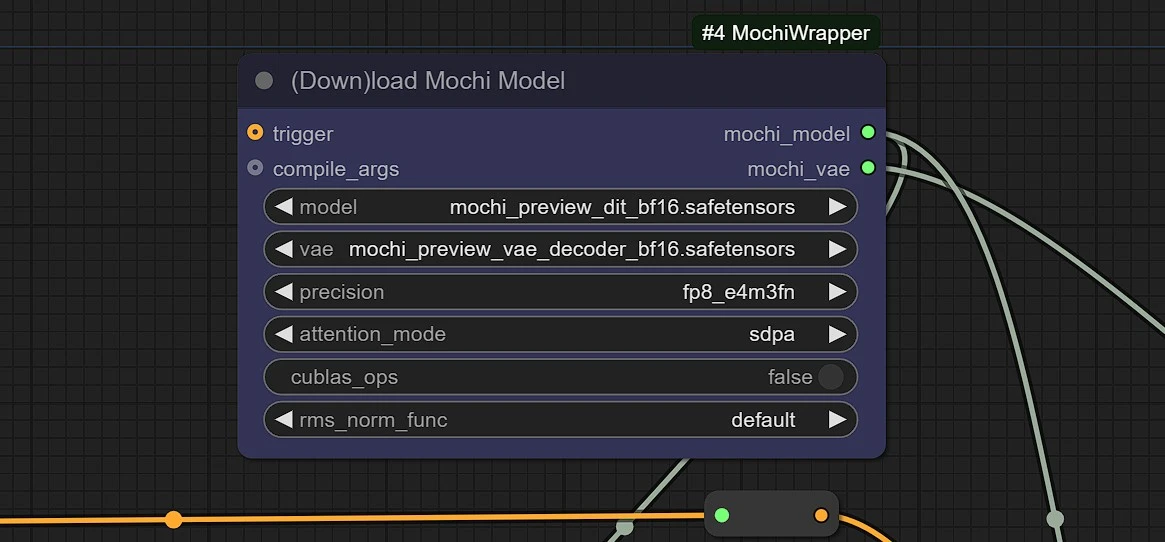

2.4 Modelos Mochi

Os modelos são baixados deste em seu comfyui automaticamente. Levará cerca de 5-10 minutos para baixar o modelo de 10,3 GB pela primeira vez.

A técnica de unsampling do Mochi Edit revoluciona a edição de vídeos e imagens ao simplificar o processo e remover a necessidade de pré-processamento complexo ou módulos adicionais. Esta abordagem inovadora capacita os usuários a gerar visuais personalizados de alta qualidade sem esforço através de prompts multimodais. Ao combinar flexibilidade e acessibilidade, o Mochi Edit abre caminho para um futuro de geração de imagens mais intuitivo e criativo.