Stable Diffusion 3 (SD3) | 文本到图像

Stable Diffusion 3 (SD3) 媒介现已在 RunComfy Beta 版本中随时可用,使其易于您的项目访问。您可以在此工作流程中直接使用 Stable Diffusion 3 媒介,或将 Stable Diffusion 3 集成到您的现有工作流程中。ComfyUI Stable Diffusion 3 (SD3) Playground

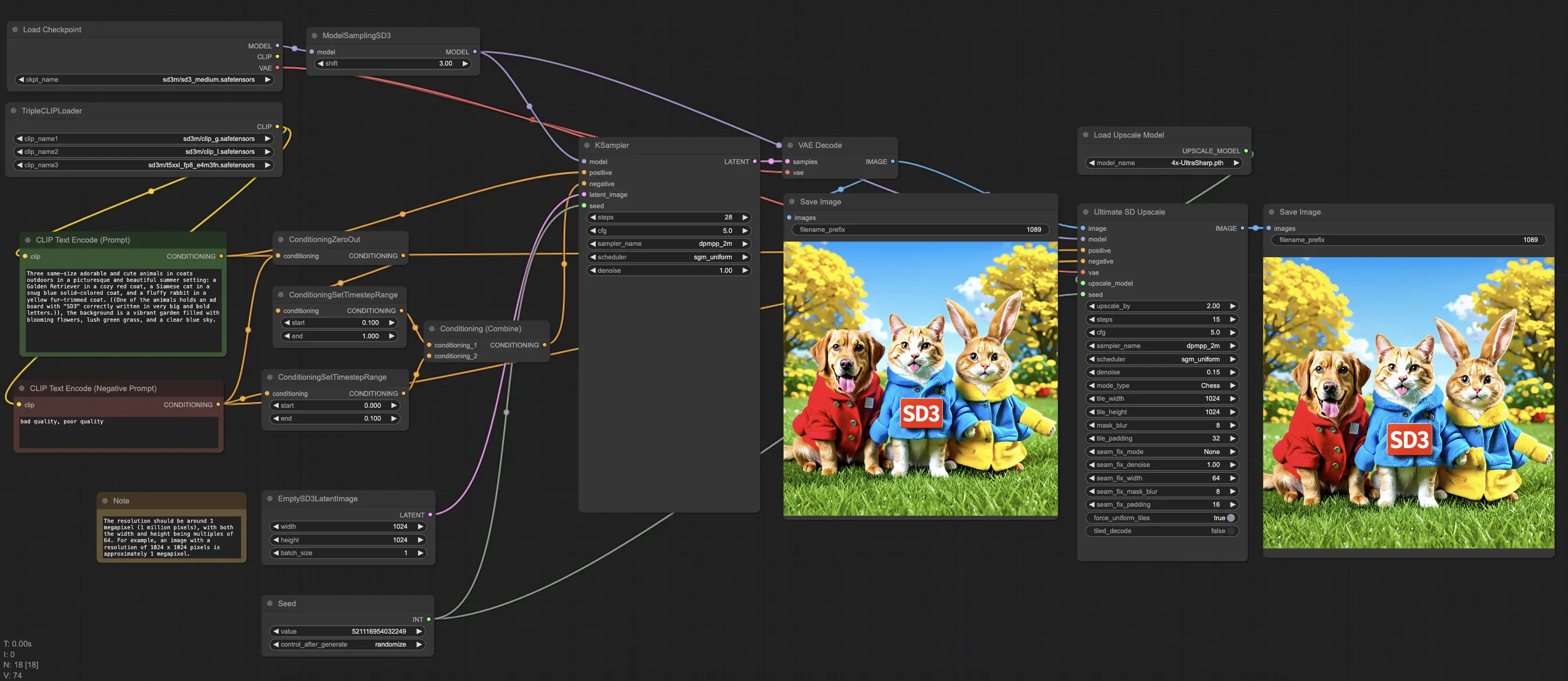

ComfyUI Stable Diffusion 3 (SD3) 工作流程

ComfyUI Stable Diffusion 3 (SD3) 示例

ComfyUI Stable Diffusion 3 (SD3) 描述

1. 使用 ComfyUI Stable Diffusion 3 提升您的创意流程

🌟🌟🌟**Stable Diffusion 3 媒介模型及其相关节点现已预加载到 RunComfy 的 ComfyUI Beta 版本 (Version 24.06.13.0) 中!!!**🌟🌟🌟 您可以在此 ComfyUI 工作流程中直接使用 Stable Diffusion 3 媒介,或将其无缝集成到您的现有 ComfyUI 工作流程中。

ComfyUI Stable Diffusion 3 工作流程包含所有必要的 Stable Diffusion 3 媒介模型。只需尝试不同的提示或参数即可体验它!

1.1. ComfyUI 中预加载的 Stable Diffusion 3 媒介模型

sd3_medium.safetensors:包含 MMDiT 和 VAE 权重,但不包含任何文本编码器。sd3_medium_incl_clips_t5xxlfp16.safetensors:包含所有必要权重,包括 T5XXL 文本编码器的 fp16 版本。sd3_medium_incl_clips_t5xxlfp8.safetensors:包含所有必要权重,包括 T5XXL 文本编码器的 fp8 版本,提供质量和资源需求之间的平衡。sd3_medium_incl_clips.safetensors:包含所有必要权重,但不包括 T5XXL 文本编码器。此版本需要最少的资源,但没有 T5XXL 文本编码器,模型的性能会有所不同。text_encoders文件夹包含三个文本编码器及其原始模型卡链接,方便用户使用。此文件夹中的所有组件(及其嵌入在其他包中的等效组件)均受其各自原始许可证的约束。

1.2 Stable Diffusion 3 媒介的整体质量和写实性

Stable Diffusion 3 媒介为 AI 艺术社区设立了新的图像质量标准。此模型提供了卓越的细节、色彩准确性和逼真的光照效果。以下是您可以期待的内容:

- 细节与分辨率:增强了渲染复杂细节的能力,非常适合特写和复杂的构图。

- 色彩与光照:改进的算法确保色彩鲜艳且逼真,动态光照效果为您的图像增添深度和现实感。

- 面部和手部的真实感:常见的失真手部和面部问题大大减少,得益于 16 通道变分自编码器 (VAE) 等创新。

1.3 Stable Diffusion 3 媒介的提示理解

SD3 媒介的一个突出特点是其复杂的提示理解能力。此模型可以解释包含空间推理、构图元素、动作和风格的长而复杂的提示。以下是一些亮点:

- 文本编码器:利用三个文本编码器平衡性能和效率。这允许对详细提示的细致理解和执行。

- 构图意识:能够保持空间关系并准确描绘场景,使其成为通过视觉讲故事的理想选择。

1.4 Stable Diffusion 3 媒介的排版

排版一直是文本到图像生成中的一个挑战。SD3 媒介在这方面取得了显著成功:

- 文本质量:在拼写、字距、字母形成和间距方面达到了前所未有的准确性。

- 扩散变压器架构:这种先进的架构能够更精确地在图像中渲染文本,减少错误并提高视觉一致性。

1.5 Stable Diffusion 3 媒介的资源效率

尽管具有先进的功能,SD3 媒介设计为资源高效:

- 低 VRAM 占用:可以在标准消费者 GPU 上运行而不会出现性能下降,使高质量的 AI 艺术对更广泛的受众可访问。

- 优化效率:在计算需求与输出质量之间取得平衡,确保即使在不太强大的硬件上也能平稳运行。

1.6 Stable Diffusion 3 媒介的微调

自定义是 AI 艺术家的关键方面,SD3 媒介在这方面表现出色:

- 吸收细微差别:能够用小数据集进行微调,允许艺术家印上其独特风格或满足特定项目需求。

- 多功能性:无论您是专注于特定主题、风格还是复杂细节,SD3 媒介都提供了个性化艺术创作所需的灵活性。

2. 什么是 Stable Diffusion 3

Stable Diffusion 3 是一种专门设计用于从提示生成图像的尖端 AI 模型。它是 Stable Diffusion 系列的第三次迭代,旨在提供比早期版本和其他模型(如 DALL·E 3、Midjourney v6 和 Ideogram v1)更高的准确性、更好地遵循提示的细微差别以及更优越的视觉美学。

3. Stable Diffusion 3 模型

Stable Diffusion 3 提供了三种不同的模型,每种模型都旨在满足不同的需求和计算能力:

3.1 Stable Diffusion 3 媒介

🌟🌟🌟 直接集成到此工作流程中 🌟🌟🌟

- 参数:20 亿

- 主要特点:

- 高质量、写实的图像

- 复杂提示的高级理解

- 优越的排版能力

- 资源高效,适用于消费者 GPU

- 适合用小数据集进行微调

3.2 Stable Diffusion 3 大型

通过 提供

- 参数:80 亿

- 主要特点:

- 增强的图像质量和细节

- 更大的处理复杂提示和风格的能力

- 适用于需要高分辨率和保真度的专业级项目

3.3 Stable Diffusion 3 大型 Turbo

通过 提供

- 参数:80 亿(具有优化的推理时间)

- 主要特点:

- 与 SD3 大型相同的高性能

- 更快的推理速度,适用于实时应用和快速原型制作

4. Stable Diffusion 3 的技术架构

Stable Diffusion 3 的核心是多模态扩散变压器 (MMDiT) 架构。此创新框架增强了模型处理和整合文本和视觉信息的方式。与其前身使用单一神经网络权重集处理图像和文本不同,Stable Diffusion 3 为每种模态分别使用单独的权重集。这种分离允许更专业地处理文本和图像数据,从而提高生成图像中的文本理解和拼写准确性。

4.1 MMDiT 架构的组件

- 文本嵌入器:Stable Diffusion 3 使用三种文本嵌入模型的组合,包括两个 CLIP 模型和 T5,将文本转换为 AI 可以理解和处理的格式。

- 图像编码器:使用增强的自动编码模型将图像转换为适合 AI 操作和生成新视觉内容的形式。

- 双变压器方法:该架构具有用于文本和图像的两个独立变压器,它们独立运行但在注意力操作上相互连接。这种设置允许两种模态直接影响彼此,从而增强文本输入和图像输出之间的一致性。

5. Stable Diffusion 3 的新改进

- 遵循提示:SD3 在紧密遵循用户提示的细节方面表现出色,特别是涉及复杂场景或多主体的提示。这种理解和渲染详细提示的精度使其在需要严格遵循指示的项目中优于其他领先模型,如 DALL·E 3、Midjourney v6 和 Ideogram v1,使其在需要严格遵循指示的项目中高度可靠。

- 图像中的文本:凭借其先进的多模态扩散变压器 (MMDiT) 架构,SD3 显著提高了图像中文字的清晰度和可读性。通过为处理图像和语言数据分别使用单独的权重集,模型实现了更好的文本理解和拼写准确性。这是对早期版本 Stable Diffusion 的重大改进,解决了文本到图像 AI 应用中的常见挑战。

- 视觉质量:SD3 不仅匹配而且在许多情况下超越了其竞争对手生成的图像质量。生成的图像不仅美观,而且由于模型精炼的解释和可视化文本描述的能力,保持了对提示的高保真度。这使得 SD3 成为寻求在生成图像中实现卓越视觉美学的用户的首选。

有关模型的详细见解,请访问 。