FLUX LoRA Training

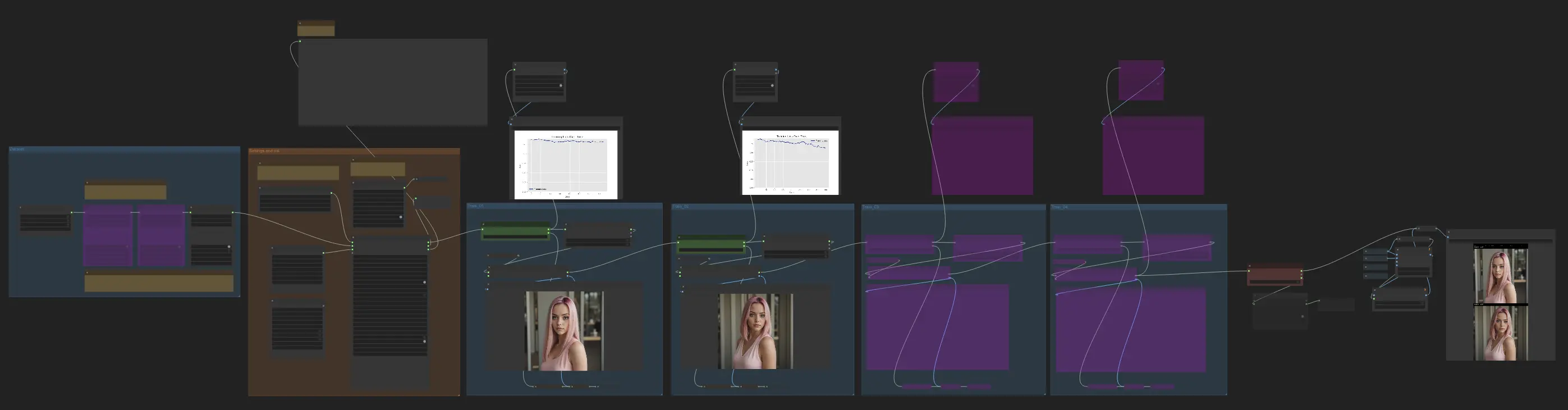

Dieser ComfyUI FLUX LoRA Training-Workflow ermöglicht es Ihnen, vorab vorhandene FLUX-Modelle mit Ihren eigenen Datensätzen fein abzustimmen. Mit dieser detaillierten Anleitung lernen Sie, wie Sie Ihre Trainingsdaten vorbereiten, den Workflow einrichten, wesentliche Parameter konfigurieren und den Trainingsprozess durchführen. Entfesseln Sie das volle Potenzial der FLUX AI-Modelle und erstellen Sie maßgeschneiderte Ausgaben, die perfekt zu Ihrer Vision passen.ComfyUI FLUX LoRA Training Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI FLUX LoRA Training Beispiele

ComfyUI FLUX LoRA Training Beschreibung

FLUX LoRA hat in der AI-Community immense Popularität erlangt, insbesondere bei denen, die AI-Modelle mit ihren eigenen Datensätzen feinabstimmen möchten. Dieser Ansatz ermöglicht es Ihnen, vorab vorhandene FLUX-Modelle mühelos an Ihre einzigartigen Datensätze anzupassen, was ihn hochgradig anpassbar und effizient für eine Vielzahl kreativer Unternehmungen macht. Wenn Sie bereits mit ComfyUI vertraut sind, wird die Verwendung des ComfyUI FLUX LoRA Training-Workflows zum Trainieren Ihres FLUX LoRA-Modells ein Kinderspiel sein. Der Workflow und die zugehörigen Knoten wurden von Kijai erstellt, daher ein großes Dankeschön an ihn für seinen Beitrag! Schauen Sie sich für weitere Informationen an.

ComfyUI FLUX LoRA Training Tutorial

Der ComfyUI FLUX LoRA Training-Workflow ist ein leistungsstarker Prozess, der für das Training von FLUX LoRA-Modellen entwickelt wurde. Das Training mit ComfyUI bietet mehrere Vorteile, insbesondere für Benutzer, die bereits mit seiner Benutzeroberfläche vertraut sind. Mit FLUX LoRA Training können Sie dieselben Modelle verwenden, die auch für Inferenz verwendet werden, sodass keine Kompatibilitätsprobleme auftreten, wenn Sie im selben Python-Umfeld arbeiten. Darüber hinaus können Sie Workflows erstellen, um verschiedene Einstellungen zu vergleichen und so Ihren Trainingsprozess zu verbessern. Dieses Tutorial führt Sie durch die Schritte zur Einrichtung und Nutzung von FLUX LoRA Training in ComfyUI.

Wir werden folgende Themen behandeln:

- Vorbereitung Ihres Datensatzes für FLUX LoRA Training

- Der FLUX LoRA Trainingsprozess

- Durchführung des FLUX LoRA Trainings

- Wie und wo man die FLUX- und FLUX LoRA-Modelle verwendet

1. Vorbereitung Ihres Datensatzes für FLUX LoRA Training

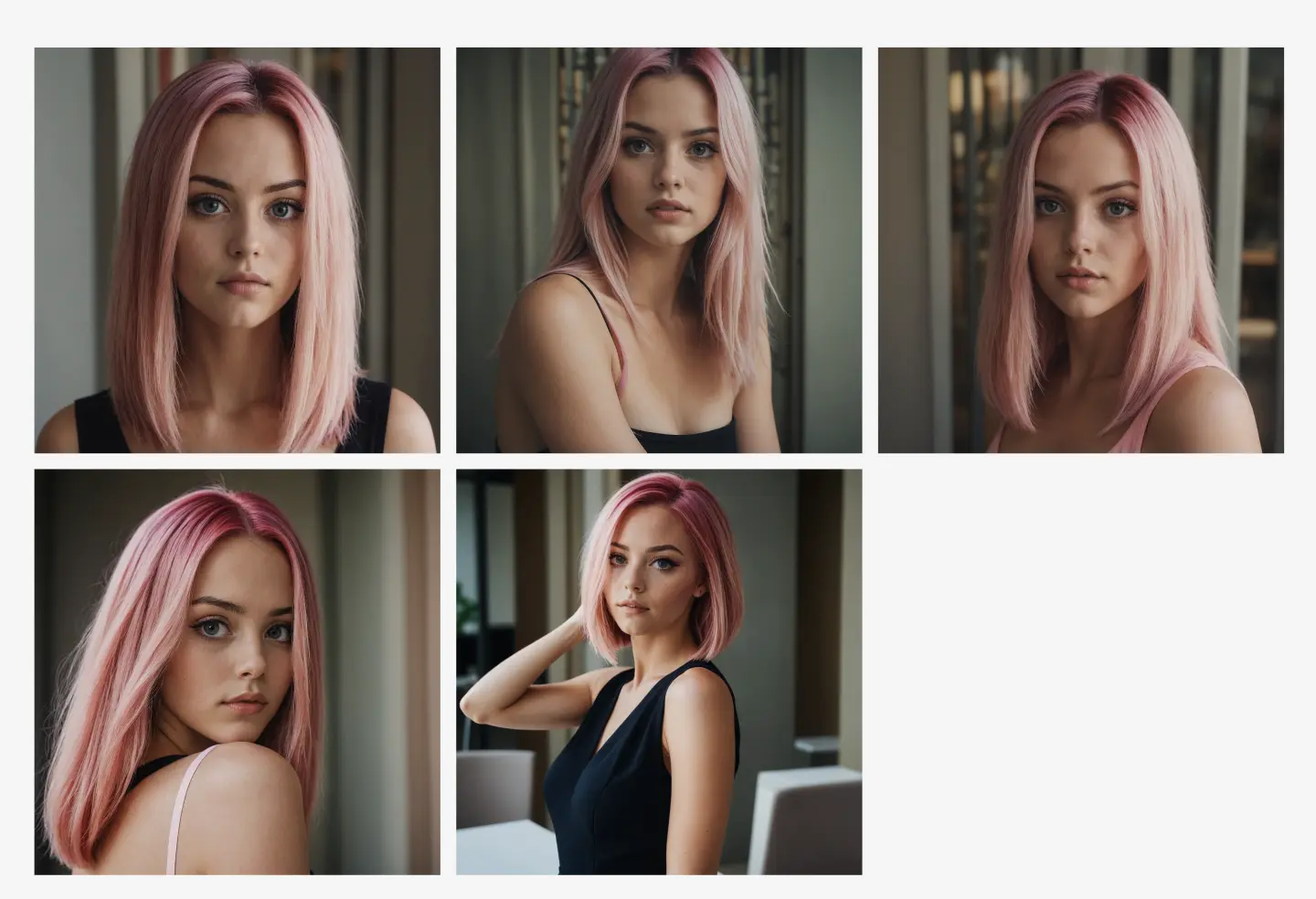

Bei der Vorbereitung Ihrer Trainingsdaten für FLUX LoRA Training ist es wichtig, hochqualitative Bilder Ihres Zielobjekts zu haben.

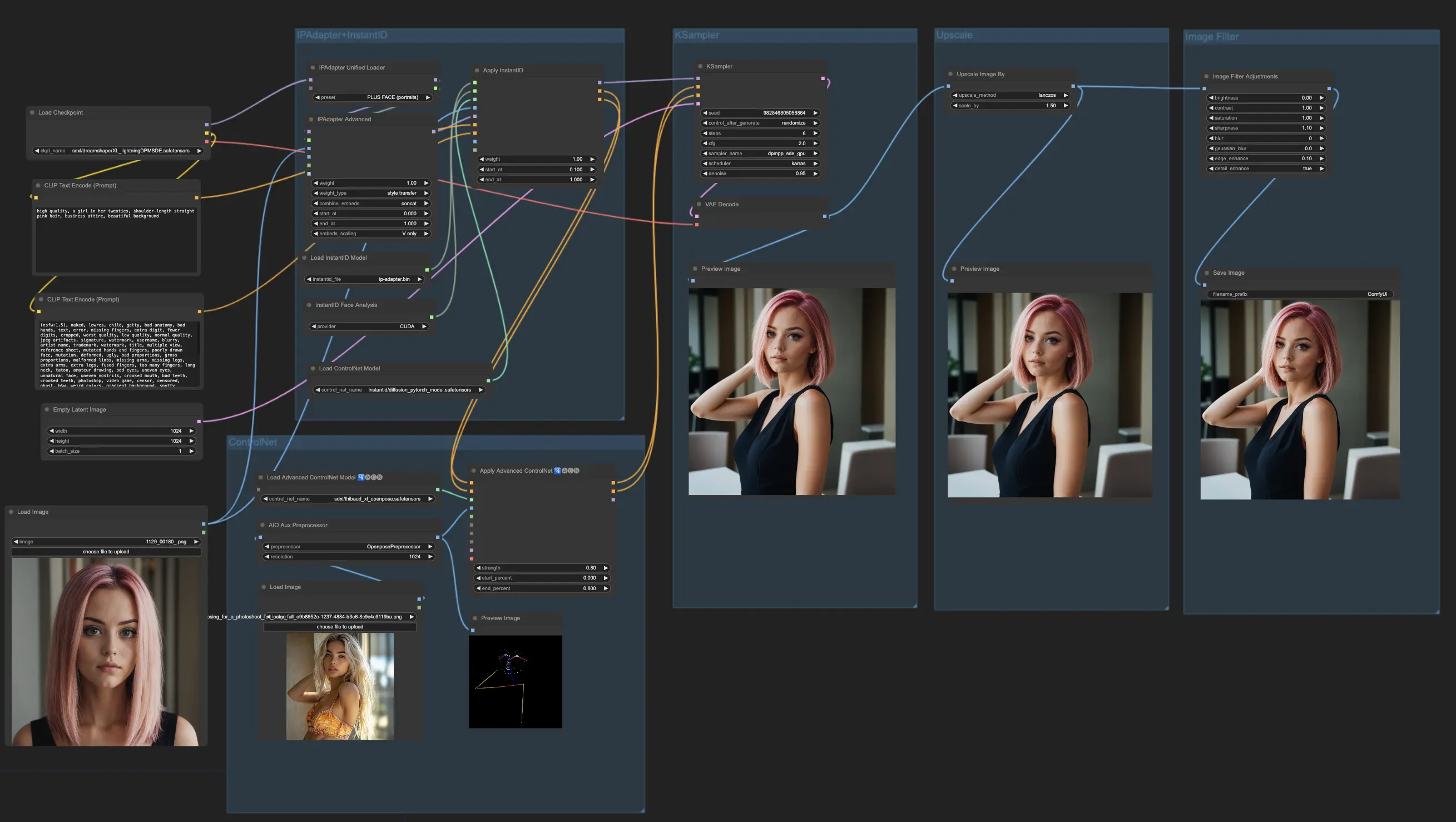

In diesem Beispiel trainieren wir ein FLUX LoRA-Modell, um Bilder eines bestimmten Influencers zu generieren. Dazu benötigen Sie eine Reihe von hochqualitativen Bildern des Influencers in verschiedenen Posen und Umgebungen. Eine praktische Möglichkeit, diese Bilder zu sammeln, ist die Verwendung des , der es einfach macht, eine Sammlung von Bildern zu erstellen, die denselben Charakter in verschiedenen Posen zeigen und dabei dessen Aussehen konsistent halten. Für unseren Trainingsdatensatz haben wir fünf hochqualitative Bilder des Influencers in verschiedenen Posen und Umgebungen ausgewählt, um sicherzustellen, dass der Datensatz robust genug ist, damit FLUX LoRA Training die komplexen Details lernen kann, die für konsistente und genaue Ausgaben erforderlich sind.

Prozess zur Beschaffung von Trainingsdaten

Beispiel für Trainingsdaten

Sie können auch Ihren eigenen Datensatz basierend auf Ihren spezifischen Bedürfnissen sammeln——FLUX LoRA Training ist flexibel und funktioniert mit verschiedenen Datentypen.

2. Der FLUX LoRA Trainingsprozess

Der FLUX LoRA Training-Workflow besteht aus mehreren wichtigen Knoten, die zusammenarbeiten, um Ihr Modell zu trainieren und zu validieren. Hier ist eine detaillierte Übersicht über die Hauptknoten, unterteilt in drei Teile: Datensatz, Einstellungen und Init, und Training.

2.1. Setzen Sie Datensätze für FLUX LoRA Training

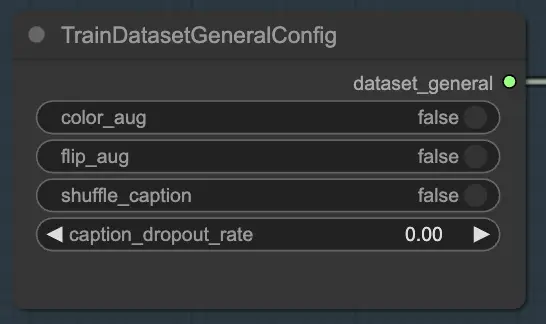

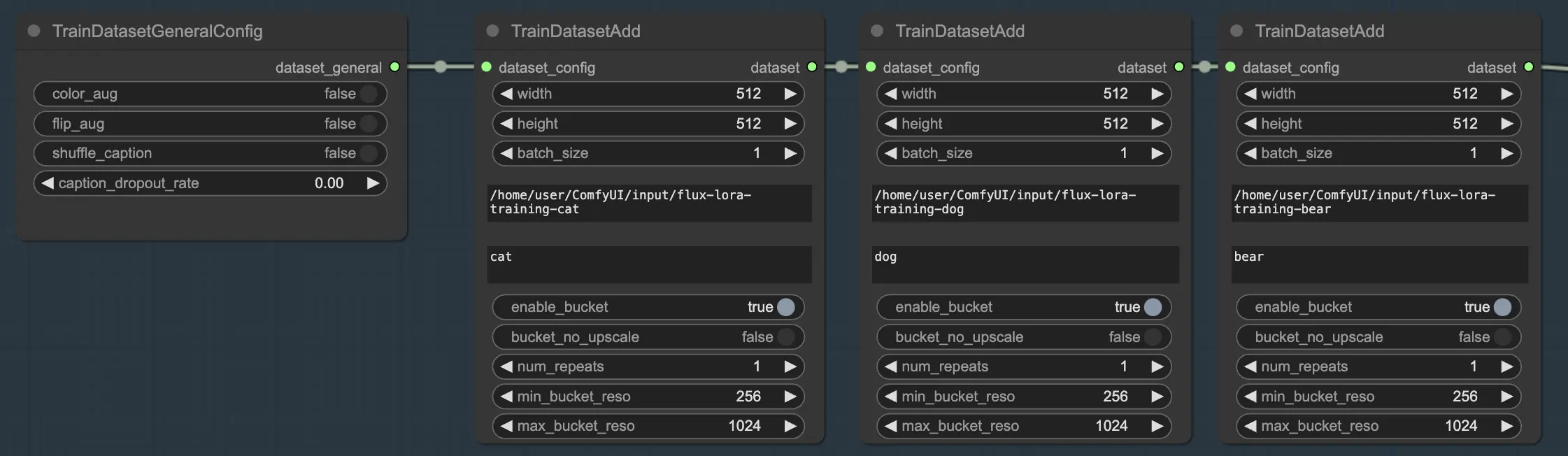

Der Datensatzabschnitt besteht aus zwei wesentlichen Knoten, die Ihnen helfen, Ihre Trainingsdaten zu konfigurieren und anzupassen: TrainDatasetGeneralConfig und TrainDatasetAdd.

2.1.1. TrainDatasetGeneralConfig

Der TrainDatasetGeneralConfig Knoten ist der Ort, an dem Sie die allgemeinen Einstellungen für Ihren Trainingsdatensatz in FLUX LoRA Training definieren. Dieser Knoten gibt Ihnen die Kontrolle über verschiedene Aspekte der Datenaugmentation und -vorverarbeitung. Beispielsweise können Sie wählen, ob Sie die Farbaugmentation aktivieren oder deaktivieren möchten, was die Fähigkeit des Modells zur Generalisierung über verschiedene Farbvariationen hinweg verbessern kann. Ebenso können Sie die Flip-Augmentation umschalten, um Bilder horizontal zufällig zu spiegeln und so vielfältigere Trainingsproben bereitzustellen. Darüber hinaus haben Sie die Möglichkeit, die Beschriftungen zu mischen, die mit jedem Bild verbunden sind, um Zufälligkeit einzuführen und Überanpassung zu reduzieren. Die Caption Dropout Rate ermöglicht es Ihnen, während des Trainings zufällig Beschriftungen wegzulassen, was das Modell robuster gegenüber fehlenden oder unvollständigen Beschriftungen machen kann.

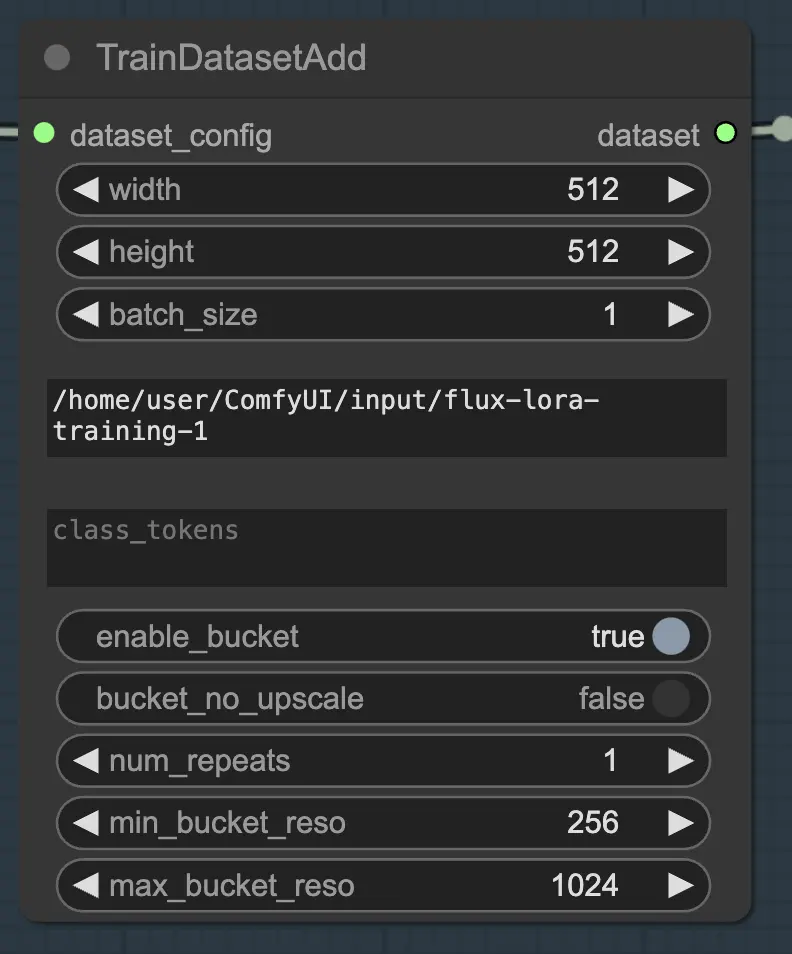

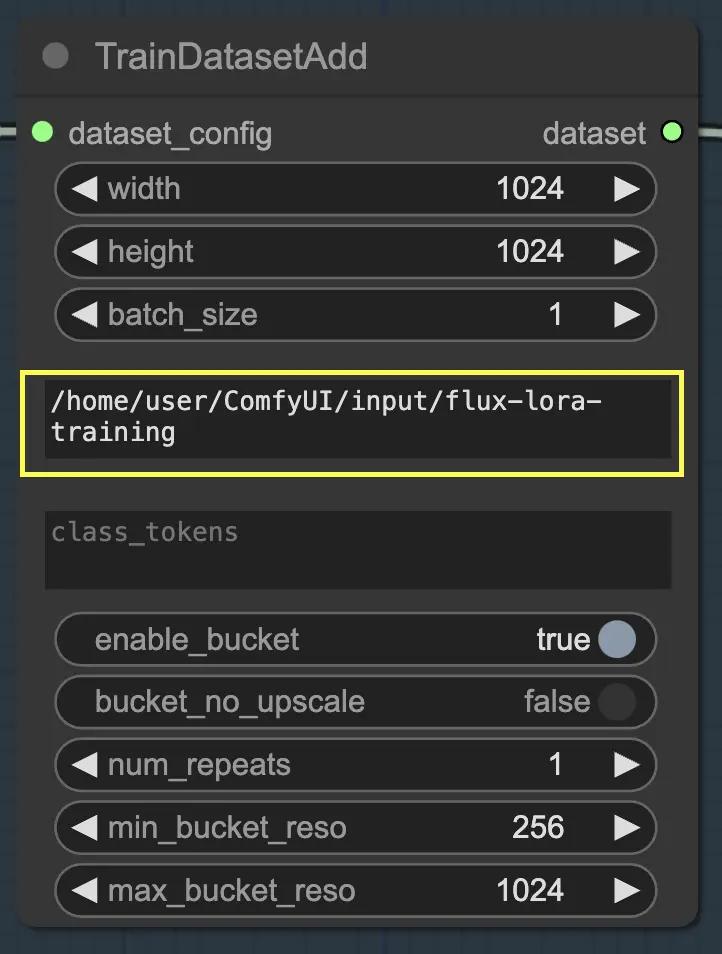

2.1.2. TrainDatasetAdd

Der TrainDatasetAdd Knoten ist der Ort, an dem Sie die Details jedes einzelnen Datensatzes angeben, der in Ihr FLUX LoRA Training einbezogen werden soll.

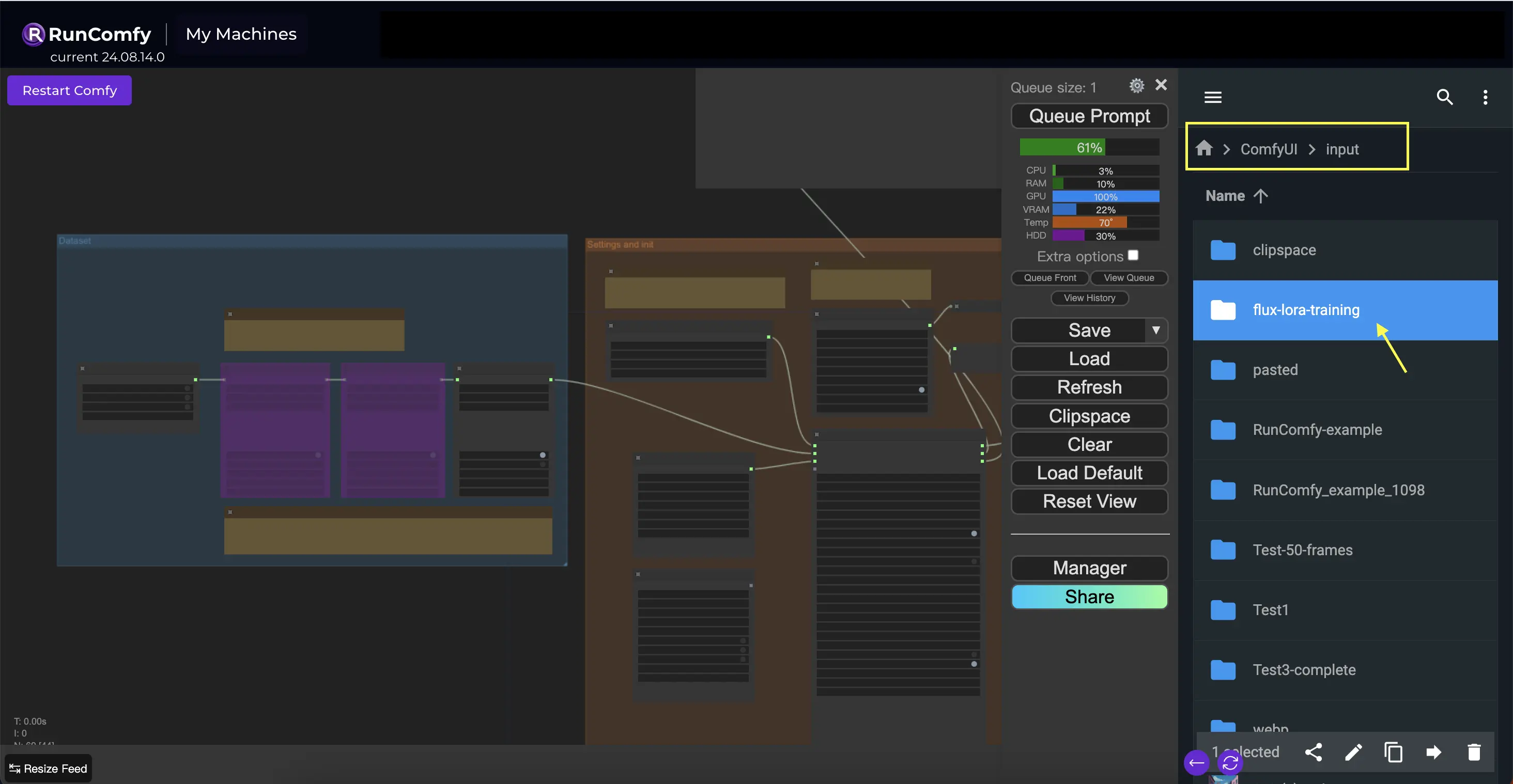

Eingabeverzeichnis: Train Dataset Path

Um das Beste aus diesem Knoten herauszuholen, ist es wichtig, Ihre Trainingsdaten richtig zu organisieren. Wenn Sie den Dateibrowser von RunComfy verwenden, platzieren Sie die Trainingsdaten im Verzeichnis /home/user/ComfyUI/input/{file-name}, wobei {file-name} ein bedeutungsvoller Name ist, den Sie Ihrem Datensatz zuweisen.

Sobald Sie Ihre Trainingsdaten im entsprechenden Verzeichnis platziert haben, müssen Sie den Pfad zu diesem Verzeichnis im image_dir Parameter des TrainDatasetAdd Knotens angeben. Dies teilt dem Knoten mit, wo er Ihre Trainingsbilder findet.

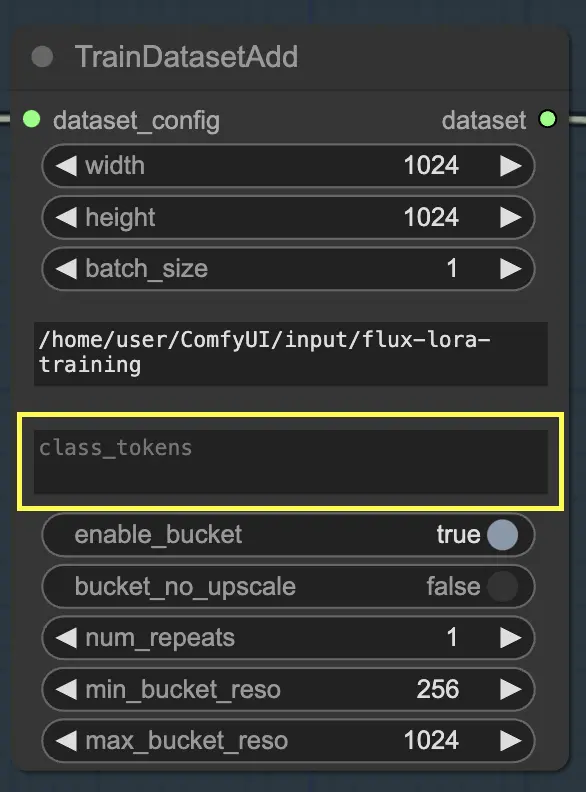

Class Token

Wenn Ihr Datensatz von der Verwendung spezifischer Klassentokens oder Triggerwörter profitiert, können Sie diese im class_tokens Parameter eingeben. Klassentokens sind spezielle Wörter oder Phrasen, die jeder Beschriftung vorangestellt werden und den Generierungsprozess des Modells leiten. Wenn Sie beispielsweise einen Datensatz mit verschiedenen Tierarten trainieren, könnten Sie Klassentokens wie "dog", "cat" oder "bird" verwenden, um das gewünschte Tier in den generierten Bildern anzugeben. Wenn Sie später diese Klassentokens in Ihren Aufforderungen verwenden, können Sie steuern, welche spezifischen Aspekte das Modell generieren soll.

Setzen Sie die Auflösung (Breite und Höhe), Batch-Größe

Zusätzlich zu den Parametern image_dir und class_tokens bietet der TrainDatasetAdd Knoten mehrere andere Optionen zur Feinabstimmung Ihres Datensatzes. Sie können die Auflösung (Breite und Höhe) der Bilder festlegen, die Batch-Größe für das Training angeben und die Anzahl der Wiederholungen des Datensatzes pro Epoche bestimmen.

Mehrere Datensätze

Eine der leistungsstarken Funktionen von FLUX LoRA Training ist die nahtlose Kombination mehrerer Datensätze. Im FLUX LoRA Training-Workflow sind drei TrainDatasetAdd Knoten in Folge verbunden. Jeder Knoten stellt einen eigenen Datensatz mit eigenen Einstellungen dar. Durch das Verknüpfen dieser Knoten können Sie einen reichen und vielfältigen Trainingssatz erstellen, der Bilder und Beschriftungen aus verschiedenen Quellen einbezieht.

Um dies zu veranschaulichen, betrachten wir ein Szenario, in dem Sie drei separate Datensätze haben: einen für Katzen, einen für Hunde und einen weiteren für Bären. Sie können drei TrainDatasetAdd-Knoten einrichten, von denen jeder einem dieser Datensätze gewidmet ist. Im ersten Knoten würden Sie den Pfad zum "cats"-Datensatz im image_dir Parameter angeben, das class token auf "cat" setzen und andere Parameter wie Auflösung und Batch-Größe anpassen, um Ihren Bedürfnissen zu entsprechen. Ebenso würden Sie den zweiten und dritten Knoten für die "dogs"- und "bears"-Datensätze konfigurieren.

Dieser Ansatz ermöglicht es dem FLUX LoRA Training-Prozess, eine Vielzahl von Bildern zu nutzen und die Fähigkeit des Modells zur Generalisierung über verschiedene Kategorien hinweg zu verbessern.

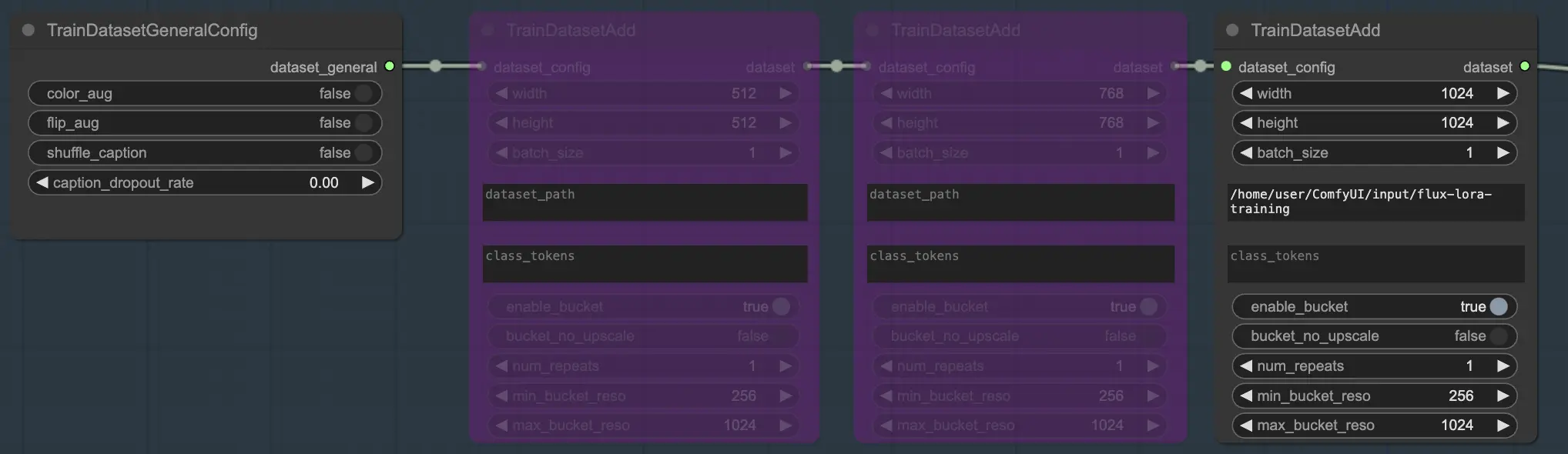

Beispiel

In unserem Beispiel verwenden wir nur einen Datensatz zum Trainieren des Modells, daher aktivieren wir einen TrainDatasetAdd Knoten und umgehen die anderen beiden. So können Sie es einrichten:

2.2. Einstellungen und Initialisierung

Der Abschnitt Einstellungen und Initialisierung ist der Ort, an dem Sie die wichtigen Komponenten und Parameter für FLUX LoRA Training konfigurieren. Dieser Abschnitt umfasst mehrere wesentliche Knoten, die zusammenarbeiten, um Ihre Trainingsumgebung einzurichten.

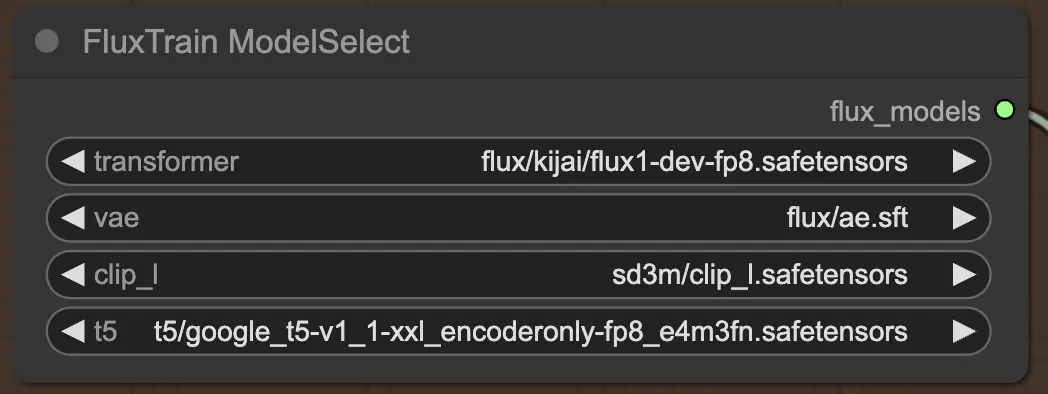

2.2.1. FluxTrainModelSelect

Zuerst haben Sie den FluxTrainModelSelect Knoten, der dafür verantwortlich ist, die FLUX-Modelle auszuwählen, die während des FLUX LoRA Trainings verwendet werden. Dieser Knoten ermöglicht es Ihnen, die Pfade zu vier kritischen Modellen anzugeben: dem Transformer, VAE (Variational Autoencoder), CLIP_L (Contrastive Language-Image Pre-training) und T5 (Text-to-Text Transfer Transformer). Diese Modelle bilden das Rückgrat des FLUX-Trainingsprozesses und wurden alle auf der RunComfy-Plattform eingerichtet.

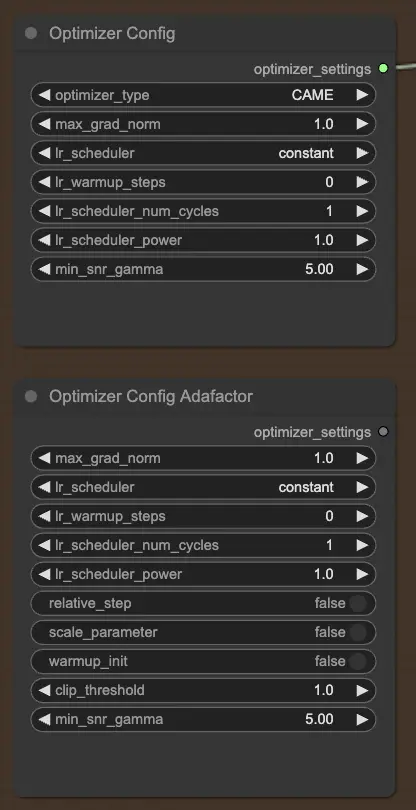

2.2.2. OptimizerConfig

Der OptimizerConfig Knoten ist entscheidend für die Einrichtung des Optimizers innerhalb von FLUX LoRA Training, der bestimmt, wie die Parameter des Modells während des Trainings aktualisiert werden. Sie können den Optimizer-Typ auswählen (z. B. AdamW, CAME), die maximale Gradienten-Norm für das Gradienten-Clipping festlegen, um explodierende Gradienten zu verhindern, und den Lernratenschieber auswählen (z. B. konstant, kosinusanpassend). Darüber hinaus können Sie optimizerspezifische Parameter wie Warmup-Schritte und Scheduler-Leistung feinabstimmen und zusätzliche Argumente für weitere Anpassungen bereitstellen.

Wenn Sie den Adafactor-Optimizer bevorzugen, der für seine Speichereffizienz und seine Fähigkeit, große Modelle zu handhaben, bekannt ist, können Sie stattdessen den OptimizerConfigAdafactor Knoten verwenden.

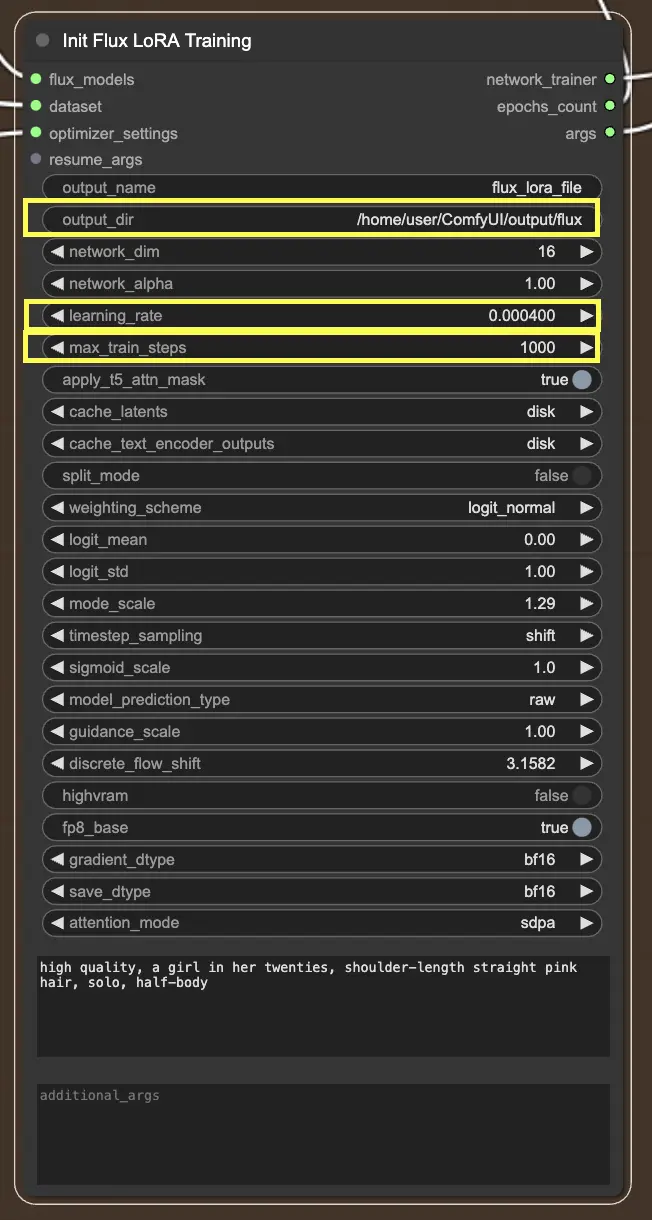

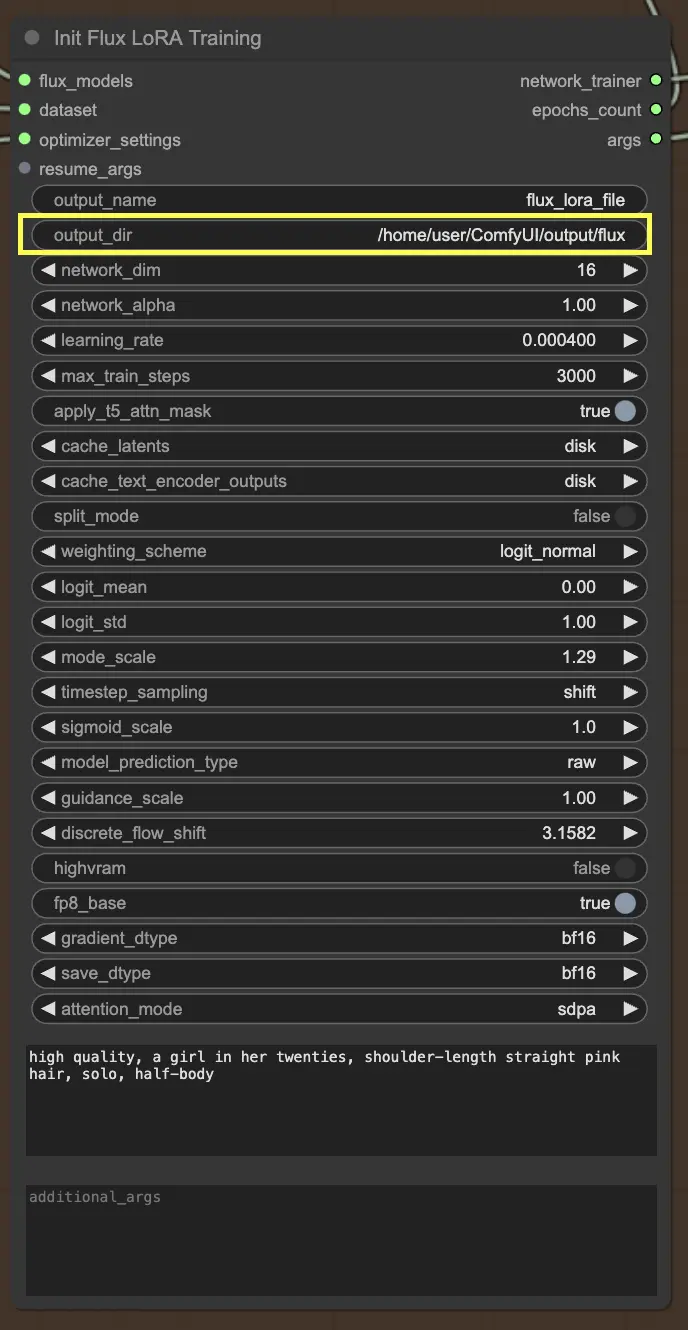

2.2.3. InitFluxLoRATraining

Der InitFluxLoRATraining Knoten ist das zentrale Zentrum, in dem alle wesentlichen Komponenten zusammenlaufen, um den FLUX LoRA Trainingsprozess zu starten.

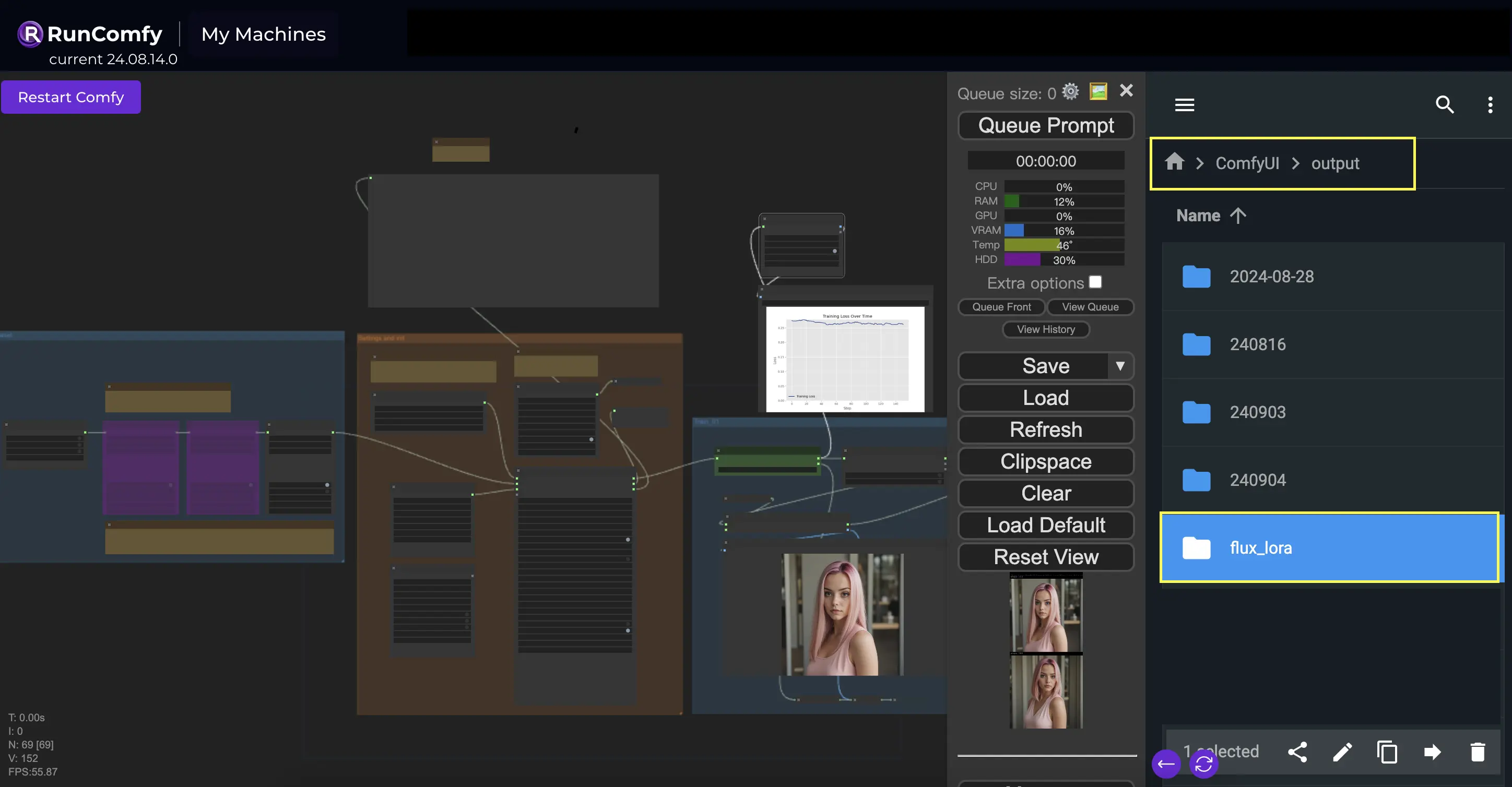

Ausgabeverzeichnis: FLUX LoRA Path

Eine der Schlüsselangaben, die Sie im InitFluxLoRATraining-Knoten angeben müssen, ist das Ausgabeverzeichnis, in dem Ihr trainiertes Modell gespeichert wird. Auf der RunComfy-Plattform können Sie /home/user/ComfyUI/output/{file_name} als Speicherort für Ihre Ausgabe wählen. Sobald das Training abgeschlossen ist, können Sie es im Dateibrowser anzeigen.

Netzwerkdimensionen und Lernraten

Als nächstes sollten Sie die Netzwerkdimensionen und Lernraten festlegen. Die Netzwerkdimensionen bestimmen die Größe und Komplexität Ihres LoRA-Netzwerks, während die Lernraten steuern, wie schnell Ihr Modell lernt und sich anpasst.

Maximale Trainingsschritte

Ein weiterer wichtiger Parameter ist max_train_steps. Dieser bestimmt, wie lange der Trainingsprozess laufen soll, oder mit anderen Worten, wie viele Schritte Ihr Modell unternehmen soll, bevor es vollständig gebacken ist. Sie können diesen Wert basierend auf Ihren spezifischen Bedürfnissen und der Größe Ihres Datensatzes anpassen. Es geht darum, den Sweet Spot zu finden, an dem Ihr Modell genug gelernt hat, um köstliche Ausgaben zu produzieren!

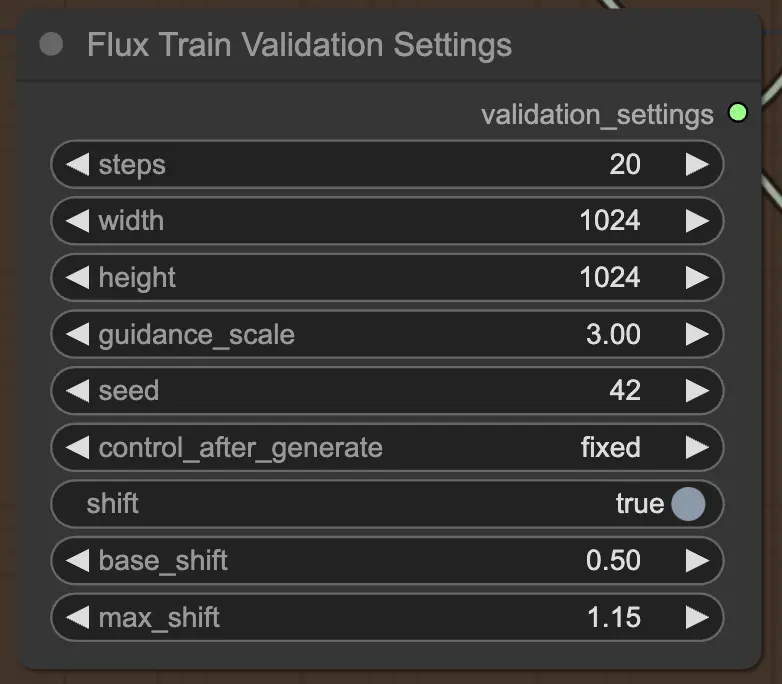

2.3.4. FluxTrainValidationSettings

Schließlich ermöglicht Ihnen der FluxTrainValidationSettings Knoten, die Validierungseinstellungen zur Bewertung der Leistung Ihres Modells während des FLUX LoRA Trainingsprozesses zu konfigurieren. Sie können die Anzahl der Validierungsschritte, die Bildgröße, die Führungsskala und den Seed für die Reproduzierbarkeit festlegen. Darüber hinaus können Sie die Methode zur Zeitschrittabtastung wählen und die Sigmoid-Skala und die Shift-Parameter anpassen, um die Zeitschrittplanung zu steuern und die Qualität der generierten Bilder zu verbessern.

3. Trainieren

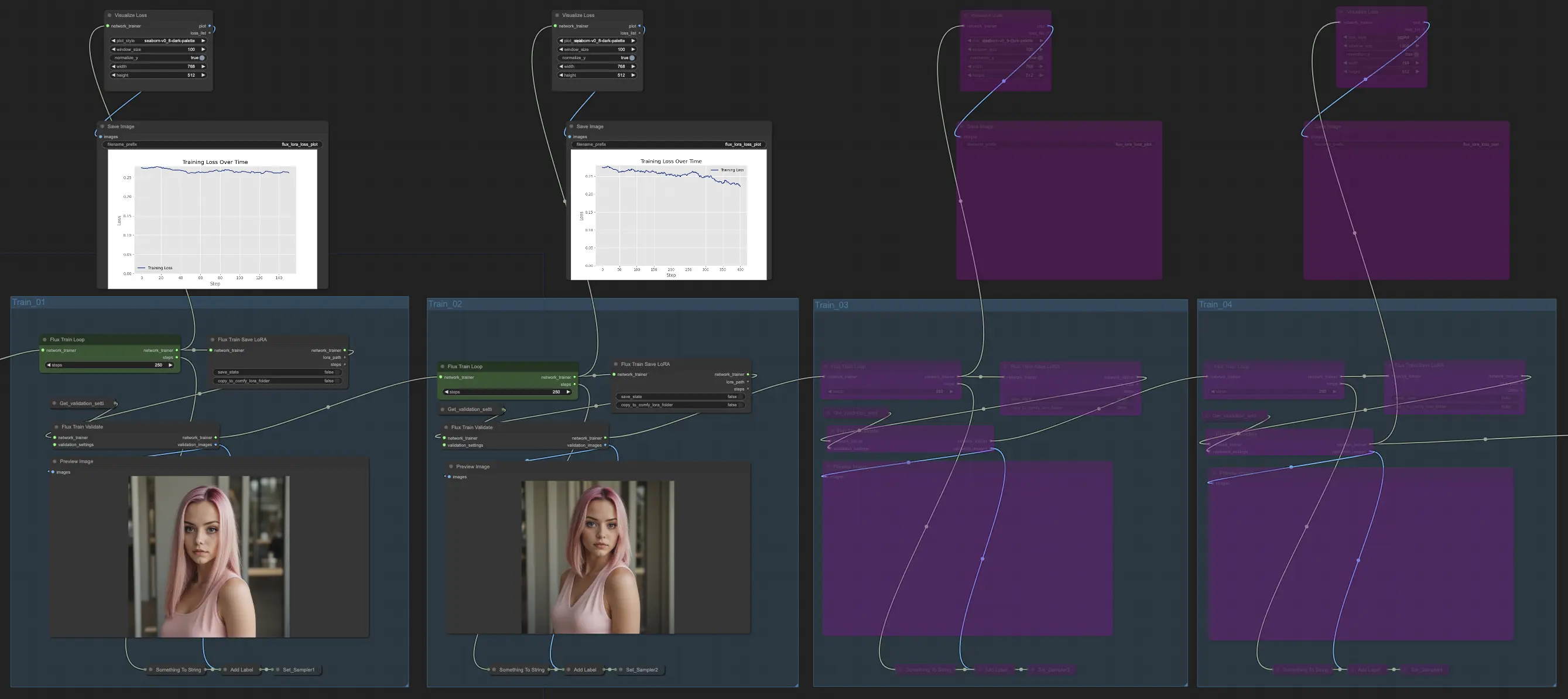

Der Trainieren-Abschnitt von FLUX LoRA Training ist der Ort, an dem die Magie passiert. Er ist in vier Teile unterteilt: Train_01, Train_02, Train_03 und Train_04. Jeder dieser Teile stellt eine andere Stufe im FLUX LoRA Trainingsprozess dar und ermöglicht es Ihnen, Ihr Modell schrittweise zu verfeinern und zu verbessern.

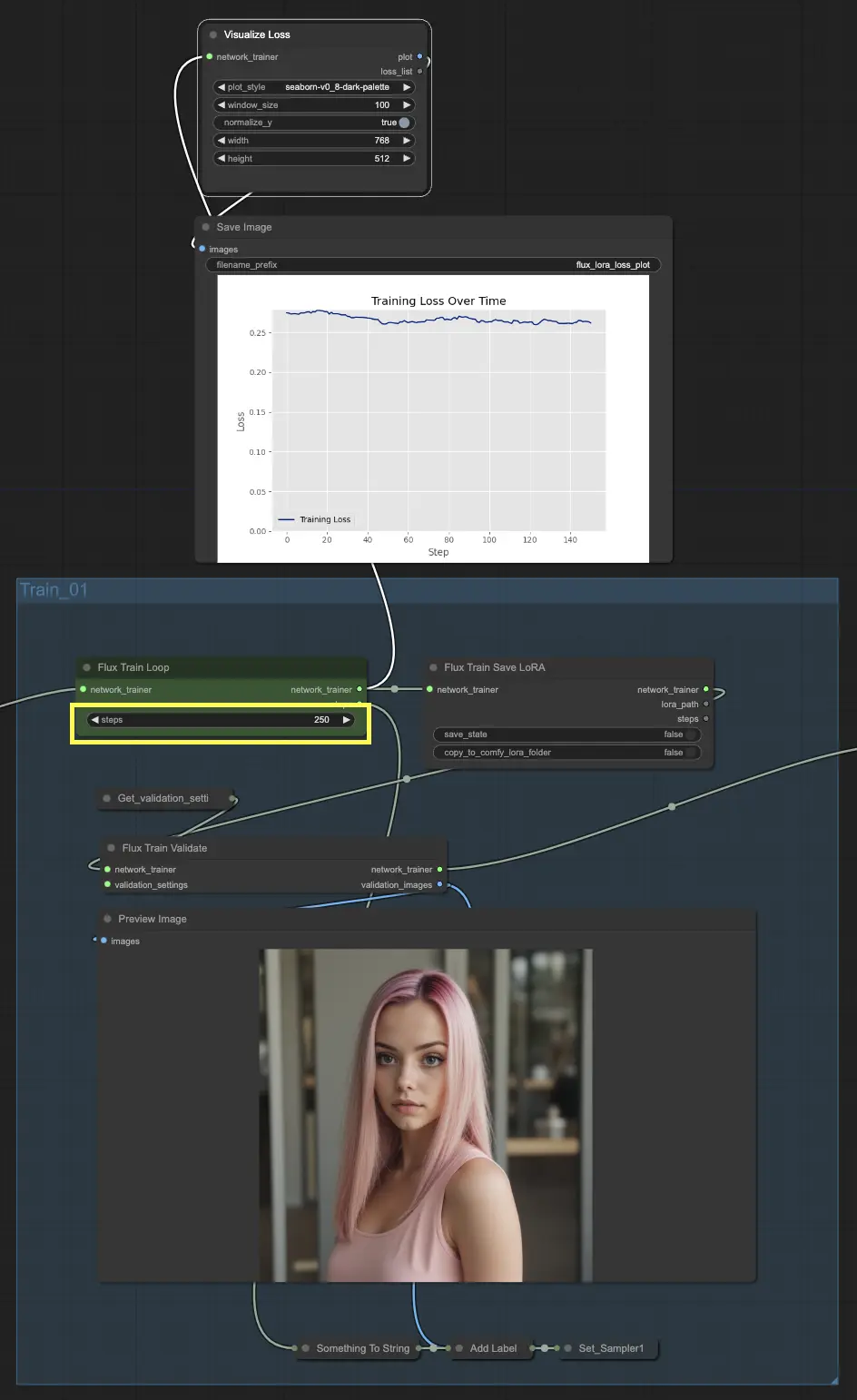

3.1. Train_01

Lassen Sie uns mit Train_01 beginnen. Hier findet die anfängliche Trainingsschleife statt. Der Star dieses Abschnitts ist der FluxTrainLoop Knoten, der dafür verantwortlich ist, die Trainingsschleife für eine festgelegte Anzahl von Schritten auszuführen. In diesem Beispiel haben wir es auf 250 Schritte eingestellt, aber Sie können dies basierend auf Ihren Bedürfnissen anpassen. Sobald die Trainingsschleife abgeschlossen ist, wird das trainierte Modell an den FluxTrainSave Knoten übergeben, der das Modell in regelmäßigen Abständen speichert. Dies stellt sicher, dass Sie Checkpoints Ihres Modells in verschiedenen Trainingsstufen haben, was nützlich sein kann, um den Fortschritt zu verfolgen und sich von unerwarteten Unterbrechungen zu erholen.

Aber Training bedeutet nicht nur, das Modell zu speichern. Wir müssen auch seine Leistung validieren, um zu sehen, wie gut es abschneidet. Hier kommt der FluxTrainValidate Knoten ins Spiel. Er nimmt das trainierte Modell und stellt es anhand eines Validierungsdatensatzes auf die Probe. Dieser Datensatz ist vom Trainingsdatensatz getrennt und hilft dabei, zu beurteilen, wie gut das Modell auf ungesehene Beispiele generalisiert. Der FluxTrainValidate Knoten generiert Beispielbilder basierend auf den Validierungsdaten und gibt Ihnen eine visuelle Darstellung der Ausgabe des Modells in diesem Stadium.

Um den Trainingsfortschritt im Auge zu behalten, haben wir den VisualizeLoss Knoten. Dieser praktische Knoten visualisiert den Trainingsverlust im Laufe der Zeit und ermöglicht es Ihnenjson : zu sehen, wie gut das Modell lernt und ob es zu einer guten Lösung konvergiert. Es ist, als hätten Sie einen persönlichen Trainer, der Ihren Fortschritt verfolgt und Ihnen hilft, auf Kurs zu bleiben.

3.2. Train_02, Train_03, Train_04

In Train_02, das an Train_01 im FLUX LoRA Training anschließt, wird die Ausgabe für eine zusätzliche festgelegte Anzahl von Schritten weiter trainiert (z. B. 250 Schritte). Train_03 und Train_04 folgen einem ähnlichen Muster und erweitern das Training mit aktualisierten Verbindungen für einen reibungslosen Fortschritt. Jede Stufe gibt ein FLUX LoRA-Modell aus, sodass Sie die Leistung testen und vergleichen können.

Beispiel

In unserem Beispiel haben wir uns entschieden, nur Train_01 und Train_02 zu verwenden, die jeweils für 250 Schritte laufen. Wir haben Train_03 und Train_04 vorerst umgangen. Aber fühlen Sie sich frei zu experimentieren und die Anzahl der Trainingsabschnitte und -schritte basierend auf Ihren spezifischen Bedürfnissen und Ressourcen anzupassen.

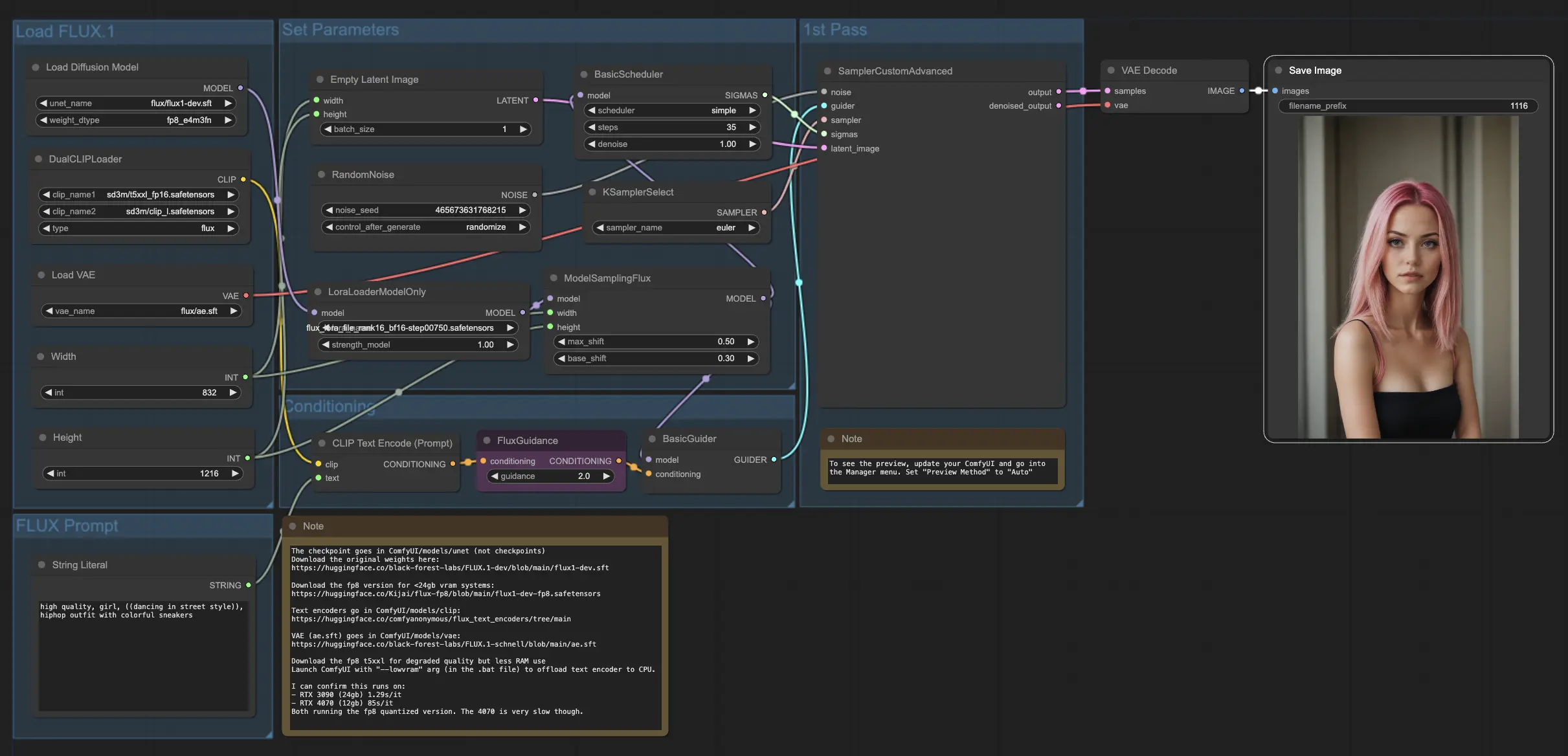

4. Wie und wo man die FLUX- und FLUX LoRA-Modelle verwendet

Sobald Sie das FLUX LoRA-Modell haben, können Sie es in den integrieren. Ersetzen Sie das vorhandene LoRA-Modell durch Ihr trainiertes Modell und testen Sie dann die Ergebnisse, um deren Leistung zu bewerten.

Beispiel

In unserem Beispiel verwenden wir den FLUX LoRA-Workflow, um mehr Influencer-Bilder zu generieren, indem wir das FLUX LoRA-Modell anwenden und seine Leistung beobachten.

Lizenz

Lizenzdateien anzeigen:

Das FLUX.1 [dev] Modell wird von Black Forest Labs, Inc. unter der FLUX.1 [dev] Non-Commercial License lizenziert. Copyright Black Forest Labs, Inc.

IN KEINEM FALL HAFTET BLACK FOREST LABS, INC. FÜR JEGLICHE ANSPRÜCHE, SCHÄDEN ODER ANDERE HAFTUNGEN, SEI ES AUS VERTRAG, UNERLAUBTER HANDLUNG ODER ANDERWEITIG, DIE SICH AUS DER NUTZUNG DIESES MODELLS ERGEBEN ODER DAMIT IN VERBINDUNG STEHEN.