Mochi 1 | Genmo Text-to-Video

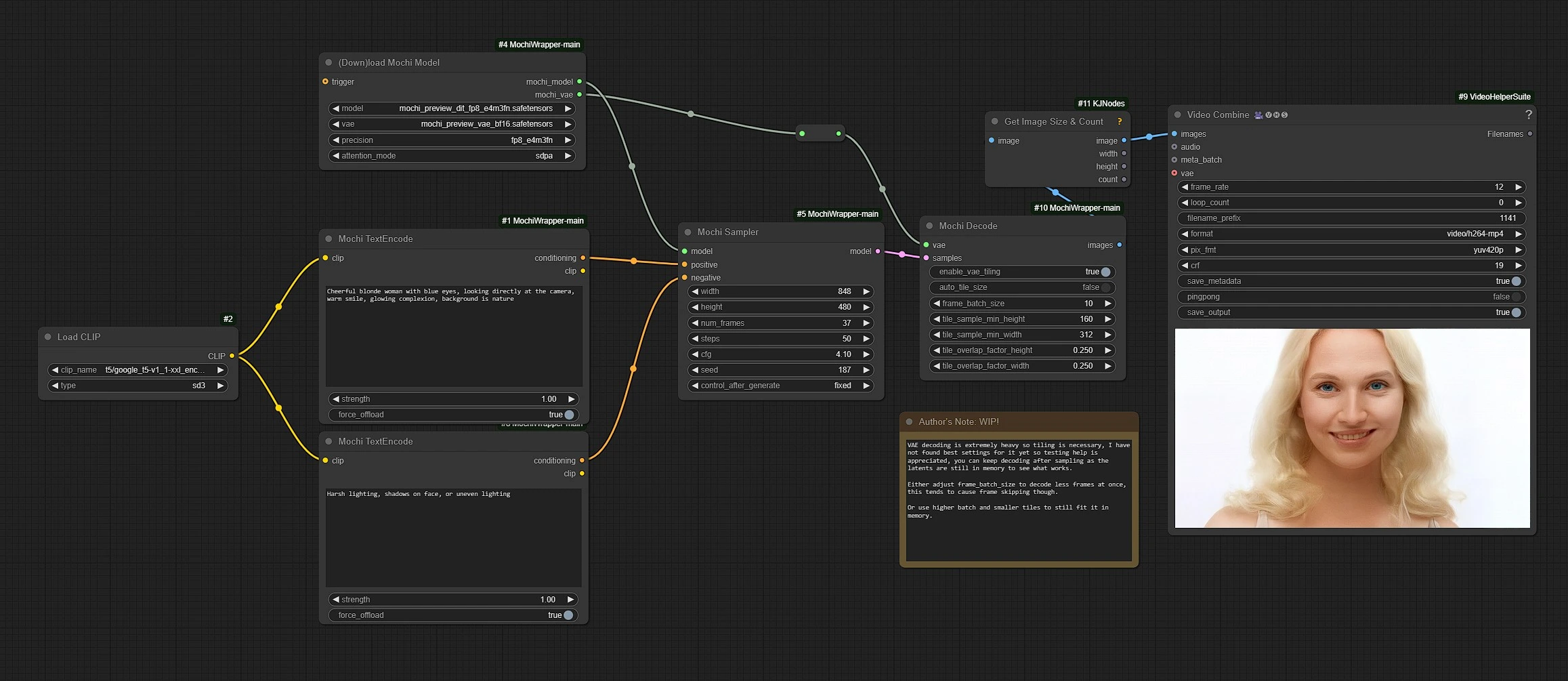

Das Mochi 1 Vorschau-Modell ist ein offenes, hochmodernes Videoerzeugungsmodell mit hochauflösender Bewegung und starker Einhaltung der Eingabeaufforderungen in der vorläufigen Bewertung. Dieses Modell schließt die Lücke zwischen geschlossenen und offenen Videoerzeugungssystemen erheblich. Das Mochi Wrapper-Modell wird von Genmo entwickelt, alle Modell-Credits gehen an ihn.ComfyUI Mochi 1 Arbeitsablauf

- Voll funktionsfähige Workflows

- Keine fehlenden Nodes oder Modelle

- Keine manuelle Einrichtung erforderlich

- Beeindruckende Visualisierungen

ComfyUI Mochi 1 Beispiele

ComfyUI Mochi 1 Beschreibung

Die und der zugehörige Workflow wurden vollständig von Kijai entwickelt. Wir geben Kijai alle verdienten Anerkennungen für diese innovative Arbeit. Auf der RunComfy-Plattform präsentieren wir einfach Kijai’s Beiträge zur Community. Es ist wichtig zu beachten, dass es derzeit keine formelle Verbindung oder Partnerschaft zwischen RunComfy und Kijai gibt. Wir schätzen Kijai’s Arbeit sehr!

Mochi 1

Mochi 1 ist ein fortschrittliches Text-zu-Video-Modell von , das kreative Ideen zum Leben erweckt, indem es Textbeschreibungen in lebendige, visuell ansprechende Videos verwandelt. Mit intuitiven KI-Fähigkeiten gebaut, kann Mochi 1 eine Reihe von Eingabeaufforderungen interpretieren und dynamische Animationen, realistische Szenen oder künstlerische Visualisierungen erstellen, die mit der Benutzerabsicht übereinstimmen. Ob für Geschichtenerzählen, Werbung, Bildungsinhalte oder Unterhaltung, Mochi 1 bietet Flexibilität, indem es verschiedene Videostile unterstützt, von 2D-Animationen bis zu filmischen Renderings. Mochi 1 wurde entwickelt, um Kreative zu unterstützen und die Videoproduktion zugänglicher zu machen.

Wie benutzt man den ComfyUI Mochi 1-Workflow?

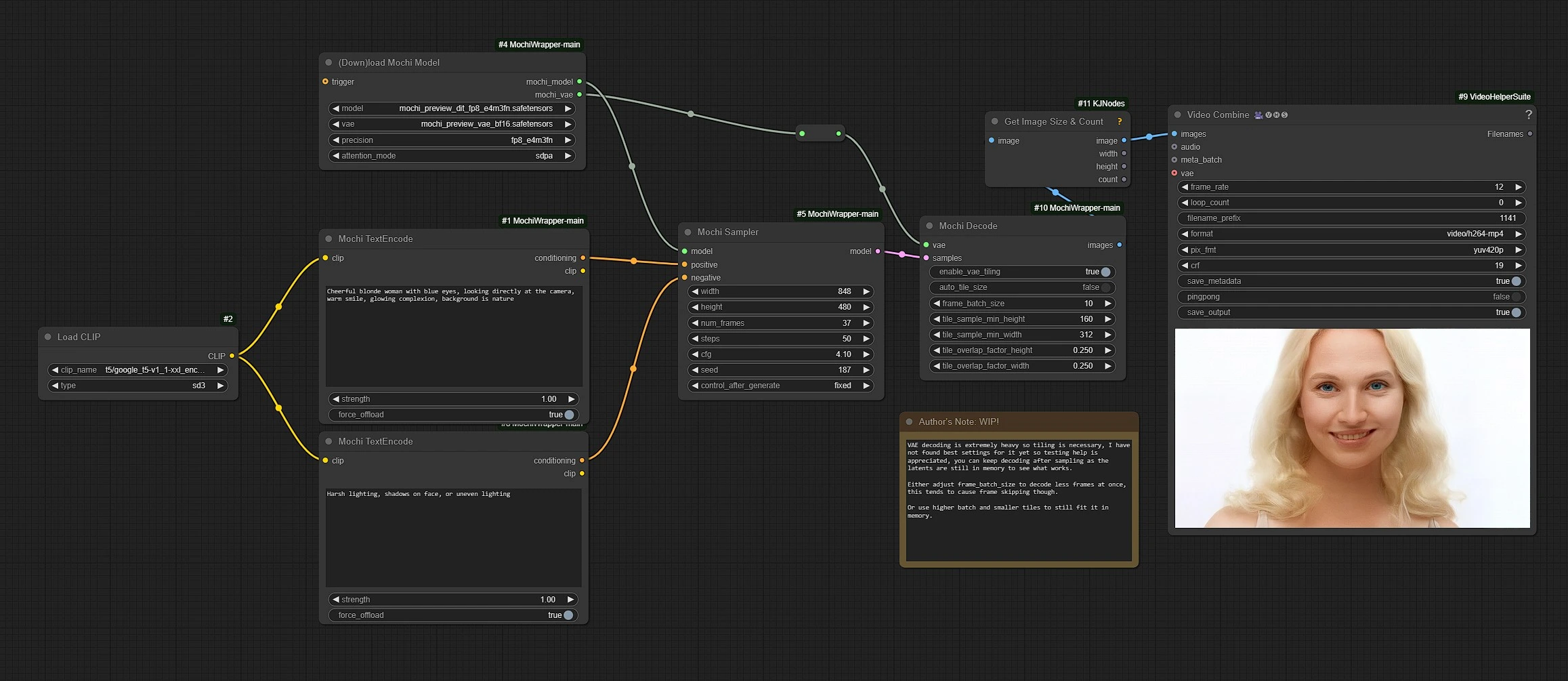

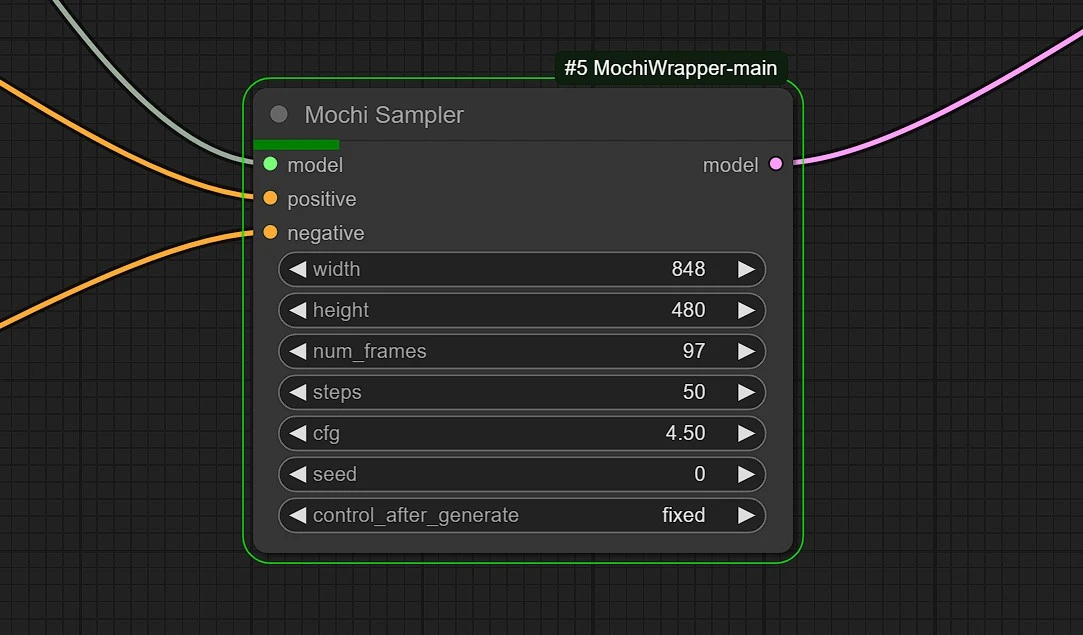

1.1 Mochi 1 Sampler

Dies ist der Hauptknoten des Workflows, in dem Sie die meisten Einstellungen wie Anzahl der Frames, Auflösungen, Schritte, cfg ...etc für die Videoerzeugung mit Mochi 1 festlegen.

Parameter:

Width: Die Breite des von Mochi 1 erzeugten Videos.Height: Die Höhe des von Mochi 1 erzeugten Videos.num_frames: Steuert die Anzahl der in einem Mochi 1 Video erzeugten Frames.steps: Die Anzahl der Iterationen zur Detailverbesserung im Mochi 1-Ausgang. Mehr Schritte führen zu feineren Details, erfordern jedoch mehr Verarbeitungszeit.cfg: Der Classifier-Free Guidance Scale, der anpasst, wie genau Mochi 1 der Eingabeanleitung folgt.seed: Steuert die Zufälligkeit im Mochi 1-Generierungsprozess. Die Verwendung desselben Seeds führt zu denselben Ergebnissen.control_after_generate: Passt die Bilddetails nach der Erzeugung in Mochi 1 an.

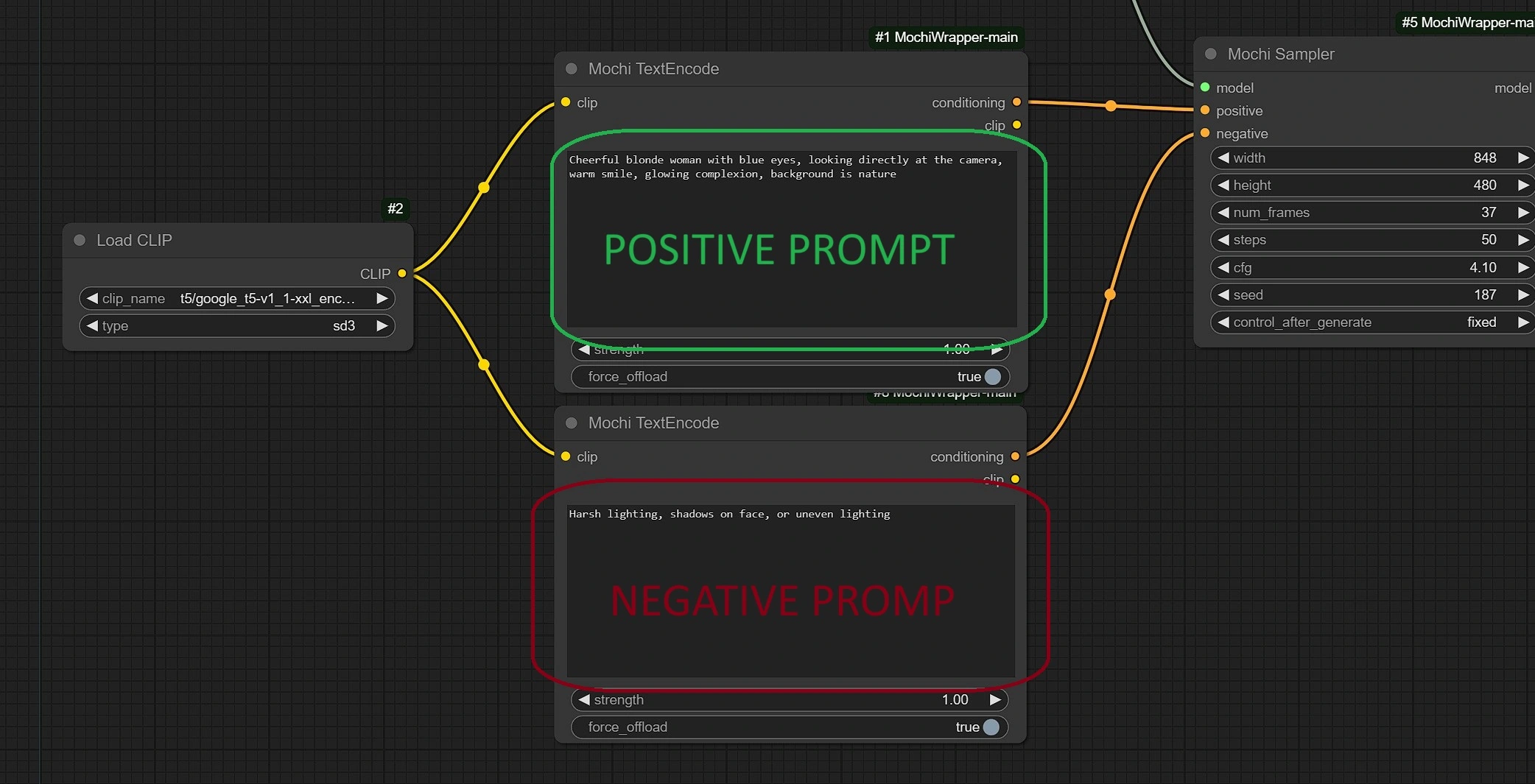

1.2 Positive und Negative Prompts.

Positive Prompt: Beschreibt, was Sie möchten, dass Mochi 1 erzeugt, wobei der Fokus auf den gewünschten Elementen liegt. Zum Beispiel: „eine blonde Frau, die im natürlichen Sonnenlicht lächelt“ oder „ein friedlicher Park mit blühenden Blumen“.Negative Prompt: Beschreibt, was Sie nicht möchten, dass Mochi 1 im Video erzeugt.Strength: Bestimmt die Stärke der Prompts und wie genau Mochi 1 dem Prompt folgt.

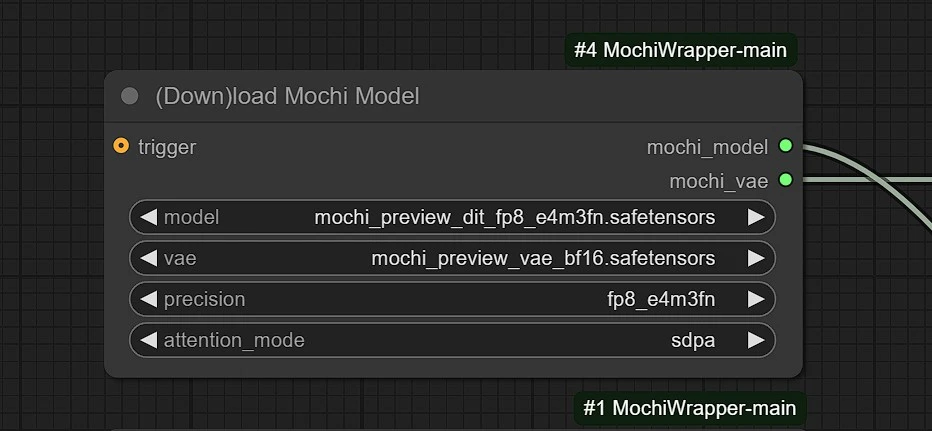

1.3 Model AutoDownloader

- Dies ist der automatische Downloader und Loader für die Mochi 1-Modelle.

- Es dauert 3-5 Minuten, um das Mochi 1 Modell von 19.1 GB herunterzuladen, wenn es zum ersten Mal ausgeführt wird.

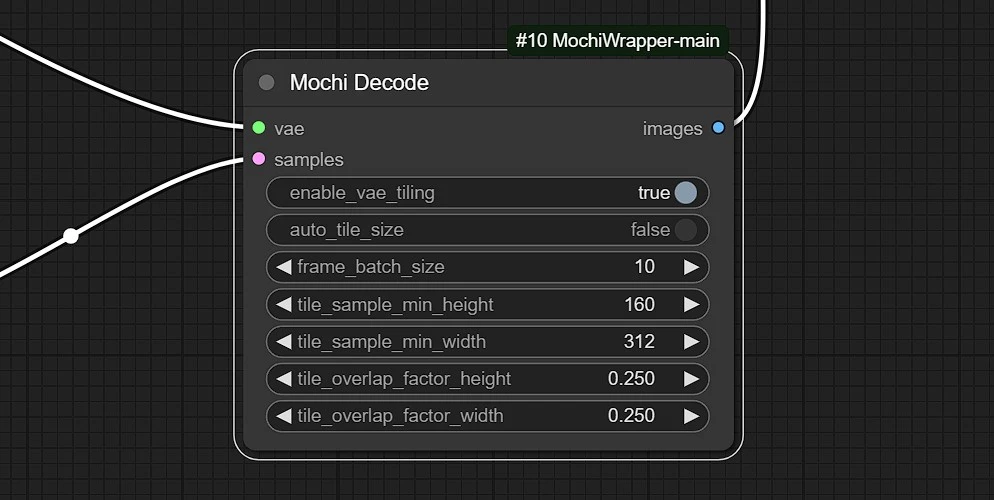

1.4 Mochi 1 Decode

Parameter:

enable_vae_tiling: Aktiviert/Deaktiviert das Kachel-Decoding für niedrigen VRAM-Verbrauch.auto_tile_size: Bestimmt automatisch die Kachel-Decoding-Größe.frames_batch_size: Bestimmt die Anzahl der Frames, die in einem Durchgang decodiert werden. Verwenden Sie niedrigere Werte, um weniger GPU zu verbrauchen, aber es wird mehr Zeit benötigen.tile_sample_mine_height: Kachel-Mindesthöhe für das Decoding von Mochi 1-Ausgaben.tile_sample_mine_width: Kachel-Mindestbreite für das Decoding von Mochi 1-Ausgaben.tile_overlap_factor_height: Kachel-Mindestüberlappungshöhe für das Decoding von Mochi 1.tile_overlap_factor_width: Kachel-Mindestüberlappungsbreite für das Decoding von Mochi 1.

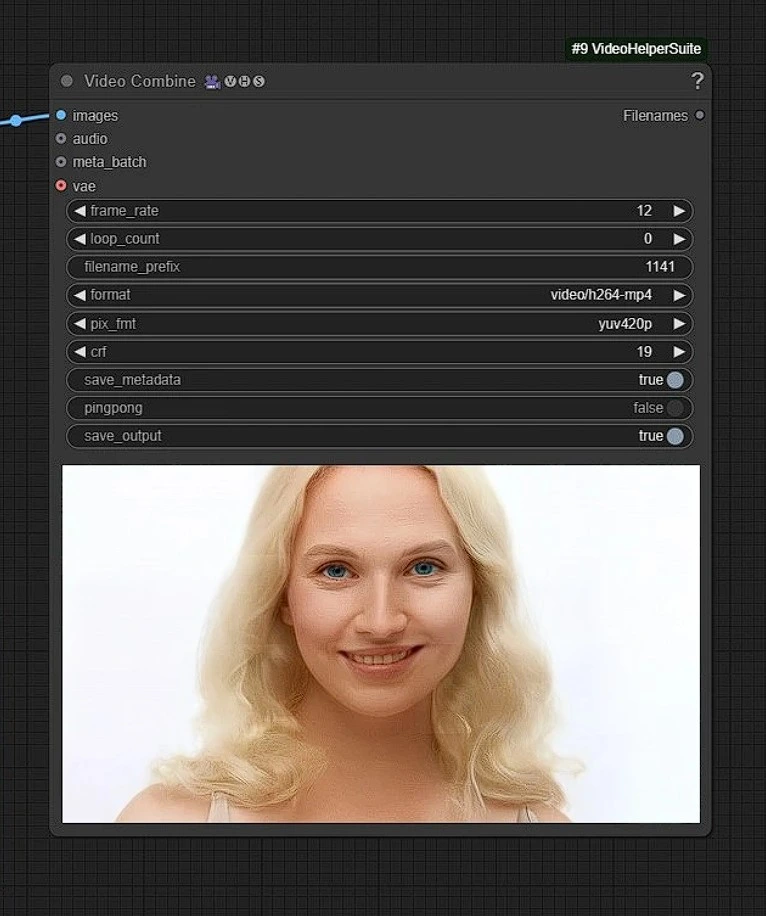

1.5 Video Combine

Parameter:

frame_rate: Legt die Bildrate für den Mochi 1-Ausgang fest. In diesem Fall ist sie auf 12 eingestellt, was bedeutet, dass das Video 12 Bilder pro Sekunde (fps) anzeigt.loop_count: Definiert, wie oft das Video in Schleife abgespielt wird. Ein Wert von 0 bedeutet normalerweise unendliche Schleife, obwohl dies von der spezifischen Softwareimplementierung abhängen kann.filename_prefix: Fügt dem Dateinamen der Mochi 1-Ausgabedatei ein Präfix hinzu. Im Bild ist es auf 1141 gesetzt, sodass die Ausgabedatei mit dieser Nummer beginnt.format: Gibt das Mochi 1-Ausgabevideoformat an. Hier ist es auf video/h264-mp4 eingestellt, was bedeutet, dass das Video im H.264-Codec codiert und als MP4-Datei gespeichert wird.pix_fmt: Definiert das Pixelformat für das Video. Der Wert yuv420p gibt an, dass es den YUV-Farbraum mit 4:2:0-Chroma-Subsampling verwendet, der aufgrund seines Gleichgewichts zwischen Qualität und Kompression häufig verwendet wird.crf: Steht für Constant Rate Factor, der die Qualität und Dateigröße des Videos in Bezug auf die Bitrate steuert. Ein Wert von 19 bietet ein gutes Gleichgewicht zwischen Videoqualität und Dateigröße, wobei niedrigere Werte bessere Qualität und größere Dateigröße bieten, während höhere Werte die Qualität und Dateigröße reduzieren.save_metadata: Wenn aktiviert (true), speichert dies Metadaten (wie Einstellungen und Eigenschaften) in der Ausgabedatei.pingpong: Diese Einstellung bewirkt, dass das Video vorwärts und dann rückwärts abgespielt wird, wodurch ein "Ping-Pong"-Effekt entsteht. Es ist hier auf false gesetzt, sodass dieser Effekt nicht angewendet wird.save_output: Wenn auf true gesetzt, wird die endgültige Ausgabe von Mochi 1 auf der Festplatte gespeichert.

Entwickelt für Zugänglichkeit, ermöglicht Mochi 1 Benutzern, Details wie Farbschemata, Kamerawinkel, Bewegungsdynamik und mehr anzupassen und macht es sowohl für Anfänger als auch erfahrene Kreative anpassungsfähig. Mochi 1s zugrunde liegende Algorithmen sind auf einem umfangreichen Datensatz von visuellen Inhalten trainiert, wodurch es Kontext, Emotionen und Nuancen des visuellen Geschichtenerzählens versteht. Mochi 1 integriert sich nahtlos in beliebte Bearbeitungsplattformen, was es Benutzern ermöglicht, generierte Videos zu verfeinern oder benutzerdefinierte Effekte hinzuzufügen.

Durch die Kombination von Effizienz und Kreativität eröffnet Mochi 1 neue Möglichkeiten für Content-Ersteller, spart Zeit und steigert die Kreativität und ermöglicht schnelles Prototyping. Dies macht Mochi 1 ideal für die Erstellung von ansprechenden YouTube-Videos, Social-Media-Inhalten oder interaktiven Geschichten und ermöglicht es Benutzern, Ideen in überzeugenden visuellen Formaten auszudrücken, ohne tiefgehende Videobearbeitungskenntnisse zu benötigen.