ComfyUI > Flujos de trabajo > Dilatación de Máscara Audioreactiva | Animaciones Impresionantes

Dilatación de Máscara Audioreactiva | Animaciones Impresionantes

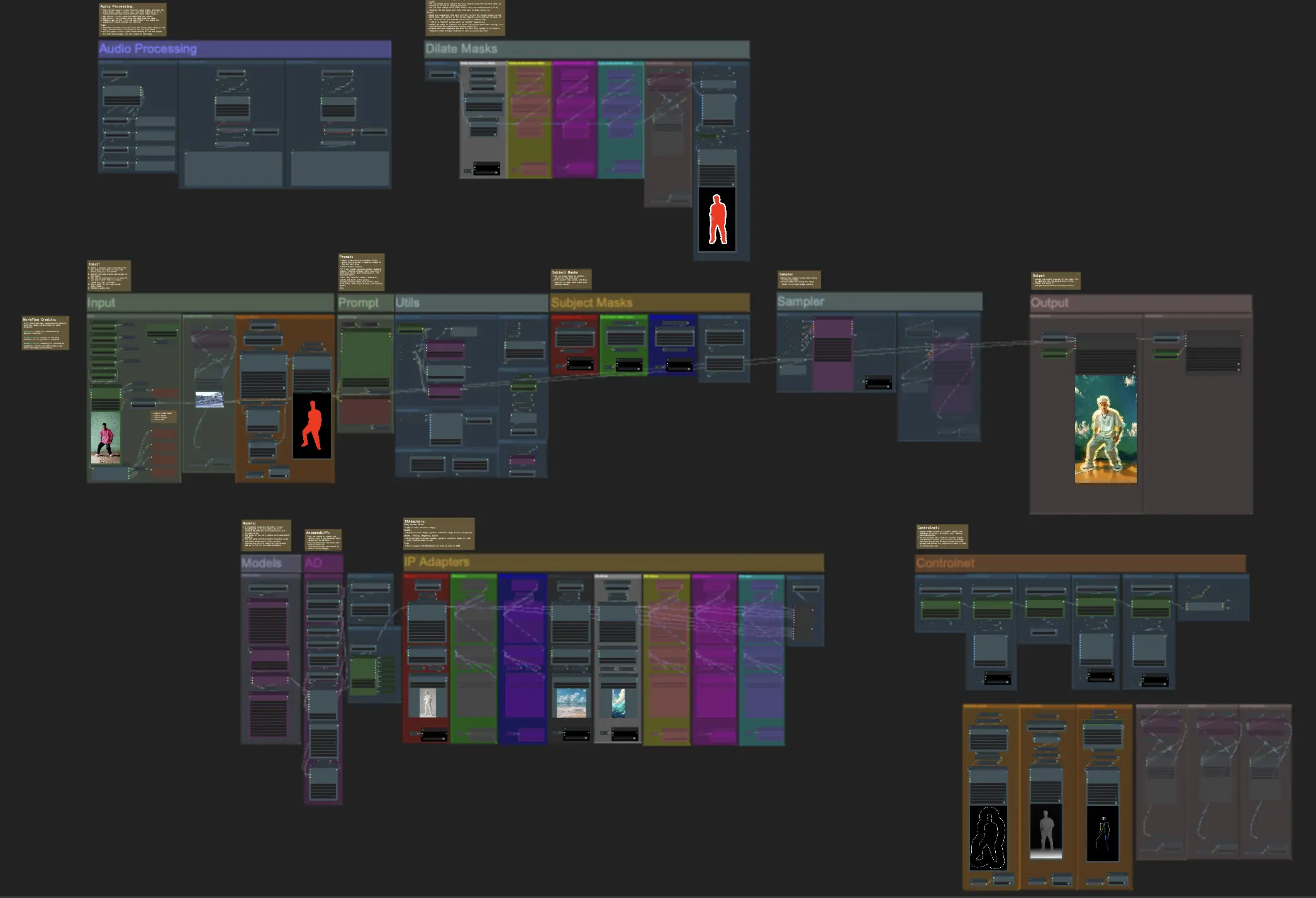

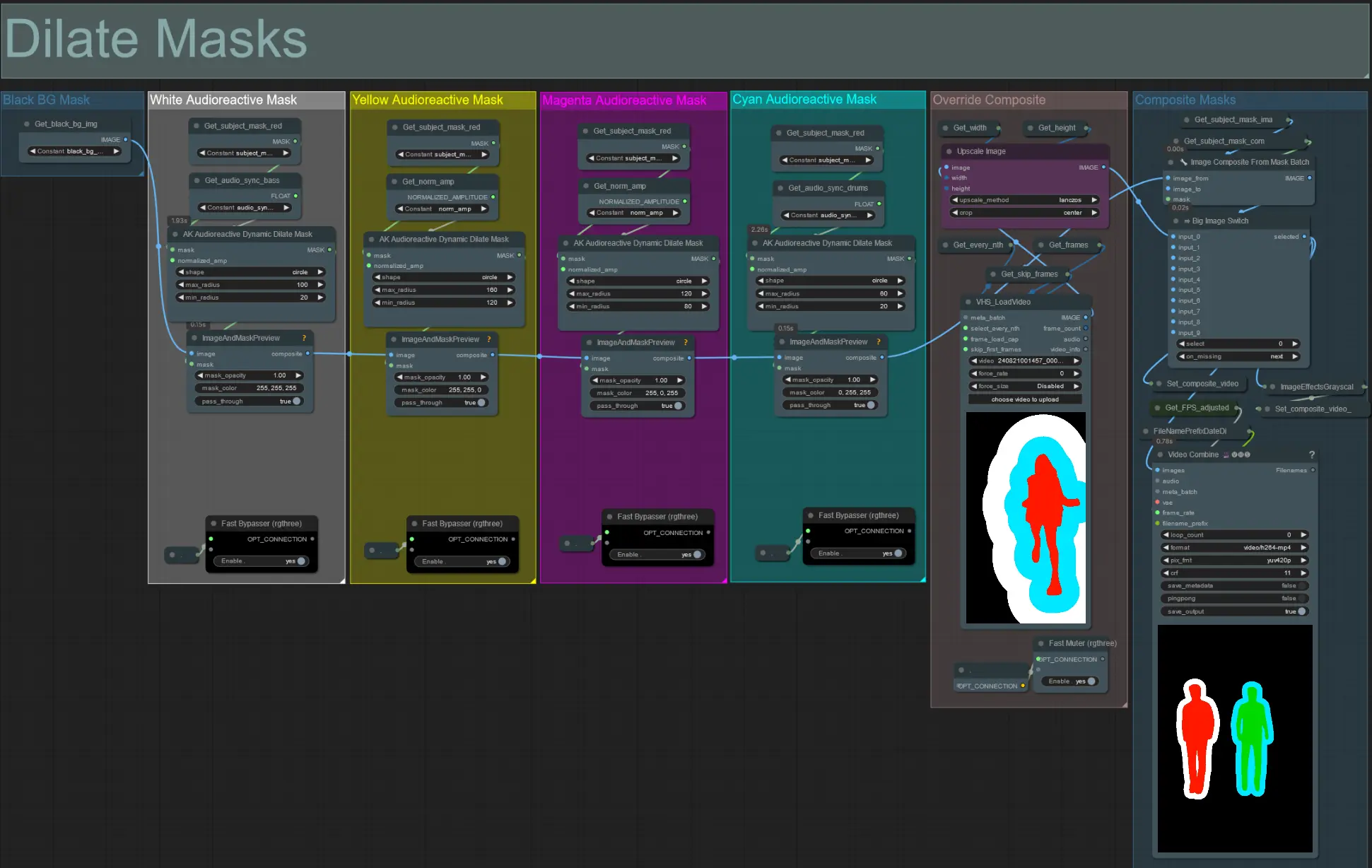

Este flujo de trabajo de Dilatación de Máscara Audioreactiva de ComfyUI te permite transformar creativamente a tus sujetos de video. Te permite envolver a tus sujetos, ya sea un individuo o un grupo de artistas, con un aura dinámica y receptiva que se expande y contrae en perfecta sincronización con el ritmo de la música. Este efecto agrega una dimensión visual cautivadora a tus videos, mejorando su impacto y compromiso general.ComfyUI Audioreactive Mask Dilation Flujo de trabajo

¿Quiere ejecutar este flujo de trabajo?

- Flujos de trabajo completamente operativos

- Sin nodos ni modelos faltantes

- No se requiere configuración manual

- Presenta visuales impresionantes

ComfyUI Audioreactive Mask Dilation Ejemplos

ComfyUI Audioreactive Mask Dilation Descripción

Crea animaciones de video impresionantes transformando tu sujeto (por ejemplo, un bailarín) con un aura dinámica que se expande y contrae rítmicamente al compás del ritmo. Usa este flujo de trabajo con sujetos individuales o múltiples sujetos como se ve en los ejemplos.

Cómo usar el Flujo de Trabajo de Dilatación de Máscara Audioreactiva:

- Sube un video del sujeto en la sección de Entrada

- Selecciona el ancho y la altura deseados para el video final, junto con cuántos fotogramas del video de entrada deben omitirse con 'every_nth'. También puedes limitar el número total de fotogramas a renderizar con 'frame_load_cap'.

- Completa el mensaje positivo y negativo. Establece los tiempos de fotogramas por lote para que coincidan con el momento en que deseas que ocurran las transiciones de escena.

- Sube imágenes para cada uno de los colores de máscara de sujeto predeterminados del IP Adapter:

- Rojo = sujeto (bailarín)

- Negro = Fondo

- Blanco = Máscara de dilatación audioreactiva blanca

- Carga un buen punto de control de LCM (yo uso ParadigmLCM de Machine Delusions) en la sección 'Models'.

- Agrega cualquier lora usando el apilador de Lora debajo del cargador de modelos

- Haz clic en Queue Prompt

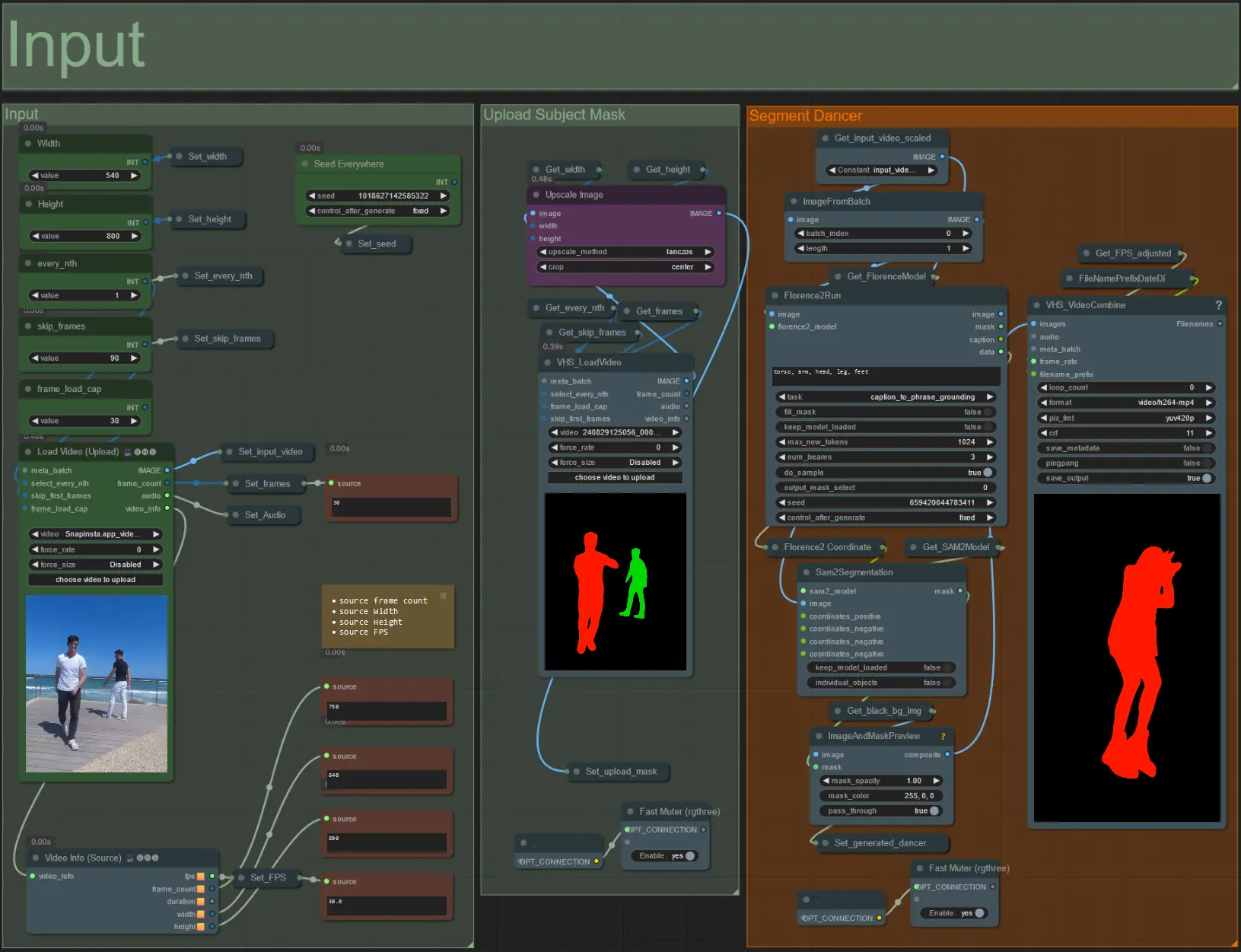

Entrada

- Sube el video del sujeto deseado al nodo de Cargar Video (Subir).

- Ajusta el ancho y la altura de salida usando las dos entradas en la parte superior izquierda.

- every_nth establece si se debe usar cada otro fotograma, cada tercer fotograma, etc. (2 = cada otro fotograma). Dejado en 1 por defecto.

- skip_frames se usa para omitir fotogramas al comienzo del video. (100 = omitir los primeros 100 fotogramas del video de entrada). Dejado en 0 por defecto.

- frame_load_cap se usa para especificar cuántos fotogramas totales del video de entrada deben cargarse. Es mejor mantenerlo bajo al probar configuraciones (30 - 60 por ejemplo) y luego aumentar o establecer en 0 (sin límite de fotogramas) al renderizar el video final.

- Los campos numéricos en la parte inferior derecha muestran información sobre el video de entrada subido: fotogramas totales, ancho, altura y FPS de arriba a abajo.

- Si ya tienes un video de máscara del sujeto generado, desactiva la sección 'Subir Máscara del Sujeto' y sube el video de máscara. Opcionalmente, desactiva la sección 'Segmentar Bailarín' para ahorrar tiempo de procesamiento.

- A veces, el sujeto segmentado no será perfecto, entonces verifica la calidad de la máscara usando el cuadro de vista previa en la parte inferior derecha como se ve arriba. Si ese es el caso, puedes jugar con el mensaje en el nodo 'Florence2Run' para apuntar a diferentes partes del cuerpo como 'cabeza', 'pecho', 'piernas', etc. y ver si obtienes un mejor resultado.

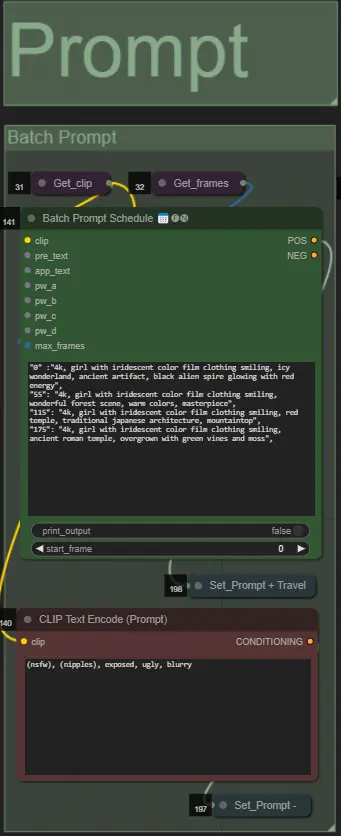

Mensaje

- Establece el mensaje positivo usando el formato de lote:

- por ejemplo, '0': '4k, obra maestra, 1 chica de pie en la playa, absurdres', '25': 'HDR, escena al atardecer, 1 chica con cabello negro y una chaqueta blanca, absurdres', …

- El mensaje negativo es formato normal, agrega incrustaciones si lo deseas.

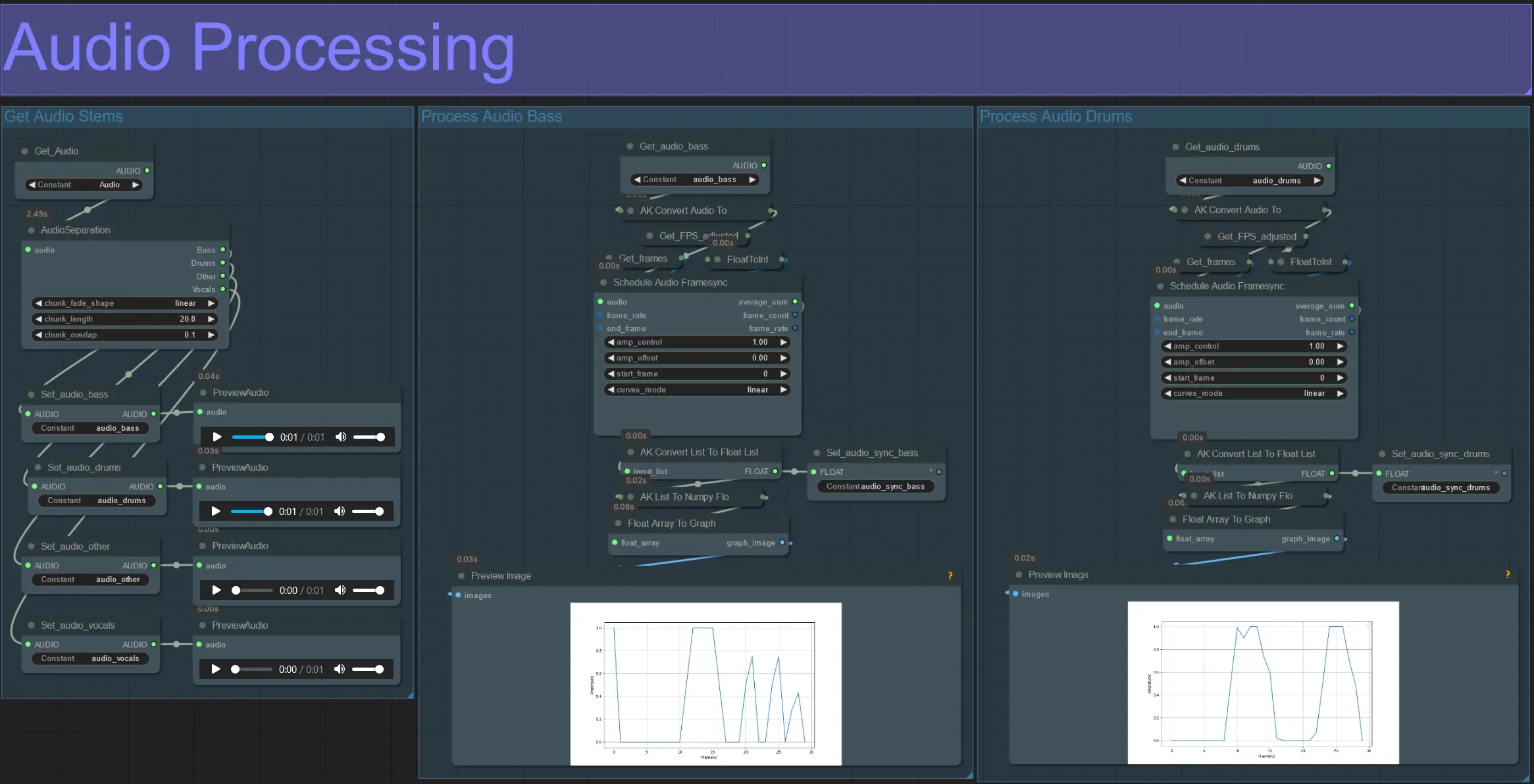

Procesamiento de Audio

- Esta sección toma el audio del video de entrada, extrae los tallos (bajo, tambores, voces, etc.) y luego lo convierte en una amplitud normalizada sincronizada con los fotogramas del video de entrada.

- amp_control = rango total que puede recorrer la amplitud.

- amp_offset = el valor mínimo que puede tomar la amplitud.

- Ejemplo: amp_control = 0.8 y amp_offset = 0.2 significa que la señal viajará entre 0.2 y 1.0.

- A veces, el tallo de Tambores contiene las notas reales del Bajo de la canción; previsualiza cada uno para determinar cuál es el mejor para tus máscaras.

- Usa los gráficos para obtener una comprensión clara de cómo cambia la señal para ese tallo a lo largo de la duración del video.

Dilatar Máscaras

- Cada grupo de colores corresponde al color de la máscara de dilatación que será generada por él.

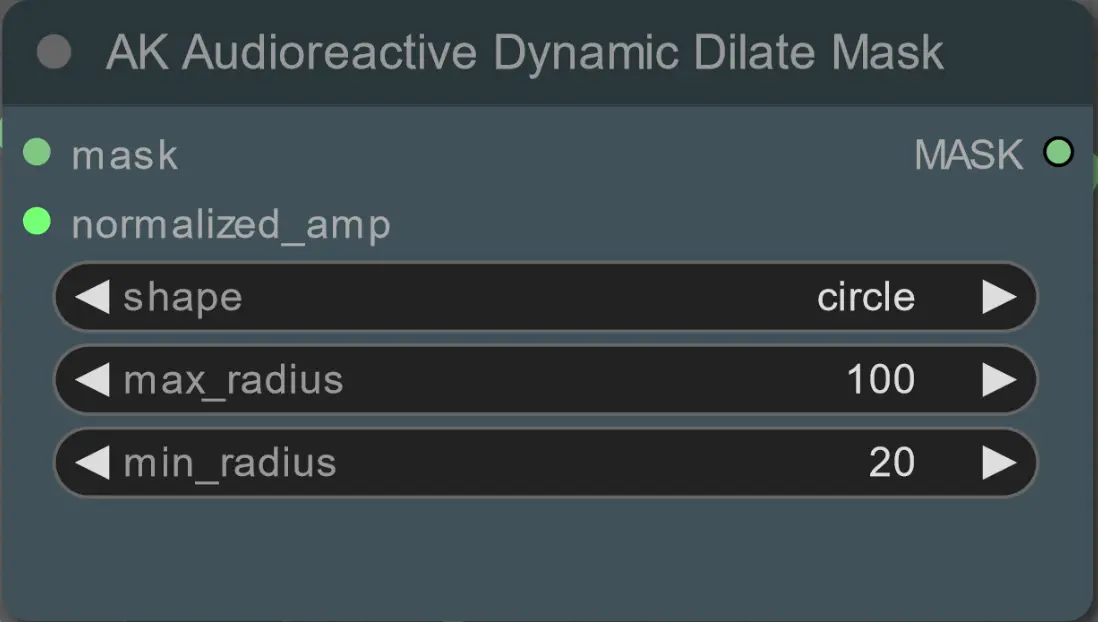

- Establece el radio mínimo y máximo para la máscara de dilatación, junto con su forma, usando el siguiente nodo:

- forma: 'círculo' es el más preciso pero tarda más en generarse. Establece esto cuando estés listo para realizar el renderizado final. 'cuadrado' es rápido de calcular pero menos preciso, mejor para probar el flujo de trabajo y decidir sobre las imágenes del IP adapter.

- max_radius: El radio de la máscara en píxeles cuando el valor de amplitud es máximo (1.0).

- min_radius: El radio de la máscara en píxeles cuando el valor de amplitud es mínimo (0.0).

- Si ya tienes un video de máscara compuesto generado, puedes desactivar el grupo 'Override Composite Mask' y subirlo. Se recomienda omitir los grupos de máscara de dilatación si se está anulando para ahorrar tiempo de procesamiento.

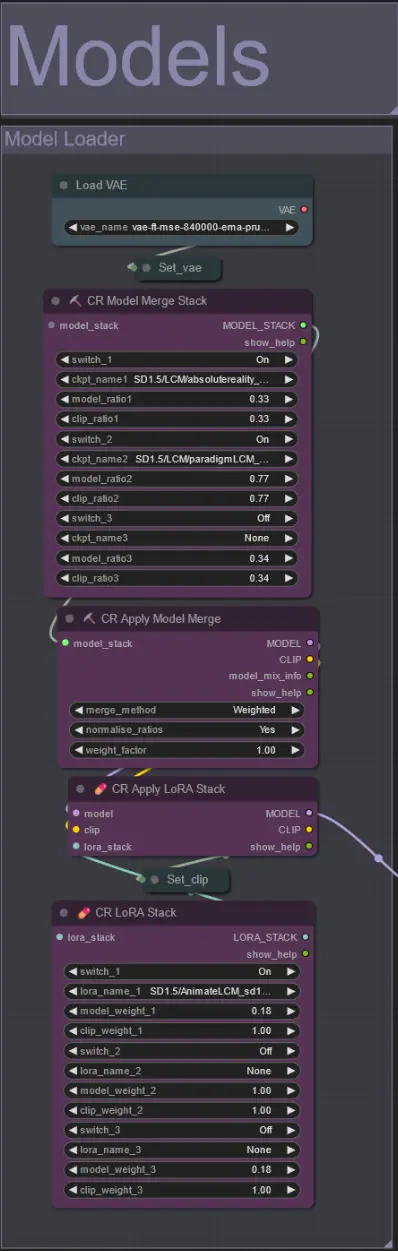

Modelos

- Usa un buen modelo de LCM para el punto de control. Recomiendo ParadigmLCM de Machine Delusions.

- Fusiona varios modelos juntos usando el Model Merge Stack para obtener varios efectos interesantes. Asegúrate de que los pesos sumen 1.0 para los modelos habilitados.

- Opcionalmente, especifica el AnimateLCM_sd15_t2v_lora.safetensors con un peso bajo de 0.18 para mejorar aún más el resultado final.

- Agrega cualquier Lora adicional al modelo usando el apilador de Lora debajo del cargador de modelos.

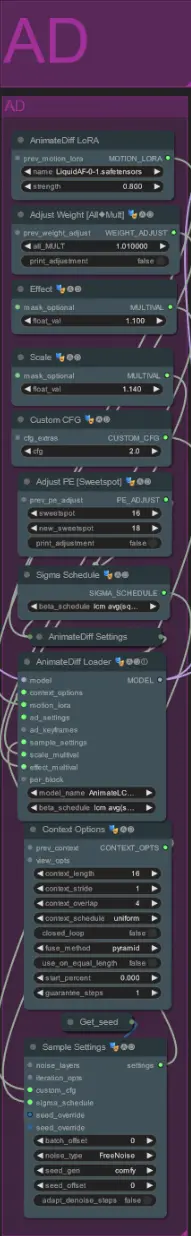

AnimateDiff

- Establece un Motion Lora diferente en lugar del que usé (LiquidAF-0-1.safetensors)

- Aumenta/disminuye los flotantes de Scale y Effect para aumentar/disminuir la cantidad de movimiento en la salida.

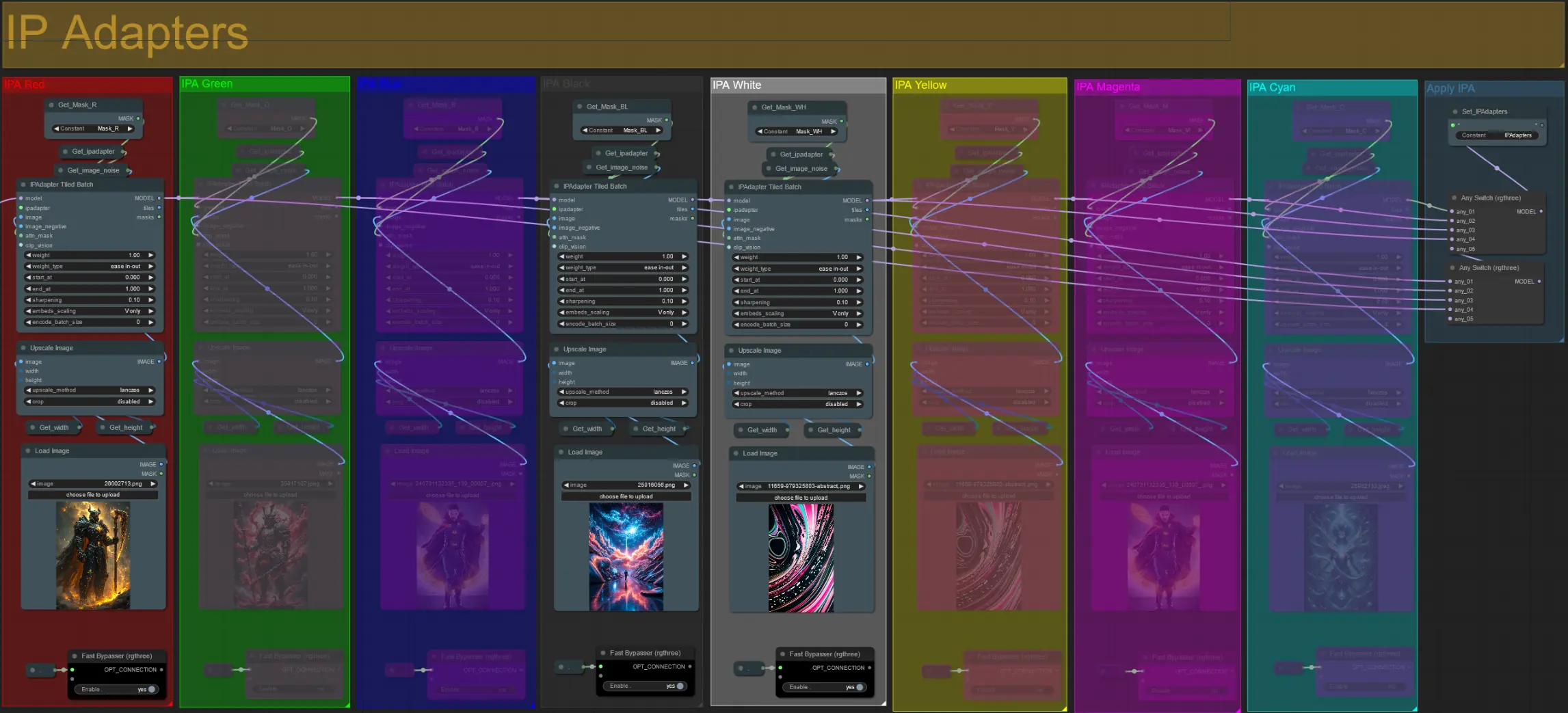

IP Adapters

- Aquí puedes especificar las imágenes de referencia que se utilizarán para renderizar los fondos de cada una de las máscaras de dilatación, así como tus sujetos de video.

- El color de cada grupo representa la máscara a la que apunta:

Rojo, Verde, Azul:

- Imágenes de referencia de la máscara del sujeto.

Negro:

- Imagen de referencia de la máscara de fondo, sube una imagen de referencia para el fondo.

Blanco, Amarillo, Magenta, Cian:

- Imágenes de referencia de la máscara de dilatación, sube una imagen de referencia para cada máscara de dilatación de color en uso.

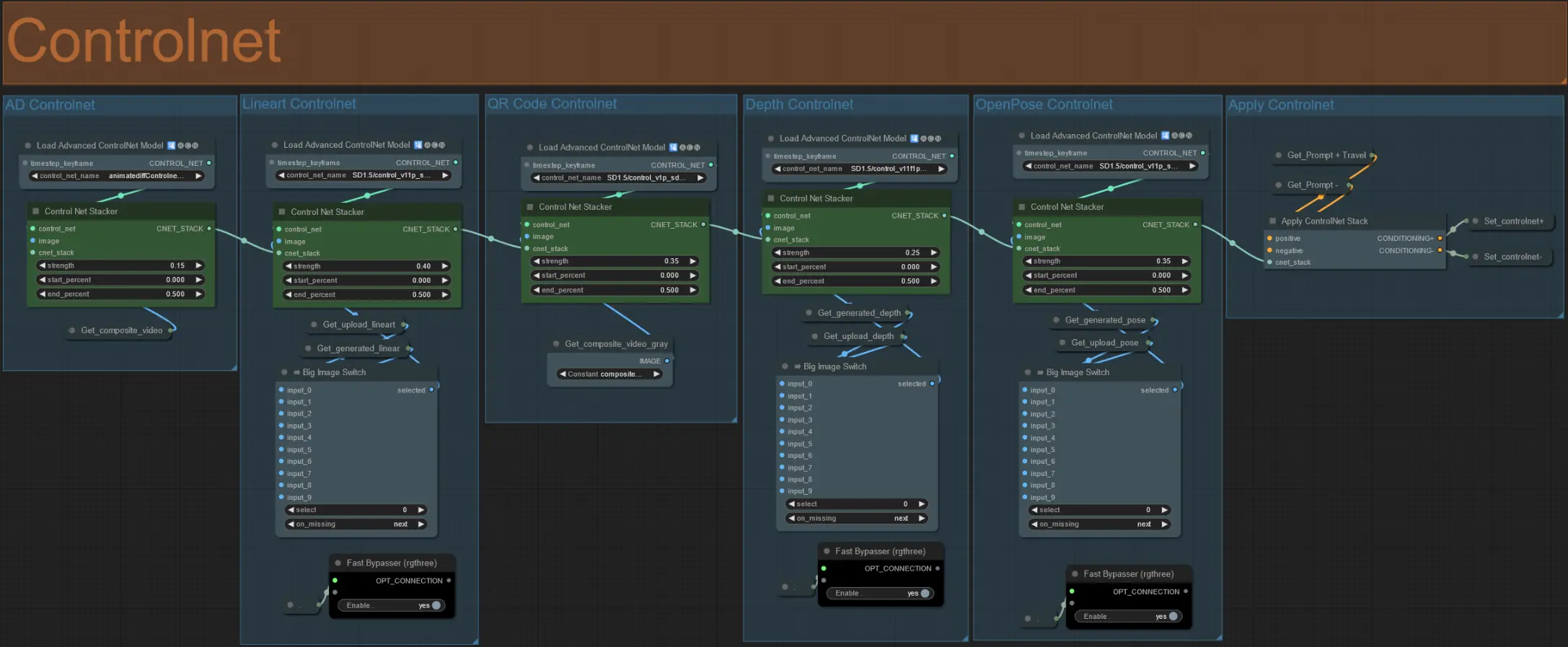

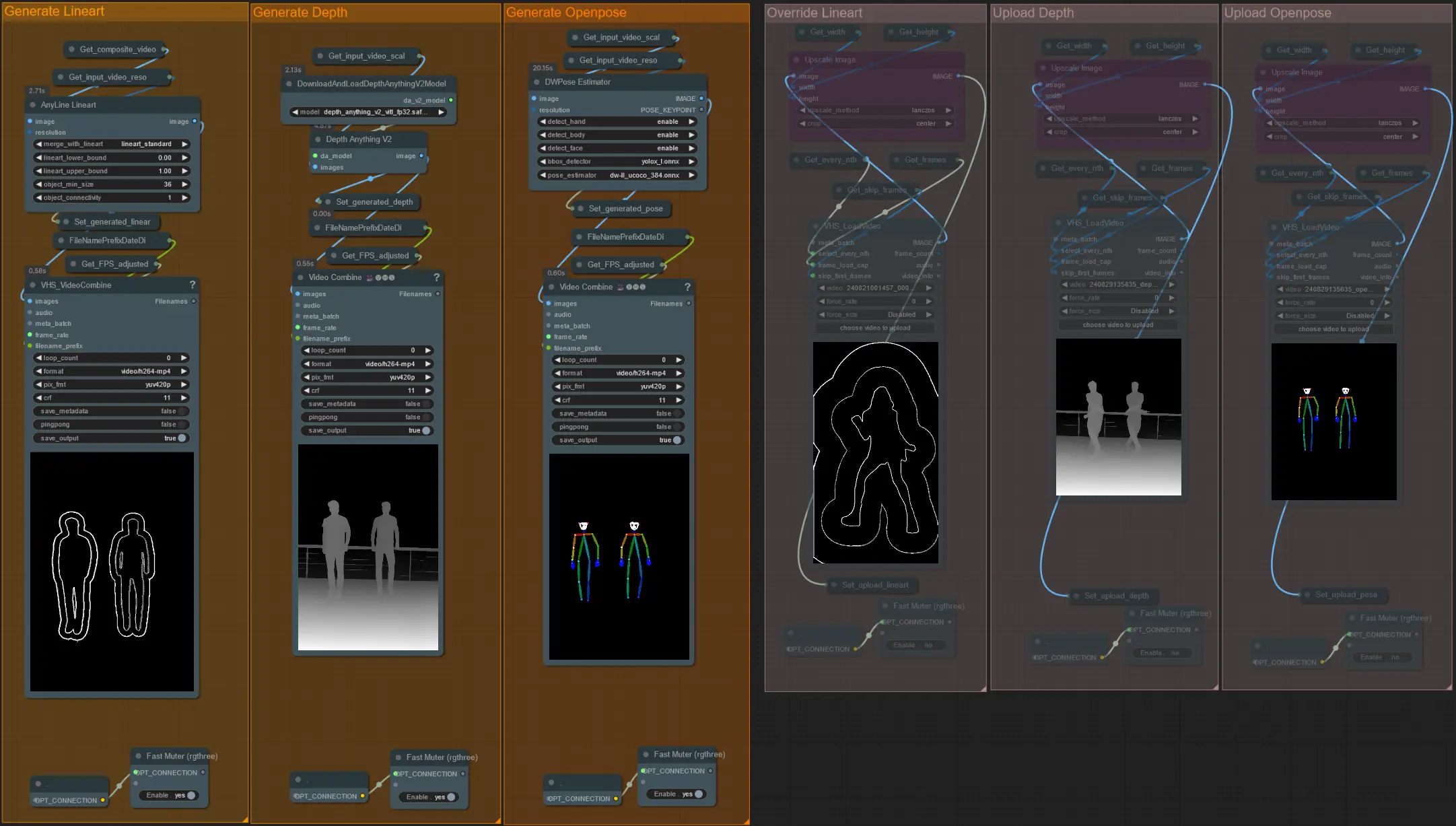

ControlNet

- Este flujo de trabajo hace uso de 5 controlnets diferentes, incluyendo AD, Lineart, QR Code, Depth y OpenPose.

- Todas las entradas a los controlnets se generan automáticamente

- Puedes optar por anular el video de entrada para los controlnets de Lineart, Depth y OpenPose si lo deseas desactivando los grupos de 'Override' como se ve a continuación:

- Se recomienda también desactivar los grupos de 'Generate' si se está anulando para ahorrar tiempo de procesamiento.

Consejo:

- Omite el Ksampler y comienza un renderizado con tu video de entrada completo. Una vez que todos los videos del preprocesador se hayan generado, guárdalos y súbelos a las respectivas anulaciones. A partir de ahora, cuando pruebes el flujo de trabajo, no tendrás que esperar a que se genere cada video del preprocesador individualmente.

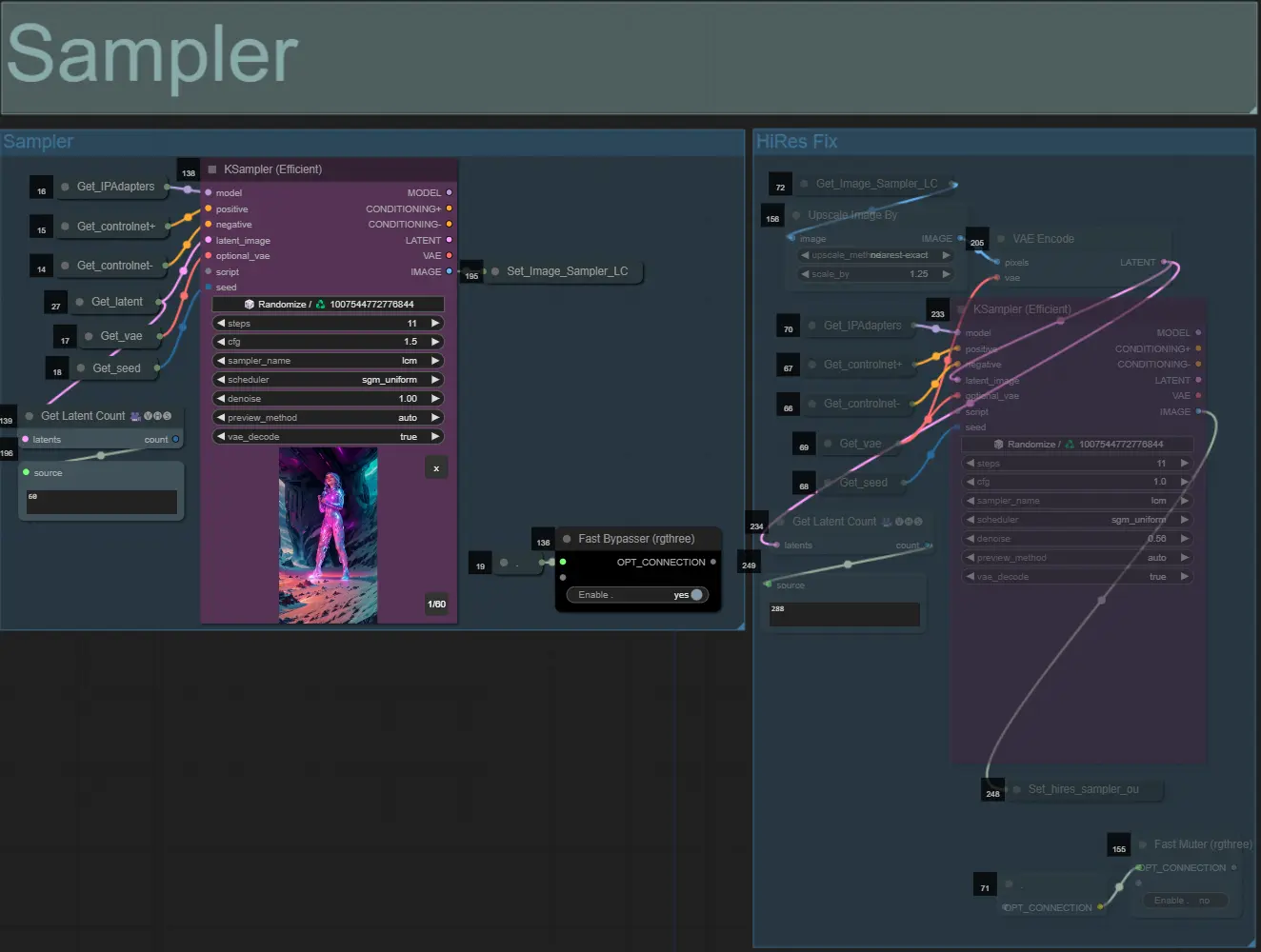

Sampler

- Por defecto, el grupo de muestreador HiRes Fix estará desactivado para ahorrar tiempo de procesamiento al probar

- Recomiendo omitir el grupo de Sampler también al intentar experimentar con configuraciones de máscara de dilatación para ahorrar tiempo.

- En renderizados finales, puedes activar el grupo de HiRes Fix que aumentará la escala y agregará detalles al resultado final.

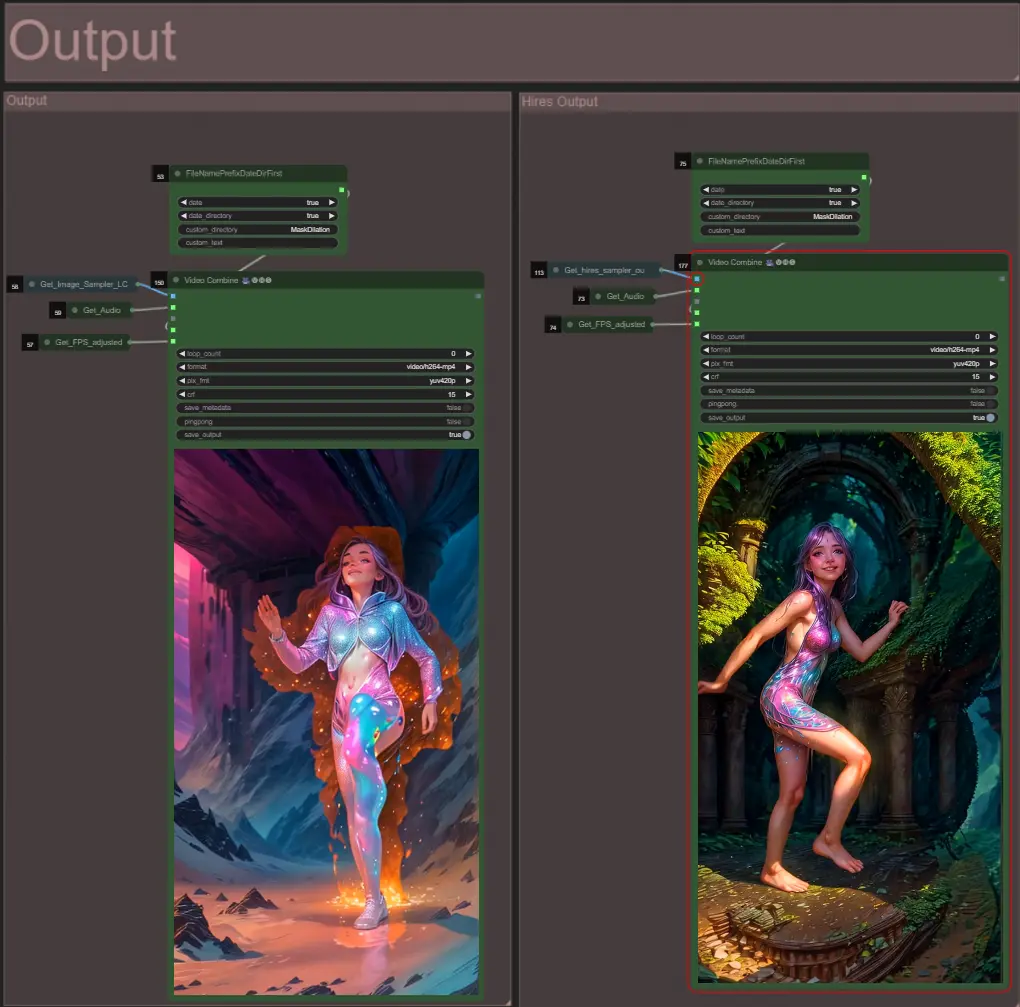

Salida

- Hay dos grupos de salida: el izquierdo es para la salida del muestreador estándar, y el derecho es para la salida del muestreador HiRes Fix.

Sobre el Autor

Akatz AI:

- Sitio web:

- http://patreon.com/Akatz

- https://civitai.com/user/akatz

- https://www.youtube.com/@akatz_ai

- https://www.instagram.com/akatz.ai/

- https://www.tiktok.com/@akatz_ai

- https://x.com/akatz_ai

- https://github.com/akatz-ai

Contactos:

- Email: akatz.hello@gmail.com