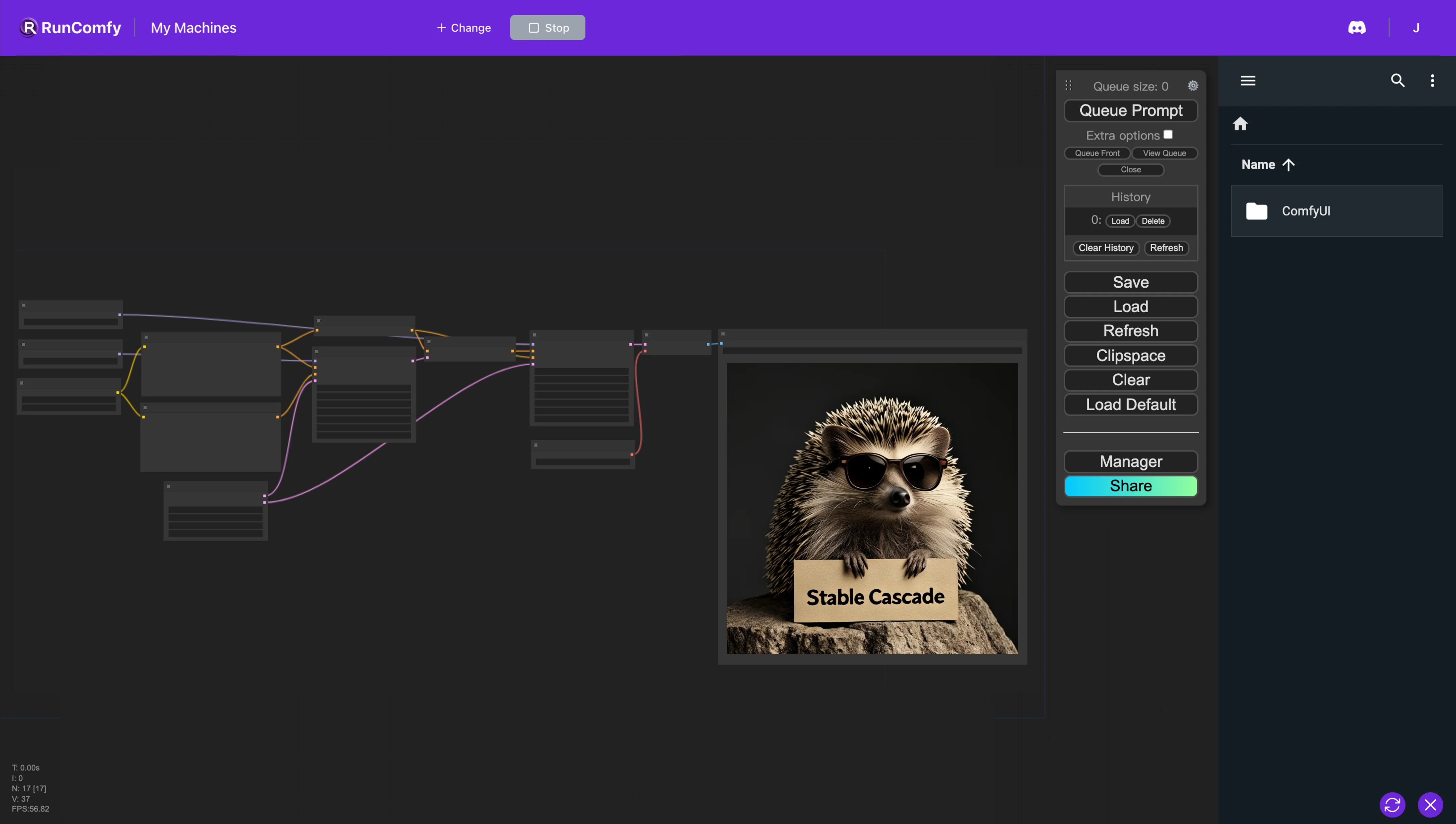

1. Workflow ComfyUI de Stable Cascade#

Dans ce workflow ComfyUI, nous tirons parti de Stable Cascade, un modèle de texte-à-image supérieur reconnu pour son alignement de prompts et son excellence esthétique. Contrairement aux autres modèles Stable Diffusion, Stable Cascade utilise une architecture de pipeline à trois étapes (Étapes A, B et C). Cette conception permet une compression d'image hiérarchique dans un espace latent très efficace, ce qui se traduit par une qualité d'image exceptionnelle.

2. Aperçu de Stable Cascade#

Stable Cascade se démarque comme un modèle révolutionnaire de texte-à-image, tirant parti de l'architecture innovante Würstchen. Ce modèle se distingue par des images de meilleure qualité, des vitesses plus rapides, des coûts inférieurs et une personnalisation plus facile.

2.1. Une structure de processus en trois étapes#

Étape A de Stable Cascade : L'étape A de Stable Cascade utilise un réseau antagoniste génératif à quantification vectorielle (VQGAN) pour obtenir une compression d'image d'un facteur de quatre. Cette étape quantifie de manière innovante les valeurs en une des 8 192 entrées uniques d'un codebook appris, similaire à la sélection de couleurs dans une palette. Cette quantification compresse non seulement spatialement l'image dans un rapport 4:1, mais réduit également considérablement la taille des données en représentant les images avec des jetons discrets. Cette méthode contraste avec l'utilisation de valeurs à virgule flottante par Stable Diffusion, offrant une technique de compression plus compacte et efficace.

Étape B de Stable Cascade : En passant à l'étape B, Stable Cascade montre ses prouesses dans le raffinement des données d'image. Ici, les jetons discrets de l'étape A subissent une transformation via un modèle de diffusion latente, intégrant ingénieusement les principes d'un adaptateur IP avec des techniques de diffusion pour guider la création d'images de sortie similaires. L'étape B brille dans sa capacité à transformer les données tokenisées en valeurs à virgule flottante riches et détaillées, améliorant la qualité sémantique de l'image. Cette étape est conçue pour l'efficacité, se concentrant sur la création de latents débruités qui correspondent parfaitement à l'entrée, rendant ainsi le processus d'entraînement plus rationalisé et réduisant les demandes de calcul.

Étape C de Stable Cascade : L'étape C introduit une nouvelle approche en ajoutant du bruit à la sortie sémantique de l'étape B, puis en la débruitant méticuleusement à l'aide d'une séquence de blocs ConvNeXt. L'objectif est de reproduire précisément le contenu sémantique, en contournant la nécessité d'un sous-échantillonnage. Cette étape joue un rôle essentiel dans la transformation d'un blob sémantique en un élément cohérent que l'étape B peut affiner davantage, aboutissant à la génération d'images de haute qualité. L'utilisation stratégique des blocs ConvNeXt par l'étape C souligne son engagement à fournir des performances de premier ordre de manière efficace, en contournant les coûts de calcul importants généralement impliqués pour atteindre des résultats aussi avancés.

2.2. Pourquoi Stable Cascade se démarque#

Qualité esthétique supérieure : Les évaluations révèlent que Stable Cascade surpasse considérablement Stable Diffusion XL dans la production d'images visuellement époustouflantes. Il atteint 2,5 fois la qualité esthétique de SDXL et surpasse étonnamment SDXL Turbo de 5,5 fois, démontrant sa capacité exceptionnelle à produire des visuels de haute qualité.

Vitesse d'inférence améliorée : Grâce à son architecture innovante, Stable Cascade offre un processus d'inférence plus efficace, utilisant les ressources plus efficacement que ses prédécesseurs. Avec un facteur de compression remarquable de 42, il peut transformer des images de 1024x1024 en dimensions compactes de 24x24. Cette efficacité ne compromet pas la qualité de l'image mais accélère plutôt le processus de génération, ce qui en fait un changeur de jeu pour générer rapidement des images.

Meilleure compréhension des prompts : Stable Cascade brille également dans sa capacité à comprendre et à s'aligner sur les prompts de l'utilisateur, qu'ils soient brefs ou détaillés. Les évaluations humaines ont démontré qu'il surpasse les autres modèles dans l'interprétation précise des prompts, garantissant que les images générées correspondent étroitement à la vision de l'utilisateur.