AnimateLCM | テキストからビデオへの高速化

このワークフローは、"Load AnimateLCM LoRA" と "Apply AnimateLCM Motion Model in AnimateDiff" を通じてAnimateLCMを組み込むことで、AnimateDiff-Evolvedワークフローを拡張しています。これにより、パーソナライズされたアニメーション効果の作成がより速く、より効率的になります。ComfyUI AnimateLCM ワークフロー

ComfyUI AnimateLCM 例

ComfyUI AnimateLCM 説明

1. ComfyUI AnimateLCM ワークフロー

ComfyUI AnimateLCM ワークフローは、AIアニメーションの速度を向上させるように設計されています。ComfyUI-AnimateDiff-Evolvedの基盤の上に構築され、このワークフローはAnimateLCMを組み込むことで、特にテキストからビデオ(t2v)アニメーションの作成を加速します。様々なプロンプトとステップを試して、希望する結果を達成できます。

2. AnimateLCMの概要

SDXL、LCM、SDXL Turboなどのテクノロジーの登場により、画像生成のペースは大幅に向上しました。AnimateLCMは、AIアニメーションの進歩をさらに推し進めます。画像からビデオへの高速な生成をサポートし、静止画やテキストの説明からアニメーションビデオを生成する速度と効率を高めることを目的としており、パーソナライズされたアニメーション効果をすばやく作成するのに特に役立ちます。

2.1. AnimateLCMの紹介

AnimateLCMは、デカップルされた一貫性学習を通じて、パーソナライズされた拡散モデルとアダプターのアニメーションを加速するように設計されています。事前学習された画像拡散モデルをdistillしてサンプリングプロセスを高速化するConsistency Model(CM)と、条件付き画像生成に焦点を当てたそのExtension、Latent Consistency Model(LCM)に触発されています。AnimateLCMは、これらの基盤を活用して、わずか数ステップで高精度のビデオを作成できるようにし、画像拡散と生成技術の成功を基に、それらの機能をビデオドメインに拡張します。

2.2. ComfyUIワークフローでAnimateLCMを使用する方法

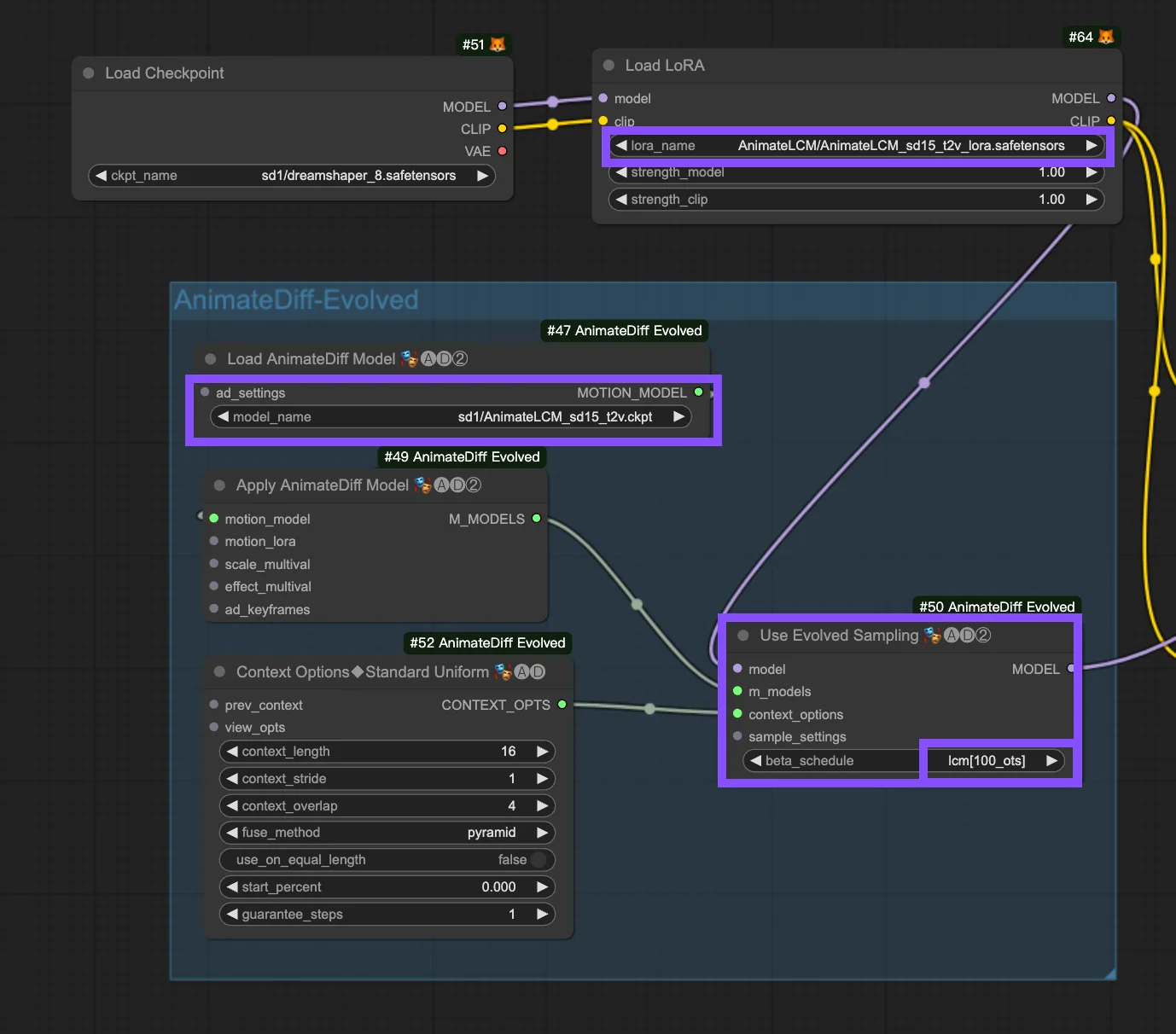

このワークフローは、 ワークフローの上に構築されています。以下は、"Use Evolved Sampling" ノードの設定パラメータです。

Models: チェックポイントモデルとLoRAモデルを設定します。

- Checkpoint: これは、アニメーション作成に使用されるStableDiffusion(SD)モデルの入力に関連します。選択したモーションモデルによって、SD1.5やSDXLなど、SDのバージョン間の互換性が異なる場合があります。

- LoRA: AnimateLCM LoRAモデル を組み込むことで、サンプリング速度を犠牲にすることなく、一貫性学習に重点を置いて、さまざまな機能のための既存のアダプターを効率的に統合し、出力品質を向上させます。

Motion Models (M Models): Apply AnimateDiff Modelプロセスからの出力であり、AnimateLCM Motion Modelの使用を可能にします。

Context Options: これらの設定は、アニメーション制作中のAnimateDiffの動作を調整し、Unet全体またはモーションモジュール内で、スライディングコンテキストウィンドウを使用して任意の長さのアニメーションを可能にします。また、複雑なアニメーションシーケンスのタイミング調整も可能にします。を参照してください。

Beta Schedule in Sample Settings: LCMを選択します。ComfyUIのAnimateDiffのSample Settingsでは、"lcm"、"lineart"などのオプションを含む"beta schedule"の選択により、拡散プロセス全体でノイズレベルを調整するベータ値を微調整します。このカスタマイズは、アニメーションの視覚的スタイルと流動性に影響します。各設定は、特定のアニメーションまたはモーションモデルのニーズに対応しています。

- LCM(Latent Consistency Module): "lcm"設定はLCM LoRAsに合わせて調整され、アニメーションの均一性を高め、作成時間を短縮します。ステップ数を減らし(最小約4ステップまで)、他のパラメータを調整することで、より迅速な収束と最適な詳細の保持を実現します。

- Linear(AnimateDiff-SDXL): SDXLモーションモジュールを使用するAnimateDiffに推奨されるこのオプションは、ディテールの保存とスムーズな動きのバランスを取り、特定のモーションモデルバージョンとの互換性を示します。

- Sqrt_lineart(AnimateDiff): "lineart"と同様に、このバリアントはAnimateDiffプロセス、特にV2モーションモジュールで設計されており、ノイズレベルを変更してモーションモデルの出力を補完し、よりスムーズな遷移や動きを実現します。