MimicMotionとは

MimicMotionは、Tencentと上海交通大学の研究者によって開発された制御可能なビデオ生成フレームワークです。任意のモーションガイダンスに従って任意の長さの高品質なビデオを生成できます。従来の方法と比較して、MimicMotionは豊かなディテール、優れた時間的滑らかさ、および長いシーケンスを生成する能力に優れています。

MimicMotionの仕組み

MimicMotionは、参照画像とポーズガイダンスを入力として受け取ります。次に、提供されたモーションシーケンスに従いながら、参照画像の外観に一致するビデオを生成します。

MimicMotionの強力なパフォーマンスを支えるいくつかの重要な革新があります:

- 信頼度認識ポーズガイダンス: ポーズ信頼度情報を組み込むことで、MimicMotionは時間的滑らかさを向上させ、ノイズの多いトレーニングデータにも強くなります。これにより、一般化がうまくいきます。

- 領域損失増幅: 特に手のような高信頼度ポーズ領域に損失を集中させることで、生成されたビデオの画像歪みを大幅に減少させます。

- 漸進的潜在融合: 滑らかで長いビデオを効率的に生成するために、MimicMotionはオーバーラップフレームを持つビデオセグメントを生成し、その潜在表現を漸進的に融合させます。これにより、計算コストを制御しながら任意の長さのビデオを生成できます。

モデルはまず大規模なビデオデータセットで事前トレーニングされ、その後モーション模倣タスクのために微調整されます。この効率的なトレーニングパイプラインは、膨大な量の専門データを必要としません。

ComfyUI MimicMotionの使用方法 (ComfyUI-MimicMotionWrapper)

ComfyUIで利用可能なさまざまなMimicMotionノードをテストした後、最高の結果を得るためにkijai's ComfyUI-MimicMotionWrapperを使用することをお勧めします。

ステップ1: MimicMotionの入力を準備する

ComfyUI MimicMotionでアニメーションを開始するには、2つの重要な要素が必要です:

- 参照画像: これはアニメーションの開始点となる初期フレームです。アニメーションしたい対象を明確に描写した画像を選択してください。

- ポーズ画像: これらはモーションシーケンスを定義する画像です。各ポーズ画像は、アニメーションの特定のポイントで対象の望ましい位置またはポーズを示す必要があります。これらのポーズ画像は手動で作成するか、ビデオからポーズを抽出するポーズ推定ツールを使用して作成できます。

🌟参照画像とポーズ画像が最適な結果を得るために同じ解像度とアスペクト比を持っていることを確認してください。🌟

ステップ2: MimicMotionモデルを読み込む

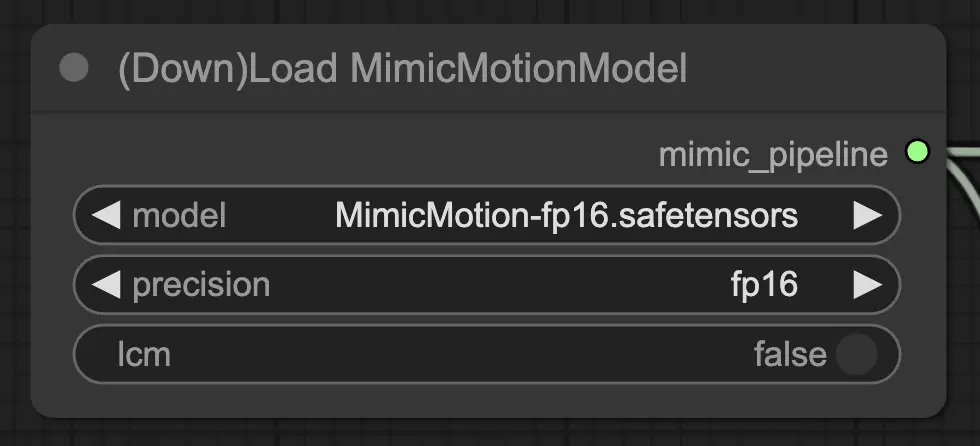

ComfyUI MimicMotionは、適切に機能するためにMimicMotionモデルを必要とします。RunComfyでは、モデルはすでに事前に読み込まれています。"DownLoadMimicMotionModel"ノードを構成するには、次の手順に従ってください:

- "model"パラメータを"MimicMotion-fp16.safetensors"(または異なる場合は適切なモデルファイル名)に設定します。

- GPUの能力に基づいて、希望の精度(fp32、fp16、またはbf16)を選択します。この選択はパフォーマンスと互換性に影響を与える可能性があります。

- "lcm"パラメータをFalseのままにします。LCM(潜在条件モーション)バリアントのモデルを使用する特定の理由がない限り。

ノード設定を構成したら、"DownloadAndLoadMimicMotionModel"ノードの出力をワークフローの次のノードの入力に接続します。これにより、読み込まれたMimicMotionモデルがComfyUIパイプラインの後続のステップで適切に利用されるようになります。

ステップ3: MimicMotionサンプラーの構成

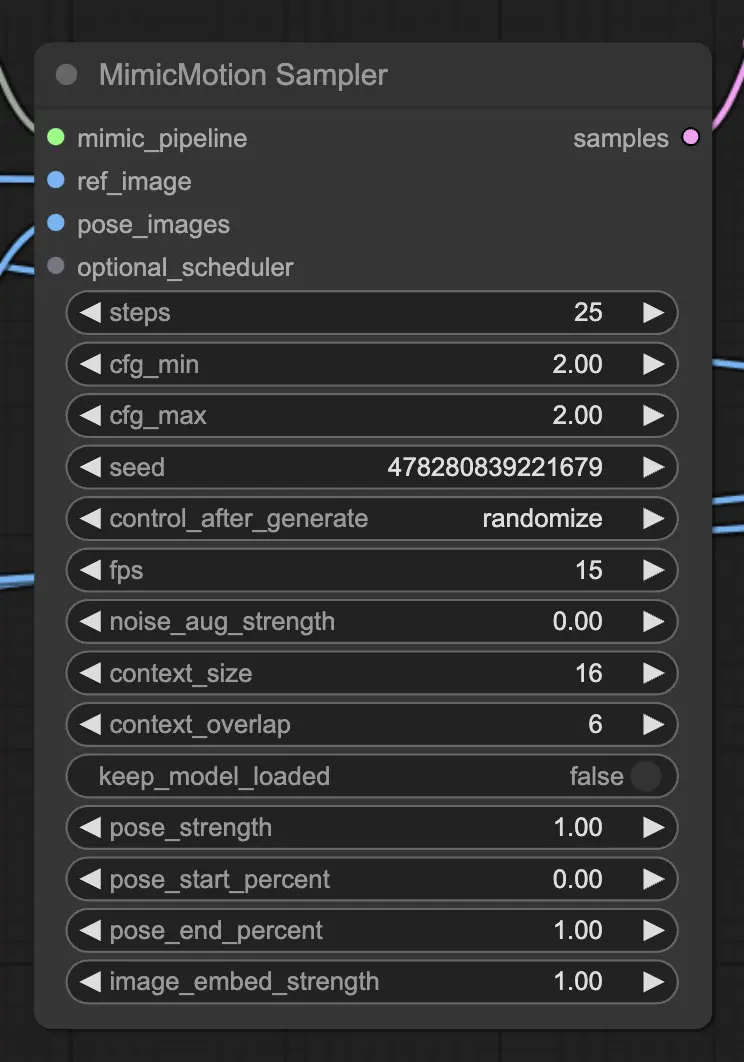

"MimicMotionSampler"ノードは、入力に基づいてアニメーションフレームを生成する役割を果たします。設定方法は次のとおりです:

- "MimicMotionSampler"ノードを追加し、"DownloadAndLoadMimicMotionModel"ノードの出力に接続します。

- "ref_image"パラメータを参照画像に設定し、"pose_images"パラメータをポーズ画像のシーケンスに設定します。

- サンプリング設定を好みに応じて調整します:

- "steps"は拡散ステップの数を決定します(値が高いほど滑らかな結果になりますが、処理時間が長くなります)。

- "cfg_min"および"cfg_max"は条件付きガイダンスの強さを制御します(値が高いほどポーズ画像に厳密に従います)。

- "seed"は再現性のためのランダムシードを設定します。

- "fps"は生成されたアニメーションのフレーム毎秒を指定します。

- "noise_aug_strength"、"context_size"、"context_overlap"などの追加パラメータを微調整して、さまざまなスタイルや時間的整合性を試してみてください。

ステップ4: 潜在サンプルのデコード

"MimicMotionSampler"ノードは、アニメーションフレームの潜在空間表現を出力します。これらの潜在を実際の画像に変換するには、"MimicMotionDecode"ノードを使用する必要があります:

- "MimicMotionDecode"ノードを追加し、"MimicMotionSampler"ノードの出力に接続します。

- "decode_chunk_size"パラメータを設定して、同時にデコードされるフレーム数を制御します(値が高いほどGPUメモリを多く消費する可能性があります)。

"MimicMotionDecode"ノードの出力は、画像形式の最終的なアニメーションフレームになります。

ステップ5: MimicMotionGetPosesでポーズを強化する

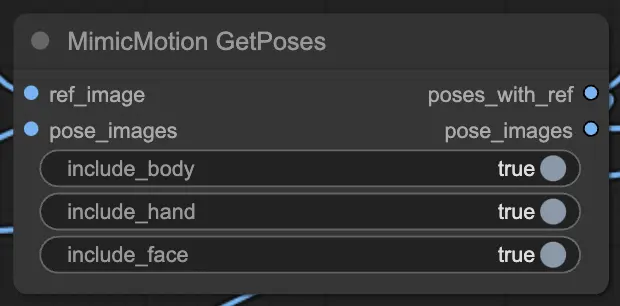

参照画像と一緒に抽出されたポーズを視覚化したい場合は、"MimicMotionGetPoses"ノードを使用できます:

- "ref_image"と"pose_images"を"MimicMotionGetPoses"ノードに接続します。

- "include_body"、"include_hand"、および"include_face"パラメータを設定して、表示されるポーズキーポイントを制御します。

出力には、抽出されたポーズと個々のポーズ画像を持つ参照画像が含まれます。

ヒントとベストプラクティス

ComfyUI MimicMotionを最大限に活用するためのヒントをいくつか紹介します:

- さまざまな参照画像とポーズシーケンスを試して、さまざまなアニメーションを作成します。

- サンプリング設定を調整して、ニーズに基づいて品質と処理時間のバランスを取ります。

- 最高の結果を得るために、高品質で一貫性のあるポーズ画像を使用します。ポーズ間の視点や照明の大きな変化を避けてください。

- 高解像度画像や長いアニメーションを扱う際には、GPUメモリの使用量を監視してください。

- "DiffusersScheduler"ノードを活用して、ノイズスケジューリングをカスタマイズし、独自の効果を得ることができます。

ComfyUI MimicMotionは、驚くべきアニメーションを簡単に作成できる強力で多用途なツールです。ワークフローを理解し、さまざまなパラメータを探求することで、誰でも簡単にアニメーションを作成できます。アニメーションの世界に足を踏み入れる際には、実験し、繰り返し、プロセスを楽しむことを忘れずに。ComfyUI MimicMotionを使用すれば、可能性は無限大です。あなたのクリエイティブなビジョンを実現する楽しさを味わってください!