ComfyUI > Fluxos de Trabalho > Linear Mask Dilation | Animações Impressionantes

Linear Mask Dilation | Animações Impressionantes

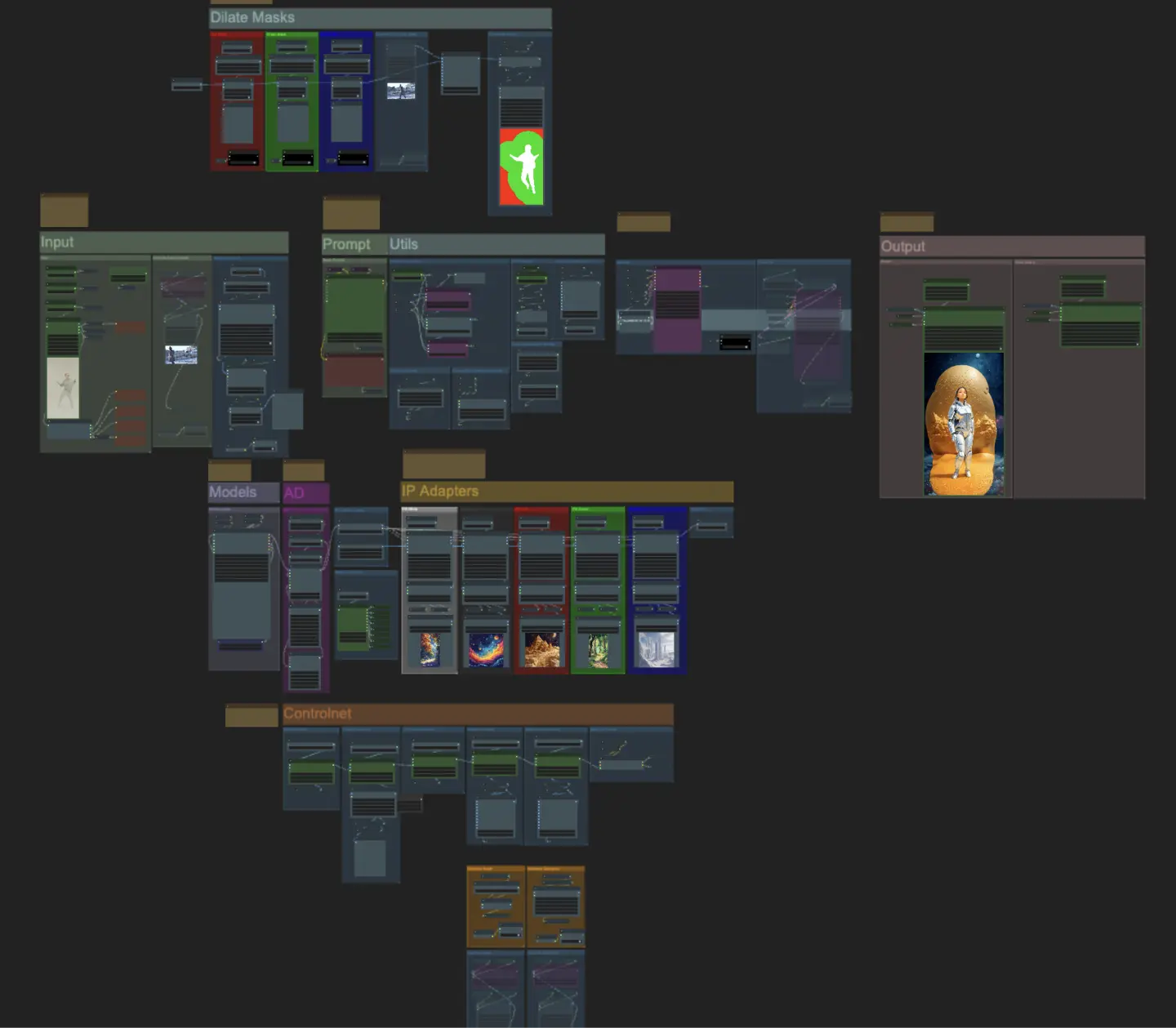

ComfyUI Linear Mask Dilation é um fluxo de trabalho poderoso para criar animações de vídeo impressionantes. Ao transformar seu sujeito, como um dançarino, você pode fazer com que ele viaje por diferentes cenas de forma contínua usando um efeito de dilatação de máscara. Este fluxo de trabalho é especificamente projetado para vídeos com um único sujeito. Siga o guia passo a passo para aprender a usar o Linear Mask Dilation de forma eficaz, desde o upload do vídeo do sujeito até a configuração de prompts e ajuste de vários parâmetros para obter resultados ótimos. Libere sua criatividade e dê vida às suas animações de vídeo com ComfyUI Linear Mask Dilation.ComfyUI Linear Mask Dilation Fluxo de Trabalho

Deseja executar este fluxo de trabalho?

- Fluxos de trabalho totalmente operacionais

- Sem nós ou modelos ausentes

- Nenhuma configuração manual necessária

- Apresenta visuais impressionantes

ComfyUI Linear Mask Dilation Exemplos

ComfyUI Linear Mask Dilation Descrição

ComfyUI Linear Mask Dilation

Crie animações de vídeo impressionantes transformando seu sujeito (dançarino) e faça-o viajar por diferentes cenas através de um efeito de dilatação de máscara. Este fluxo de trabalho é projetado para ser usado com vídeos de um único sujeito.

Como usar o Fluxo de Trabalho ComfyUI Linear Mask Dilation:

- Carregue um vídeo do sujeito na seção de Entrada

- Selecione a largura e altura desejadas do vídeo final, juntamente com quantos quadros do vídeo de entrada devem ser pulados com "every_nth". Você também pode limitar o número total de quadros a serem renderizados com "frame_load_cap".

- Preencha o prompt positivo e negativo. Defina os tempos de quadros em lote para corresponder ao momento em que deseja que as transições de cena ocorram.

- Carregue imagens para cada uma das cores da máscara do sujeito do IP Adapter:

- Branco = sujeito (dançarino)

- Preto = Primeiro plano de fundo

- Vermelho = Plano de fundo da máscara de dilatação vermelha

- Verde = Plano de fundo da máscara de dilatação verde

- Azul = Plano de fundo da máscara de dilatação azul

- Carregue um bom ponto de verificação LCM (eu uso ParadigmLCM by Machine Delusions) na seção "Models".

- Adicione quaisquer loras usando o Lora stacker abaixo do carregador de modelos

- Clique em Queue Prompt

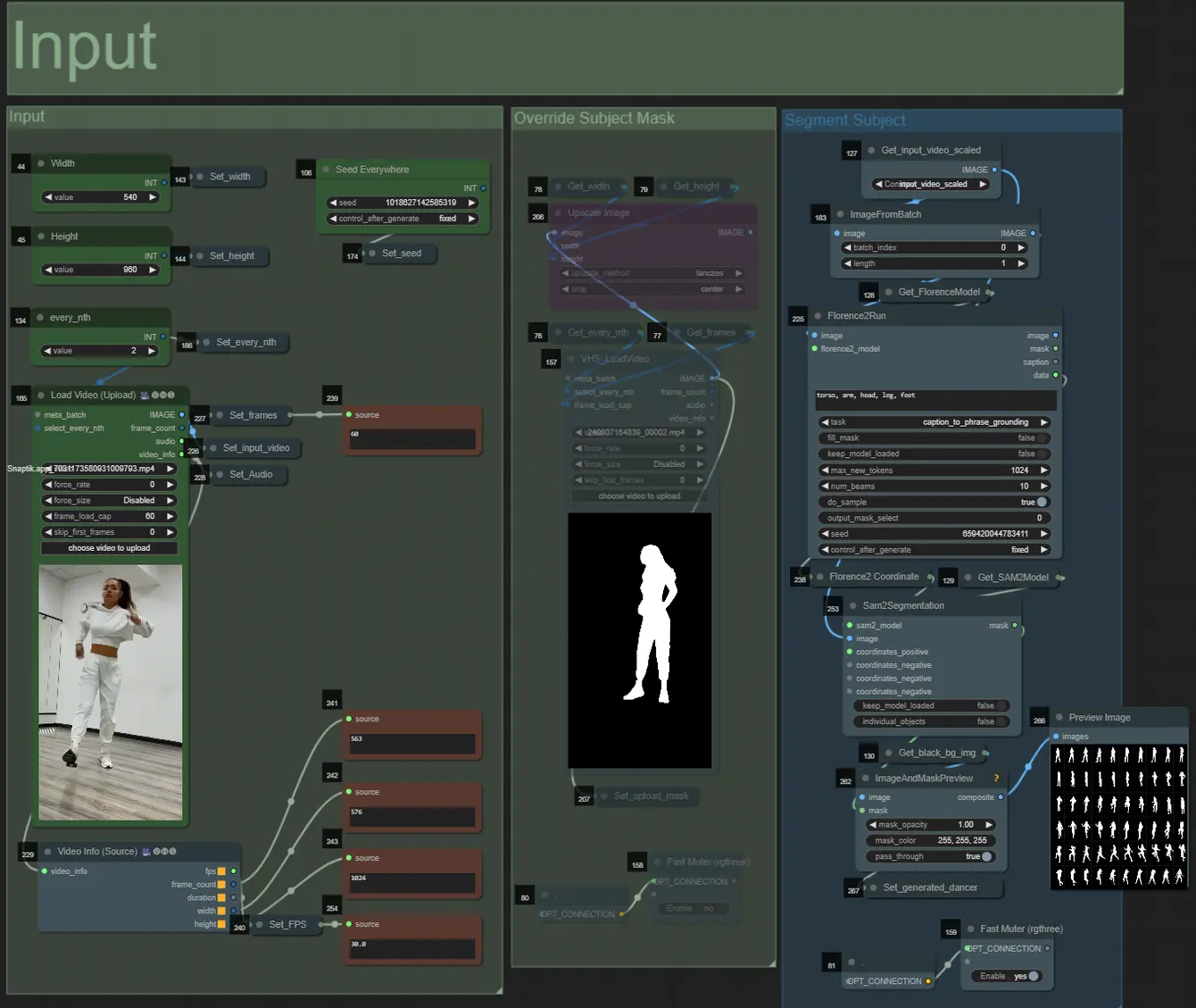

Entrada

- Você pode ajustar a largura e altura usando as duas entradas no canto superior esquerdo

- every_nth define quantos quadros da entrada devem ser pulados (2 = a cada outro quadro)

- Os campos numéricos no canto inferior esquerdo exibem informações sobre o vídeo de entrada carregado: quadros totais, largura, altura e FPS de cima para baixo.

- Se você já tiver um vídeo de máscara do sujeito gerado (deve ser sujeito branco em fundo preto), você pode desmutar a seção "Override Subject Mask" e carregar o vídeo da máscara. Opcionalmente, você pode mutar a seção "Segment Subject" para economizar tempo de processamento.

- Às vezes, o sujeito segmentado não será perfeito, você pode verificar a qualidade da máscara usando a caixa de visualização no canto inferior direito, como visto acima. Se for o caso, você pode brincar com o prompt no nó "Florence2Run" para direcionar diferentes partes do corpo, como "cabeça", "peito", "pernas", etc., e ver se obtém um resultado melhor.

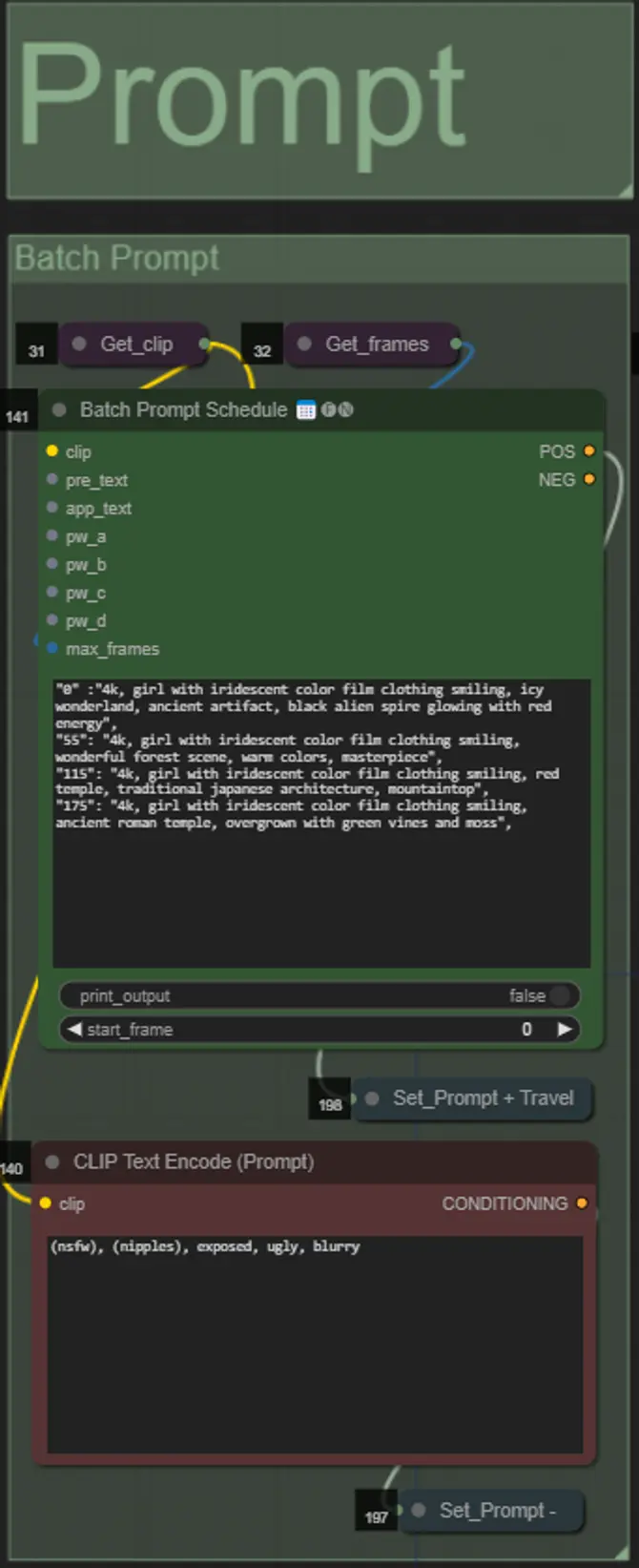

Prompt

- Defina o prompt positivo usando formatação em lote:

- e.g. "0": "4k, masterpiece, 1girl standing on the beach, absurdres", "25": "HDR, sunset scene, 1girl with black hair and a white jacket, absurdres", …

- O prompt negativo é em formato normal, você pode adicionar embeddings se desejar.

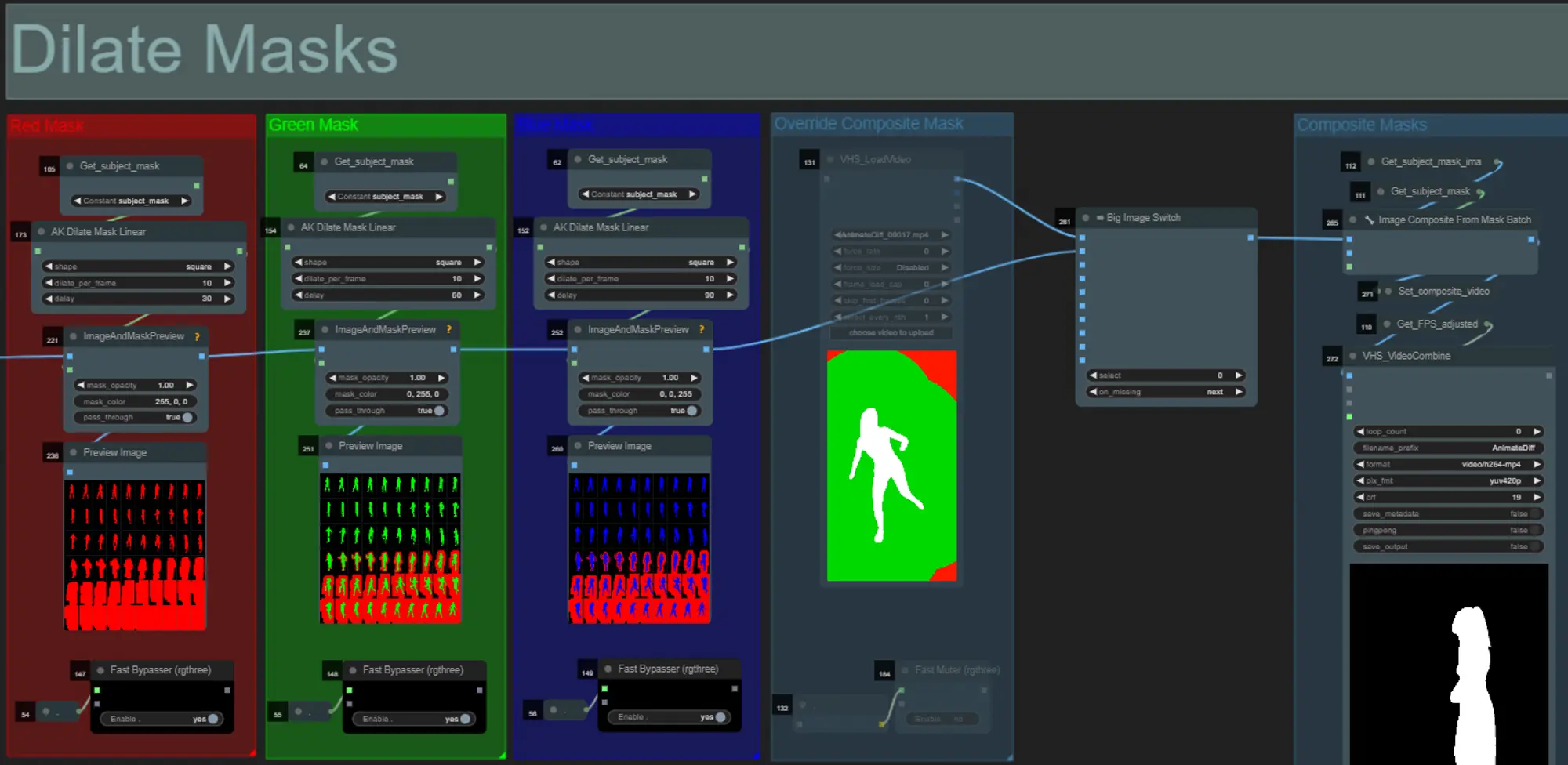

Dilatações de Máscara

- Cada grupo colorido corresponde à cor da máscara de dilatação que será gerada por ele.

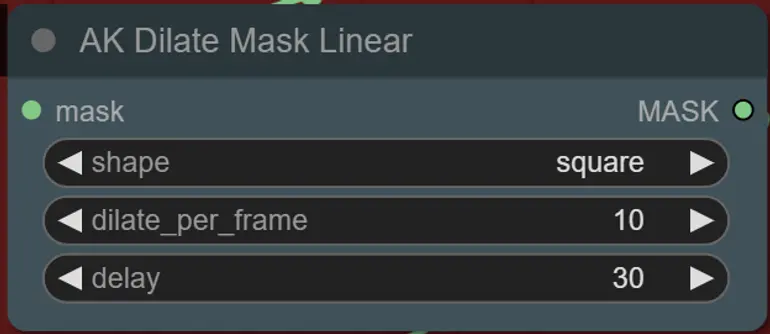

- Você pode definir a forma da máscara, juntamente com a velocidade da dilatação e o atraso do quadro com o seguinte nó:

- shape: "circle" é a mais precisa, mas leva mais tempo para gerar. Defina isso quando estiver pronto para realizar a renderização final. "square" é rápido de calcular, mas menos preciso, melhor para testar o fluxo de trabalho e decidir sobre as imagens do IP adapter.

- dilate_per_frame: Quão rapidamente a máscara deve dilatar, números maiores = maior velocidade de dilatação

- delay: Quantos quadros esperar antes que a máscara comece a dilatar.

- Se você já tiver um vídeo de máscara composta gerado, pode desmutar o grupo "Override Composite Mask" e carregá-lo. Recomenda-se ignorar os grupos de máscara de dilatação se estiver substituindo para economizar tempo de processamento.

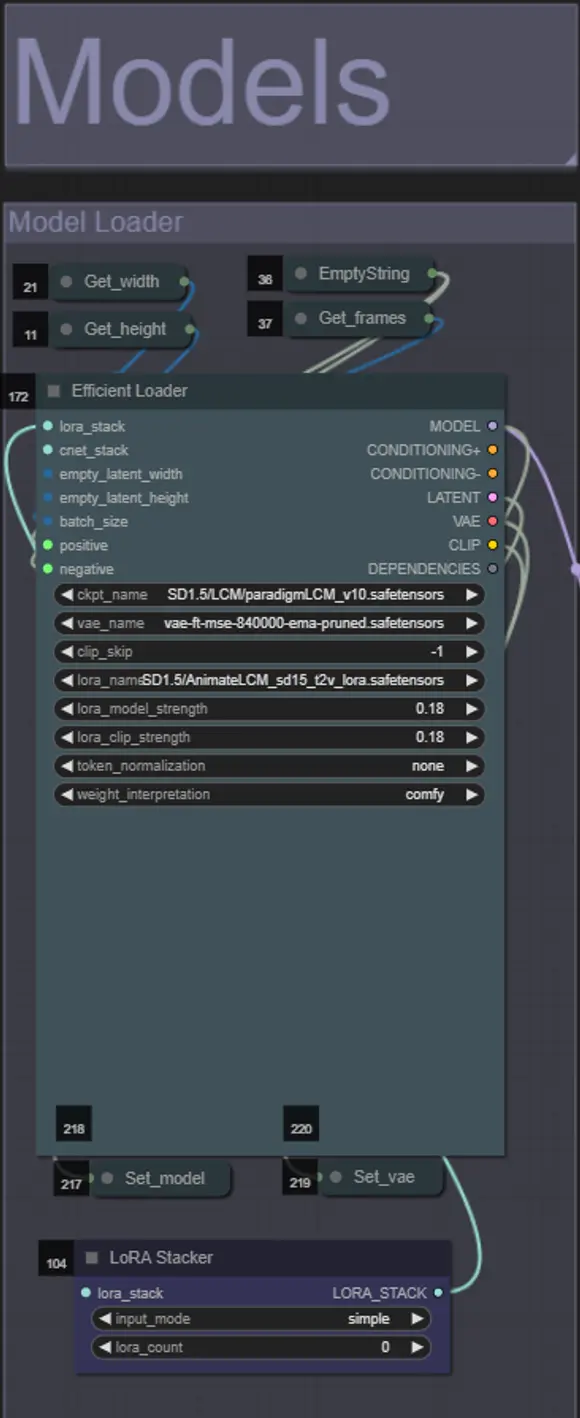

Modelos

- Use um bom modelo LCM para o ponto de verificação. Recomendo ParadigmLCM by Machine Delusions.

- Você pode opcionalmente especificar o AnimateLCM_sd15_t2v_lora.safetensors com um peso baixo de 0.18 para melhorar ainda mais o resultado final.

- Adicione quaisquer Loras adicionais ao modelo usando o Lora stacker azul abaixo do carregador de modelos.

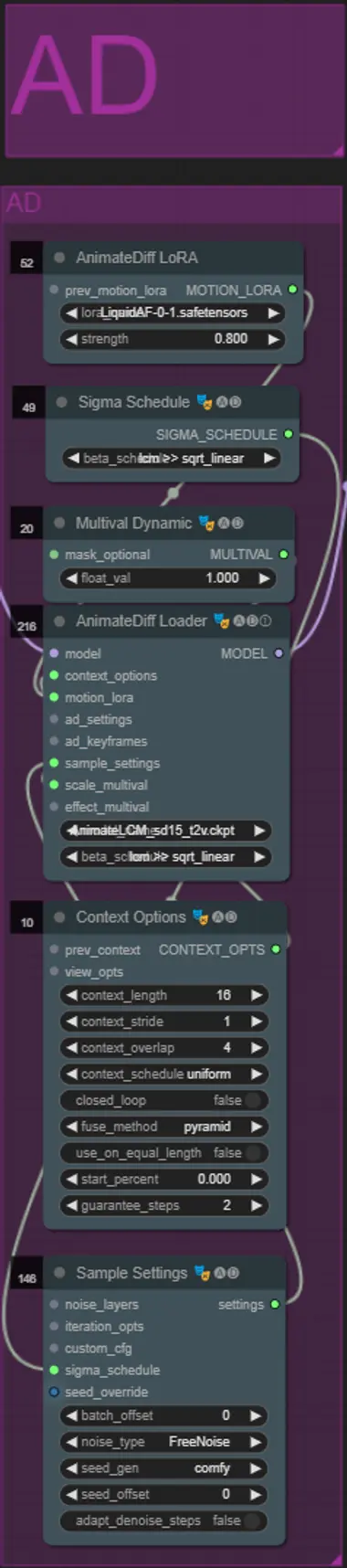

AnimateDiff

- Você pode definir um Motion Lora diferente do que eu usei (LiquidAF-0-1.safetensors)

- Ajuste o valor float do Multival Dynamic mais alto ou mais baixo, dependendo se você quer que o resultado tenha mais ou menos movimento.

IP Adapters

- Aqui você pode especificar os sujeitos de referência que serão usados para renderizar os planos de fundo para cada uma das máscaras de dilatação, bem como o sujeito do seu vídeo.

- A cor de cada grupo representa a máscara que ele alvo:

- Branco = sujeito (dançarino)

- Preto = Primeiro plano de fundo

- Vermelho = Plano de fundo da máscara de dilatação vermelha

- Verde = Plano de fundo da máscara de dilatação verde

- Azul = Plano de fundo da máscara de dilatação azul

- Se você quiser que a renderização final siga mais de perto as imagens do IP adapter de entrada, você pode alterar o preset do IPAdapter de VIT-G para PLUS no grupo IPA Unified Loader.

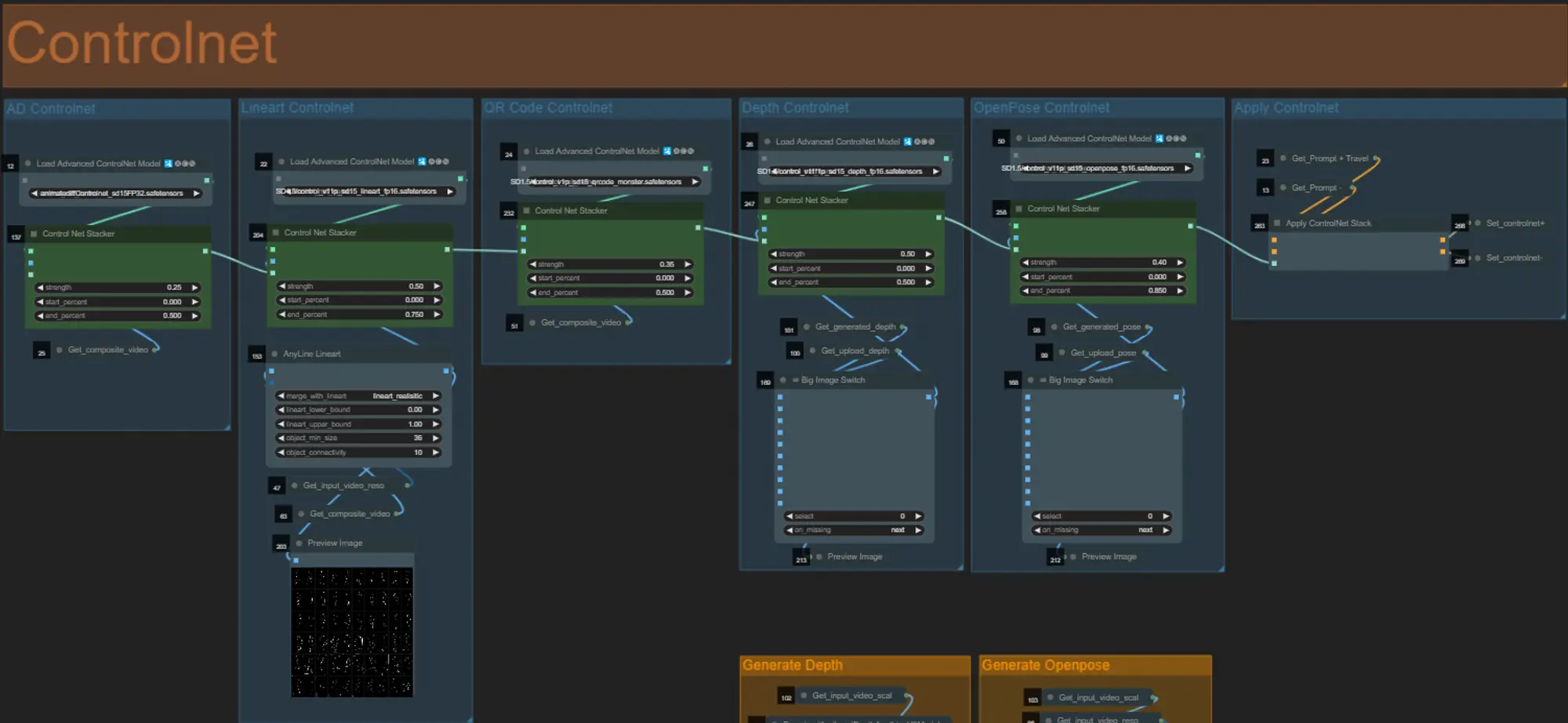

ControlNet

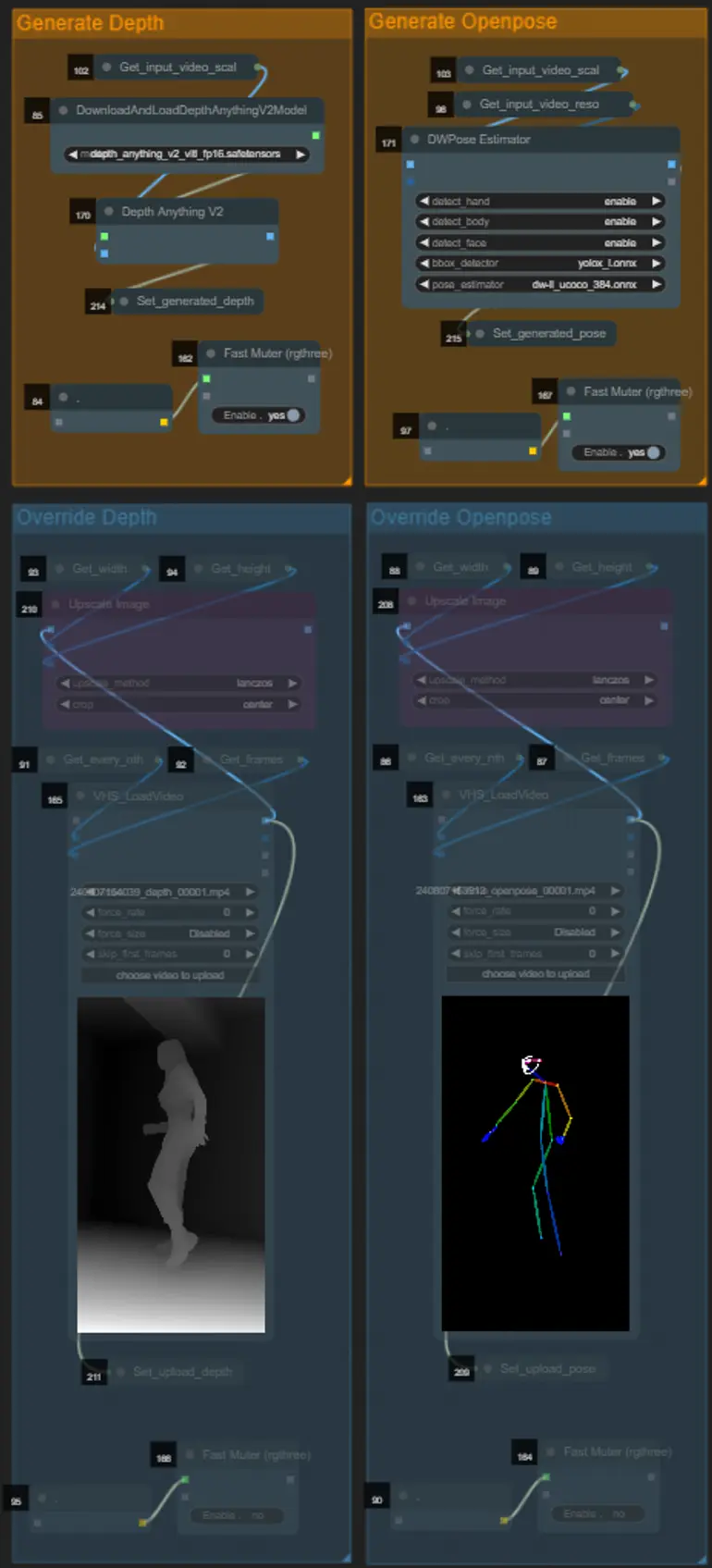

- Este fluxo de trabalho faz uso de 5 controlnets diferentes, incluindo AD, Lineart, QR Code, Depth e OpenPose.

- Todas as entradas para os controlnets são geradas automaticamente

- Você pode escolher substituir o vídeo de entrada para os controlnets Depth e Openpose se desejar, desmutando os grupos "Override Depth" e "Override Openpose" como visto abaixo:

- Recomenda-se mutar os grupos "Generate Depth" e "Generate Openpose" se estiver substituindo para economizar tempo de processamento.

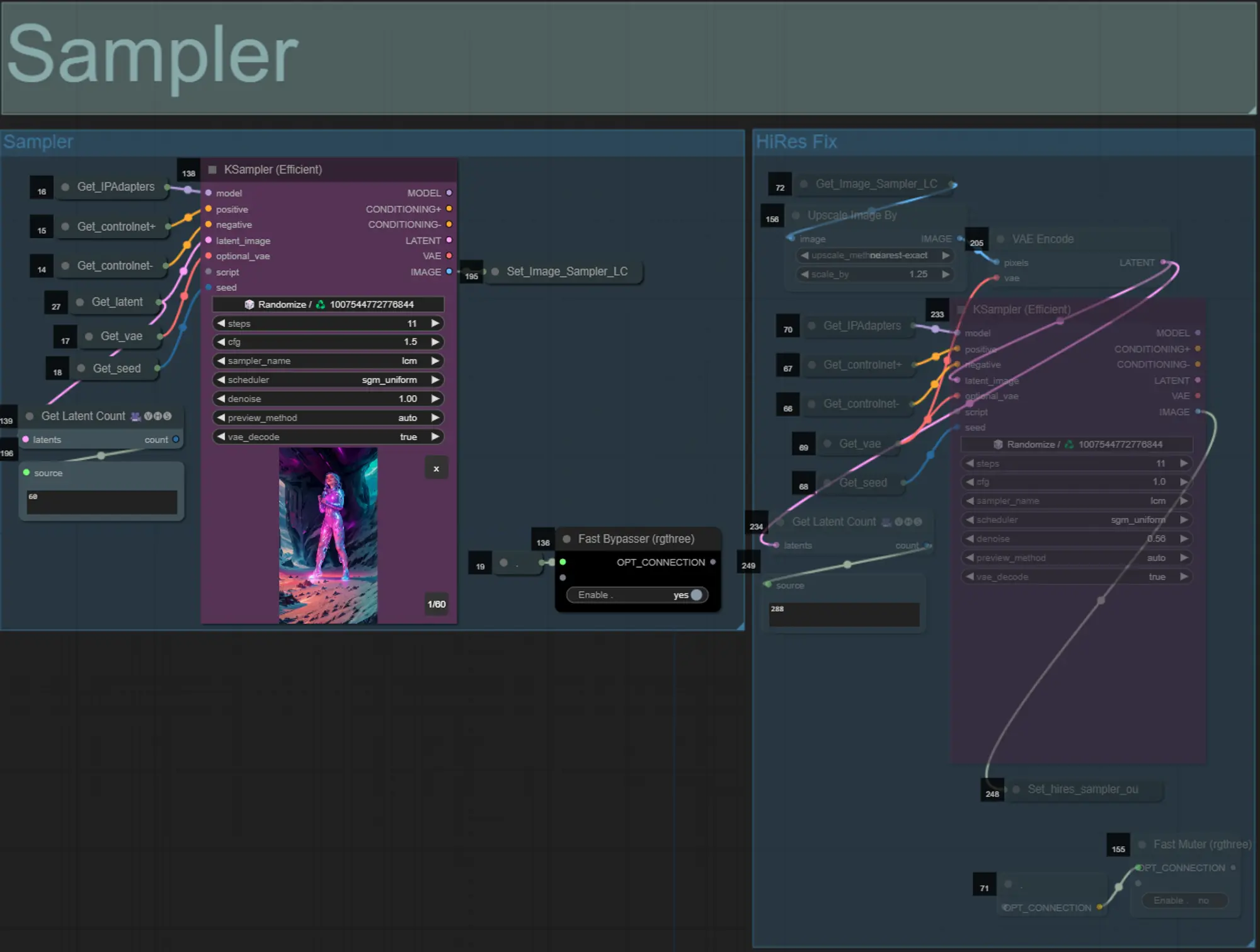

Sampler

- Por padrão, o grupo de sampler HiRes Fix estará mutado para economizar tempo de processamento ao testar

- Recomendo ignorar o grupo Sampler também ao tentar experimentar as configurações da máscara de dilatação para economizar tempo.

- Nas renderizações finais, você pode desmutar o grupo HiRes Fix, que fará a upscale e adicionará detalhes ao resultado final.

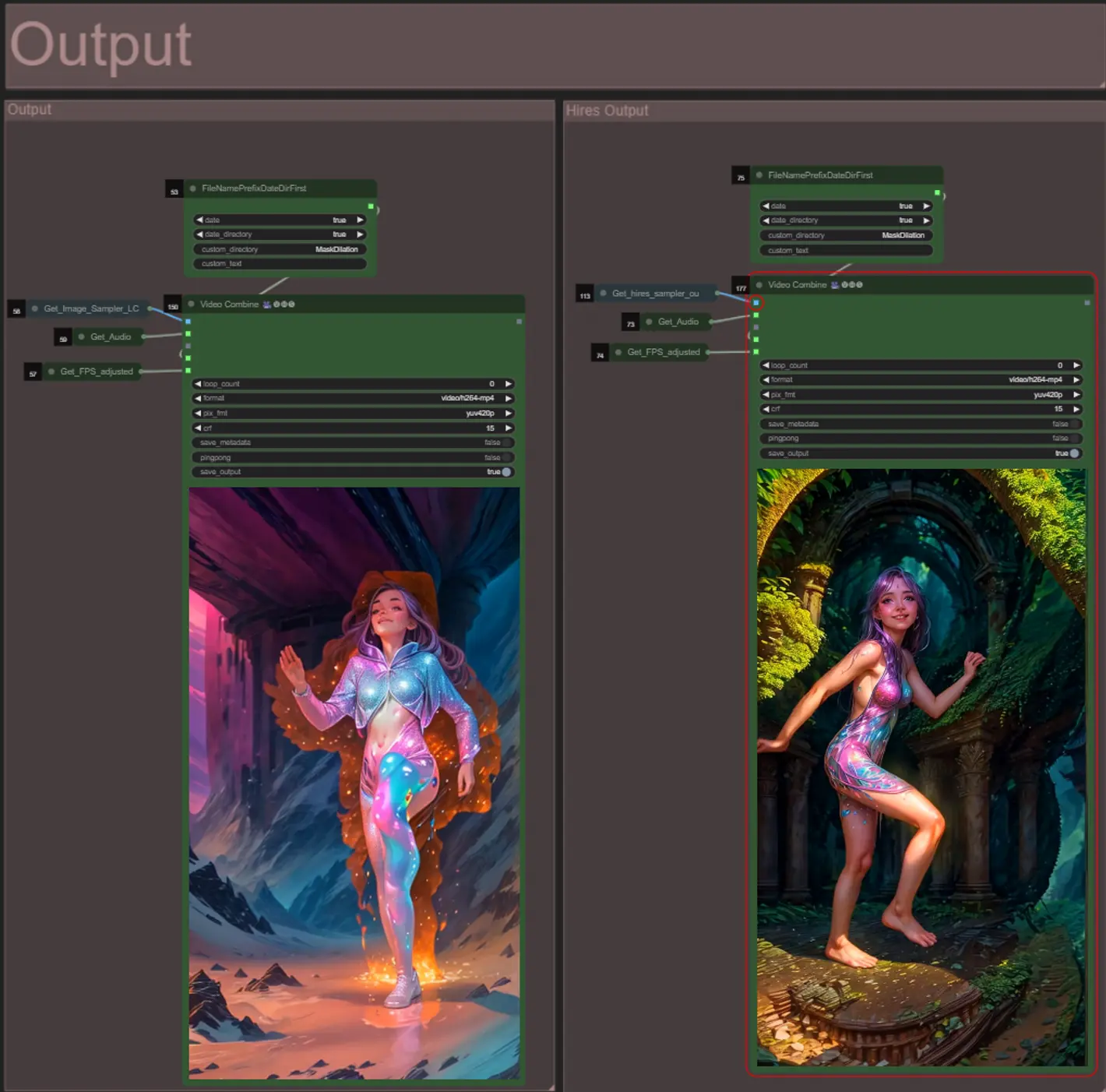

Saída

- Existem dois grupos de saída: o da esquerda é para saída de sampler padrão e o da direita é para saída de sampler HiRes Fix.

- Você pode alterar onde os arquivos serão salvos alterando a string "custom_directory" nos nós "FileNamePrefixDateDirFirst". Por padrão, este nó salvará vídeos de saída em um diretório com carimbo de data/hora no diretório "output" do ComfyUI

- e.g. …/ComfyUI/output/240812/

<custom_directory>/<my_video>.mp4

- e.g. …/ComfyUI/output/240812/

Sobre o Autor

Akatz AI:

- Website:

- https://www.youtube.com/@akatz_ai

- https://www.instagram.com/akatz.ai/

- https://www.tiktok.com/@akatz_ai

- https://x.com/akatz_ai

- https://github.com/akatz-ai

Contatos:

- Email: akatzfey@sendysoftware.com