Transformation de Vidéo de Danse | Personnalisation de Scène & Échange de Visage

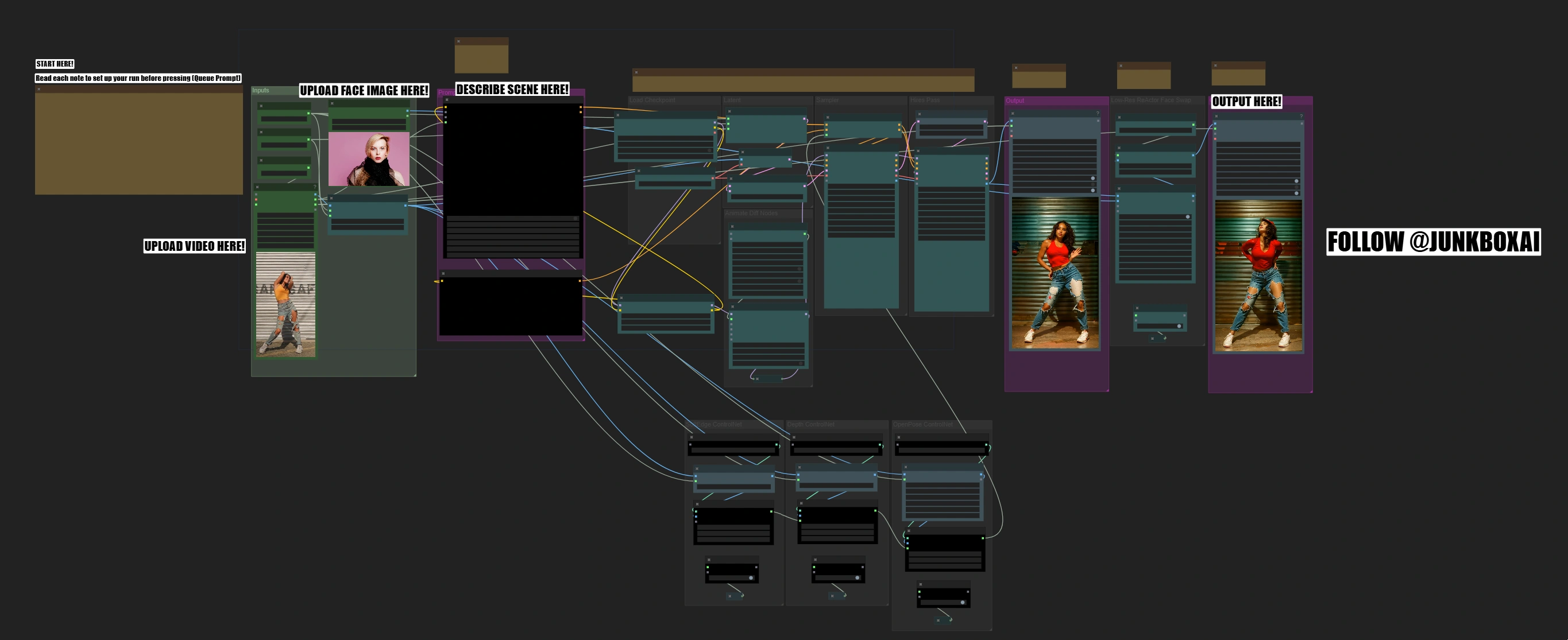

Ce processus de Transformation de Vidéo de Danse combine le modèle SD1.5, AnimateDiff, ControlNet, et ReActor pour échanger des visages afin de fournir des transformations de chorégraphie de haute qualité. Il préserve le mouvement du danseur en utilisant une triple guidance ControlNet (Edge, Depth, et OpenPose), tandis que ReActor et CodeFormer assurent un échange de visage précis avec une fidélité améliorée. Le processus prend en charge le contrôle dynamique des scènes grâce à la planification par lots des invites, permettant une personnalisation spécifique par image. Avec les options de contexte de AnimateDiff et l'échelle de mouvement adaptative, il assure une préservation du mouvement fluide et naturelle tout au long de la transformation.Flux de travail ComfyUI Dance Video Transform

- Workflows entièrement opérationnels

- Aucun nœud ou modèle manquant

- Aucune configuration manuelle requise

- Propose des visuels époustouflants

Exemples ComfyUI Dance Video Transform

Description ComfyUI Dance Video Transform

Ce que Fait le Workflow de Transformation de Vidéo de Danse ComfyUI

Le Workflow de Transformation de Vidéo de Danse ComfyUI transforme les vidéos de danse en nouvelles scènes époustouflantes avec un échange de visage professionnel tout en préservant la chorégraphie originale et en garantissant une sortie de haute qualité. Le processus se déroule en plusieurs étapes, de l'analyse du mouvement au remplacement du visage, permettant des vérifications de qualité à chaque étape.

Comment Fonctionne le Workflow de Transformation de Vidéo de Danse ComfyUI

Le workflow transforme votre vidéo de danse en automatisant ces transformations complexes à travers plusieurs étapes, nécessitant seulement votre vidéo, une image de visage, et une description de scène : Analyse du Mouvement → Transfert de Style → Remplacement de Visage

- Analyse les mouvements de danse et les informations spatiales

- Transforme la scène selon votre description

- Intègre le nouveau visage tout en conservant les expressions

Caractéristiques Clés du Workflow de Transformation de Vidéo de Danse ComfyUI

- Optimisé pour le format vertical (rapport d'aspect 9:16)

- Système Triple ControlNet pour des transformations stables

- Échange de visage professionnel avec mélange naturel

- Mode de test rapide (traite 50 images en quelques minutes)

- Prise en charge de la sortie haute résolution (jusqu'à 896px de hauteur)

- Préservation avancée du mouvement utilisant AnimateDiff

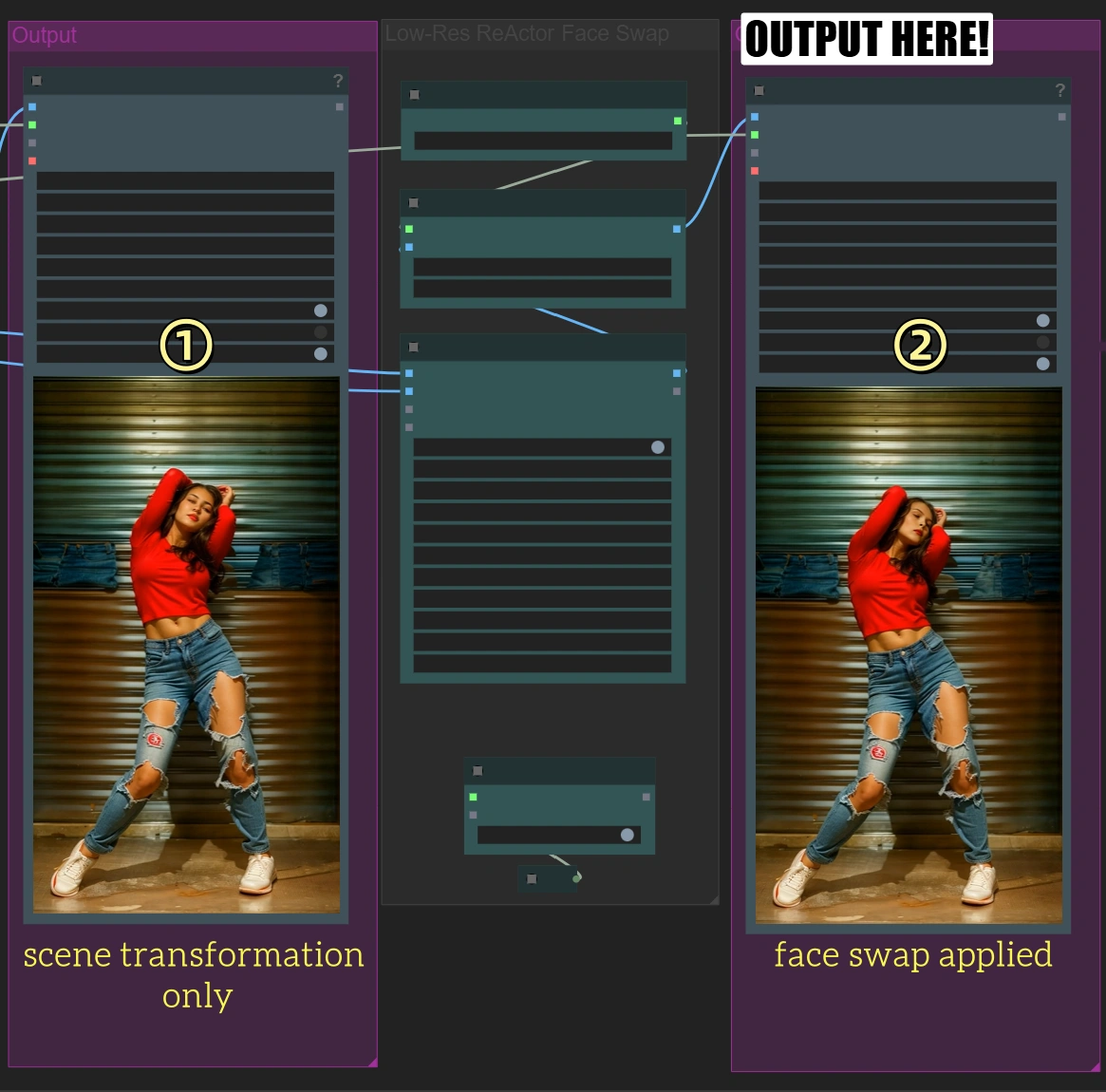

- Système de sortie double pour vérification de la qualité

Guide de Démarrage Rapide

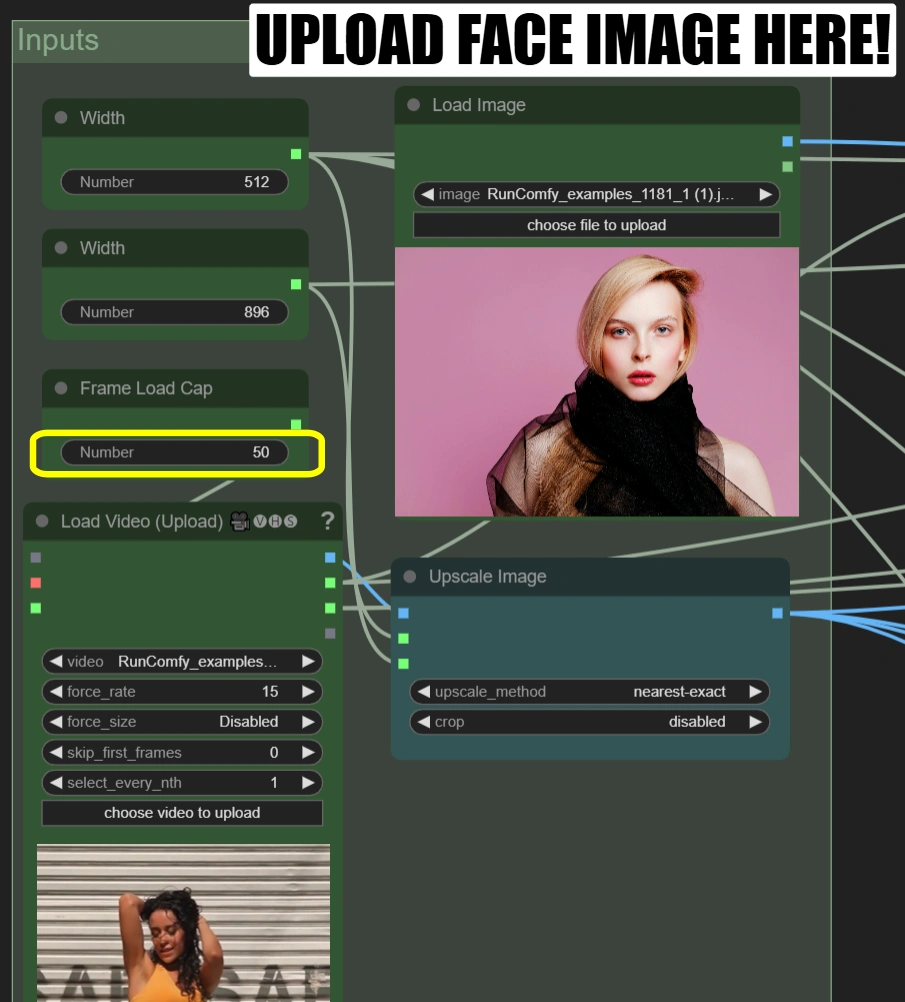

Étape 1 : Configuration Initiale

Dans les nœuds respectifs :

-

Charger Vidéo (Télécharger) :

- Téléchargez une vidéo de danse de 10-15 secondes avec un rapport d'aspect de 9:16

- Si votre vidéo n'est pas en 9:16, vous devrez ajuster les paramètres de Largeur et Hauteur pour correspondre à votre vidéo.

- Limite de Chargement des Images : 50 (rendre seulement les 50 premières images pour un test rapide)

-

Charger Image :

- Téléchargez une photo de visage claire, de face

-

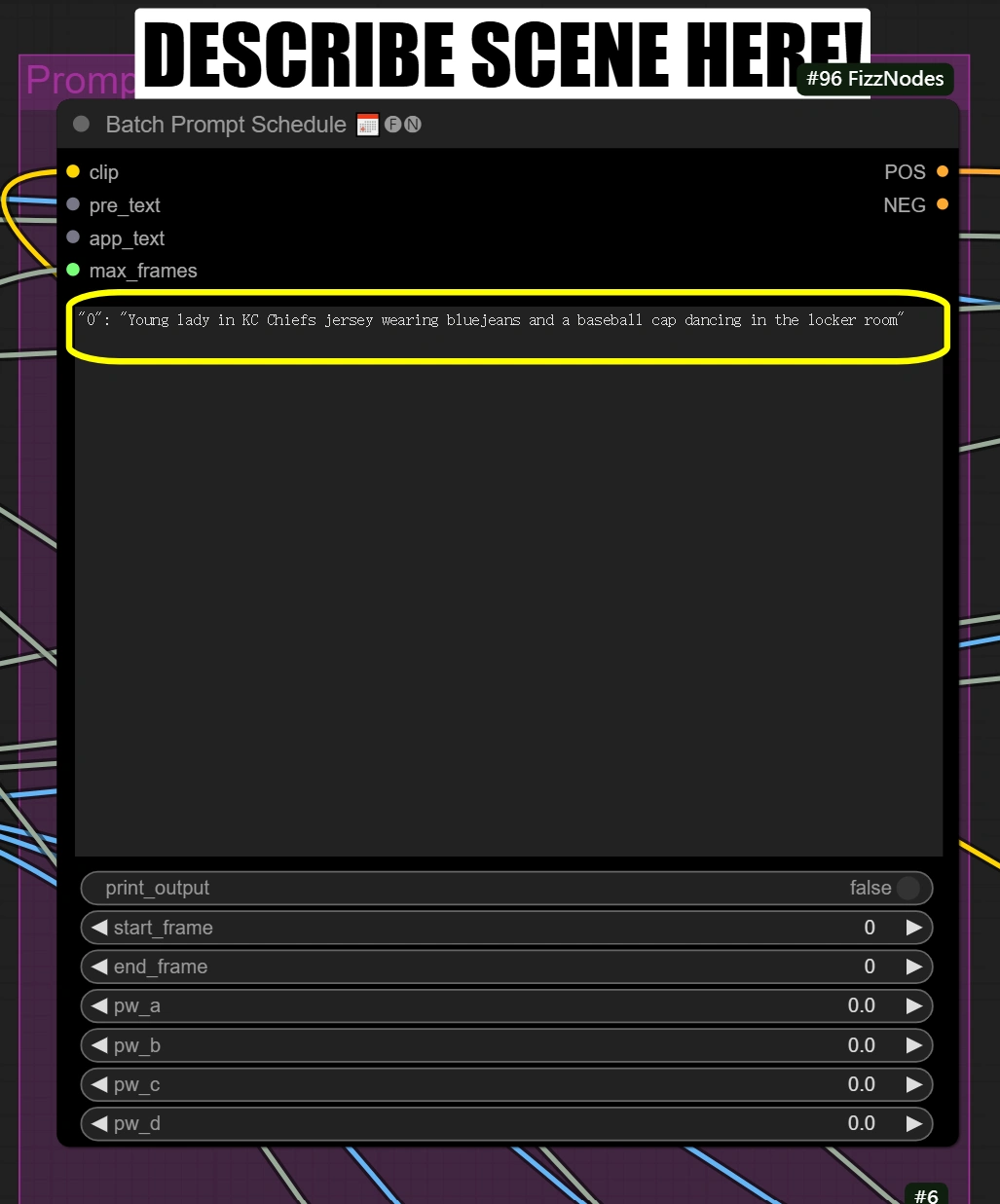

Planification des Invites par Lots :

- Décrivez brièvement la scène et tout autre aspect que vous souhaitez transformer

"0": "[personne] en maillot des KC Chiefs portant un jean bleu et une casquette de baseball dansant dans le vestiaire"

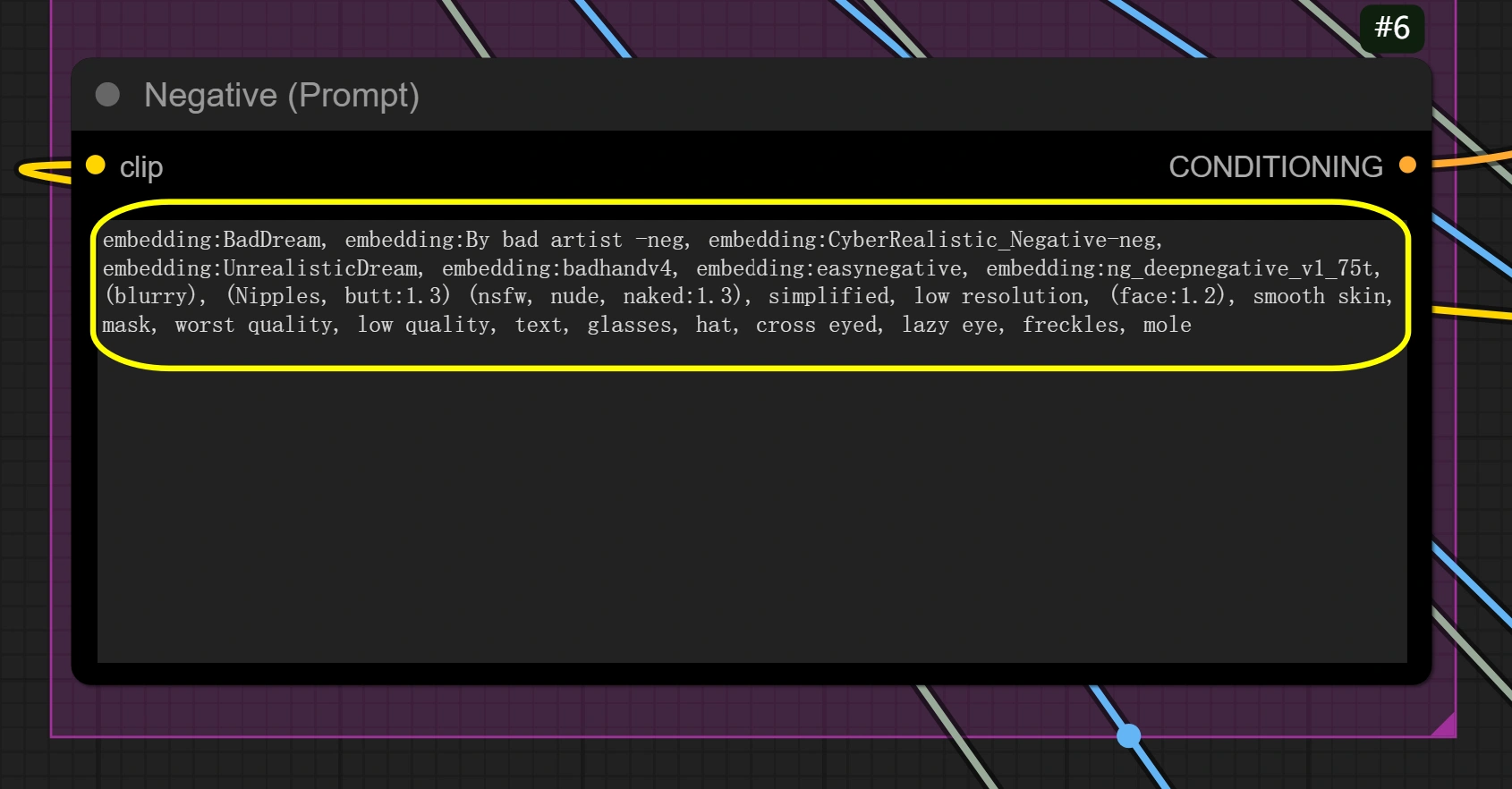

- Définissez une invite négative si nécessaire

Étape 2 : Exécution de Test Rapide

- Cliquez sur "Queue Prompt"

- Cela traite environ 2 secondes de vidéo

- Vous verrez deux sorties :

- Première sortie : Transformation de scène uniquement

- Deuxième sortie : Avec échange de visage appliqué

Étape 3 : Traitement Complet de la Vidéo

Seulement après que le test rapide soit concluant :

- Retournez au nœud "Charger Vidéo"

- Changez la Limite de Chargement des Images à 0 pour la vidéo complète

- Cliquez sur "Queue Prompt" pour un traitement complet (Cela prendra beaucoup plus de temps)

Conseils de l pour les Débutants

- Suivez les Notes : Cherchez toute note dans l'interface—elles vous guideront étape par étape

- Ne vous inquiétez pas pour les Paramètres Avancés : La plupart du temps, vous n'avez pas besoin d'ajuster quoi que ce soit au-delà de ce qui est mentionné ici

- Importance du Rapport d'Aspect : Assurez-vous que le rapport d'aspect est correct, sinon la vidéo peut sembler étirée ou recadrée

Référence des Nœuds Clés

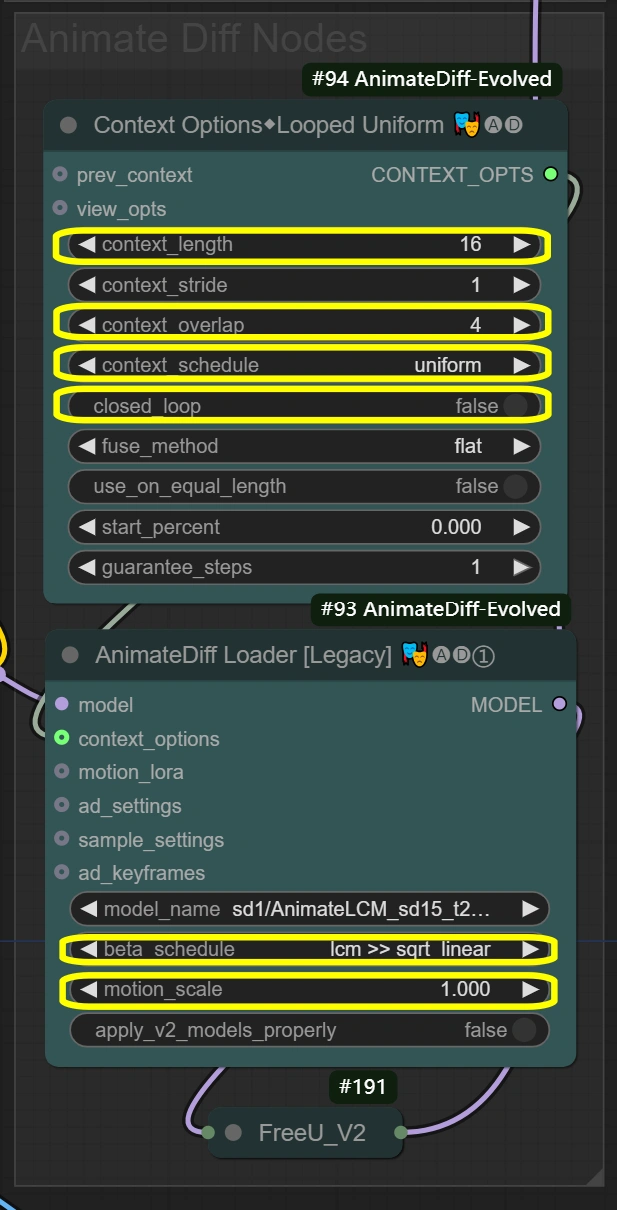

Paramètres AnimateDiff

Les nœuds ici créent une préservation du mouvement fluide tout au long de la transformation vidéo. Les Options de Contexte définissent comment les images doivent être groupées et traitées, alimentant ces paramètres au Chargeur AnimateDiff, qui applique ensuite la préservation réelle du mouvement. Les paramètres de longueur et de chevauchement du contexte affectent directement comment le Chargeur AnimateDiff maintient la cohérence du mouvement.

- Nœud des Options de Contexte (#94) : Réalise le groupement des images et le contrôle du traitement temporel pour un mouvement cohérent.

- longueur_contexte :

- Contrôle combien d'images sont traitées ensemble

- Plus élevé = plus fluide mais plus d'utilisation de VRAM

- Plus bas = plus rapide mais peut perdre la cohérence du mouvement

- chevauchement_contexte :

- Gère la fluidité de transition des images

- Plus élevé = meilleur mélange mais traitement plus lent

- Plus bas = plus rapide mais peut montrer des écarts de transition

- planification_contexte :

- Contrôle la distribution des images

- "uniforme" est le meilleur pour le mouvement de danse

- Ne changez pas à moins de besoins spécifiques

- boucle_fermée :

- Contrôle le comportement de boucle vidéo

- True uniquement pour des vidéos parfaitement en boucle

- longueur_contexte :

- Nœud Chargeur AnimateDiff (#93) : Implémente la préservation du mouvement en utilisant le modèle AnimateDiff et applique la cohérence temporelle.

- échelle_mouvement :

- Contrôle la force du mouvement

- Plus élevé : Mouvement exagéré

- Plus bas : Mouvement atténué

- planification_beta : lcm >> sqrt_linear

- Contrôle le comportement d'échantillonnage

- Optimisé pour ce workflow

- Ne modifiez pas sauf si nécessaire

- échelle_mouvement :

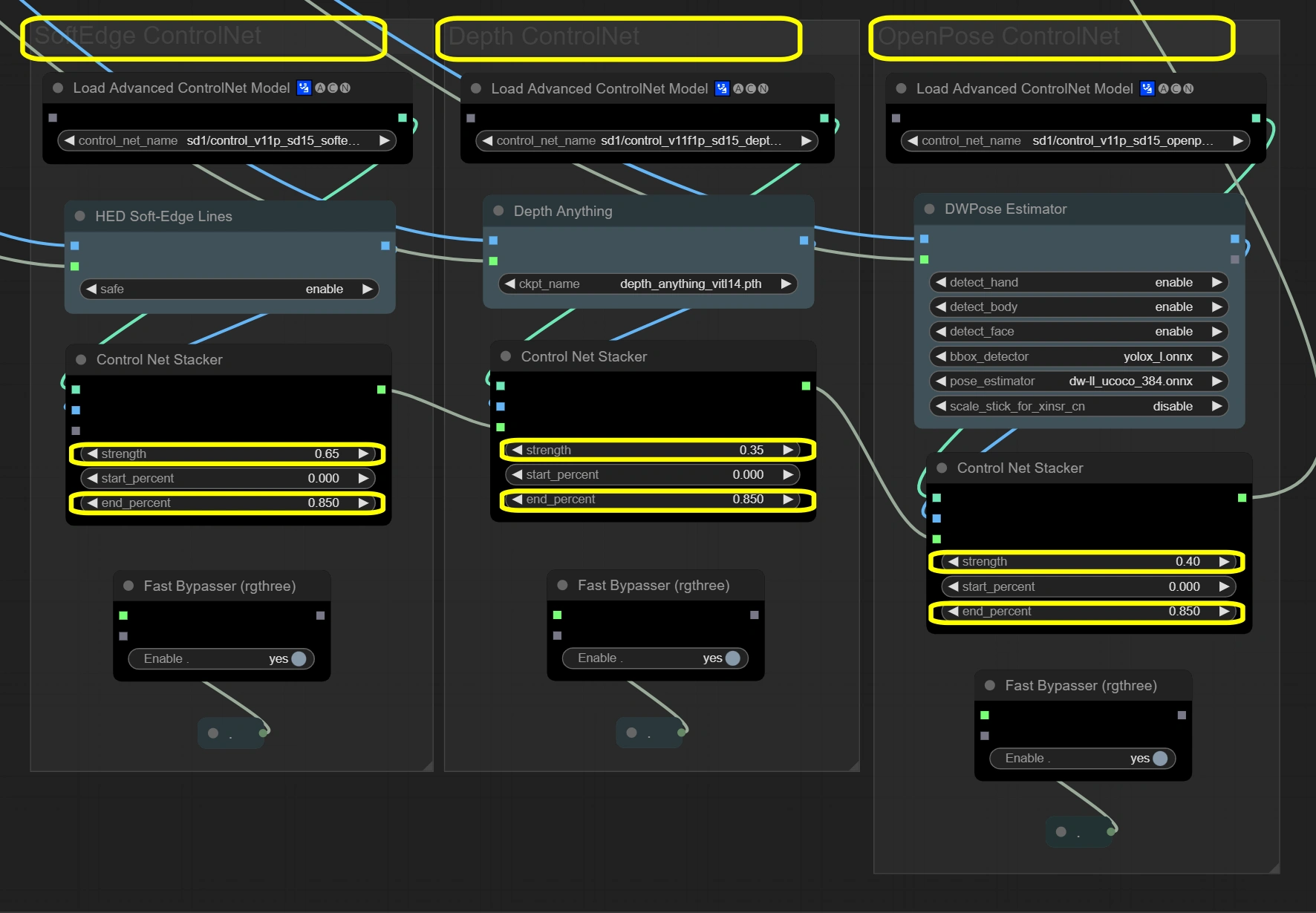

Pile ControlNet

Les nœuds ici maintiennent l'intégrité de la vidéo grâce à un système de guidance à trois couches. Les trois ControlNets traitent les images d'entrée simultanément, chacune se concentrant sur différents aspects. Soft Edge fournit la structure de base, Depth ajoute une compréhension spatiale, et OpenPose assure la précision du mouvement. Les résultats sont combinés à travers des empileurs avec une force totale ne dépassant pas 1.4 pour la stabilité.

- ControlNet Soft Edge : Extrait et préserve les éléments et formes structurels des images originales.

- Force :

- Contrôle la préservation structurelle

- Plus élevé = adhérence plus forte aux formes originales

- Plus bas = plus de liberté créative dans la modification des formes

- Pourcentage fin :

- Quand l'influence de contrôle s'arrête

- Plus élevé = influence plus longue tout au long du processus

- Plus bas = permet plus de déviation dans les étapes ultérieures

- Force :

- ControlNet Depth : Traite les relations spatiales et maintient la cohérence 3D.

- Force :

- Contrôle la conscience spatiale

- Plus élevé = cohérence 3D plus forte

- Plus bas = plus de liberté artistique avec l'espace

- Pourcentage fin :

- Maintient la durée de l'influence de la profondeur

- Devrait correspondre à Soft Edge pour la cohérence

- Force :

- ControlNet OpenPose : Capture et transfère les informations de pose pour un mouvement précis.

- Force :

- Contrôle la préservation de la pose

- Plus élevé = suivi de pose plus strict

- Plus bas = interprétation de pose plus flexible

- Pourcentage fin :

- Maintient l'influence de la pose

- Garde le mouvement naturel tout au long du processus

- Force :

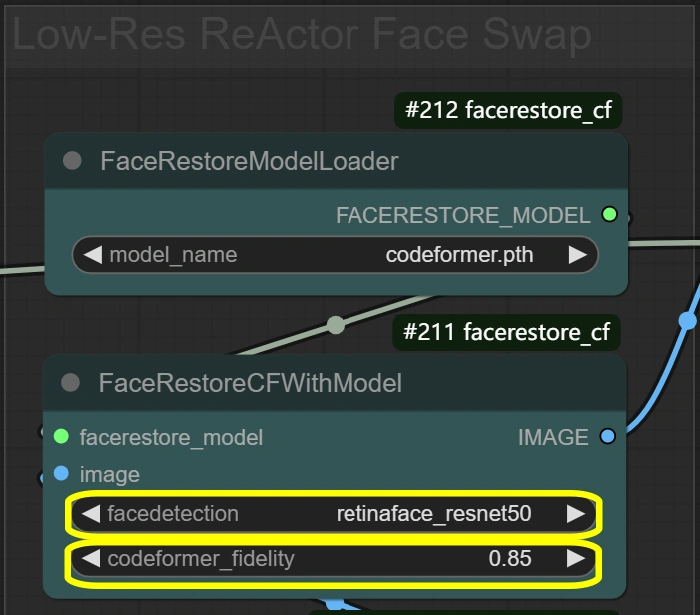

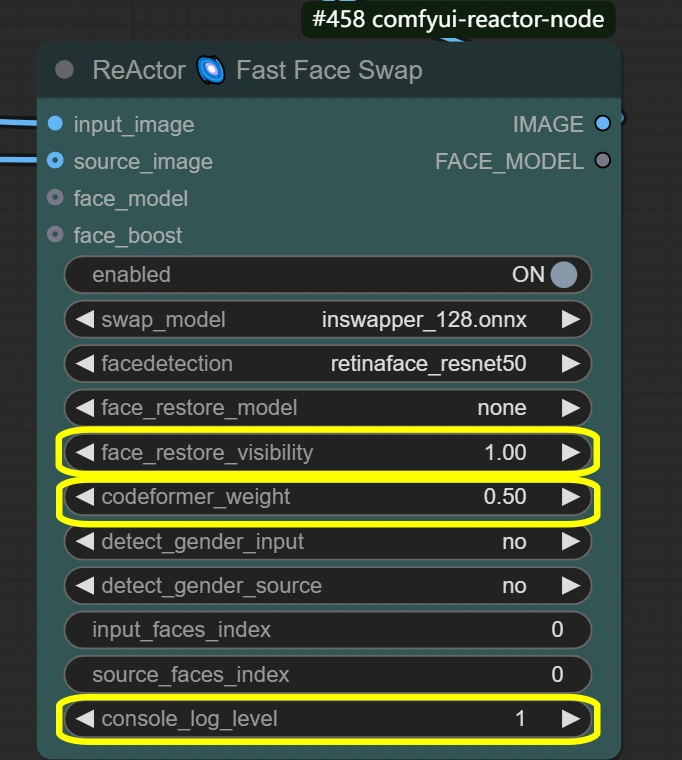

Traitement du Visage

Les nœuds ici gèrent le remplacement et l'amélioration du visage pour des résultats naturels. Le processus fonctionne en deux étapes : FaceRestore améliore d'abord la qualité du visage original, puis ReActor effectue l'échange en utilisant le visage amélioré comme référence. Ce processus en deux étapes assure une intégration naturelle tout en préservant les expressions.

- Système FaceRestore : Améliore les détails du visage et prépare pour l'échange.

- Fidélité :

- Contrôle la préservation des détails dans la restauration

- Plus élevé = plus de détails mais potentiels artefacts

- Plus bas = plus lisse mais peut perdre des détails

- Détection :

- Choix du modèle de détection de visage

- Fiable pour la plupart des scénarios

- Ne changez pas à moins que les visages ne soient pas détectés

- Fidélité :

- ReActor Échange de Visage : Effectue le remplacement du visage et le mélange avec les expressions préservées.

- Visibilité :

- Contrôle la visibilité de l'échange

- Plus élevé = effet d'échange de visage plus fort

- Plus bas = mélange plus subtil

- Poids :

- Équilibre de la préservation des caractéristiques du visage

- Plus élevé = caractéristiques du visage source plus fortes

- Plus bas = meilleur mélange avec la cible

- Niveau de journal de la console :

- Contrôle les informations de débogage

- Plus élevé = journaux plus détaillés

- Visibilité :

Détails Supplémentaires des Nœuds

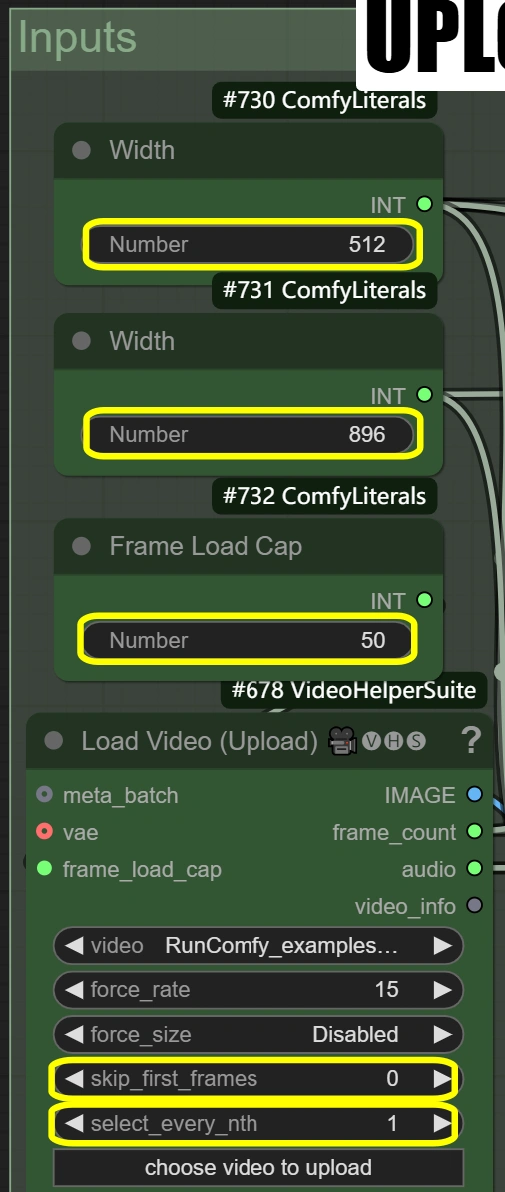

Entrée & Prétraitement

Objectif : Charge la vidéo, ajuste les dimensions, et prépare le modèle VAE pour le traitement.

- Charger Vidéo :

- Limite de Chargement des Images :

- Contrôle le nombre d'images à traiter

- 50 = test rapide (traite environ 2 secondes)

- 0 = traite toute la vidéo

- Affecte le temps total de traitement

- Passer les Premières Images :

- Définit le point de départ dans la vidéo

- Plus élevé = commence plus tard dans la vidéo

- Utile pour sauter les intros

- Sélectionner Chaque Nième :

- Contrôle le taux d'échantillonnage des images

- Les nombres plus élevés sautent des images

- 1 = utiliser chaque image

- 2 = utiliser chaque deuxième image, etc.

- Limite de Chargement des Images :

- Échelle de l'Image :

- Largeur : 512

- Contrôle la largeur du cadre de sortie

- Doit maintenir le ratio 9:16 avec la hauteur

- Hauteur : 896

- Contrôle la hauteur du cadre de sortie

- Doit maintenir le ratio 9:16 avec la largeur

- Méthode : nearest-exact

- Meilleur pour maintenir la netteté

- Les alternatives peuvent flouter le contenu

- Recommandé pour les vidéos de danse

- Ne changez pas à moins de besoins spécifiques

- Largeur : 512

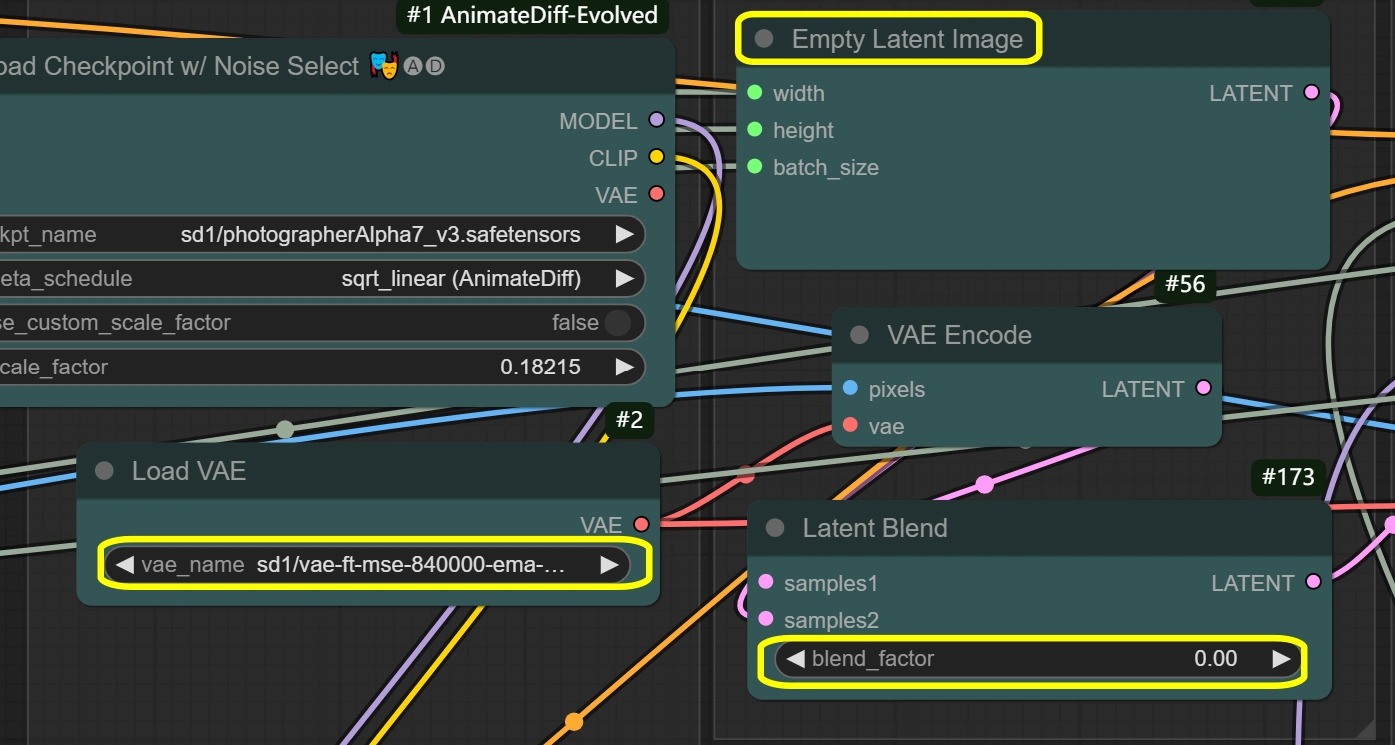

- Chargeur VAE :

- Modèle : vae-ft-mse-840000-ema-pruned

- Optimisé pour la stabilité et la qualité

- Gère l'encodage/décodage de l'image

- Ratio de compression équilibré

- Ne changez pas à moins de besoins spécifiques

- Mode VAE : Ne changez pas

- Optimisé pour le workflow actuel

- Affecte la qualité de l'encodage

- Modèle : vae-ft-mse-840000-ema-pruned

Traitement Latent

Objectif : Gère toutes les opérations et transformations de l'espace latent.

- Image Latente Vide :

- Largeur/Hauteur : correspond à l'entrée

- Doit correspondre aux dimensions de l'Échelle de l'Image

- Affecte directement l'utilisation de la mémoire

- Les tailles plus grandes nécessitent plus de VRAM

- Ne peut pas être plus petit que l'entrée

- Taille du Lot : des images vidéo

- Défini automatiquement à partir du nombre d'images

- Affecte la vitesse de traitement et la VRAM

- Plus élevé = plus de mémoire nécessaire

- Largeur/Hauteur : correspond à l'entrée

- Encodage VAE :

- Modèle VAE : du Chargeur VAE

- Utilise les paramètres du Chargeur VAE

- Maintient la cohérence

- Décodage : activé

- Contrôle la qualité du décodage

- Désactivez uniquement si VRAM limitée

- Affecte la qualité de sortie

- Modèle VAE : du Chargeur VAE

- Mélange Latent :

- Facteur de Mélange :

- Contrôle le mélange des espaces latents

- 0 = contenu source complet

- Plus élevé = plus d'influence latente vide

- Affecte la force du transfert de style

- Facteur de Mélange :

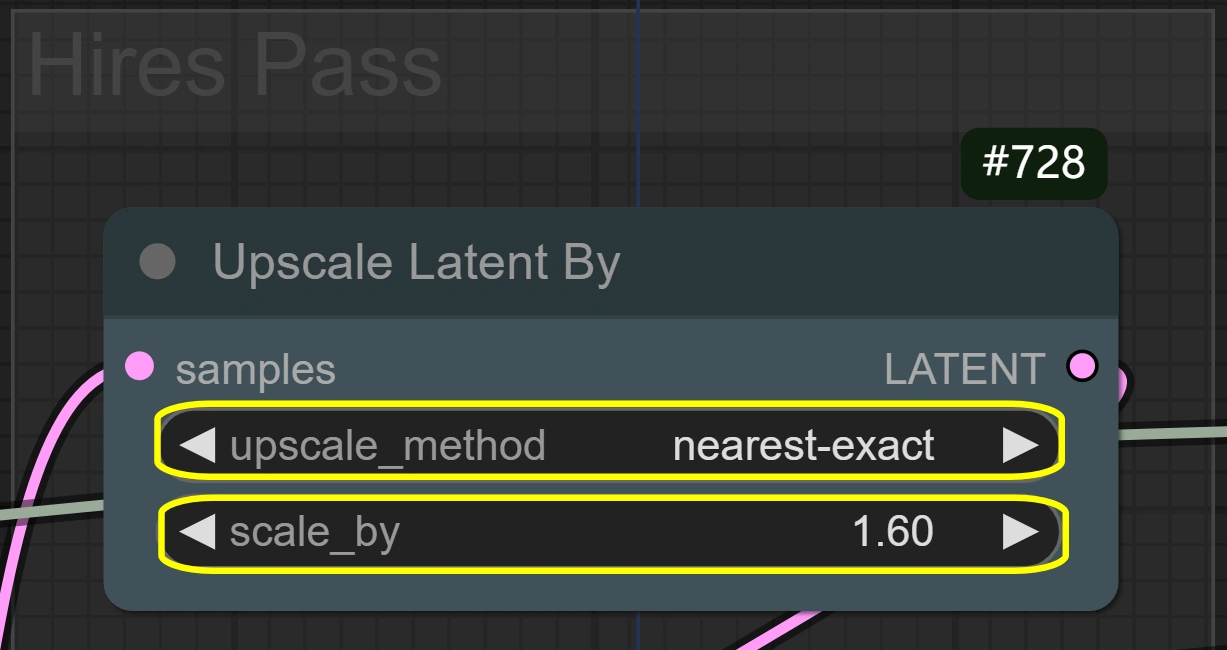

- Échelle Latente Par :

- Méthode : nearest-exact

- Meilleur pour maintenir la netteté

- Les méthodes alternatives peuvent flouter

- Préserve les détails du mouvement

- Échelle :

- Contrôle l'augmentation de la taille

- Plus élevé = meilleurs détails mais plus de VRAM

- Plus bas = traitement plus rapide

- 1.6 optimal pour la plupart des cas

- Méthode : nearest-exact

Échantillonnage & Affinement

Objectif : Processus d'échantillonnage en deux étapes pour une transformation de qualité.

- KSampler (Première Passe) :

- Étapes :

- Nombre d'étapes de débruitage

- Plus élevé = meilleure qualité mais plus lent

- 6 optimal pour l'échantillonneur lcm

- CFG :

- Contrôle l'influence de l'invite

- Plus élevé = adhérence de style plus forte

- Plus bas = plus de liberté

- Échantillonneur : lcm

- Optimisé pour la vitesse

- Bon équilibre qualité/vitesse

- Planificateur : sgm_uniform

- Fonctionne mieux avec lcm

- Maintient la cohérence temporelle

- Dénoise :

- Pleine force pour la première passe

- Contrôle l'intensité de la transformation

- Étapes :

- KSampler (Passe Haute Résolution) :

- Étapes :

- Correspond à la première passe pour la cohérence

- Plus élevé non nécessaire pour l'affinement

- CFG :

- Maintient la cohérence du style

- Préservation équilibrée des détails

- **Échantillonneur :**json

- Échantillonneur : lcm

- Même que la première passe

- Maintient la cohérence

- Planificateur : sgm_uniform

- Maintient la cohérence avec la première passe

- Bon pour l'affinement des détails

- Dénoise :

- Plus bas que la première passe

- Préserve plus de détails originaux

- Bon équilibre pour l'affinement

- Étapes :

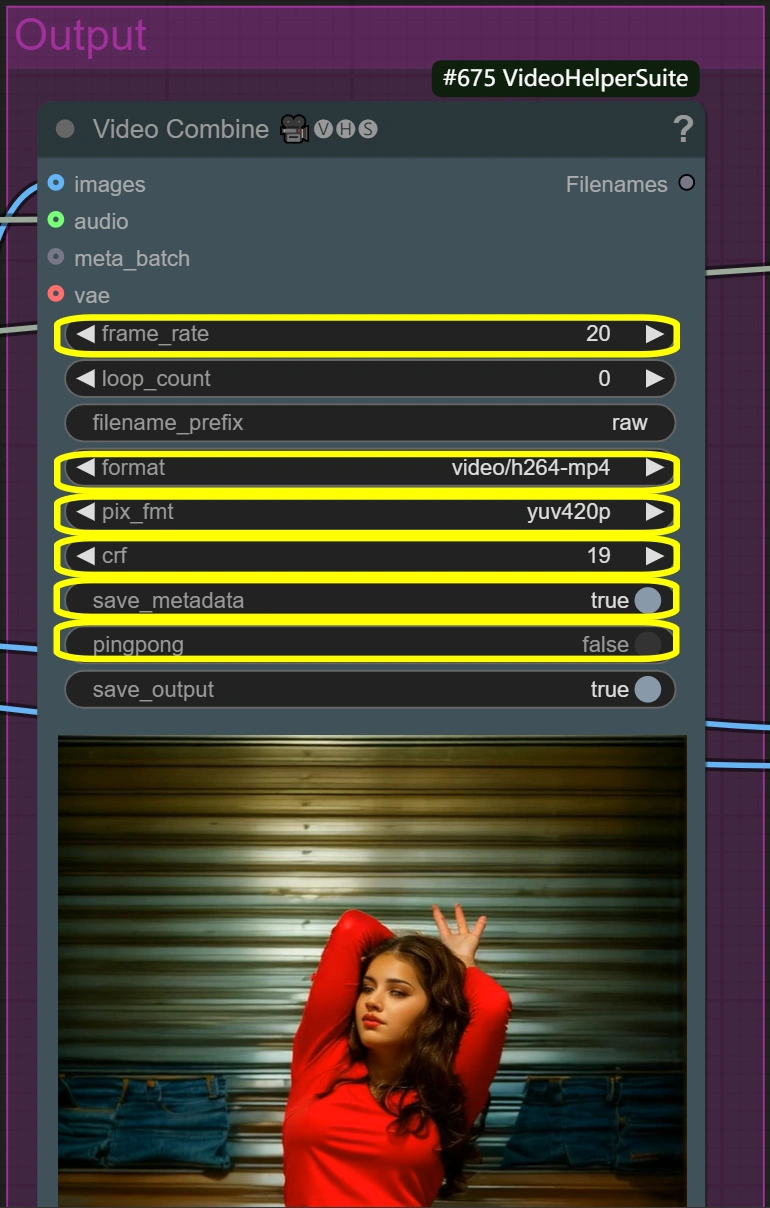

Traitement de Sortie

Objectif : Crée les sorties vidéo finales avec et sans échange de visage.

- Combinaison Vidéo (Brut) :

- Taux de Cadre :

- Taux d'image vidéo standard

- Contrôle la vitesse de lecture

- Plus bas = fichier plus petit

- Plus élevé = mouvement plus fluide

- Format : video/h264-mp4

- Format standard pour la compatibilité

- Bon équilibre de qualité/taille

- Largement pris en charge

- CRF :

- Contrôle la qualité de compression

- Plus bas = meilleure qualité mais fichier plus grand

- Plus élevé = fichier plus petit mais qualité inférieure

- 19 est un réglage de haute qualité

- Format de Pixel : yuv420p

- Format standard pour la compatibilité

- Ne changez pas sauf si nécessaire

- Assure un large support de lecture

- Taux de Cadre :

- Combinaison Vidéo (Échange de Visage) :

- Même paramètres que la sortie brute

- Utilise des paramètres identiques pour la cohérence

- Ajoute l'intégration de l'échange de visage

- Maintient les réglages de qualité vidéo

Conseils d'Optimisation

Compromis Qualité vs Vitesse

- Équilibre de Résolution :

- Standard : 512x896

- Traitement plus rapide

- Bon pour la plupart des utilisations

- Haute Qualité : 768x1344

- Meilleur détail

- Temps de traitement 2-3 fois plus long

- Standard : 512x896

- Qualité de l'Échange de Visage :

- Standard : Paramètres par défaut

- Intégration naturelle

- Temps de traitement équilibré

- Qualité Maximale :

- Augmentez la fidélité de codeformer à 0.9

- Plus lent mais visages plus détaillés

- Standard : Paramètres par défaut

- Fluidité du Mouvement :

- Traitement Plus Rapide :

- Réduisez le chevauchement_contexte à 2

- Transitions légèrement moins fluides

- Meilleur Mouvement :

- Augmentez le chevauchement à 6

- Utilise plus de VRAM, traitement plus lent

- Traitement Plus Rapide :

Problèmes Courants & Solutions

- Fusion de Visage :

- Problème : Transition de visage non naturelle

- Solution : Ajustez le poids de codeformer

- Essayez une plage de 0.4-0.7

- Plus bas = meilleur mélange

- Plus élevé = plus de détails faciaux

- Force du Style :

- Problème : Transfert de style faible

- Solution : Augmentez cfg

- Essayez une plage de 7-8

- Plus élevé = style plus fort

- Peut affecter la qualité du mouvement

- Gestion de la Mémoire :

- Problème : Limitations de VRAM

- Solutions :

- Activez la découpe VAE

- Réduisez la résolution

- Traitez des segments plus courts

Plus d'Informations

Pour des détails supplémentaires et des créations étonnantes, veuillez visiter l.