LayerDiffuse | 텍스트를 투명 이미지로

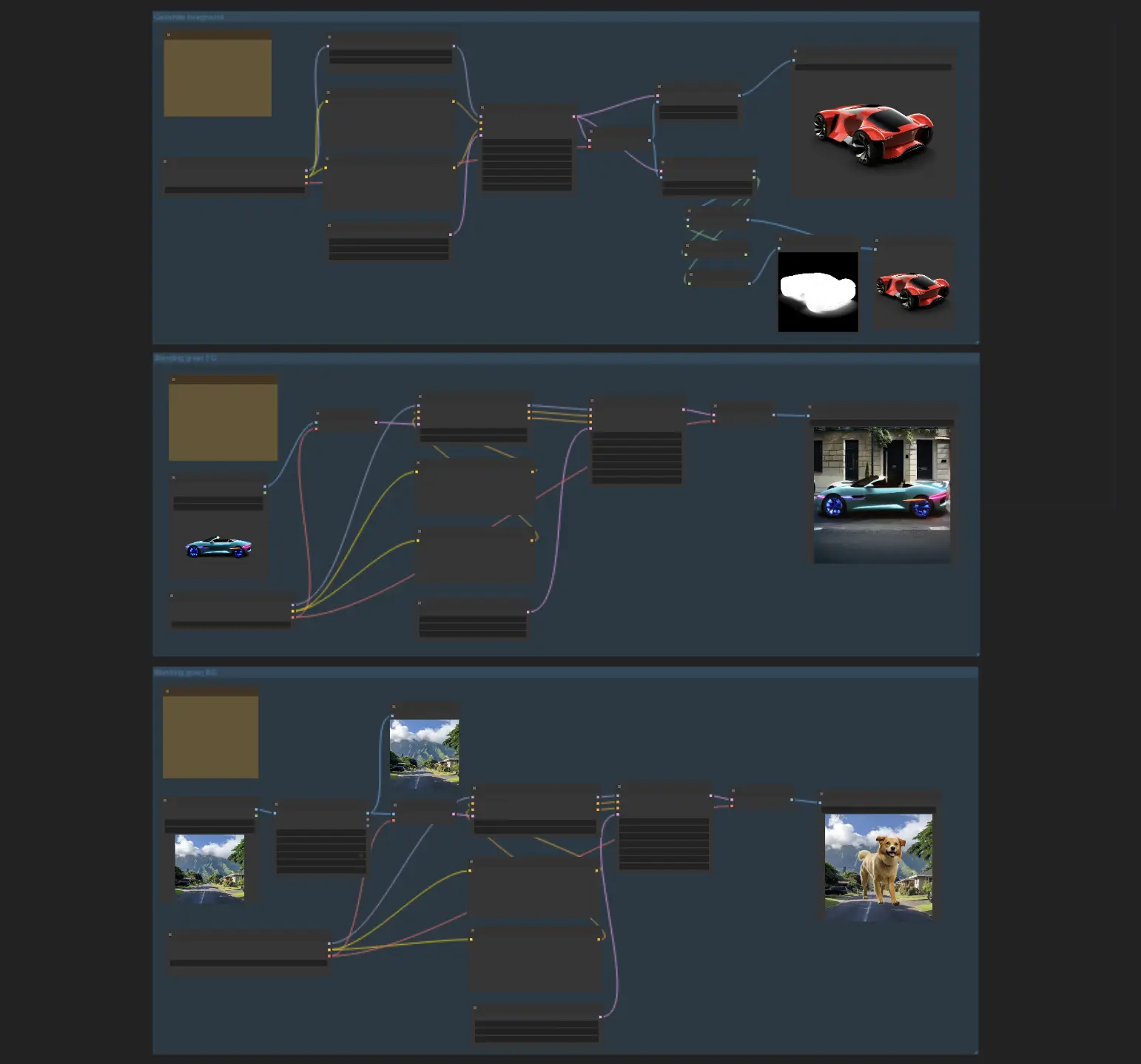

LayerDiffuse 모델은 투명한 이미지를 직접 생성할 수 있는 새로운 이미지 조작 방식을 도입합니다. 이 ComfyUI LayerDiffuse 워크플로우에는 세 가지 전문 하위 워크플로우가 통합되어 있습니다: 투명한 이미지 생성, 전경에서 배경 생성, 기존 배경을 기반으로 전경을 생성하는 역 프로세스.ComfyUI LayerDiffuse 워크플로우

ComfyUI LayerDiffuse 예제

ComfyUI LayerDiffuse 설명

1. ComfyUI LayerDiffuse 워크플로우 개요

ComfyUI LayerDiffuse 워크플로우는 세 가지 전문 하위 워크플로우를 통합합니다: 투명한 이미지 생성, 전경에서 배경 생성, 기존 배경을 기반으로 전경을 생성하는 역 프로세스. 이러한 각 LayerDiffuse 하위 워크플로우는 독립적으로 작동하여 창의적 요구 사항을 충족하는 특정 LayerDiffuse 기능을 선택하고 활성화할 수 있는 유연성을 제공합니다.

1.1. LayerDiffuse로 투명한 이미지 생성:

이 워크플로우를 통해 투명한 이미지를 직접 생성할 수 있으며, 알파 채널 마스크를 지정하거나 지정하지 않고 이미지를 생성할 수 있는 유연성을 제공합니다.

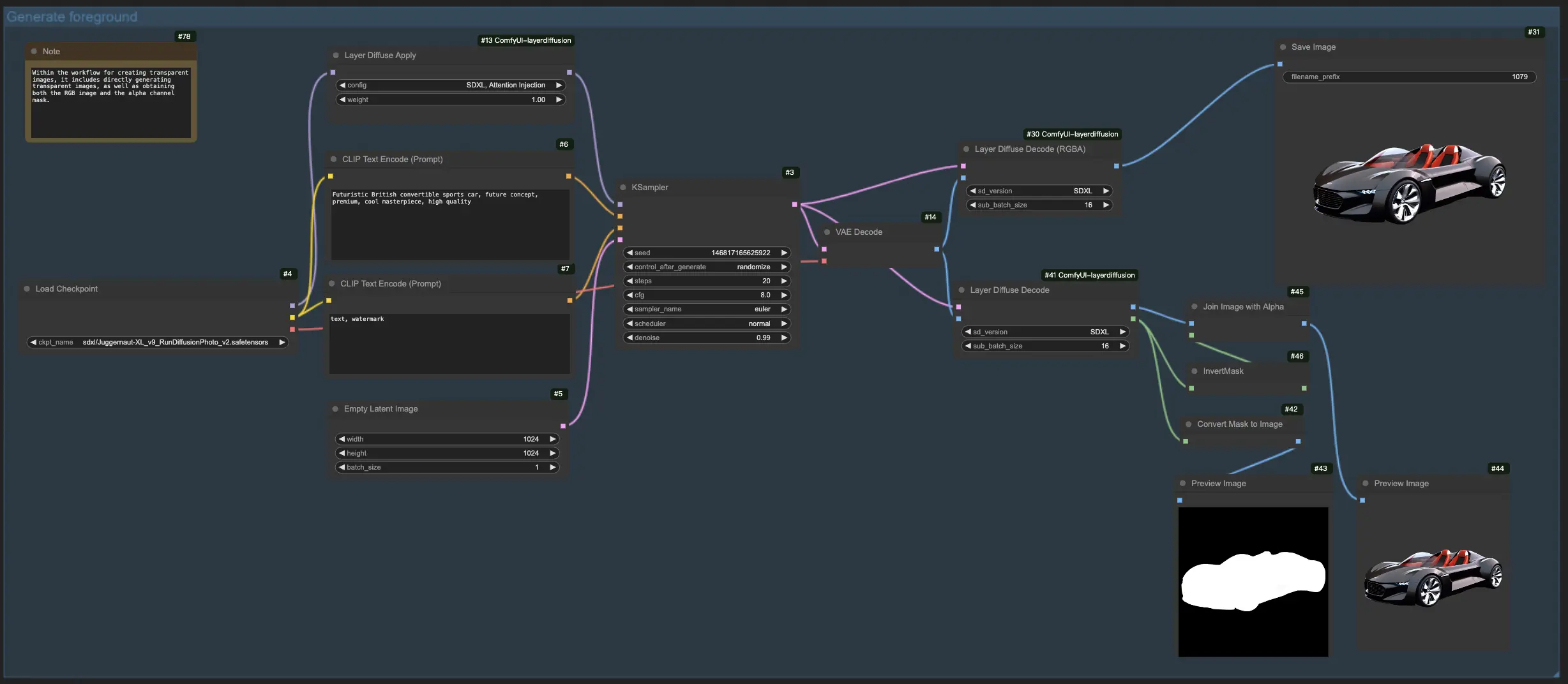

1.2. LayerDiffuse를 사용하여 전경에서 배경 생성:

이 LayerDiffuse 워크플로우의 경우 먼저 전경 이미지를 업로드하고 설명이 포함된 프롬프트를 작성하세요. 그런 다음 LayerDiffuse는 이러한 요소를 혼합하여 원하는 이미지를 생성합니다. LayerDiffuse에 대한 프롬프트를 작성할 때는 배경 요소(예: "거리")만 설명하는 대신 전체 장면(예: "거리 옆에 주차된 자동차")을 자세히 설명하는 것이 중요합니다.

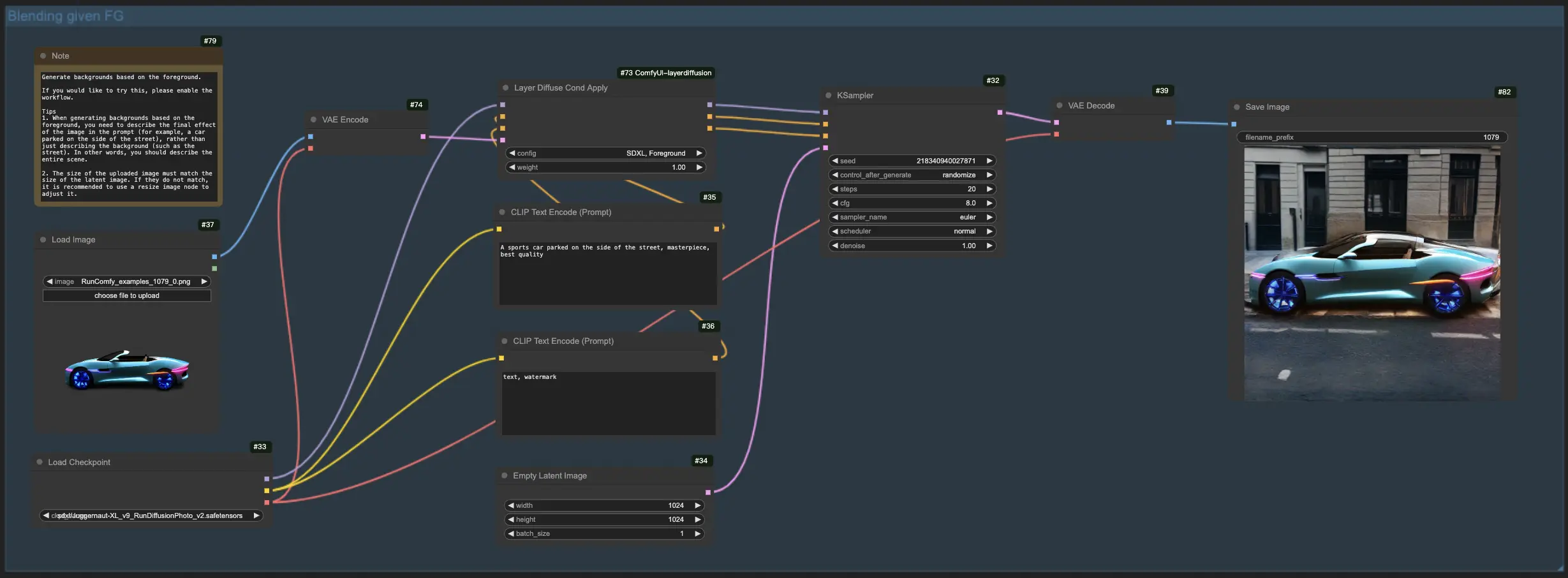

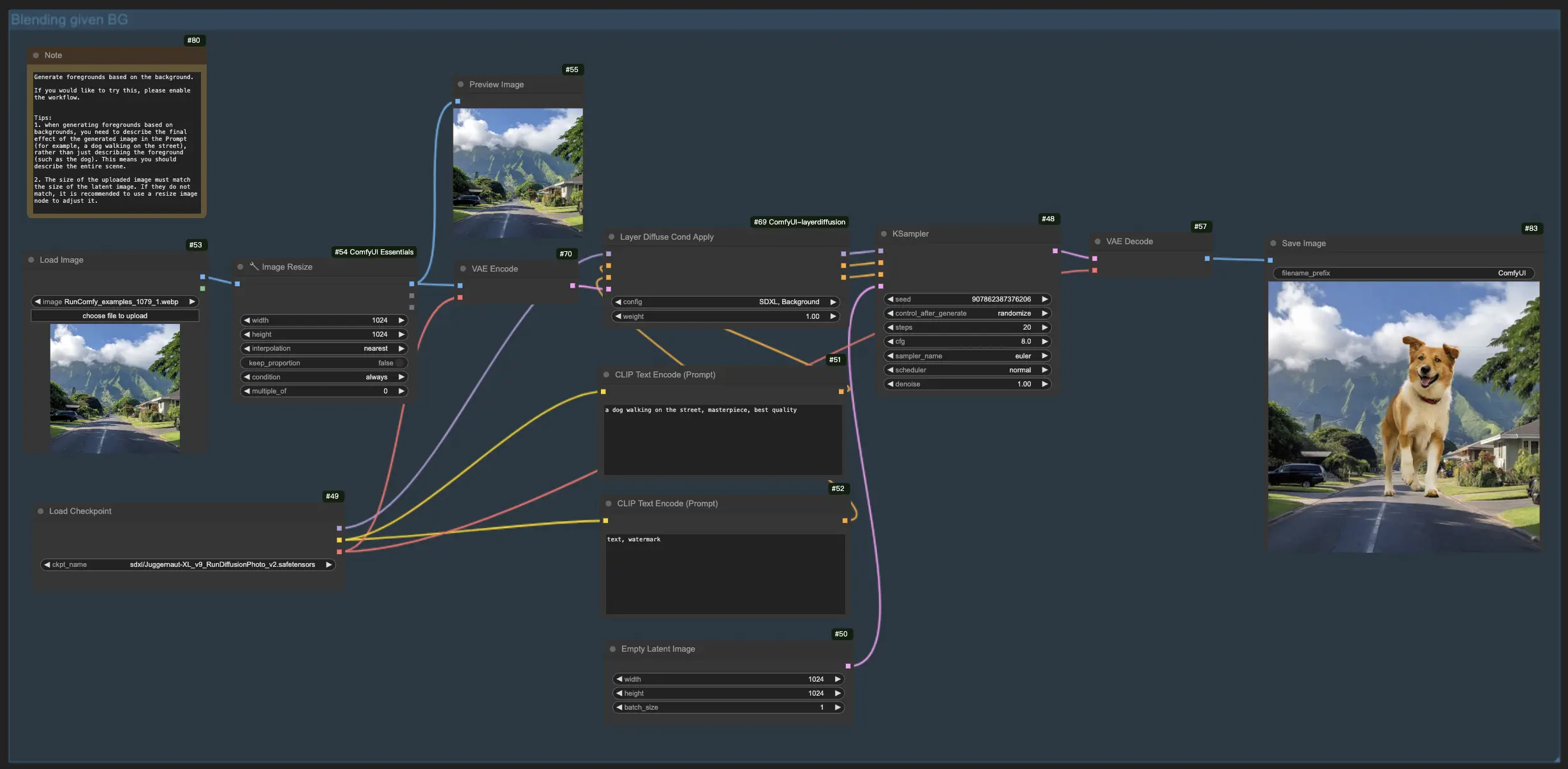

1.3. 배경을 기반으로 전경 생성:

이전 워크플로우와 유사하게 이 LayerDiffuse 기능은 초점을 반전시켜 전경 요소를 기존 배경과 병합하는 것을 목표로 합니다. 따라서 배경 이미지를 업로드하고 프롬프트에서 개별 요소(예: "개")보다는 전체 장면(예: "거리를 걷는 개")을 강조하여 최종 이미지를 설명해야 합니다.

더 많은 LayerDiffuse 워크플로우는 에서 확인하세요.

2. LayerDiffuse 워크플로우 효과

투명한 이미지를 만드는 프로세스는 강력하고 신뢰할 수 있는 고품질 결과를 제공하지만, 배경과 전경을 혼합하는 워크플로우는 더 실험적입니다. 이 기술의 혁신적이지만 개발 중인 특성을 나타내는 것처럼 항상 완벽한 혼합을 달성하지는 못할 수 있습니다.

3. LayerDiffuse 기술 소개

LayerDiffuse는 대규모 사전 학습된 잠재 확산 모델이 투명성이 있는 이미지를 생성할 수 있도록 설계된 혁신적인 접근 방식입니다. 이 기술은 "잠재 투명성"의 개념을 도입하는데, 이는 기존 모델의 잠재 매니폴드에 알파 채널 투명성을 직접 인코딩하는 것을 포함합니다. 이를 통해 사전 학습된 모델의 원래 잠재 분포를 크게 변경하지 않고도 투명한 이미지 또는 여러 투명한 레이어를 만들 수 있습니다. 목표는 이러한 모델의 고품질 출력을 유지하면서 투명성이 있는 이미지를 생성하는 기능을 추가하는 것입니다.

이를 달성하기 위해 LayerDiffuse는 투명성을 잠재 오프셋으로 포함하도록 잠재 공간을 조정하여 사전 학습된 잠재 확산 모델을 미세 조정합니다. 이 프로세스에는 모델을 최소한으로 변경하여 원래 품질과 성능을 유지하는 작업이 포함됩니다. LayerDiffuse의 학습은 다양한 투명 효과를 보장하기 위해 휴먼-인-더-루프 체계를 통해 수집된 100만 개의 투명 이미지 레이어 쌍 데이터셋을 활용합니다.

이 방법은 다양한 오픈 소스 이미지 생성기에 적응할 수 있고 서로 다른 조건부 제어 시스템에 통합될 수 있는 것으로 나타났습니다. 이러한 다재다능함으로 인해 전경/배경별 투명성이 있는 이미지 생성, 공동 생성 기능이 있는 레이어 생성, 레이어의 구조적 콘텐츠 제어와 같은 다양한 응용 프로그램에 사용할 수 있습니다.