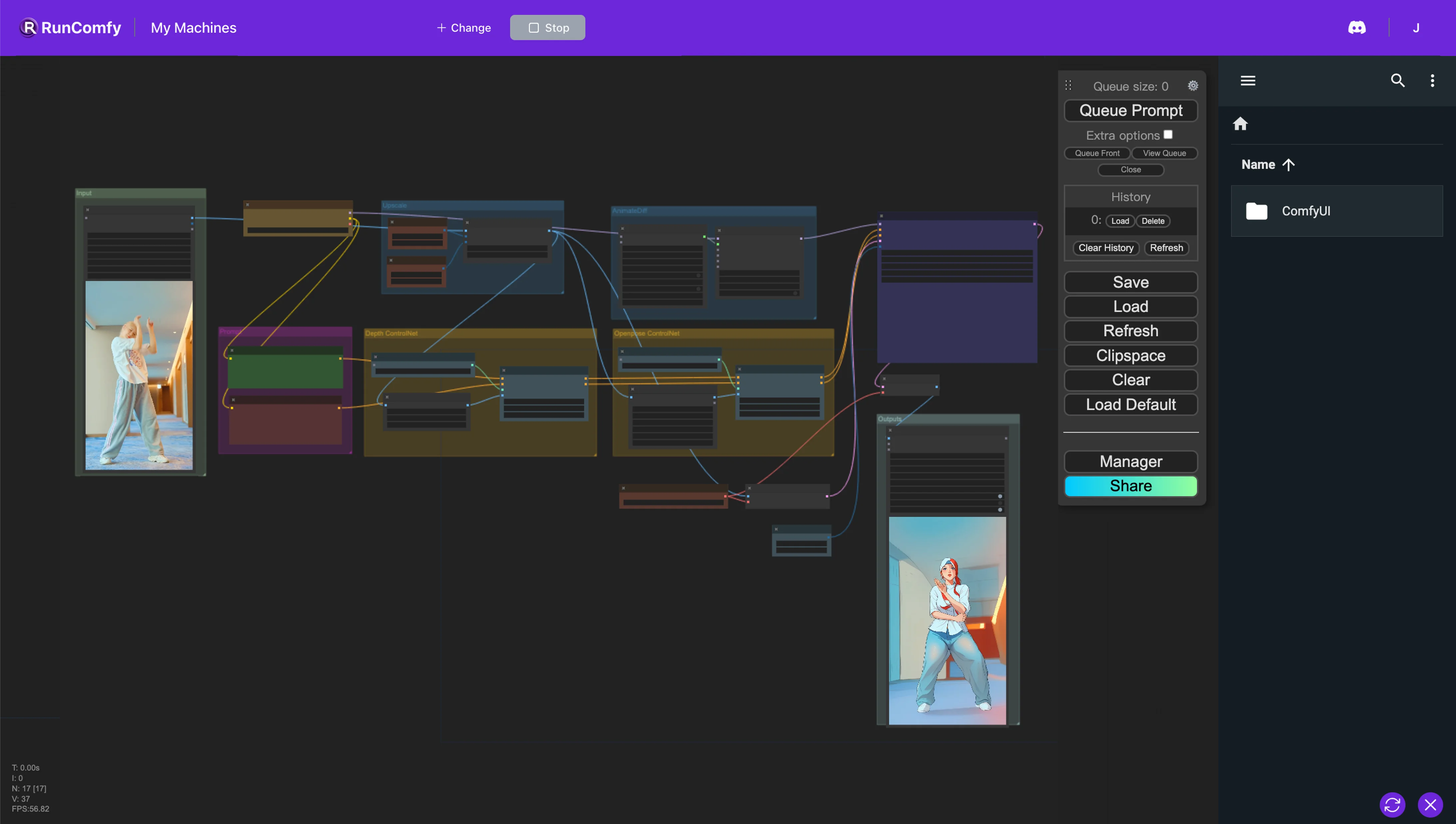

AnimateDiff + ControlNet | 卡通风格

在这个 ComfyUI 工作流程中,我们利用 Animatediff 和 ControlNet(包括 Depth 和 OpenPose)等节点将原始视频转换为动画风格。风格在很大程度上受检查点模型的影响,因此可以自由尝试各种检查点以实现不同的风格。ComfyUI video2video (Cartoon Style) 工作流程

ComfyUI video2video (Cartoon Style) 示例

ComfyUI video2video (Cartoon Style) 描述

1. ComfyUI 工作流程:AnimateDiff + ControlNet | 卡通风格

这个 ComfyUI 工作流程采用了一种视频风格化的方法,在 Stable Diffusion 框架内结合了 AnimateDiff 和 ControlNet 等节点,以增强视频编辑的能力。AnimateDiff 可以将文本提示转换为视频内容,超越了传统的文本到图像模型,产生动态视频。相反,ControlNet 利用参考图像或视频来指导生成内容的运动,确保输出在运动方面与参考紧密对齐。通过将 AnimateDiff 的文本到视频生成与 ControlNet 的详细运动控制相结合,这个 ComfyUI 工作流程提供了一个强大的套件,用于生成高质量的、经过重新风格化的视频内容。

2. AnimateDiff 概述

请查看有关 的详细信息

3. ControlNet 概述

请查看有关 的详细信息