音频反应舞者进化

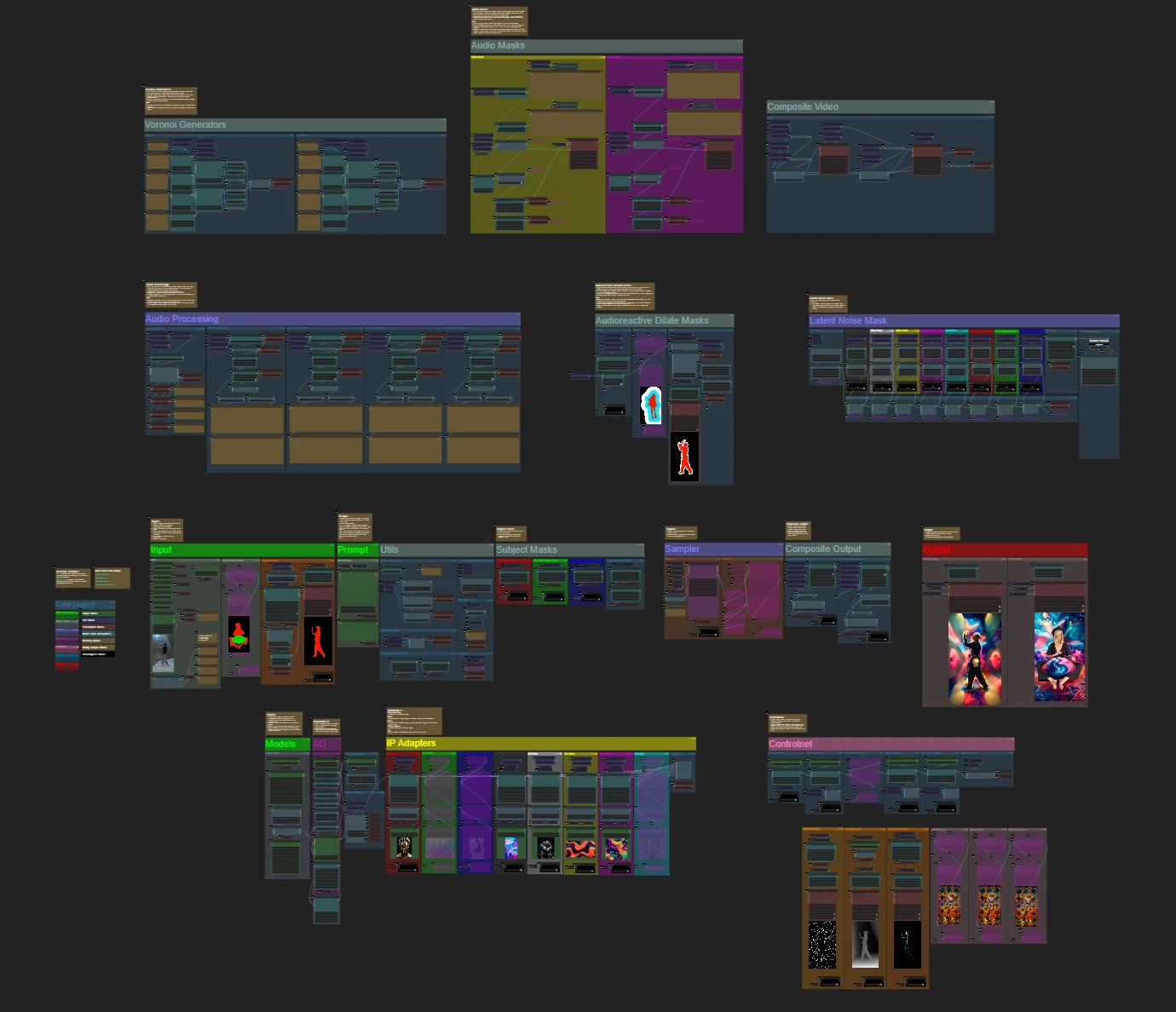

音频反应舞者进化工作流程将视频主题转化为与音乐节拍同步的迷人动画,背景是动态的几何和迷幻图案。设计灵活,允许用户控制视频帧、遮罩、音频响应和图案细节。凭借扩张遮罩、ControlNet和节拍同步噪声动画等功能,这个ComfyUI工作流程使创意者能够将艺术、声音和运动结合,创造出视觉沉浸、节奏感十足的音频反应体验。ComfyUI Audioreactive Dancers Evolved 工作流程

ComfyUI Audioreactive Dancers Evolved 示例

ComfyUI Audioreactive Dancers Evolved 描述

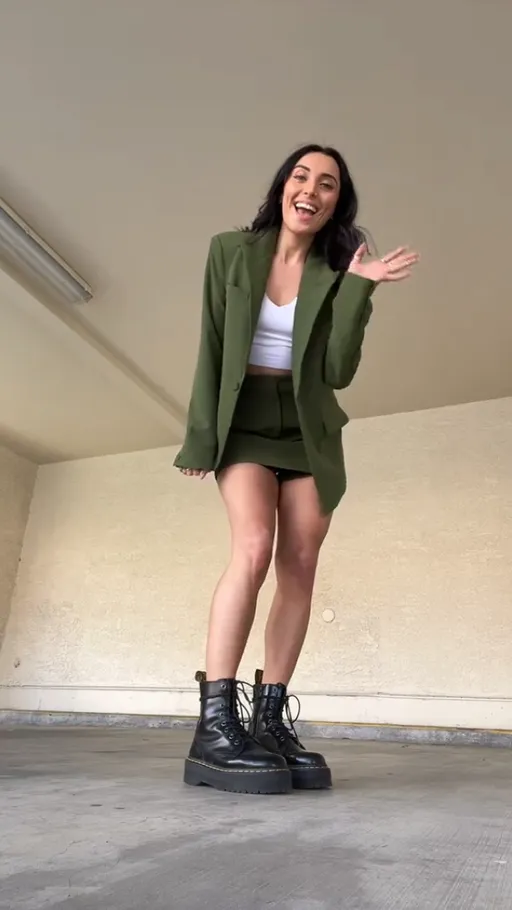

通过转换你的主题(舞者)来创建令人惊叹的视频动画,并为他们提供由各种复杂几何图形和迷幻图案构成的动态音频反应背景。你可以使用此工作流程处理单个或多个主题。使用此工作流程,你可以制作出与音乐节拍完美同步的迷人音频反应视觉效果,提供沉浸式体验。该工作流程允许你使用单个主题或多个主题,并增强音频反应元素。

如何使用音频反应舞者进化工作流程:

- 在输入部分上传主题视频

- 选择最终视频的期望宽度和高度,并选择输入视频的每隔多少帧进行跳过,使用“every_nth”。你还可以限制使用“frame_load_cap”渲染的总帧数。

- 填写正面和负面提示。设置批量帧时间以匹配你希望场景转换发生的时间。

- 为每种默认IP适配器主题遮罩颜色上传图像:

- 红色、绿色、蓝色 = 主题

- 黑色 = 背景

- 白色 = 白色音频反应扩张遮罩

- 黄色、洋红色 = 背景噪声遮罩图案

- 在“模型”部分加载一个好的LCM检查点(我使用Machine Delusions的ParadigmLCM)。

- 使用模型加载器下方的Lora堆栈添加任何lora

- 点击队列提示

视频指南

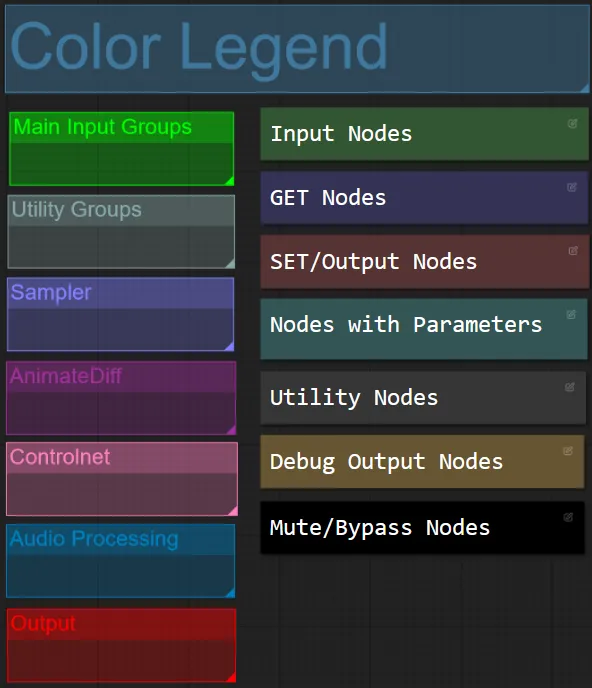

节点和组颜色

- 在此工作流程中,我根据每个组中的功能对节点进行了颜色协调。

- 组部分标题的颜色协调以便于区分。

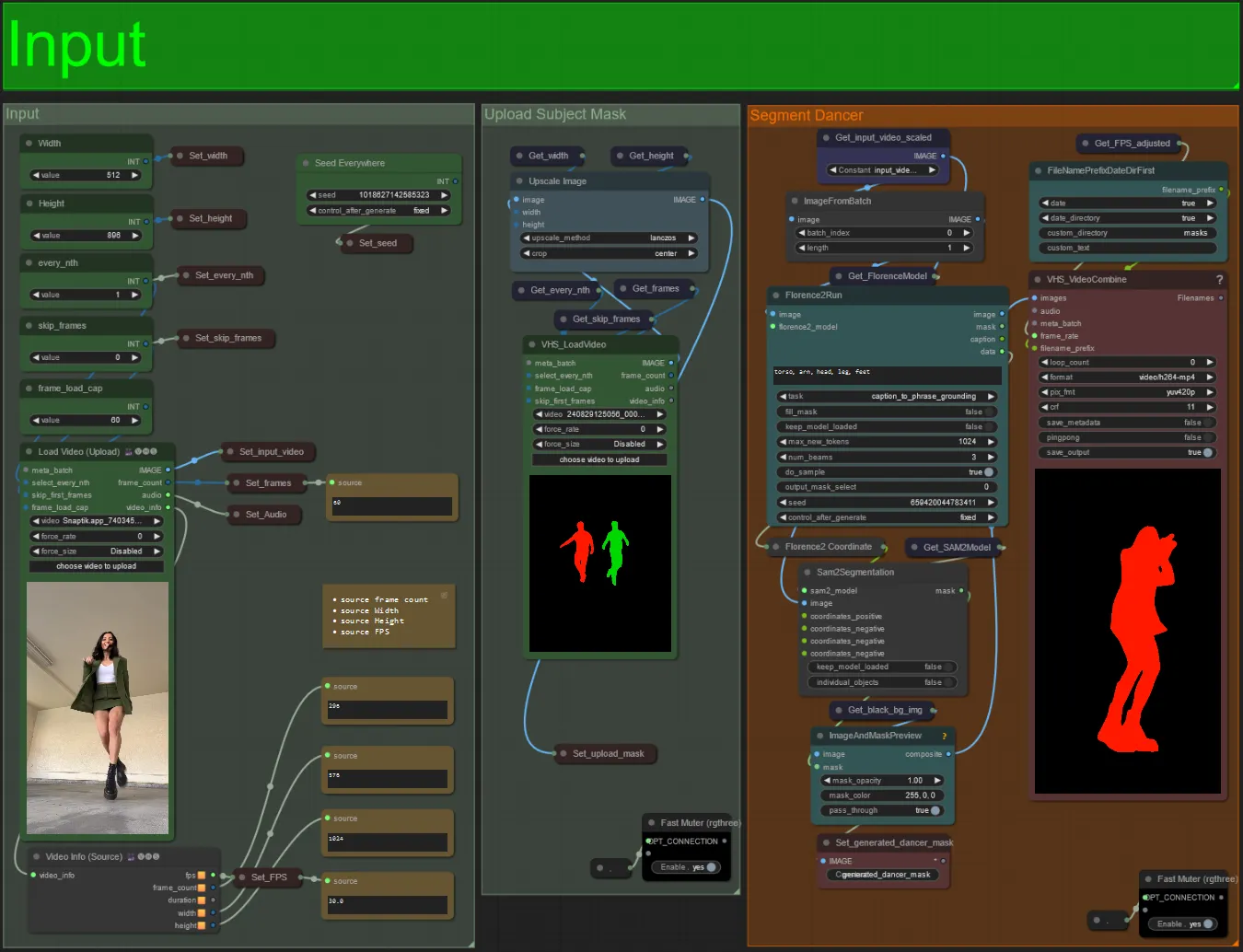

输入

- 将所需的主题视频上传到加载视频(上传)节点。

- 你可以使用左上方的两个输入调整输出宽度和高度。

- every_nth设置是否使用每隔一帧、每隔三帧等等(2 = 每隔一帧)。默认设置为1。

- skip_frames用于跳过视频开头的帧。(100 = 跳过输入视频的前100帧)。默认设置为0。

- frame_load_cap用于指定应加载的输入视频的总帧数。测试设置时最好保持低(例如30 - 60),然后在渲染最终视频时增加或设置为0(无帧上限)。

- 右下角的数字字段显示上传的输入视频的信息:从上到下依次为总帧数、宽度、高度和FPS。

- 如果你已经生成了主题的遮罩视频,可以取消静音“上传主题遮罩”部分并上传遮罩视频。你还可以选择静音“分割舞者”部分以节省一些处理时间。

- 有时分割的主题可能不完美,你可以使用右下方的预览框检查遮罩质量。如果是这种情况,你可以在“Florence2Run”节点中调整提示,针对不同的身体部位,如“头部”、“胸部”、“腿部”等,看看是否能得到更好的结果。

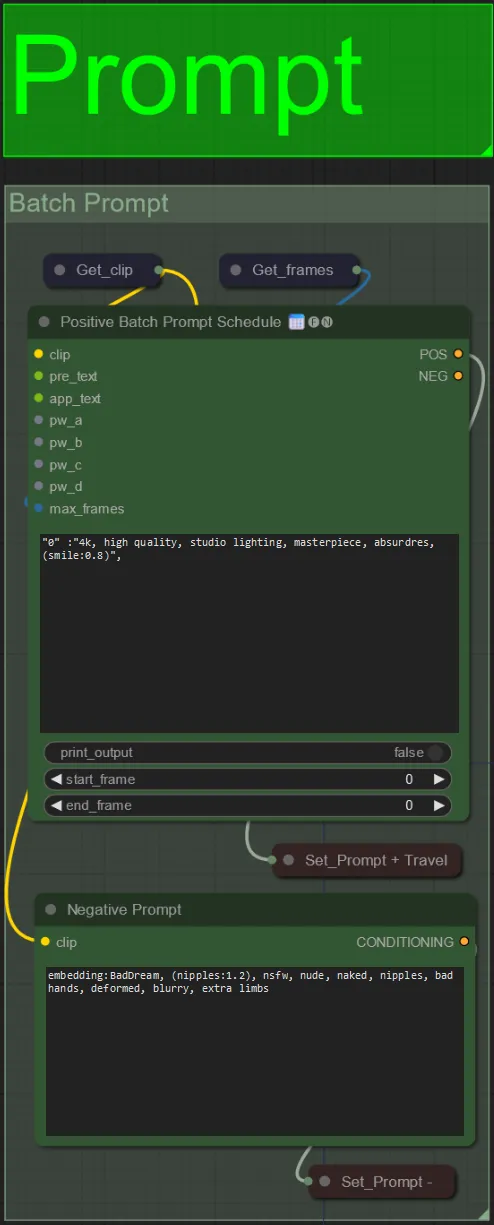

提示

- 使用批量格式设置正面提示:

- 例如 “0”: “4k,杰作,1个女孩站在海滩上,荒谬的分辨率”,“25”: “HDR,日落场景,1个黑发白夹克的女孩,荒谬的分辨率”,…

- 负面提示是正常格式,如果需要,可以添加嵌入。

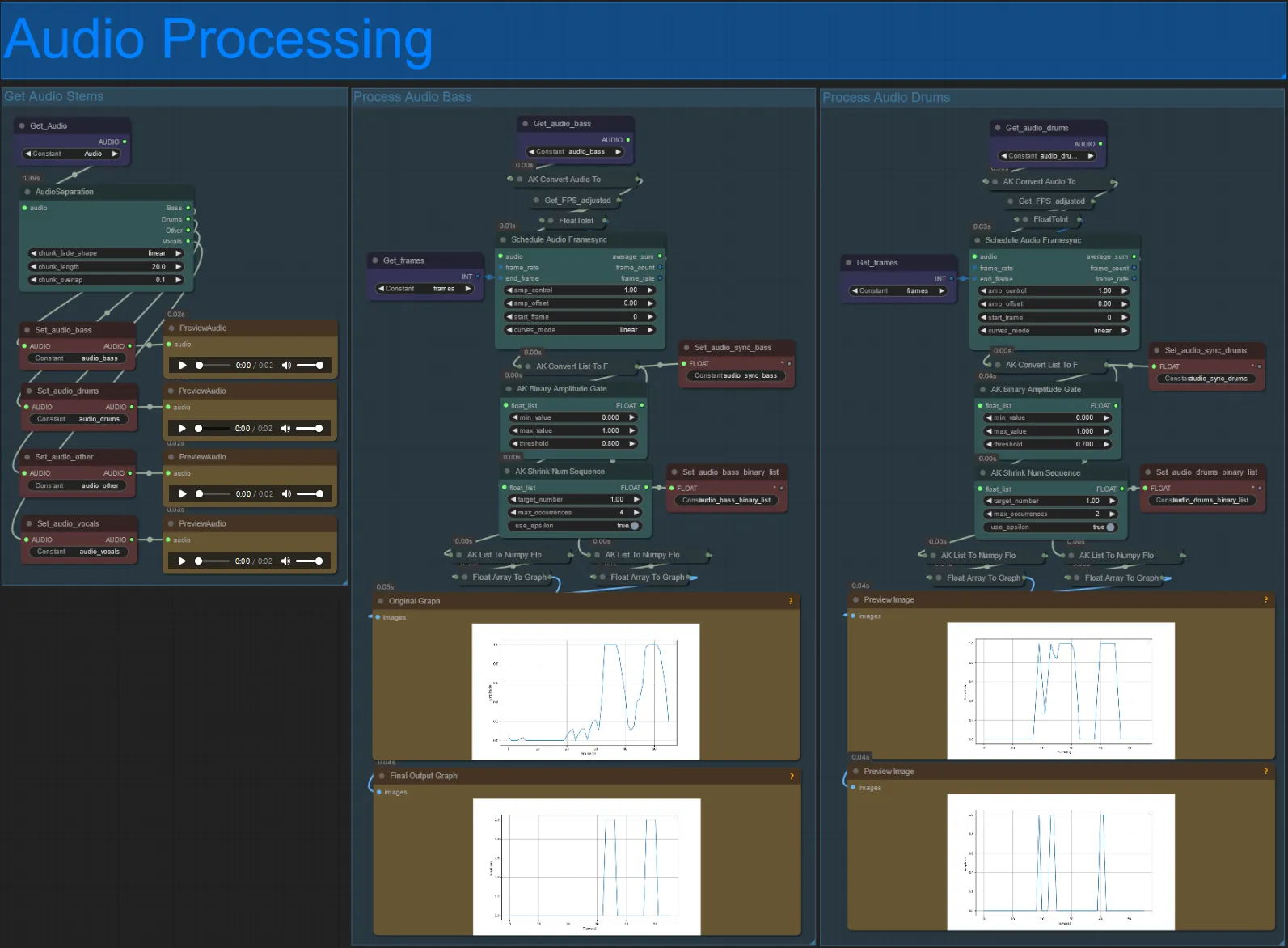

音频处理

- 此部分从输入视频中获取音频,提取音干(贝斯、鼓、人声等),然后将其转换为与输入视频帧同步的标准化振幅,以创建音频反应视觉效果。

- amp_control = 振幅可以达到的总范围。

- amp_offset = 振幅可以达到的最小值。

- 例如:amp_control = 0.8 和 amp_offset = 0.2 表示信号将在0.2和1.0之间变化。

- 有时鼓音干中会包含歌曲的实际贝斯音符,预览每个音干以确定哪个用于音频反应遮罩。

- 使用图表可以很好地理解该音干的信号在视频长度内的变化。

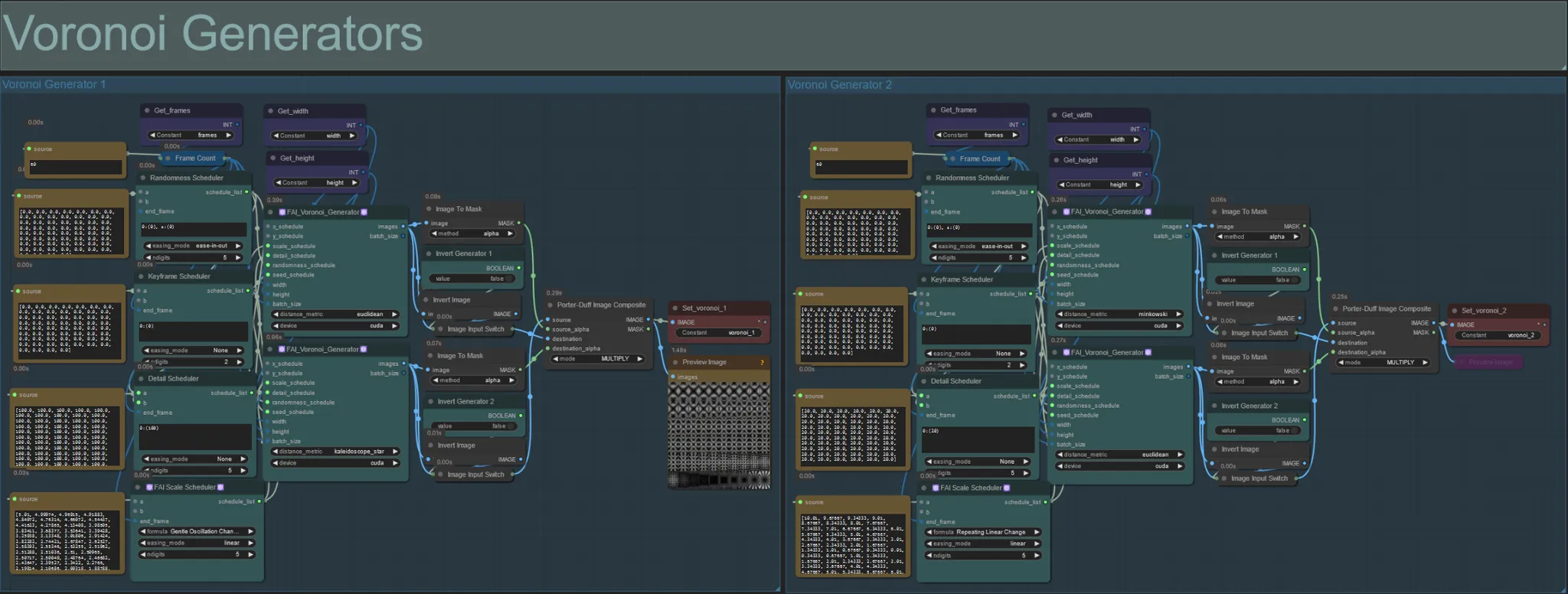

Voronoi 生成器

- 此部分使用每组两个FAI_Voronoi_Generator自定义节点生成Voronoi噪声图案,并使用乘法合成在一起。

- 你可以在括号中增加随机调度器的值,从0开始,以打破最终输出中的对称图案。

- 在括号中增加细节调度器的值,以增加输出噪声图案中的细节数量。较低的值会导致较低的噪声差异。

- 更改FAI Scale Scheduler节点中的“公式”参数对最终噪声图案的运动有很大影响。

- 你还可以更改FAI_Voronoi_Generator节点本身的“距离度量”函数,以极大地影响生成的图案和形状。

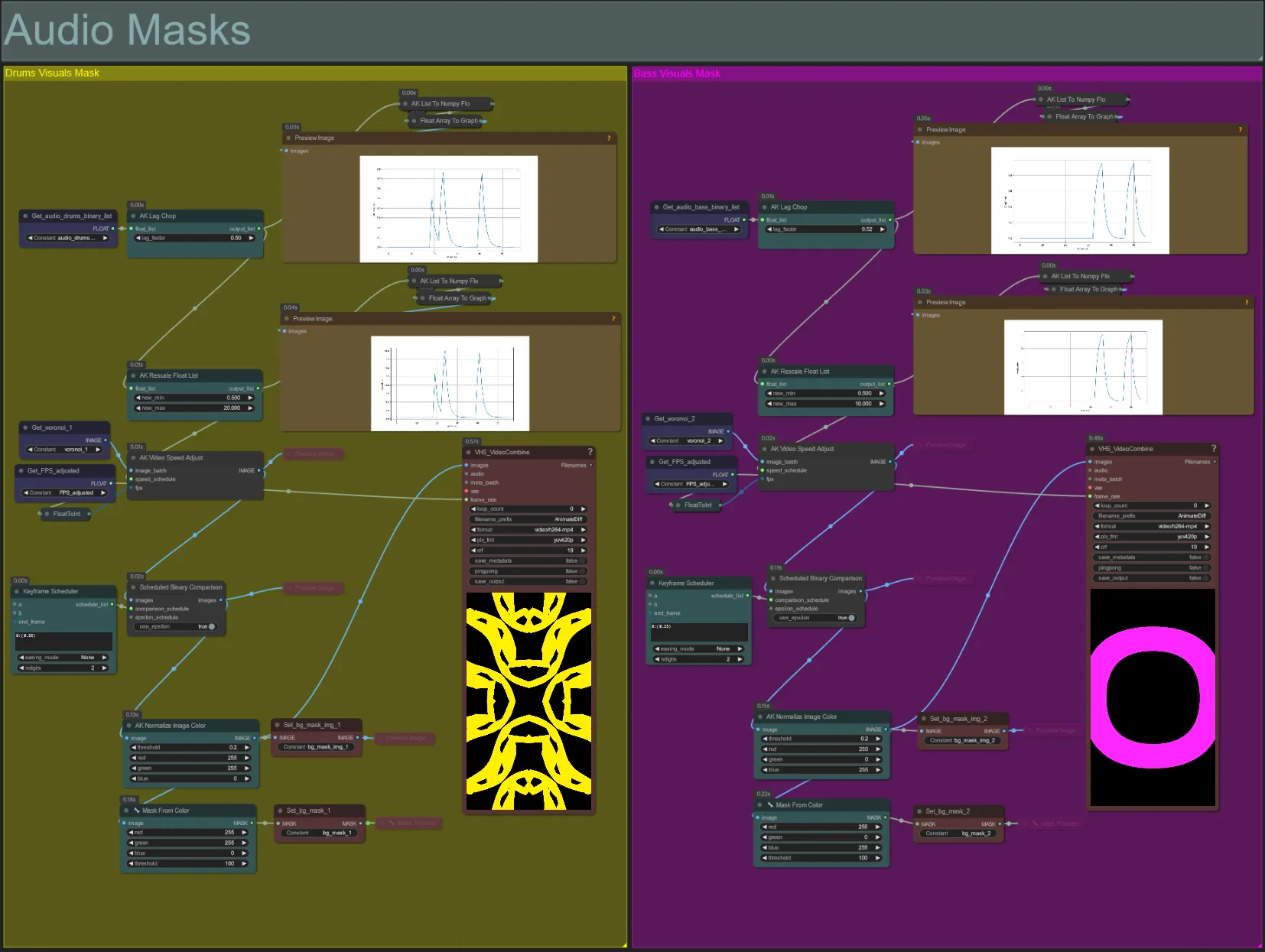

音频遮罩

- 此部分用于将Voronoi噪声图像批处理转换为彩色遮罩,以与主题合成,并同步它们的运动与贝斯或鼓音干的节拍。这些遮罩对于创建音频反应效果至关重要。

- 在AK Lag Chop节点中增加“lag_factor”以增加最终振幅图的“尖锐”程度。这将导致输出噪声运动加速和减速更突然,而较低的lag_factor将导致每次节拍后运动的减速更加渐进。这用于避免噪声遮罩动画显得过于“跳跃”和僵硬。

- AK Rescale Float List用于将标准化振幅值从0-1重新映射到new_min和new_max。1.0的值表示噪声动画的30FPS播放速度,而0.5表示15FPS,2.0表示60FPS等。调整此值以更改音频反应噪声图案在节拍(振幅0.0)时的动画速度,以及在节拍(振幅1.0)时的移动速度。

- 关键帧调度器对遮罩的外观有很大影响。它创建一个浮动值列表,以指定用于噪声输入图像的像素亮度值阈值,这将导致部分噪声被裁剪并转化为最终遮罩。降低此值以保留更多输入噪声,增加此值以保留更少的噪声。

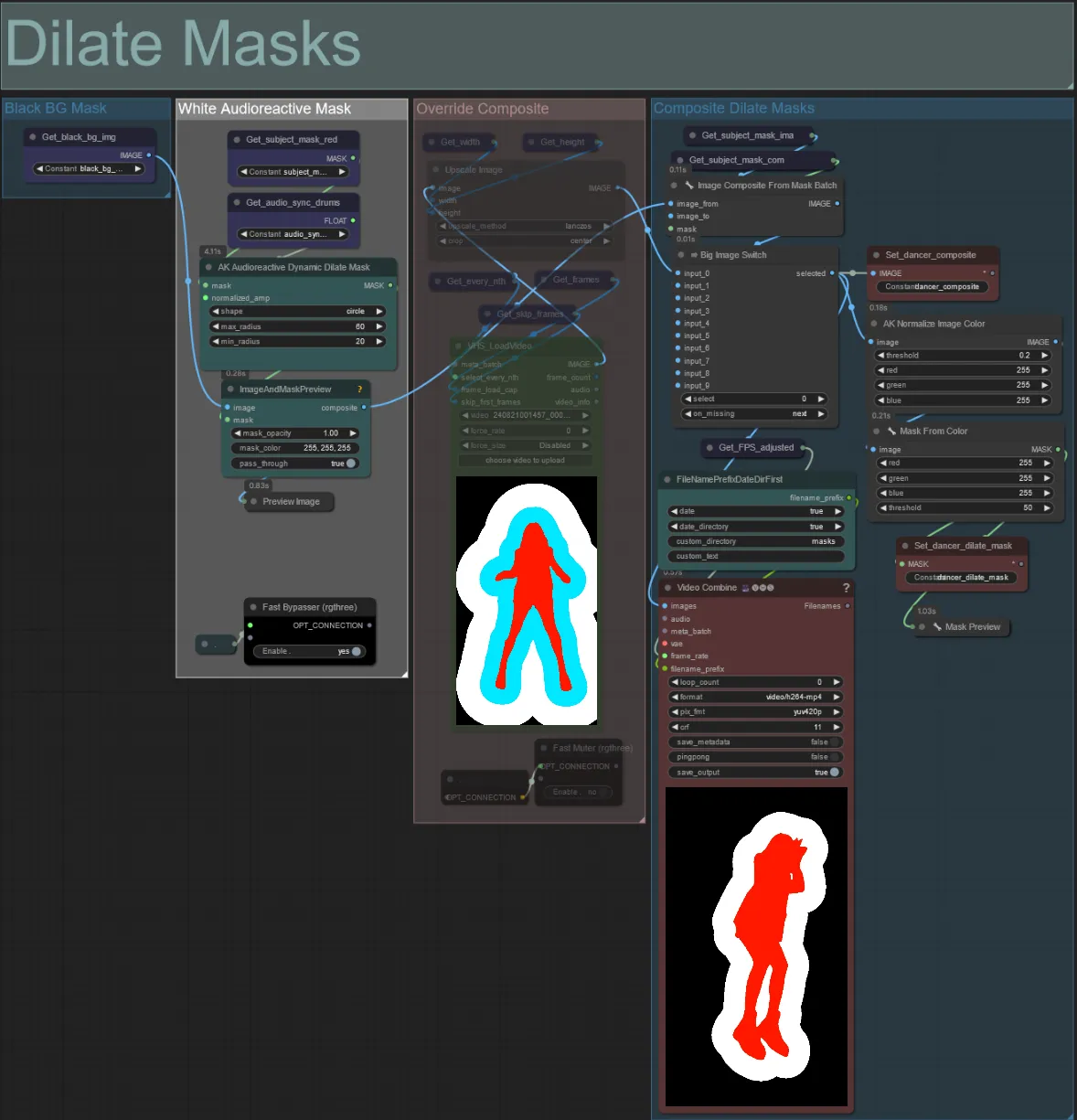

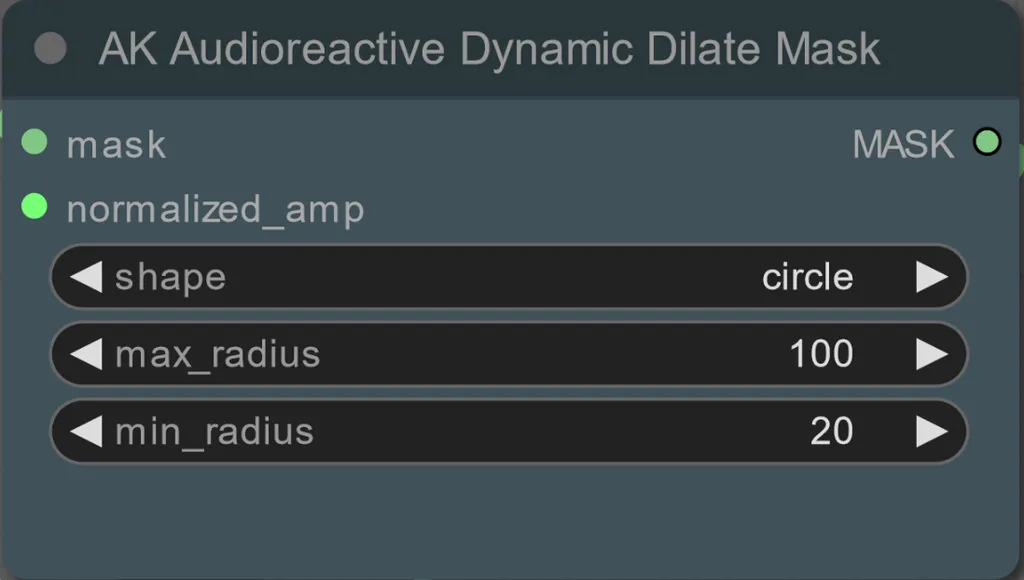

扩张遮罩

- 每个彩色组对应于将由其生成的扩张遮罩的颜色。

- 你可以使用以下节点设置扩张遮罩的最小和最大半径以及形状:

- 形状:“circle”是最准确的,但生成时间较长。准备进行最终渲染时设置此选项。“square”计算速度快,但准确性较低,最适合测试工作流程并决定IP适配器图像。

- max_radius:当振幅值为最大(1.0)时遮罩的半径(像素)。

- min_radius:当振幅值为最小(0.0)时遮罩的半径(像素)。

- 如果你已经生成了复合遮罩视频,你可以取消静音“覆盖复合遮罩”组并上传它。建议在覆盖时绕过扩张遮罩组以节省处理时间。

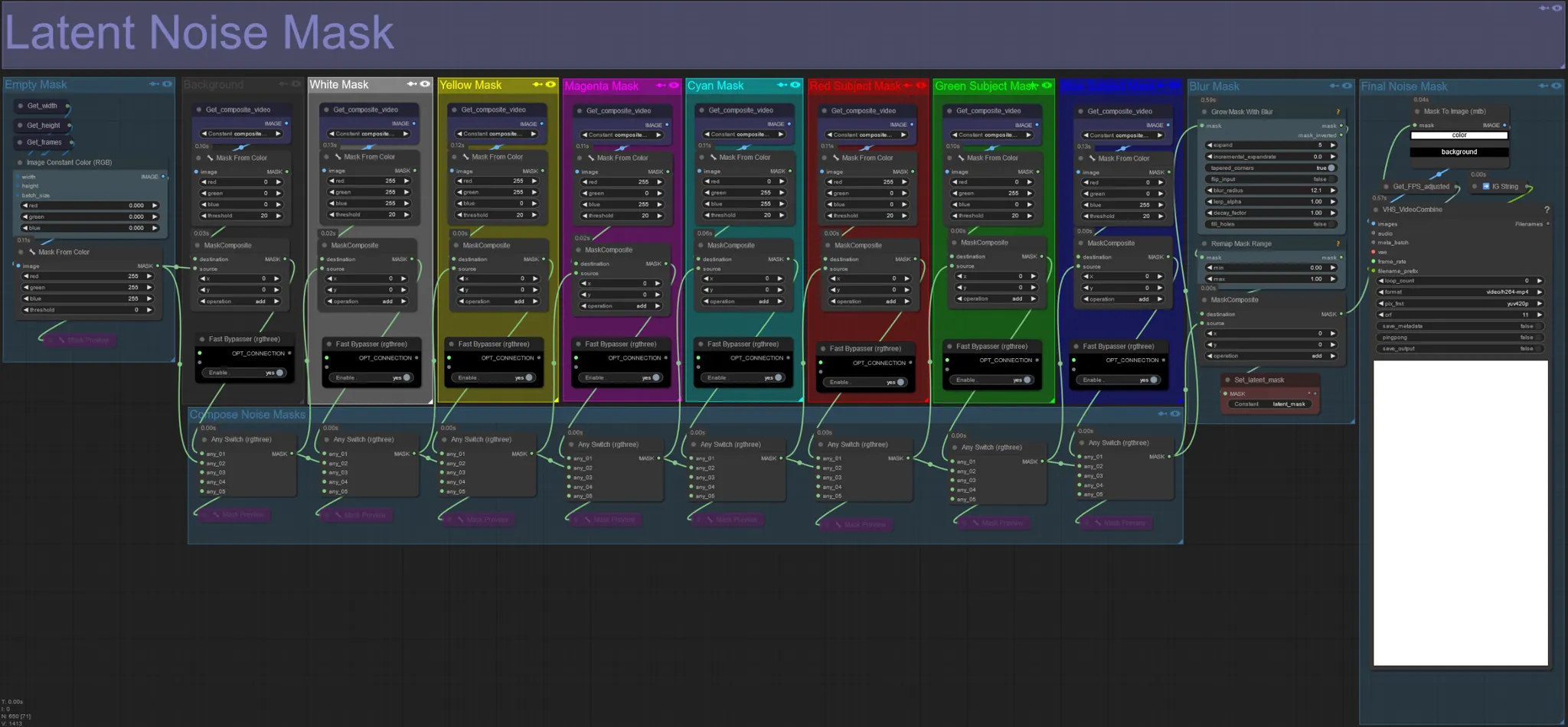

潜在噪声遮罩

- 使用潜在噪声遮罩控制哪些遮罩实际被ksampler扩散(梦境化)。绕过你不想扩散的彩色遮罩对应的组(即希望在上面显示原始视频中的元素)。

- 启用所有遮罩组会导致白色最终噪声遮罩(所有内容都会被扩散)。

- 示例: 点击快速绕过节点绕过红色主题遮罩组,以便你的舞者或主题出现在最终输出中。

原始输入视频:

绕过红色和黄色遮罩组:

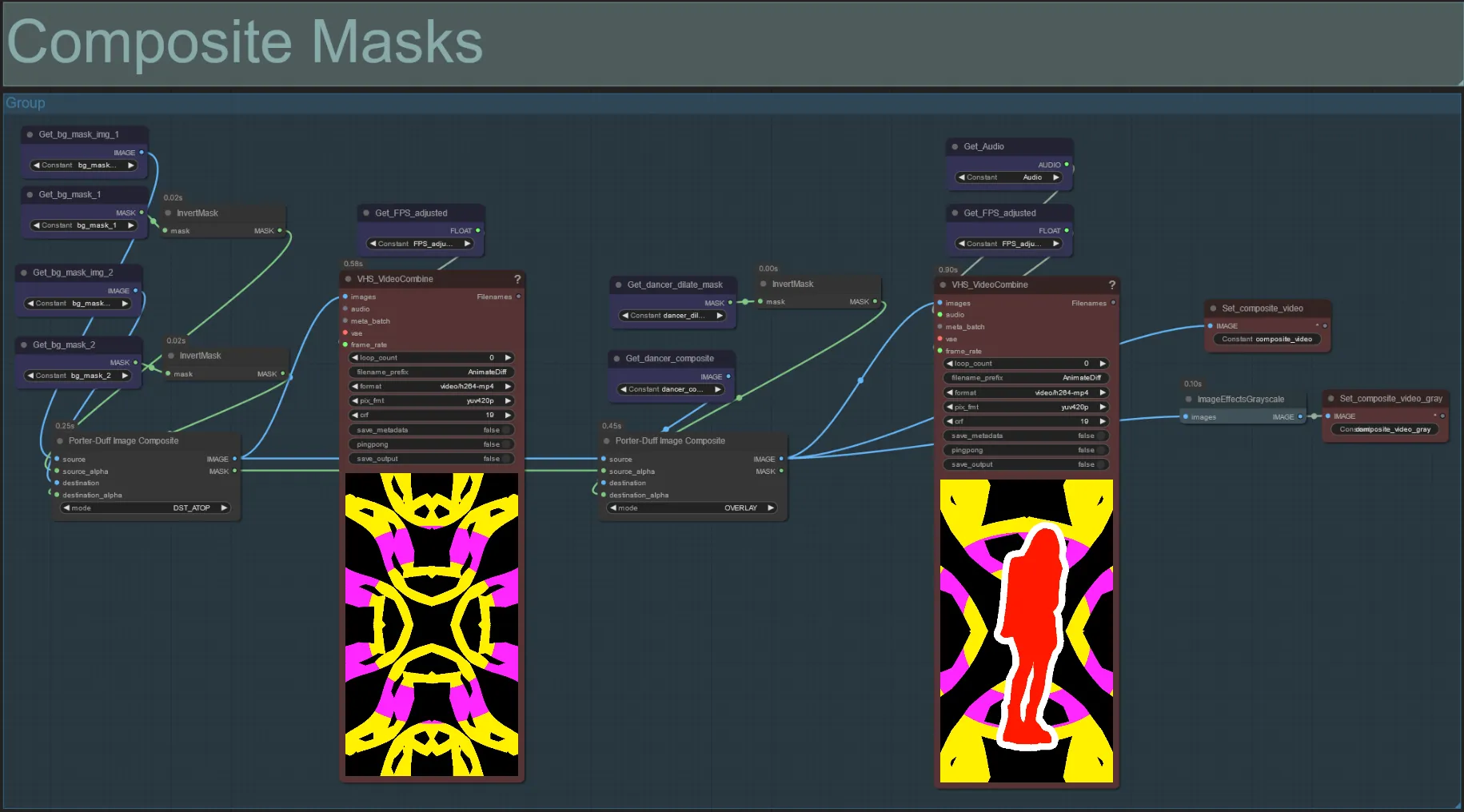

复合遮罩

- 此部分创建Voronoi噪声遮罩与主题遮罩(如果启用,还包括音频反应扩张遮罩)的最终复合。

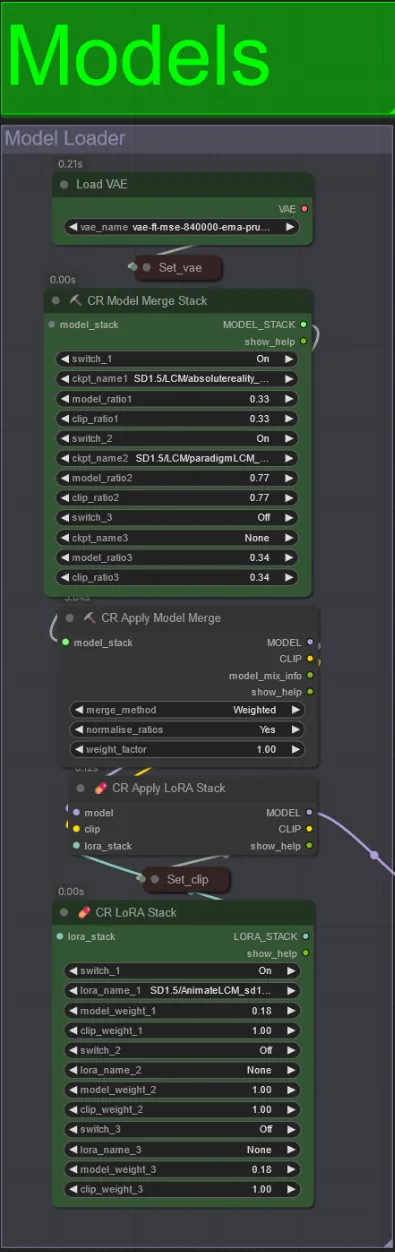

模型

- 使用一个好的LCM模型作为检查点。我推荐Machine Delusions的ParadigmLCM。

- 你可以使用模型合并堆栈将多个模型合并在一起以获得各种有趣的效果。确保启用的模型的权重总和为1.0。

- 你可以选择性地指定AnimateLCM_sd15_t2v_lora.safetensors,权重设置为0.18,以进一步增强最终结果。

- 使用模型加载器下方的Lora堆栈添加任何额外的Lora。

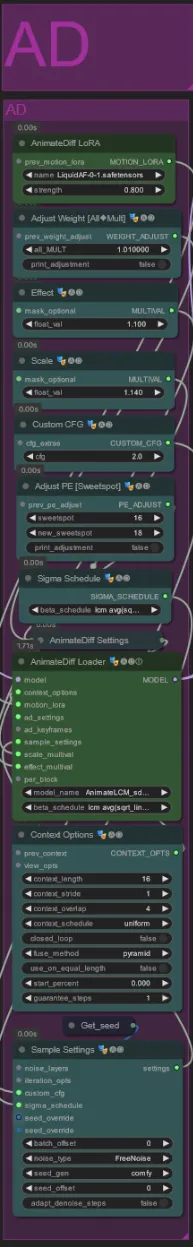

AnimateDiff

- 你可以设置不同的Motion Lora,而不是我使用的(LiquidAF-0-1.safetensors)。

- 增加/减少比例和效果浮动以增加/减少输出中的运动量。

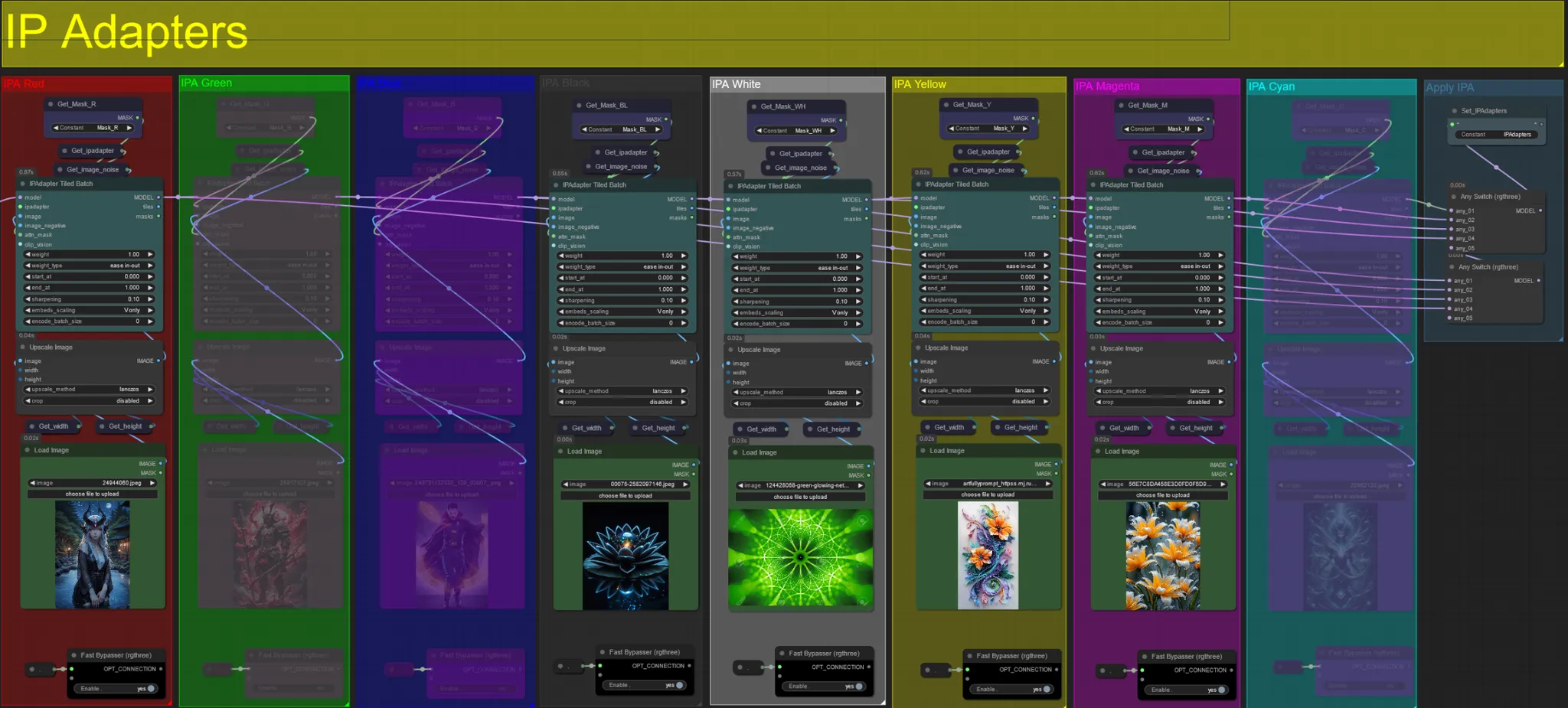

IP适配器

- 在这里,你可以指定将用于渲染扩张遮罩背景的参考图像,以及你的视频主题。

- 每个组的颜色表示其目标的遮罩:

红色、绿色、蓝色:

- 主题遮罩参考图像。

黑色:

- 背景遮罩图像,上传背景的参考图像。

白色:

- 扩张遮罩参考图像,为使用的每种颜色扩张遮罩上传一个参考图像。

黄色、洋红色

- Voronoi噪声遮罩参考图像。

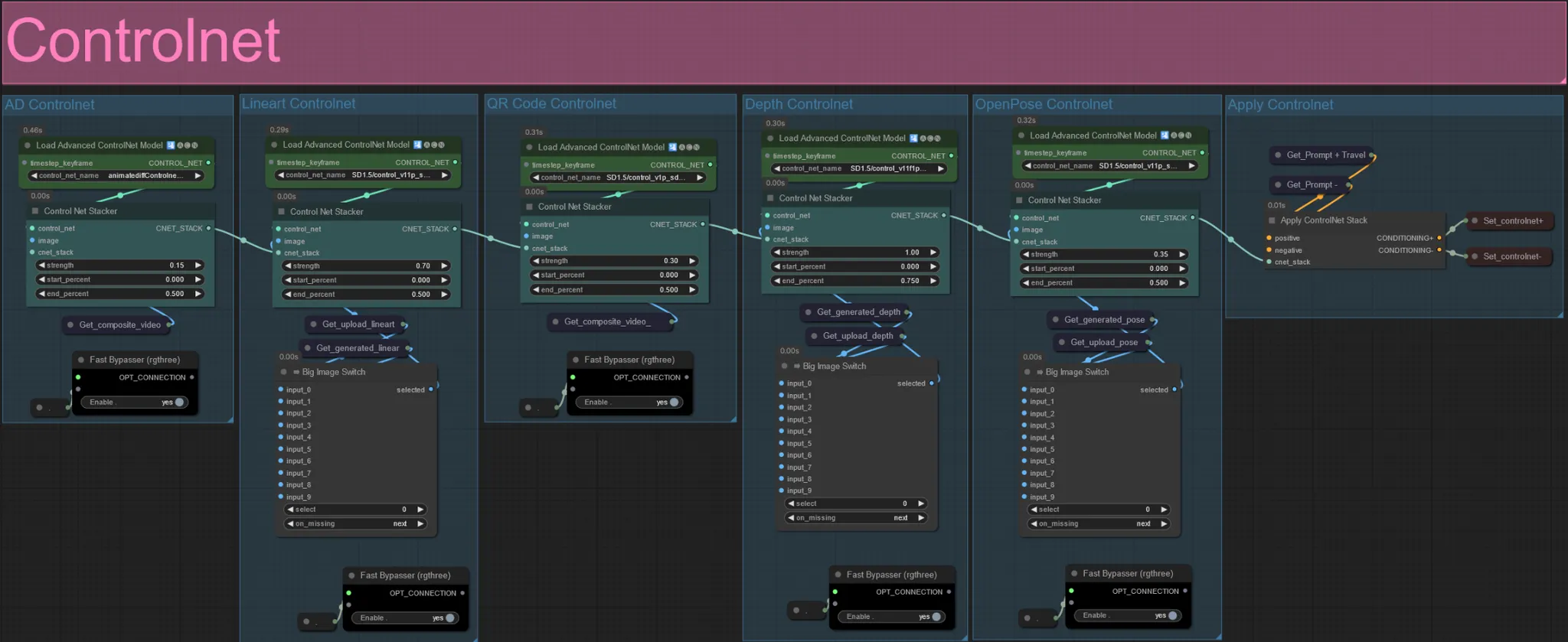

ControlNet

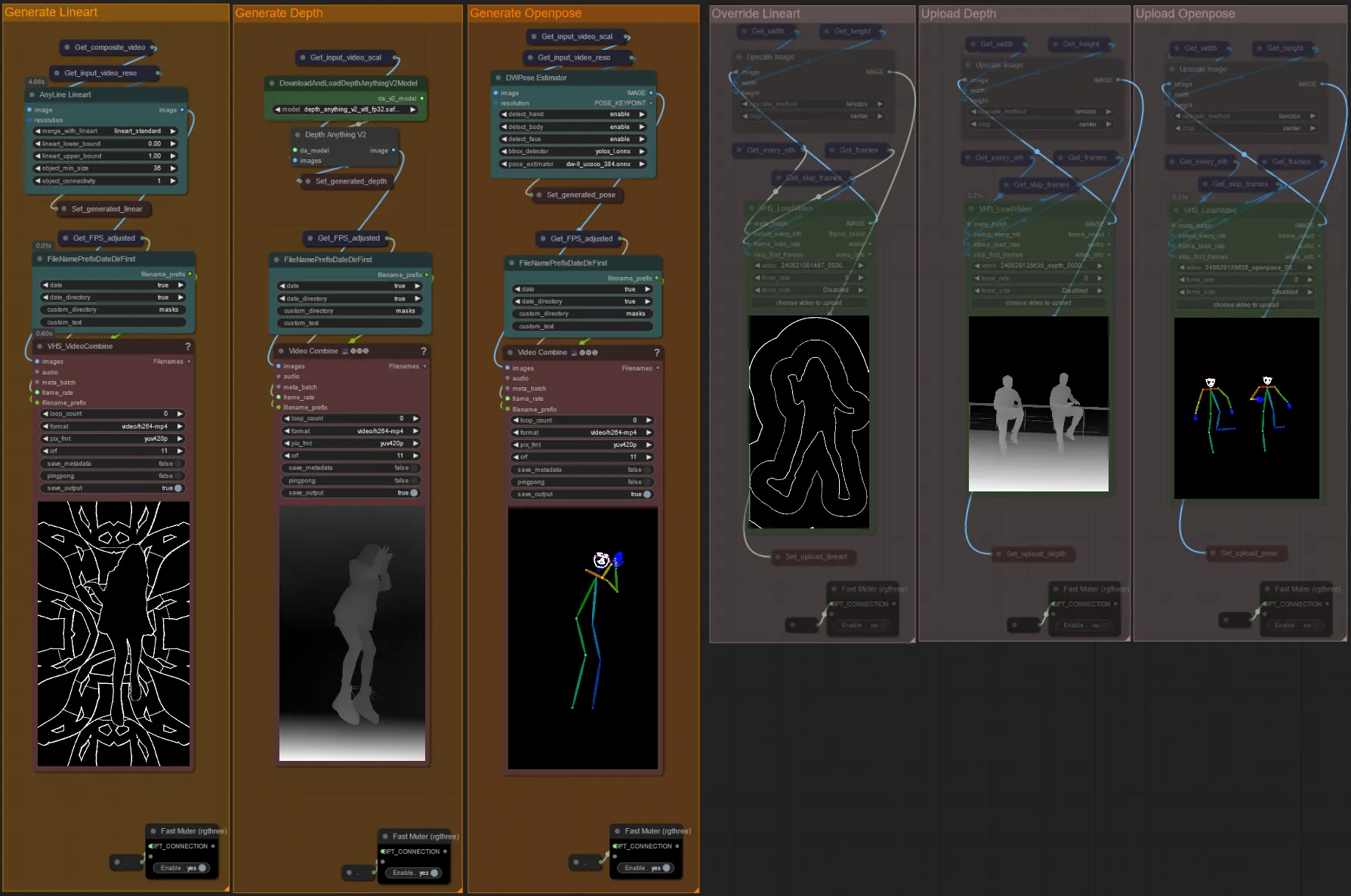

- 此工作流程使用5个不同的controlnet,包括AD、Lineart、QR Code、Depth和OpenPose。

- 所有controlnet的输入都是自动生成的

- 你可以选择取消静音“覆盖”组来覆盖Lineart、Depth和Openpose controlnet的输入视频,如下所示:

- 建议在覆盖时静音“生成”组以节省处理时间。

提示:

- 绕过Ksampler并使用完整的输入视频开始渲染。一旦所有预处理器视频生成完成,保存它们并上传到相应的覆盖中。从现在起,当测试工作流程时,你不必等待每个预处理器视频单独生成。

采样器

- 默认情况下,为了节省测试时的处理时间,HiRes Fix采样器组将被静音

- 我建议在尝试测试扩张遮罩设置时也绕过采样器组以节省时间。

- 在最终渲染时,你可以取消静音HiRes Fix组,这将放大并增加最终结果的细节。

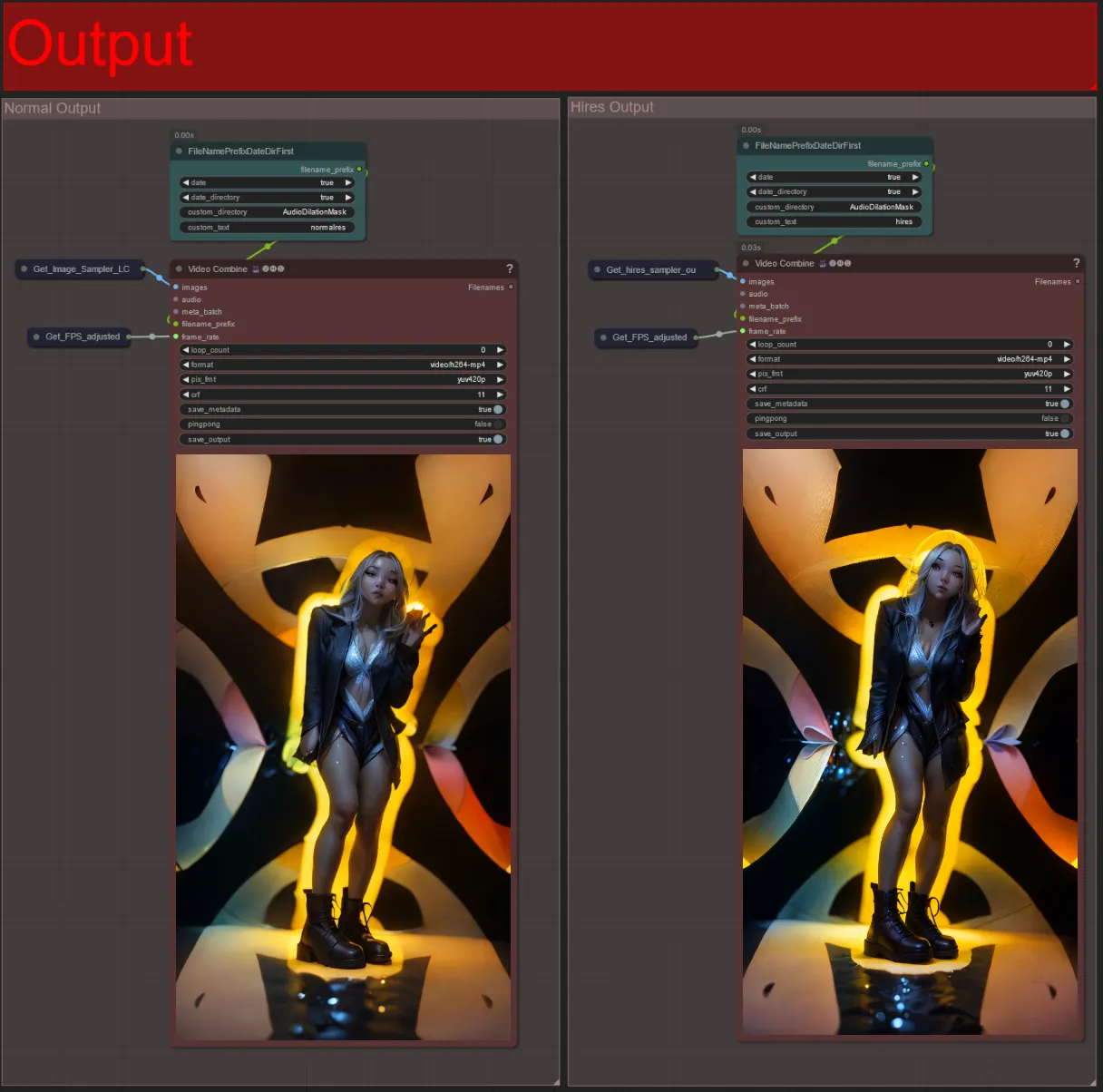

输出

- 有两个输出组:左侧是标准采样器输出,右侧是HiRes Fix采样器输出。

- 你可以通过更改“FileNamePrefixDateDirFirst”节点中的“custom_directory”字符串来更改文件的保存位置。默认情况下,此节点将输出视频保存在ComfyUI“output”目录中的时间戳目录中

- 例如

…/ComfyUI/output/240812/<custom_directory>/<my_video>.mp4

- 例如

创建一个音频反应视频可以为你的主题添加沉浸式、脉动的能量,每一帧都实时响应节拍。所以,进入音频反应艺术的世界,享受节奏引领的变革吧!

关于作者

Akatz AI:

- 网站:

联系方式:

- 邮箱:akatzfey@sendysoftware.com